Cache‑Invalidierungsmuster für schnell wechselnde Daten, die funktionieren

Praktische Cache‑Invalidierungs‑Muster für schnell wechselnde Daten: versionierte Keys, Tagging und kurze TTLs, damit Nutzer keine veralteten Ergebnisse mehr sehen.

Wie veralteter Cache in echten Apps aussieht

Veralteter Cache bedeutet, dass Ihre App Daten zeigt, die vor einem Moment noch zutrafen, jetzt aber falsch sind. Nutzer nennen es selten ein Caching‑Problem. Sie sagen: „Ihre Seite ist kaputt“, weil das, was sie sehen, nicht mit dem übereinstimmt, was sie gerade getan haben.

Es fällt am schnellsten dort auf, wo sich Daten ständig ändern:

- Ein Warenkorb‑Gesamtbetrag ist nach Hinzufügen oder Entfernen eines Artikels falsch.

- Auf einer Produktseite wird ein alter Preis angezeigt, aber im Checkout steht der neue Preis.

- Das Inventar sagt „auf Lager“, und dann schlägt die Bestellung fehl, weil nichts mehr da ist.

- Ein Dashboard spiegelt gerade abgeschlossene Zahlungen, Rückerstattungen oder Statusänderungen nicht wider.

- Ein Profil‑Update „speichert“, aber der alte Name oder Avatar kommt immer wieder zurück.

Schnell wechselnde Daten unterscheiden sich von meist statischen Seiten, weil die Kosten eines Fehlers sofort sind. Ein veralteter Blogpost ist ärgerlich. Ein veralteter Preis, Kontingent, Berechtigungsliste oder Lieferstatus kann zu verlorenen Verkäufen, Support‑Tickets und manchmal Sicherheitsproblemen führen (z. B. wenn jemand Daten sieht, auf die er keinen Zugriff mehr haben sollte).

Es hilft auch, konkret zu benennen, was gecacht wird. In realen Apps ist Caching nicht nur „die Seite“. Sie könnten eine API‑Antwort, ein Datenbank‑Query‑Ergebnis, einen berechneten Wert (wie „empfohlene Produkte“) oder eine vollständig gerenderte HTML‑Seite cachen. Oft werden mehrere Schichten gleichzeitig gecacht, weshalb Nutzer durch Refresh immer noch das Falsche sehen können.

Ein typisches Szenario: Sie deployen einen Prototypen, der mit einem KI‑Tool gebaut wurde, er wirkt schnell im Test, und dann driftet die Produktion. Ein Endpunkt cached „Kontostand“, ein anderer cached „letzte Transaktionen“ und die UI kombiniert beides. Das Ergebnis ist ein Kontostand, der falsch wirkt, obwohl jedes Stück für sich „korrekt“ ist.

Gute Invalidierung hat ein Ziel: nach einem Update darf die alte Antwort nicht mehr ausgeliefert werden.

Entscheiden Sie, wie frisch die Daten sein müssen

Bevor Sie Invalidierungs‑Muster wählen, entscheiden Sie, was „frisch" für jede Datenart bedeutet. Sagen Sie nicht „so frisch wie möglich“. Geben Sie eine Zahl an, z. B. „innerhalb von 5 Sekunden“, „innerhalb von 2 Minuten“ oder „muss bei jeder Anfrage korrekt sein“. Diese Entscheidung macht Caching aus Schätzung zu Plan.

Fragen Sie, was passiert, wenn ein Nutzer den alten Wert sieht. Manchmal ist die Auswirkung gering (ein Dashboard‑Graph ist eine Minute hinterher). Manchmal entsteht echter Schaden (ein Kunde wird falsch belastet oder im Checkout steht ein Artikel als verfügbar, obwohl er es nicht ist). Veraltete Reads sind nicht nur optisch schlecht, sie zeigen sich als Rückerstattungen, Support‑Tickets, wütende E‑Mails und Teams, die Entscheidungen auf falschen Berichten treffen.

Die meisten Apps brauchen unterschiedliche Freshness‑Regeln für verschiedene Daten. Nutzerspezifische Daten (Ihr Profil, Ihre Berechtigungen, Ihr Warenkorb) brauchen meist engere Freshness als globale Inhalte (Startseitentexte, Blogposts, öffentliche FAQs). Trennen Sie außerdem „kritisch“ von „nice to have“. Ein veraltetes Marketing‑Banner ist ärgerlich. Ein veralteter Abrechnungsstatus ist eine Krise.

Eine praktische Einteilung ist, jede Datengruppe mit einem Freshness‑Budget und einer Konsequenz‑Stufe zu versehen:

- Muss bei jeder Anfrage korrekt sein: Auth, Berechtigungen, Abrechnung, Zahlungsstatus

- Muss innerhalb von Sekunden korrekt sein: Inventar, Preis, Platzverfügbarkeit

- Kann eine Minute hinterherhinken: Aktivitätsfeeds, Analyse‑Summaries

- Kann Stunden hinterherhinken: statische Inhalte, Langzeit‑Reports

Das ist auch ein guter Moment, um „versteckte“ Veralterung zu entdecken. Bei KI‑generierten Prototypen wird Caching oft an der falschen Stelle eingeführt, z. B. Session‑State oder Benutzerrollen.

Die wichtigsten Cache‑Invalidierungs‑Muster im Überblick

Wenn sich Daten schnell ändern, fühlt sich Caching wie eine Falle an: Reads werden schneller, aber Sie riskieren, das Falsche zu zeigen. Die meisten realen Setups nutzen eine kleine Menge von Mustern. Entscheidend ist, das Muster zu wählen, das zu Ihrer Änderungsfrequenz und den Kosten eines „einen Moment falsch“-Zustands passt.

Kernansätze:

- Löschen (explizite Invalidierung): entferne gecachte Einträge, wenn sich die zugrunde liegenden Daten ändern.

- Ablauf (kurze TTL): lasse Einträge schnell sterben, damit alte Werte nicht lange bestehen.

- Bypass: überspringe den Cache für bestimmte Requests (oder Nutzer), wenn Frische zählt.

- Revalidieren: liefere aus dem Cache, prüfe aber, ob es noch gültig ist, und erneuere bei Bedarf.

Wann welches passt

Löschen funktioniert gut, wenn Updates klar sind und nicht zu häufig. Beispiel: Ein Admin bearbeitet einen Blogpost. Sie können die gecachte Seite (oder verwandte Keys) direkt nach dem Speichern löschen.

Ablauf (kurze TTL) ist ein guter Default, wenn Daten oft wechseln und Sie kurze Veralterung tolerieren können. Ändert sich ein Wert jede Minute, kann eine TTL von 10–30 Sekunden ausreichend sein, ohne komplexe Logik.

Bypass ist richtig, wenn Korrektheit schneller zählt als Geschwindigkeit. Beispiel: Checkout, Kontoeinstellungen, Berechtigungen oder alles, was mit Sicherheit zusammenhängt. Viele Apps cachen die meisten Reads, umgehen aber riskante Pfade.

Revalidierung passt, wenn Sie Geschwindigkeit und Frische wollen. Sie liefern den gecachten Wert, haben aber eine Regel, um zu erkennen, ob er veraltet ist (z. B. ein "last updated"‑Timestamp oder eine Version). Ist er alt, erneuern Sie im Hintergrund oder bei der nächsten Anfrage.

Das Tradeoff‑Dreieck: Geschwindigkeit, Kosten, Korrektheit

Jede Cache‑Entscheidung handelt von:

- Geschwindigkeit: wie schnell die Antwort ist

- Kosten: Compute, DB‑Last und Cache‑Churn

- Korrektheit: wie oft Nutzer veraltete Daten sehen

Löschen und Revalidierung verbessern meist die Korrektheit, kosten aber Implementationsaufwand. Kurze TTLs sind simpel, erhöhen aber Kosten (mehr Cache‑Misses) und erlauben trotzdem ein paar veraltete Reads.

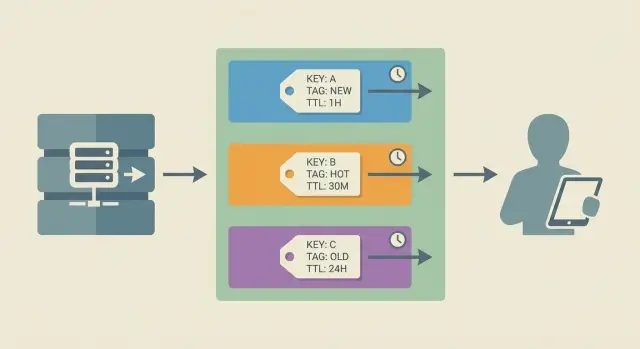

Ein nützliches Modell ist Keys, Gruppen und Zeit:

- Keys: die genauen Lookup‑Namen, die Sie speichern und abrufen (z. B.

product:123). - Gruppen: Wege, viele verwandte Keys gemeinsam zu invalidieren (oft per Tagging).

- Zeit: wie lange Einträge leben (TTL), bevor sie als alt gelten.

Die meisten soliden Setups kombinieren diese. Für schnell wechselnde Daten nutzen Sie oft versionierte Keys (Keys), Tagging (Gruppen) und kurze TTLs (Zeit), damit Sie schnell bleiben, ohne die Wahrheit von gestern zu servieren.

Schritt‑für‑Schritt: Wählen Sie einen Invalidierungsansatz für Ihre Daten

Die richtige Wahl startet damit, zu verstehen, wie Daten durch Ihre App fließen. Überspringen Sie das, und Sie löschen die falschen Dinge (oder nichts) und Nutzer sehen weiter alte Ergebnisse.

Schritt 1: Zeichnen Sie den Read‑Pfad (was wird wo und von wem gecacht)

Schreiben Sie den kompletten Weg einer typischen Leseanfrage auf. Beginnen Sie bei der Nutzeraktion und verfolgen Sie bis zur Datenbank. Notieren Sie jeden Cache auf dem Weg (Browser, CDN, API‑Layer, Redis, In‑Memory). Erfassen Sie, wie der Key aussieht und was die Antwort enthält.

Viele „veralteten Daten“-Bugs sind eigentlich „falsch geformt gecacht“-Bugs, z. B. eine komplette Seite cachen, die nutzerspezifische Daten enthält.

Schritt 2: Listen Sie die Schreibvorgänge, die die Antwort ändern sollten

Listen Sie Ereignisse auf, die ein gecachtes Ergebnis falsch machen. Denken Sie über „Datensatz bearbeiten“ hinaus: Importe, Hintergrundjobs, Rückerstattungen, Statusänderungen, Admin‑Tools und Drittanbieter‑Webhooks ändern oft Daten außerhalb des Haupt‑Codepfads.

Schritt 3–5: Wählen Sie Trigger, Umfang und Ihr Sicherheitsnetz

Nutzen Sie diese Checkliste, um den Ansatz dem Risiko anzupassen:

- Wählen Sie den Trigger: invalidieren bei Write (sofort), zeitbasiert (eventuell) oder beides kombinieren.

- Wählen Sie den Umfang: einen Eintrag löschen, eine Gruppe löschen oder alles löschen (selten richtig).

- Entscheiden Sie, wie Sie Einträge anvisieren: vorhersehbare Keys, versionierte Keys oder Tagging.

- Fügen Sie ein Backup hinzu für den Fall, dass Invalidierung fehlschlägt: konservative TTL, ein Nachprüfen gegen die Quelle der Wahrheit oder ein Freshness‑Check.

- Loggen Sie es: protokollieren Sie, wann Invalidierung passiert und wie viele Keys betroffen waren.

Beispiel: Wenn ein Produkt‑Update sowohl die Produktseite als auch die Kategorieseiten ändert, reicht Single‑Key‑Löschen nicht. Group‑Invalidierung (Tagging) oder versionierte Keys passen hier besser.

Versionierte Keys: Alte Daten stoppen, indem der Key sich ändert

Versionierte Keys sind eine einfache Idee mit hoher Belastbarkeit. Statt zu versuchen, den alten Cache‑Wert zu löschen, ändern Sie den Cache‑Key, wenn die Daten sich ändern. Neuer Key bedeutet neuer Wert. Der alte Eintrag kann bleiben, bis er ausläuft.

Ein grundlegendes Muster sieht so aus:

user:123:v17 -> gecachte JSON für user 123

Wenn der Nutzer aktualisiert wird, erhöhen Sie die Version zu v18. Jeder Read verfehlt dann den alten Eintrag und füllt einen neuen.

Woher die Version stammen kann

Wählen Sie eine Versionsquelle, die sich leicht beim Lesen holen lässt und schwer falsch zu machen ist:

- Monoton steigende Zahl (am zuverlässigsten): speichern Sie

user_versionin der Datenbank und erhöhen Sie sie beim Schreiben. updated_at‑Timestamp (einfach): nutzen Sie einen normalisierten Zeitstempel wie20260116T1030Z.- Content‑Hash (genau, aber aufwändiger): hashen Sie den serialisierten Datensatz oder eine Teilmenge der Felder.

Monotone Versionen sind normalerweise am zuverlässigsten, da Zeitstempel Rundungs‑ und Clock‑Probleme haben können.

Verwandte Keys handhaben (wenn eine Änderung viele Antworten betrifft)

Das Schwierige ist selten das einzelne Objekt. Es ist alles, was daraus gebaut wird: user:123:profile_page, user:123:dashboard_summary, team:9:members.

Ein praktischer Ansatz ist ein gemeinsamer „Anchor‑Version“ für die Entität, die sich fächert. Zum Beispiel enthält jede Antwort, die von user 123 abhängt, user:123:v{user_version} im Key. Wenn user 123 sich ändert, ändern sich automatisch alle diese Keys, ohne raten zu müssen, welche Cache‑Keys existieren.

Vorteile: keine Massenlöschungen, sicherer bei Concurrency, funktioniert gut für CDN‑Caching und größtenteils unveränderliche Objekte.

Nachteile: Der Cache kann wachsen (alte Versionen bleiben), daher brauchen Sie trotzdem TTLs und gelegentliche Bereinigung, wenn der Speicher knapp wird.

Tagging: Gruppen invalidieren, ohne Keys zu raten

Tagging ist einfach: Wenn Sie etwas in den Cache schreiben, hängen Sie ein oder mehrere Tags an. Später, wenn sich die zugrunde liegenden Daten ändern, löschen Sie per Tag (z. B. "entferne alles mit dem Tag product:123") statt zu versuchen, sich an jeden Key zu erinnern, der dieses Produkt enthalten könnte.

Das passt gut zur Realität: Eine Änderung betrifft oft viele gecachte Antworten: Produktseite, Suchergebnis, ein „verwandte Artikel“‑Widget und vielleicht eine mobile API‑Antwort. Tagging erlaubt das Löschen des ganzen Sets mit einer Aktion.

Gutes Tagging‑Design ist langweilig und vorhersehbar. Beginnen Sie mit Tags, die Ihre Domain‑Objekte und Nutzeransichten spiegeln:

- pro Nutzer:

user:42 - pro Account/Team:

account:9 - pro Produkt:

product:123 - pro Kollektion/Liste:

category:shoesodercollection:summer-2026 - pro Rollenberechtigung:

role:admin

Seien Sie vorsichtig mit Over‑Tagging. Wenn jeder Cache‑Eintrag 10 Tags bekommt „aus Vorsicht“, wird Invalidierung teuer und riskant. Das Schlimmste ist eine Fan‑Out‑Purge, bei der eine einzelne Änderung Tausende Keys löscht und eine Thundering‑Herd‑Recompute‑Welle auslöst. Eine gute Regel ist, nur nach Daten zu taggen, die die Ausgabe wirklich verändern.

Der andere schwierige Punkt ist Bookkeeping: Sie brauchen eine sichere Methode, Tags auf Keys zu mappen (oder eine cache‑native Tag‑Indexierung). Gängige Ansätze sind ein kleiner Tag‑Index mit eigener TTL, Begrenzung der Index‑Größe pro Tag, und das Fehlen von Index‑Einträgen als normal zu behandeln, während TTL die Bereinigung macht.

Konkretes Beispiel: Wird Produkt 123 aktualisiert, löschen Sie product:123 und category:shoes. Das leert Produktdetail‑Caches und den Kategorie‑Seiten‑Cache, ohne wissen zu müssen, ob der Key productPage:123:en oder v2:mobile:product:123 hieß.

Kurze TTLs und kontrolliertes Auffrischen

Kurze TTLs (Time to Live) sind der einfachste Weg, veraltete Daten einzuschränken. Sie lassen Cache‑Einträge schnell verfallen, sodass die maximale Veralterung begrenzt ist. TTLs sind ein Sicherheitsnetz, nicht der gesamte Plan. Wenn Daten unvorhersehbar wechseln, liefert TTL allein weiterhin alte Werte bis der Timer abläuft.

TTLs sind sinnvoll, wenn Sie etwas hinterherhinken können und das Hauptziel Geschwindigkeit unter Last ist. Sie versagen, wenn ein Update sofort sichtbar sein muss (Preise im Checkout, Berechtigungen, Account‑Status).

Kontrolliertes Auffrischen hält den Cache schnell, ohne die Kosten der Misses den Nutzern aufzubürden. Zwei gängige Ansätze:

- Auffrischen im Hintergrund: liefern Sie den gecachten Wert und, wenn er nah am Ablauf (oder gerade abgelaufen) ist, triggern Sie asynchron ein Refresh.

- Beim nächsten Request auffrischen: die erste Anfrage nach Ablauf baut die Daten neu auf, während andere kurz warten oder kurz den alten Wert wiederverwenden.

Beide funktionieren besser mit Jitter. Wenn jeder Key exakt nach 60 Sekunden ausläuft, können viele Items gleichzeitig ablaufen und Sie bekommen einen plötzlichen Datenbank‑Spike. Jitter randomisiert TTL ein wenig (z. B. 45–75 Sekunden). Die Freshness bleibt ähnlich, aber die Abläufe verteilen sich.

Das andere große Risiko ist das Thundering‑Herd‑Problem: viele Requests treffen denselben abgelaufenen Key und versuchen gleichzeitig, ihn neu zu bauen. Vermeiden Sie das mit Request‑Coalescing (Single‑Flight): erlauben Sie nur eine Erneuerung für einen gegebenen Key zur Zeit, und lassen Sie andere Requests auf das Ergebnis warten oder kurz einen leicht veralteten Wert verwenden.

Ein einfaches Modell:

- Wenn ein Key frisch ist, geben Sie ihn zurück.

- Wenn er veraltet ist, lässt eine Anfrage ihn neu berechnen.

- Alle anderen warten kurz oder verwenden den veralteten Wert innerhalb eines kleinen Grace‑Fensters.

Nur‑TTL kann akzeptabel sein, wenn eventuale Korrektheit ausreicht, z. B. Dashboards, Activity‑Feeds, Suchvorschläge und read‑schwere Inhalte, die in Batches aktualisiert werden.

Beispiel: Preise und Inventar, die sich jede Minute ändern

Stellen Sie sich einen Onlineshop während eines Flash‑Sales vor. Preise ändern sich mit Start/Ende von Aktionen und Inventar sinkt mit jedem Checkout. Ist der Cache auch nur leicht falsch, sehen Kunden „auf Lager“, obwohl es nicht mehr so ist, oder sie bekommen einen Warenkorb‑Total, das nicht zum Checkout passt.

Teams cachen oft teuer zu berechnende Responses wie Produktdetailseiten, Kategorieseiten, Suchergebnisse und Warenkorb‑Totals. Das Ziel ist, ein paar Invalidierungs‑Muster zu kombinieren, damit Sie nicht jeden Key erraten müssen.

Eine praktische Mischung, die funktioniert

Verwenden Sie versionierte Cache‑Keys für den „Single Source of Truth“ eines Produkts. Beispiel: cache product:{id}:v{productVersion}, wobei productVersion erhöht wird, wenn Preis oder Inventar sich ändert.

Nutzen Sie Cache‑Tagging für Seiten, die viele Produkte enthalten, wie Kategorieseiten. Taggen Sie den Kategorie‑Cache mit category:{categoryId} und zusätzlich mit Tags für die angezeigten Produkte (z. B. product:{id}), damit ein Produkt‑Update jede Seite entfernt, die es zeigte.

Nutzen Sie kurze TTLs für Suchergebnisse. Suchanfragen sind zu zahlreich, um sie gut zu taggen, und Ergebnisse ändern sich ständig. Eine TTL von 10–30 Sekunden plus kontrolliertes Auffrischen (hintergrundgestützt) ist meist besser, als jeden möglichen Query invalidieren zu wollen.

Ablauf: ein Inventar‑Update

Ein Kunde kauft die letzte Einheit von Produkt 42. Ihr System schreibt das neue Inventar in die DB und erhöht productVersion für 42.

Was jetzt passieren sollte:

- Requests für Produkt 42 nutzen den neuen versionierten Key, sodass das alte „auf Lager“‑Payload nicht mehr ausgeliefert werden kann.

- Die Kategorie‑Seite, die Produkt 42 zeigte, wird per

product:42‑Tag invalidiert, selbst wenn Sie den genauen Cache‑Key nicht kennen. - Suchergebnisse könnten Produkt 42 noch ein paar Sekunden zeigen, aber die TTL begrenzt die Abweichung und der nächste Refresh korrigiert es.

Fehlermodus ohne diese Mischung: Sie löschen nur die Produktseite, während Kategorie und Suche weiterhin „auf Lager“ zeigen und Warenkorb‑Totals zu lange im Cache bleiben.

Häufige Fehler und Fallstricke

Die meisten Cache‑Bugs sind nicht „der Cache ist kaputt“. Es sind kleine Design‑Entscheidungen, die Updates schwer nachvollziehbar machen.

Sich ausschließlich auf kurze TTLs für kritische Daten zu verlassen, ist ein häufiger Fehler. TTLs sind gut für eine Homepage‑Feed, aber gefährlich für Abrechnung, Berechtigungen, Account‑Status oder alles, was jemanden aussperren oder falsch belasten kann. Muss die Daten jetzt korrekt sein, nutzen Sie ein Invalidierungs‑Signal (versionierte Keys oder Tags), nicht „warte eine Minute und es ist wieder gut".

Ein weiterer Fehler ist zu breit zu invalidieren. Alles bei jedem Update zu purgen fühlt sich sicher an, kann aber Stampedes, DB‑Lastspitzen und langsamere Seiten für alle verursachen. Es verbirgt auch das eigentliche Problem: Sie wissen nicht, welche Keys sich ändern müssen.

Leute vergessen außerdem abgeleitete Caches. Sie invalidieren vielleicht das Item selbst, lassen aber Listen, Zählungen, Aggregationen und Suchergebnisse stehen, die daraus gebildet wurden. Beispiel: Sie aktualisieren einen Produktpreis, löschen product:123, vergessen aber category:shoes:page1, top-deals und search:shoes:sort=price. Nutzer sehen weiter die alte Zahl.

Seien Sie vorsichtig, geteilte vs. nutzerspezifische Caches zu mischen. Fehlt die Nutzer‑(oder Tenant‑)Dimension im Key, kann privater Content geleakt werden. Das tritt oft bei „meine Bestellungen“, Feature‑Flags und permission‑geprüften Antworten auf.

Und schließlich: überspringen Sie nicht das Logging. Ohne Aufzeichnung dessen, was was invalidiert hat, werden Bugs schwer reproduzierbar.

Eine einfache Sicherheitsliste:

- Verwenden Sie nicht nur TTL für Geld, Auth oder Berechtigungen.

- Invalidieren Sie eng (per Tag oder Version), nicht global.

- Karten und leeren Sie abgeleitete Sichten (Listen, Aggregationen, Suche).

- Trennen Sie Shared‑ vs. User‑Caches mit klaren Key‑Regeln.

- Loggen Sie Invalidierungsereignisse und beobachten Sie Cache‑Misses bei Updates.

Schnell‑Checkliste und nächste Schritte

Bei oft wechselnden Daten ist das Ziel nicht „niemals veraltet“. Es ist: „nur dort veraltet, wo es akzeptabel ist, und niemals dort, wo es schadet." Schreiben Sie Freshness‑Regeln pro Endpoint, nicht als vagen Global‑Regel.

Schnellchecks vor dem Deploy

- Markieren Sie jede Response als muss korrekt sein vs kann kurz veraltet sein (mit Max‑Age wie 5s, 30s, 2m).

- Stellen Sie sicher, dass für jeden Write (create/update/delete) eine passende Invalidierung, Tag‑Purge oder Versionserhöhung existiert.

- Überprüfen Sie Cache‑Keys auf fehlende Dimensionen: Nutzer‑ oder Account‑ID, Rolle/Plan, Locale/Currency, Gerät, Filter/Sort/Page und Preview vs Live.

- Fügen Sie Grundmetriken hinzu: Hit‑Rate, Stale‑Rate (wie oft alte Daten ausgeliefert wurden) und Invalidierungs‑Zählung.

- Testen Sie einen "Bad‑Day"‑Flow: schnelle Updates, Retries und konkurrierende Nutzer. Stellen Sie sicher, dass niemals Nutzerdaten an andere Nutzer ausgeliefert werden.

Nächste Schritte, die sich lohnen

Wählen Sie einen hochwirksamen Bereich (Preise, Inventar, Berechtigungen) und machen Sie ihn langweilig: klare Key‑Regeln, eine primäre Invalidierungsmethode und ein kleiner Test, der beweist, dass Updates sichtbar werden.

Wenn Sie einen KI‑generierten Code geerbt haben, sitzen Probleme mit veralteten Daten oft neben anderen Produktionsblockern wie inkonsistenten Auth‑Checks und schwer nachvollziehbarer Logik. Wenn Sie Hilfe beim Entwirren brauchen, kann FixMyMess (fixmymess.ai) beim Diagnostizieren und Reparieren von KI‑generierten Codebasen helfen, inklusive Caching und Invalidierungspfaden, sodass das Produktionsverhalten vorhersehbar wird.

Häufige Fragen

Wie sieht ein veralteter Cache für Nutzer eigentlich aus?

Veralteter Cache ist, wenn Ihre App eine ältere Antwort liefert, obwohl die zugrunde liegenden Daten sich bereits geändert haben. Nutzer bemerken das als Widersprüche, z. B. ein Warenkorb‑Gesamtbetrag, der nicht zum Checkout passt, ein Profilwechsel, das „speichert“ und wieder zurückspringt, oder Inventar, das „auf Lager“ angibt, kurz bevor eine Bestellung fehlschlägt.

Wie entscheide ich, wie frisch meine Daten sein müssen?

Beginnen Sie damit, für jeden Datensatz ein Freshness‑Budget festzulegen, z. B. „muss bei jeder Anfrage korrekt sein“ oder „darf bis zu 30 Sekunden hinterherhinken“. Lassen Sie die Konsequenz entscheiden: Geld, Auth und Berechtigungen brauchen normalerweise sofortige Korrektheit; Analyse‑Summaries dürfen Verzögerung haben.

Wann soll ich Delete vs. TTL vs. Bypass vs. Revalidate verwenden?

Verwenden Sie explizite Invalidierung (Löschen), wenn Sie Schreibvorgänge zuverlässig erkennen und die Betroffenheit klar ist. Verwenden Sie kurze TTLs, wenn Staleness akzeptabel ist und Updates häufig oder schwer zu verfolgen sind. Bypassen Sie den Cache, wenn Korrektheit wichtiger ist als Geschwindigkeit (z. B. Checkout, Berechtigungsprüfungen). Revalidierung passt, wenn Sie meist schnell sein wollen, aber Regeln brauchen, um bei Änderungen zu aktualisieren.

Was sind versionierte Cache‑Keys und warum verhindern sie veraltete Reads?

Versionierte Keys ändern den Cache‑Schlüssel, wenn sich Daten ändern, sodass alte Einträge nicht mehr zurückgegeben werden können. Ein gängiges Muster ist user:123:v18, wobei die Version bei jedem relevanten Schreiben erhöht wird. Das reduziert Race‑Conditions und „vergessen zu löschen“-Bugs, solange Sie zusätzlich TTLs setzen, damit alte Versionen nicht für immer hängen bleiben.

Wie hilft Cache‑Tagging, wenn ein Update viele Seiten betrifft?

Tagging erlaubt es, Gruppen von zwischengespeicherten Antworten zu invalidieren, ohne jeden Key‑Namen vorher zu kennen. Sie hängen Tags wie product:123 oder category:shoes an, wenn Sie in den Cache schreiben, und löschen per Tag, wenn ein Produkt oder eine Kategorie sich ändert. Das ist nützlich, wenn eine Änderung viele Seiten, Widgets und API‑Payloads betrifft.

Wie nutze ich kurze TTLs, ohne Traffic‑Spitzen oder langsame Seiten zu verursachen?

Nutzen Sie kurze TTLs als Sicherheitsnetz für Daten, bei denen kurze Verzögerungen akzeptabel sind, und ergänzen Sie kontrolliertes Auffrischen, damit Nutzer nicht die Kosten der Cache‑Misses tragen müssen. Fügen Sie Jitter hinzu, damit nicht viele Einträge exakt gleichzeitig ablaufen, und verwenden Sie Single‑Flight (Request‑Coalescing), damit nur eine Anfrage einen abgelaufenen Key neu berechnet, während andere kurz warten oder einen kleinen Grace‑Wert weiterverwenden.

Warum zeigt das Neuladen der Seite manchmal immer noch falsche Daten?

Weil „der Cache" oft nicht nur „die Seite" ist, sondern ein Stack aus Browser, CDN, API und In‑Memory‑Layern. Sie können die Seite neu laden und immer noch die alte Antwort sehen, wenn eine Schicht weiterhin eine veraltete API‑Antwort oder ein gerendertes HTML‑Fragment liefert. Die Lösung ist, den kompletten Read‑Pfad zu kartieren und sicherzustellen, dass Ihre Invalidierungsstrategie jede Schicht abdeckt, die diese Daten ausliefern kann.

Was sind „abgeleitete Caches“ und warum halten sie veraltete Daten?

Abgeleitete Caches sind Listen, Zählungen, Aggregationen, Suchergebnisse und „empfohlene“ Blöcke, die aus anderen Objekten gebaut werden. Ein häufiger Fehler ist, product:123 zu löschen, aber Kategorie‑Grids, „Top‑Deals“ oder ein gecachter Warenkorb‑Total zu vergessen, die die alte Zahl weiterzeigen. Planen Sie Invalidierung rund um das, was der Nutzer sieht, nicht nur rund um die Datenbankzeile, die sich geändert hat.

Wie vermeide ich, nutzerspezifische Daten falsch zu cachen?

Wenn Ihr Cache‑Key nicht die richtigen Dimensionen enthält, können geteilte Cache‑Einträge zwischen Nutzern oder Mandanten leaken oder vermischt werden. Das passiert oft bei „meine Bestellungen“, rollenbasierten Antworten, Feature‑Flags, Locale/Currency oder plan‑abhängigem Zugriff. Nehmen Sie standardmäßig Benutzer‑ oder Account‑IDs in den Key auf, wenn die Ausgabe variieren kann, und umgehen Sie den Cache für sensible Endpunkte, wenn Sie unsicher sind.

Was soll ich tun, wenn eine KI-generierte App in Produktion wegen Caching driftet?

Beginnen Sie damit, Invalidierungsereignisse zu protokollieren und zu verfolgen, wann veraltete Werte ausgeliefert werden, nicht nur die Trefferquote. Wenn Sie einen KI-generierten Prototyp übernommen haben, sitzen Probleme mit veralteten Daten oft neben Auth‑Lücken, inkonsistenter Business‑Logik und versteckten Schreibpfaden wie Webhooks und Hintergrundjobs. Wenn Sie eine schnelle, verifizierte Lösung wollen, kann FixMyMess (fixmymess.ai) ein kostenloses Code‑Audit durchführen und Caching‑ sowie Invalidierungspfade reparieren, damit das Produktionsverhalten vorhersehbar wird.