Hosting nach dem Prototyp wählen: Serverless vs. Container

Wählen Sie Hosting nach dem Prototyp mit einer einfachen Entscheidungstabelle für Traffic, Hintergrundjobs und Datenbanken über Serverless, Container und verwaltete Plattformen.

Warum Hosting direkt nach dem Prototyp schwierig wird

Ein Prototyp fühlt sich schnell an, weil er nur für eine kleine Gruppe, für kurze Zeit und in einer kontrollierten Umgebung funktionieren muss. Vielleicht testen Sie mit Seed‑Daten, einem Admin‑User und wenigen Seiten. Sobald echte Nutzer erscheinen, verhält sich dieselbe App anders: mehr Logins, mehr Uploads, mehr Reloads und mehr Edge‑Fälle.

Hosting‑Entscheidungen werden schwieriger, weil Prototypen oft die langweiligen Teile überspringen, die darüber entscheiden, ob eine App in Produktion überlebt: Uptime, Retries, Ratenbegrenzungen, Secrets und wie die Datenbank unter Last reagiert. Wenn Sie diese Grundlagen schließlich brauchen, stehen Sie zwischen Optionen, die ähnlich klingen, aber sehr unterschiedlich funktionieren.

Typische Zeichen, dass Ihre aktuelle Umgebung zu klein ist:

- Seiten werden langsam, wenn ein paar Leute die App gleichzeitig nutzen

- Hintergrundaufgaben schlagen manchmal fehl, ohne klaren Grund

- Datenbankverbindungen timen out oder Sie treffen auf „zu viele Verbindungen“

- Deploys sind beängstigend, weil eine Änderung alles kaputt machen kann

- Sie finden API‑Keys oder Passwörter im Klartext

Sie brauchen kein tiefes DevOps‑Wissen, um eine solide Hosting‑Wahl zu treffen. Sie brauchen eine klare Methode, die Bedürfnisse Ihrer App dem richtigen Hosting‑Typ zuzuordnen, damit Sie nicht zweimal neu bauen.

Wenn Leute „Traffic, Jobs und Datenbank“ sagen, meinen sie normalerweise:

- Traffic: Nutzer laden Seiten und rufen APIs auf. Die Schlüsselfrage ist, ob die Nutzung stabil (vorhersagbar) oder spiky (meist ruhig, dann plötzlich busy) ist.

- Jobs: Arbeit, die im Hintergrund läuft, wie E‑Mails senden, Reports generieren, Uploads verarbeiten oder Daten synchronisieren. Die Frage ist, ob sie zuverlässig laufen muss, auch wenn niemand aktiv die App benutzt.

- Datenbank: Wo Ihre App Daten und Zustand speichert. Die Frage ist, ob sie lang lebende Verbindungen, Migrations‑ und Backup‑Strategien und konsistente Performance braucht.

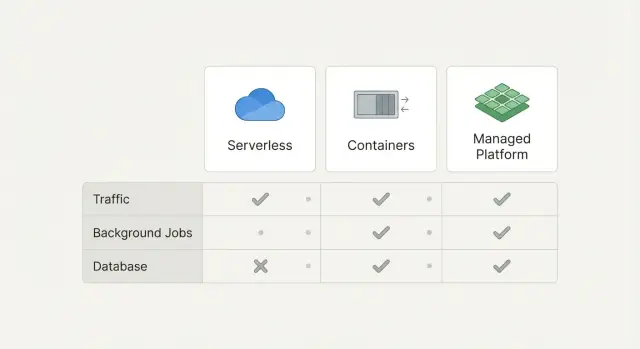

Dieser Beitrag vergleicht Serverless, Container und verwaltete Hosting‑Plattformen anhand einfacher Entscheidungstabellen.

Was Sie aufschreiben sollten, bevor Sie Optionen vergleichen

Bevor Sie Serverless, Container oder eine verwaltete Plattform wählen, notieren Sie, was Ihre App im Alltag tatsächlich tut. Das verhindert, dass Sie nach Gefühlen entscheiden und es später neu machen müssen.

Beginnen Sie mit einer einfachen Karte Ihrer Seiten und Flows. Listen Sie die Hauptansichten (Marketing‑Seite, Dashboard, Einstellungen, Admin, Checkout) und markieren Sie, welche jedes Mal schnell wirken müssen. „Jedes Mal schnell“ bedeutet meistens Login, die erste Seite nach dem Login und alles, was mit Zahlungen zu tun hat.

Schätzen Sie dann den Traffic auf einfache Weise. Sie brauchen noch keine genauen Zahlen. Verwenden Sie ein Label wie low, medium, spiky oder unknown. Spiky kann bedeuten „wir haben an den meisten Tagen 10 Nutzer, aber am Launch‑Tag 5.000“ oder „ein Webhook‑Partner kann plötzlich einen Burst senden“. Wenn der Traffic unbekannt ist, schreiben Sie das auch auf — das ändert, worauf Sie optimieren.

Trennen Sie als Nächstes Hintergrundarbeit von Seitenanfragen. Viele Apps sehen in einer Demo gut aus, brechen aber in Produktion zusammen, weil Hintergrundaufgaben keinen sicheren Ort zum Laufen haben. Häufige Beispiele:

- E‑Mails oder SMS senden (Signup, Belege, Passwort‑Reset)

- Importe und Exporte (CSV‑Uploads, Datensync)

- Lange KI‑Aufgaben (Berichte generieren, Dokumente zusammenfassen, Batch‑Verarbeitung)

- Medienarbeit (Bildskalierung, Video‑Verarbeitung)

- Webhooks (Retry‑Logik, wenn andere Dienste fehlschlagen)

Erfassen Sie jetzt Ihre Datenerfordernisse in klaren Worten. Sie müssen noch keine Anbieter wählen. Beschreiben Sie einfach, welche Art von Zustand Sie haben und was passiert, wenn er verloren geht:

- SQL‑Daten (Nutzer, Zahlungen, Berechtigungen)

- Dateien (Uploads, Rechnungen, Avatare)

- Suche (Volltext, Filter, Relevanz)

- Caching (beschleunigt heiße Seiten, Ratenbegrenzungen)

Zum Schluss notieren Sie Einschränkungen, die wichtiger sind als technische Details: Time‑to‑ship, Budget und wer es betreut. Wenn Sie ein Solo‑Founder ohne On‑Call‑Team sind, sagen Sie das. Wenn etwas in 48 Stunden laufen muss, schreiben Sie das dazu.

Ein schnelles Beispiel: Wenn Sie einen Prototyp mit schnellem Dashboard, spiky Launch‑Traffic, einem täglichen Importjob und einer SQL‑Datenbank haben, reicht das meist aus, um Optionen zu vergleichen, ohne zu raten.

Serverless, Container und verwaltete Plattformen einfach erklärt

Hosting‑Wahl nach einem Prototyp dreht sich meist darum, wie viel der „App‑Betriebsarbeit“ Sie selbst übernehmen wollen.

Serverless: Code läuft nur bei Bedarf

Serverless bedeutet, Ihr Code wacht bei Bedarf auf und schläft wieder, wenn nichts zu tun ist. Sie managen keinen lang laufenden Server. Sie liefern kleine Code‑Stücke (Funktionen) oder einen serverlosen Webservice, und die Plattform kümmert sich um das Scaling.

Die Kompromisse sind real: Requests können nach Leerlauf langsamer starten, und man muss oft um Limits herum gestalten (Timeouts, stateless Ausführung, spezielle Muster für DB‑Verbindungen). Serverless ist gut für spiky Traffic oder einfache APIs.

Container: mehr Kontrolle, mehr Verantwortung

Ein Container ist Ihre App zusammen mit ihrer Laufzeit verpackt, sodass sie überall gleich läuft. Sie bestimmen, wie sie startet, was daneben läuft und wie CPU/Memory genutzt werden.

Der Vorteil ist Kontrolle: Hintergrundworker, vorhersehbare Laufzeiten und weniger „Plattform‑Regeln“. Der Nachteil ist Betriebsarbeit: Dienste gesund halten, Skalierungsregeln, Logs, Secrets, Patches und Incident‑Response.

Verwaltete Plattformen: der Mittelweg

Verwaltete Plattformen liegen dazwischen. Sie deployen eine App und die Plattform betreibt sie auf ihrer Infrastruktur. „Managed“ umfasst oft Build‑Schritte, HTTPS, Autoscaling und grundlegende Health‑Checks.

Was Ihre Aufgabe bleibt: App‑Bugs, Datenbank‑Design, Verhalten von Hintergrundjobs und Secrets aus dem Repo fernhalten.

Ein einfaches Preismodell:

- Serverless: Zahlung pro Anfrage und Compute‑Zeit. Günstig bei wenig oder bursty Traffic, aber Kosten können bei konstant hoher Nutzung steigen.

- Container: Zahlung für reservierte Kapazität (laufende Maschinen), auch wenn Traffic niedrig ist. Vorhersehbarer bei konstantem Load.

- Managed Plattfomen: meist Basis‑Monatskosten plus Add‑ons (DBs, Logs, Bandbreite). Oft am einfachsten zu budgetieren.

Deploys und Rollbacks fühlen sich auch unterschiedlich an:

- Serverless: schnelle Deploys, aber mehr Teile, wenn viele Funktionen existieren. Rollbacks sind meist einfach, Debugging über Funktionen verteilt kann schwieriger sein.

- Container: klare versionierte Releases und schnelle Rollbacks, aber Sie müssen den Prozess einrichten.

- Managed Plattformen: „Push to deploy“ ist simpel. Rollbacks oft per Klick, aber Anpassungsmöglichkeiten können begrenzt sein.

Wenn Ihr Prototyp eine kleine API mit gelegentlichem Traffic und ein paar geplanten Tasks ist, ist Serverless ein einfacher Start. Wenn Sie bereits eine Worker‑Queue, lang laufende Jobs oder strikte Runtime‑Kontrolle brauchen, sind Container (oder eine verwaltete Plattform mit Worker‑Support) oft entspannter.

Entscheidungstabelle Teil 1: Traffic‑Muster

Traffic ist das erste, was Sie sortieren sollten, weil es Kosten, Zuverlässigkeit und die notwendige Arbeit zur Stabilität beeinflusst.

| Your traffic pattern | What it usually feels like | Typical best fit | Watch‑outs |

|---|---|---|---|

| Steady (ähnliche Last jede Stunde) | Vorhersagbare Nutzung, z. B. ein internes Tool oder B2B‑App | Container oder verwaltete Plattform mit lang laufenden Diensten | Sie brauchen trotzdem Skalierungsregeln und Health‑Checks. „Always on“ kostet auch bei Leerlauf. |

| Spiky (große Bursts, dazwischen ruhig) | Launches, Ads, Demos, tägliche Spitzen | Serverless für die Web‑Schicht, manchmal gemischt mit Managed Services | Cold‑Starts können sichtbar sein. Concurrency‑Limits und Timeouts überraschen häufig. |

| Unknown (wirklich unbekannt) | Prototyp wird veröffentlicht, Nachfrage abwarten | Beginnen mit Managed Plattform oder Serverless, dann messen | Sperren Sie sich nicht früh in komplexe Infrastruktur. Logging und Metriken sind wichtiger als „perfektes“ Scaling. |

Cold‑Starts sind relevant, wenn Nutzer sie spüren. Bei Checkout, Login oder anderen Fällen, wo Menschen warten, kann eine 1–3 Sekunden Pause schaden. Bei kleinen internen Tools sind Cold‑Starts oft egal.

Echtzeit‑Bedürfnisse können die Antwort ändern. Wenn Sie WebSockets, lange Streams oder Live‑Kollaboration brauchen, sind lang laufende Dienste meist einfacher. Container oder verwaltete Plattformen sind hier am wenigsten schmerzhaft. Manche serverlosen Setups unterstützen Echtzeit, verlangen aber zusätzliche Komponenten und erhöhen die Fehlerquellen.

Autoscaling‑Erwartungen sind oft zu optimistisch. „Serverless heißt unendliches Scaling“ trifft in der Praxis nicht zu. Sie stoßen weiterhin an Limits: gleichzeitige Request‑Caps, DB‑Verbindungsgrenzen und Rate‑Limits von Drittanbietern. Container skalieren ebenfalls, reagieren aber langsamer, wenn Sie nicht etwas Kapazität warm halten.

Faustregel:

- Steady Traffic: Container oder verwaltete Plattform, halten Sie es langweilig.

- Spiky Traffic: Serverless funktioniert gut für bursty Web‑Requests, planen Sie Cold‑Starts und Limits ein.

- Unknown Traffic: starten Sie einfach, instrumentieren Sie früh und passen Sie an, wenn echte Nutzung sichtbar wird.

Entscheidungstabelle Teil 2: Hintergrundjobs und Queues

Hintergrundjobs sind alles, was Ihre App außerhalb der Hauptseitenanfrage tun muss: E‑Mails senden, Uploads skalieren, Daten syncen, Karten belasten oder ein AI‑Modell aufrufen. Für viele Prototypen ist das der entscheidende Faktor, weil Jobs zeigen, was in Produktion bricht.

Die meisten Job‑Probleme drehen sich weniger um „wo es läuft“ als um Grundlagen: Timeouts, Retries, Idempotenz (damit Retries nicht doppelte Arbeit erzeugen) und sichere Concurrency.

Serverless ist großartig für Jobs, wenn jede Aufgabe klein und unabhängig ist. Sie bekommen automatisches Scaling und zahlen nur, wenn gearbeitet wird. Es wird schmerzhaft, wenn Tasks regelmäßig Time‑Limits erreichen, konstant CPU für lange Zeit benötigen oder schwere Abhängigkeiten haben, die Cold‑Starts verlangsamen.

Container sind oft einfacher für lang laufende Jobs und dedizierte Worker. Ein Worker‑Container kann aus einer Queue ziehen, warm bleiben und größere Memory/CPU‑Anforderungen handhaben, ohne gegen Function‑Limits zu kämpfen. Der Kompromiss ist, dass Sie Skalierung, Neustarts und sicherstellen müssen, dass nur ein Worker einen Job gleichzeitig verarbeitet.

Verwaltete Plattformen helfen, wenn sie die langweiligen Teile bündeln: gehostete Queues, Scheduling, Worker‑Autoscaling, Dashboards für Fehler und Dead‑Letter‑Handling.

| Job length | Retry needs | Concurrency needs | Good default | Watch‑outs |

|---|---|---|---|---|

| Unter 30s | Niedrig bis mittel | Spiky oder unvorhersehbar | Serverless + verwaltete Queue | Timeouts, Cold‑Starts, doppelte Ausführungen |

| 30s bis 15min | Mittel bis hoch | Moderat | Verwaltete Worker oder Container | Idempotenz und Backoff nötig |

| Über 15min oder heavy CPU | Hoch | Kontrolliert | Container mit Queue | Skalierungsregeln, hängende Jobs, Kosten |

Konkretes Beispiel: Eine SaaS‑App, die Rechnungen erstellt, kann PDF‑Generierung serverless ausführen, wenn sie schnell fertig ist. Wenn Kunden große Dokumente hochladen und die Generierung Minuten dauert, ist ein Container‑Worker, der Jobs aus einer Queue zieht, meist ruhiger im Betrieb und leichter zu debuggen.

Entscheidungstabelle Teil 3: Datenbank und zustandsbehaftete Dienste

Starten Sie mit dem „klebrigsten“ Teil Ihrer App: der Datenbank und allem, was Zustand hält. Das Web‑Hosting können Sie später wechseln. Daten und Zustand zu verschieben, kostet Teams oft Wochen.

Wenn Ihr Prototyp Postgres oder MySQL nutzt, behalten Sie das bei. Verwaltetes Postgres/MySQL ist meist die sicherste Voreinstellung, weil Upgrades, Disk‑Probleme und Backups die häufigsten Selbsthost‑Fehlerquellen sind.

Wenn Ihr Prototyp SQLite nutzt, betrachten Sie das als Warnsignal. Es ist für eine Demo fine, aber es bricht schnell zusammen, wenn Sie gleichzeitige Nutzer, mehrere App‑Instanzen oder Background‑Jobs hinzufügen.

Managed DB vs selbstgehostete DB: was kaputt geht

Eine Datenbank selbst in einem Container zu hosten kann funktionieren, aber die Ausfallmodi sind meist langweilig und teuer: Speicher läuft voll, Backups sind keine echten Backups, ein kleines Upgrade bricht eine Extension oder ein Neustart korruptiert Daten, weil Volumes falsch konfiguriert sind. Eine verwaltete Datenbank reduziert diese Risiken, besonders wenn Sie das Schema häufig ändern.

Listen Sie über die DB hinaus Ihre anderen zustandsbehafteten Bedürfnisse auf:

- File‑Uploads brauchen meist Object‑Storage (nicht die lokale Festplatte der App).

- Suche benötigt oft einen separaten Suchdienst für schnelle Filter bei Skalierung.

- Caching braucht in der Regel etwas wie verwaltetes Redis, wenn Sie Sessions, Rate‑Limits oder teure Queries cachen.

Verbindungsgrenzen sind wichtiger als viele erwarten. Jede offene DB‑Verbindung kostet Memory auf dem DB‑Server. Serverless‑Apps können viele kurzlebige Verbindungen erzeugen, was zu „zu viele Verbindungen“‑Fehlern führt. Übliche Lösung ist Connection‑Pooling: Ihre App spricht mit einem Pool, der eine kleinere Anzahl echter DB‑Verbindungen wiederverwendet.

| Frage | Wenn „low/early" | Wenn „wachsende/hoch" | Was wählen |

|---|---|---|---|

| Lese/Schreib‑Last, Migrations, Backups | Leichte Reads, wenige Writes, wöchentliche Migrations, einfache Backups ok | Hohe Reads/Writes, häufige Migrations, Point‑in‑Time Recovery nötig | Verwaltetes Postgres/MySQL + automatisierte Backups; Pooling hinzufügen, wenn Sie skalieren |

Wie man wählt: ein schrittweiser Pfad

Zu viele Features verschiedener Plattformen zu vergleichen, führt schnell zum Stillstand. Besser: starten Sie beim Teil, der am ehesten zuerst bricht, und wählen Sie die einfachste Option, die das Problem verhindert.

Schritt 1: Wählen Sie Ihren aktuellen Engpass

Seien Sie ehrlich darüber, was heute wehtut, nicht was in einem Jahr relevant sein könnte:

- Traffic: Seiten sind langsam, Timeouts treten auf, oder Sie werden rate‑limitiert.

- Hintergrundjobs: E‑Mails, Importe, AI‑Aufrufe oder geplante Arbeit schlägt fehl oder läuft doppelt.

- Datenbank/Zustand: Daten sind inkonsistent, Migrationsangst oder Sie speichern Dateien/Sessions am falschen Ort.

Wenn Sie eine Engstelle wählen, können Sie den Rest ignorieren.

Schritt 2: Wählen Sie das einfachste Hosting, das die Engstelle beseitigt

Zielen Sie auf möglichst wenige bewegliche Teile, die trotzdem Ihr Problem lösen.

Wenn Traffic das Problem ist, reicht oft Serverless oder eine verwaltete Plattform, weil sie ohne Servertuning skaliert. Wenn lange Requests oder WebSockets zentral sind, sind Container meist einfacher als gegen Limits anzukämpfen.

Wenn Jobs das Problem sind, priorisieren Sie eine echte Queue und einen Worker mit sicheren Retries. Das kann serverless bleiben, aber nur wenn Sie Timeouts und Retries kontrollieren können. Andernfalls ist ein kleiner Container‑Worker leichter zu verstehen.

Wenn die Datenbank das Problem ist, holen Sie zuerst eine stabile verwaltete DB. Ihre Wahl des App‑Hostings ist dann weniger relevant als Backups, Migrationsstrategien und klare Verbindungsgrenzen.

Schritt 3: Führen Sie einen kleinen Last‑ und einen Fehler‑Test durch

Halten Sie es klein. Sie suchen nach offensichtlichen Bruchpunkten.

Load‑Test: simulieren Sie einen moderaten Spike (z. B. 5–10x Ihres normalen Traffics für 10 Minuten) und beobachten Sie Fehler und Antwortzeiten.

Failure‑Test: lassen Sie etwas absichtlich abstürzen und prüfen Sie, ob es sauber wiederherstellt. Der einfachste Test ist ein Neustart. Für Jobs testen Sie auch Retries: lassen Sie einen Job absichtlich fehlschlagen und prüfen Sie, dass er einmal neu startet und keine Duplikate erzeugt.

Schritt 4: Definieren Sie einen einfachen Deployment‑Flow

Sie brauchen einen minimalen sicheren Pfad von Code zu Produktion:

- Staging und Production (auch wenn Staging klein ist)

- Ein Deploy‑Prozess, der nicht nur aus manuellen Klicks besteht

- Einen Rollback‑Plan (idealerweise ein Befehl oder eine Einstellung)

Wenn Sie Ihr Rollback nicht in einem Satz erklären können, ist Ihr Hosting noch nicht „einfach“ genug.

Schritt 5: Planen Sie, was Sie überwachen

Wählen Sie ein paar Signale, die Sie wirklich wöchentlich prüfen: Error‑Rate, Latenz und Job‑Fehler reichen meist. Fügen Sie ein DB‑Signal hinzu (langsame Queries oder Verbindungsanzahl), wenn Ihre App DB‑schwer ist.

Häufige Fallen, die später zu Rework führen

Der schnellste Weg, einen Monat zu verschwenden, ist, Hosting nach dem zu wählen, was „professionell“ klingt, statt nach dem, was Ihre App tatsächlich macht. Die richtige Wahl ist meist die, die Ihr Team jede Woche ruhig betreiben kann, nicht die mit dem schönsten Diagramm.

Eine Falle ist, Container zu wählen, weil sie professionell wirken, und dann zu merken, dass niemand die Ops‑Arbeit übernehmen möchte. Container sind in Ordnung, bedeuten aber oft, dass Sie Updates, Monitoring, Skalierung und Incident‑Handling selbst stemmen müssen. Bei einem kleinen Team taucht diese Arbeit meist zur schlechtesten Zeit auf.

Serverless hat die gegenteilige Falle: Es ist leicht zu starten, aber schmerzhaft, wenn Arbeiten zu lange laufen. Bei Video‑Verarbeitung, großen Importen, verketteten KI‑Aufrufen oder Berichtsgenerierung von mehreren Minuten trifft man Time‑Limits oder Kosten‑Spikes. Teams bauen dann Queues und Worker nachträglich an und müssen unter Druck neu designen.

Triggers für Rework:

- Secrets als nachträgliche Überlegung behandeln (Keys im Code, geteilte .env‑Dateien, keine Rotationspläne)

- DB‑Schema‑Änderungen und App‑Code im gleichen Schritt ausliefern, ohne sicheren Rollback

- Eine Plattform wählen, die Auth‑Flows umständlich macht (Callbacks, Session‑Speicher, Custom Domains)

- File‑Uploads und Storage nicht früh planen (wo Dateien liegen, wie Berechtigungen funktionieren)

- Annehmen, Echtzeit‑Features würden „einfach funktionieren“ (WebSockets, lange Verbindungen, Background‑Consumer)

Ein konkretes Beispiel: Ein Prototyp könnte eine einfache Login‑Bibliothek nutzen, Dateien auf dem lokalen Disk speichern und einen nächtlichen Job im Webserver laufen lassen. In Demos sieht das gut aus, aber in Produktion bricht es, sobald Sie mehrere Instanzen einsetzen oder eine neue Version deployen.

Beispiel: Ein AI‑generierter Prototyp in Produktions‑Hosting überführen

Eine Gründerin baut einen KI‑basierten Prototyp mit einem Tool wie Replit oder Cursor. Auf dem Laptop läuft alles. Nach dem Launch scheitert es in Produktion: Nutzer werden zufällig ausgeloggt, E‑Mails werden doppelt verschickt und die Datenbank timed out bei Spitzen.

Das passiert, weil Prototypen oft alles vermischen: Web‑Requests, Hintergrundarbeit (Im- porte, E‑Mails) und Datenbankzugriff im selben Prozess. Bei Traffic‑Spitzen konkurriert alles um die gleichen Ressourcen.

Entscheidungstabellen‑Durchgang

Traffic: Der Launch bringt spiky Traffic. Das spricht für eine Frontend‑ und API‑Schicht, die schnell skalieren kann. Serverless‑Funktionen passen für Web/API, wenn Requests kurz und stateless sind. Sind Requests lang oder brauchen Sie strikte Runtime‑Kontrolle, ist ein kleiner Container‑Service sicherer.

Hintergrundjobs: E‑Mails und CSV‑Importe sollten nicht innerhalb der Web‑Requests laufen. Spikes machen Web‑Server langsam, und Retries können Duplikate verursachen. Jobs brauchen eine Queue und einen Worker, der länger laufen darf als ein typischer Request‑Timeout.

Datenbank und Auth: Timeouts kommen oft von zu vielen Verbindungen und langsamen Queries. Auth‑Probleme unter Last entstehen meist durch falsch konfigurierte Cookies, fehlenden Session‑Speicher oder Timeouts beim DB‑Zugriff.

Realistische Hosting‑Kombination für diesen Fall:

- Serverless oder ein verwalteter Web‑Service für die API (schnelles Skalieren bei spiky Traffic)

- Eine verwaltete Queue plus Worker (Container oder Managed Job Runner) für E‑Mails/Im- porte

- Eine verwaltete Datenbank mit Connection‑Pooling (und Grund‑Monitoring)

- Verwaltete Secret‑Speicherung, damit Keys nicht im Repo landen

Dabei geht es nicht um das feinste Stack‑Design, sondern darum, Verantwortlichkeiten zu trennen, sodass ein Problem (z. B. Importe) nicht alles mitreißt.

Einfache Erst‑Woche: stabilisieren, dann optimieren

Woche eins sollte Zuverlässigkeit vor Kostentuning priorisieren:

- Tag 1: Request‑Logging, Error‑Tracking und Health‑Checks hinzufügen, damit Fehler sichtbar sind.

- Tag 2: E‑Mails und Importe in eine Queue + Worker verschieben, Idempotenz sicherstellen (keine Doppel‑Sends).

- Tag 3: DB‑Timeouts mit Pooling angehen, Indexe für langsame Queries und sinnvolle Timeouts.

- Tag 4: Auth stabilisieren (Sessions, Cookies, Redirects) und grundlegende Rate‑Limits setzen.

- Tag 5: Hauptflüsse Load‑testen und Skalierungslimits setzen, damit ein Spike keine Überraschungsrechnung erzeugt.

Schnell‑Checkliste und nächste Schritte

Wenn Sie Hosting nach einem Prototyp wählen wollen, ohne sich in Vergleichen zu verlieren, halten Sie die Entscheidung klein und praktisch. Sie wählen nicht „die ewige Plattform“, sondern den sichersten nächsten Schritt für echte Nutzer.

Starten Sie mit diesen Prüfungen:

- Traffic‑Form: meistens steady oder spiky? Notieren Sie, ob Nutzer hauptsächlich in einer Region sind.

- Job‑Länge: sind Hintergrundaufgaben kurz (Sekunden) oder lang (Minuten)? Brauchen sie Retries, Schedules oder garantierte Zustellung?

- Datenbank‑Wachstum: wie schnell wächst die Datenmenge, brauchen Sie bald Migrationen oder strikte Backups?

- Zustand und Dateien: speichern Sie Uploads, Sessions oder erzeugte Dateien, die Neustarts überleben müssen?

- Team‑Verantwortung: wer ist on‑call, und wie sicher sind sie bei Deploys und Debugging?

Bevor Sie öffentlich gehen, bringen Sie die „Minimum‑Production‑Basics“ in Stellung:

- Getestete Backups: nicht nur aktiviert, sondern einmal wiederhergestellt.

- Durchsuchbare Logs: Requests, Jobs und DB‑Fehler an einem Ort.

- Fehler‑Alerts: benachrichtigen schnell einen Menschen, mit genug Details zum Handeln.

- Rollbacks: ein Weg, ein schlechtes Deploy ohne Heldenmut rückgängig zu machen.

Halten Sie bewusst eine Sache einfach. Für viele Teams heißt das: eine verwaltete Datenbank verwenden und frühe eigene DB‑Operationen vermeiden, auch wenn das Runtime‑Hosting noch offen ist. Notieren Sie außerdem, was Sie vertagen (Multi‑Region, perfektes Autoscaling, komplexe Queues), damit es später kein unbeabsichtigtes Problem wird.

Nächste sinnvolle Schritte für die meisten Teams:

- Dokumentieren Sie Ihre Entscheidungen auf einer Seite: Runtime, Jobs/Queue, Datenbank, Storage und wer was besitzt.

- Führen Sie eine kleine Produktionsprobe durch: begrenzte Veröffentlichung mit echtem Monitoring, dann die Top‑Issues beheben.

- Load‑testen Sie einen Kernfluss: Signup, Checkout oder Ihren Haupt‑API‑Endpoint, genug, um offensichtliche Limits zu finden.

- Üben Sie einen Ausfall: App neu starten, eine Konfig‑Variable kaputt machen oder einen Queue‑Backlog simulieren und schauen, was passiert.

- Setzen Sie ein Review‑Datum: zwei Wochen nach Launch entscheiden, ob Sie bleiben oder ein Teil upgraden.

Wenn Sie fragilen, KI‑generierten Code übernehmen, lohnt es sich, die Grundlagen zu reparieren (Auth, Secrets, Job‑Retries und DB‑Zugriffsmuster), bevor Sie das Hosting ändern. FixMyMess (fixmymess.ai) konzentriert sich darauf, KI‑generierte Prototypen zu diagnostizieren und zu reparieren, sodass sie produktionsreif sind — inklusive Security‑Härtung und Deployment‑Vorbereitung — und bietet eine kostenlose Code‑Analyse an, die die Probleme aufzeigt, die Hosting‑Migrationen oft entgleisen lassen.

Häufige Fragen

What should I write down before picking hosting?

Notieren Sie drei Dinge: Ihr Traffic‑Muster (steady, spiky oder unknown), welche Hintergrundaufgaben Sie ausführen (E‑Mails, Importe, KI‑Aufgaben, Uploads) und welche Daten Sie speichern (SQL‑Daten, Dateien, Sessions). Diese drei Details zeigen meist die einfachste, sichere Option, ohne in Plattformvergleiche zu versinken.

If I don’t know my traffic yet, what’s the safest default?

Beginnen Sie mit einer verwalteten Plattform oder einem einfachen Serverless‑Setup und fügen Sie grundlegendes Monitoring hinzu, damit Sie echten Nutzungsdaten sehen können. Das Ziel ist, schnell zu lernen, ohne ein komplexes Setup zu bauen, das Sie später verwerfen.

Will serverless cold starts actually hurt my app?

Das kann passieren, ist aber am ehesten spürbar bei Login, Checkout und der ersten Seite nach dem Login. Wenn diese Abläufe immer sofort reagieren müssen, bevorzugen Sie einen lang laufenden Service (Container oder verwalteter Webservice) oder halten Sie etwas Kapazität warm.

When should I avoid serverless and use containers instead?

Wählen Sie Container oder eine verwaltete Plattform, die lang laufende Dienste und Worker unterstützt. Echtzeitfunktionen sind einfacher, wenn Ihre App Verbindungen offen halten kann, ohne gegen Timeouts oder Plattformlimits anzukämpfen.

Do I really need a queue for background jobs?

Nicht zwingend, aber Hintergrundjobs sind oft der erste Produktionskiller, weil sie Wiederholungen, Timeouts und Schutz gegen Doppelverarbeitung brauchen. Eine Queue plus ein Worker (serverless oder Container) ist meist der Unterschied zwischen „läuft in der Demo“ und „läuft die ganze Woche“.

Should I self-host my database inside a container?

Standardmäßig sollten Sie eine verwaltete Datenbank verwenden, besonders am Anfang. Die schmerzhaftesten Fehler entstehen bei Backups, Speicher und Upgrades, nicht beim SQL‑Schreiben. Verwaltete DBs reduzieren diese Risiken erheblich.

My prototype uses SQLite—do I need to change it before launch?

SQLite ist für Demos OK, aber es bricht bei gleichzeitigen Nutzern, mehreren Instanzen und Hintergrund‑Workern schnell zusammen. Für eine öffentliche Nutzung ist der Umstieg auf verwaltetes Postgres oder MySQL meist der sauberste Schritt, um zufällige Locks und Datenprobleme zu vermeiden.

What causes “too many database connections,” and how do I fix it?

Meist ist es ein Verbindungs‑Limit, nicht „die Datenbank ist down“. Fügen Sie Connection‑Pooling hinzu und stellen Sie sicher, dass Ihre App Verbindungen sinnvoll wiederverwendet, vor allem bei Serverless, wo viele Instanzen kurzzeitig Verbindungszahlen hoch treiben können.

What’s the minimum testing I should do before switching hosting?

Machen Sie einen kleinen Load‑Test (kurzer Traffic‑Spike) und einen Failure‑Test (etwas absichtlich neu starten), bevor Sie live gehen. Sie suchen nach offensichtlichen Bruchstellen wie Timeouts, doppelten Jobs und langsamen Seiten bei moderater Last.

If my app was generated by an AI tool, should I fix the code before changing hosting?

Ja. KI‑generierte Prototypen haben oft fragile Auth, exponierte Geheimnisse und unordentliche Hintergrundjob‑Logik, die unabhängig vom Hosting brechen. Wenn Sie einen ruhigen Weg zur Produktion wollen, kann FixMyMess eine kostenlose Code‑Analyse durchführen und die Codebasis (Auth, Secrets, Job‑Retries, DB‑Zugriff, Deployment‑Vorbereitung) innerhalb von 48–72 Stunden stabilisieren oder einen Rebuild empfehlen, wenn das schneller ist.