Log‑Kosten bei Prototypen begrenzen: Aufbewahrung, Sampling, Maskierung

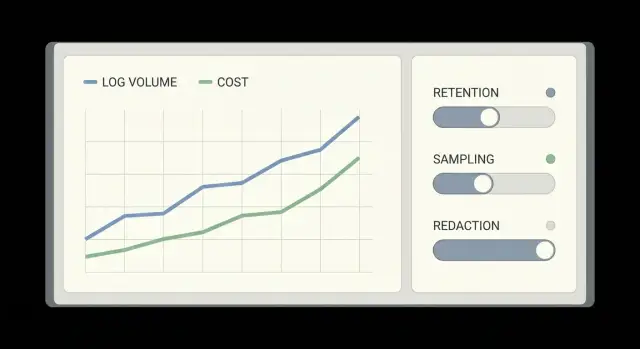

Log‑Kosten kontrollieren: Retention‑Tiers, Sampling‑Regeln und Redaction so einstellen, dass schnell wachsende Prototypen nützliche Logs behalten ohne Überraschungsrechnungen.

Warum Prototypen überraschende Log‑Rechnungen bekommen

Prototypen starten oft mit „alles loggen“, weil es sicherer erscheint, als etwas Wichtiges zu verpassen. Dann kommen echte Nutzer, der Traffic springt hoch, und jeder Klick erzeugt mehrere Log‑Zeilen im Frontend, Backend, Auth, der Datenbank und bei Drittanbietern. Was ein Rinnsal war, wird schnell zum Feuerwehrschlauch — manchmal an einem einzigen Wochenende.

Überraschende Rechnungen entstehen, wenn Kosten in mehreren Richtungen gleichzeitig skalieren. Sie zahlen für das Ingest von Log‑Volumen, für das lange Aufbewahren und dafür, dass Logs durchsuchbar bleiben. Logs können zudem über Regionen dupliziert, an mehrere Tools weitergeleitet oder für Analysen wieder herausgezogen werden, was Egress‑ und Query‑Kosten erhöht.

Die üblichen Auslöser sind einfach:

- Debug‑Logging in Produktion anlassen

- Eine Anfrage erzeugt viele Logs (Retries, Schleifen, „chatty“ Clients)

- Felder mit hoher Kardinalität (User‑IDs, vollständige URLs, zufällige Tokens) werden indexiert

- Lange Standard‑Retention, die niemand überprüft

- Große Payloads in Logs (vollständige Request‑Bodies, wiederholte Stacktraces)

„Nützliche Logs“ für ein kleines Team sind einfacher, als es klingt. Meist müssen Sie beantworten: Was ist kaputt? Wer ist betroffen? Wann hat es angefangen? Kann man es reproduzieren? Das heißt normalerweise: eine klare Fehlermeldung, eine Request‑ oder Trace‑ID, ein paar Kontextfelder und ein guter Stacktrace bei Fehlern — kein Tagebuch jeder erfolgreichen Anfrage.

Das Ziel ist, schnell zu debuggen, ohne für Rauschen zu zahlen.

Woraus Logging‑Kosten wirklich entstehen

Die meisten Log‑Rechnungen lassen sich auf ein paar vorhersehbare Multiplikatoren zurückführen, die auftauchen, sobald ein Prototyp echten Traffic bekommt.

Ingest ist der erste Treiber. Jedes Log‑Event muss verschickt und vom Logging‑Service angenommen werden. Wenn Ihr Code bei jeder Anfrage, jedem Retry und jedem Hintergrundjob etwas loggt, steigt das Volumen mit Nutzern und mit Bugs.

Speicher und Retention kommt als Nächstes. Roh‑Logs 30–90 Tage aufzubewahren fühlt sich sicher an, aber teuer, wenn die meisten Logs nie gelesen werden. Das verschlechtert sich, wenn Dev, Staging und Produktion dieselbe Retention haben.

Suche und Indizierung sind eine weitere Überraschung. „Alles durchsuchbar machen“ bedeutet oft, deutlich mehr Felder zu indexieren, als man im Alltag filtert.

Kardinalität ist der versteckte Multiplikator. Felder mit vielen einzigartigen Werten (User‑IDs, Session‑Tokens, vollständige URLs mit Query‑Strings, dynamischer Fehlertext) können die Anzahl der einzigartigen Kombinationen explodieren lassen, die Ihr Logging‑Tool verfolgen muss.

Kurz gesagt, achten Sie auf diese Multiplikatoren:

- Hochvolumige „info“‑Logs bei jeder Anfrage

- Lange Retention in lauten Umgebungen (dev und staging)

- Zu viele standardmäßig indexierte Felder

- High‑cardinality‑Felder als Tags/Labels

- Doppelte Pipelines, die dieselben Logs weiterleiten

Entscheiden Sie, was Sie wirklich von Logs brauchen

Kostenkontrolle beim Logging beginnt mit einer Entscheidung: Welche Fragen sollen Logs beantworten, wenn etwas kaputtgeht.

Für die meisten Prototypen dienen Logs hauptsächlich für:

- Fehler und Abstürze (was ist fehlgeschlagen, wo und warum)

- Authentifizierungsprobleme (Login‑Fehler, Token‑Fehler, Berechtigungsprüfungen)

- Zahlungen und Abrechnung (gescheiterte Belastungen, Webhook‑Fehler, doppelte Events)

- Latenz und Timeouts (lange Endpunkte, langsame Queries, Verzögerungen bei Drittanbietern)

Entscheiden Sie zudem, wann voller Kontext nötig ist und wann eine Zusammenfassung reicht. Voller Kontext hilft bei ganz neuen Bugs oder Sicherheitsvorfällen, ist aber teuer. Für viele Events reicht ein kurzer Eintrag: Event‑Name, Request‑ID, User‑ID (oder ein sicherer Hash), Statuscode und Dauer. Volle Payloads behalten Sie nur für seltene Fälle, hinter einer Flag oder nur bei Fehlern.

Es hilft auch, klar zwischen Logs, Metriken und Traces zu trennen:

- Logs sagen, was für eine spezifische Anfrage passiert ist.

- Metriken sagen, wie oft und wie schlimm (Error‑Rate, p95‑Latenz) ohne großes Volumen.

- Traces zeigen, wo Zeit über Services hinweg verbracht wurde.

Wenn Sie alles in Logs stopfen, wachsen die Rechnungen schnell und Debugging bleibt unübersichtlich.

Schließlich klassifizieren Sie Daten in drei Buckets:

- Must keep: Fehler, Auth‑Entscheidungen, Zahlungszustandsänderungen, Deploy‑Version, Request‑IDs

- Nice to have: Debug‑Details, die nur gelegentlich gebraucht werden

- Never log: Secrets, Passwörter, Access‑Tokens, vollständige Kreditkarteninformationen, rohe private Nachrichten

Ein einfaches Beispiel: Wenn eine Anmeldung fehlschlägt, loggen Sie den Fehlercode und das Feld, das die Validierung nicht bestanden hat — nicht den vollständigen Request‑Body.

Setzen Sie Retention‑Tier, die zur tatsächlichen Nutzung passen

Ein guter Retention‑Plan geht von einer Wahrheit aus: Sie brauchen verschiedene Log‑Arten für unterschiedliche Zeitfenster. Wenn Sie alles gleich lange aufbewahren, verlieren Sie entweder Details oder Sie zahlen für Rauschen.

Ein praktisches 3‑Tier‑Retention‑Setup

- Hot (kurz): Hochvolumige App‑ und Debug‑Logs für aktive Fehlersuche. Behalten Sie 1–3 Tage.

- Warm (mittel): Standard‑Request‑Logs und wichtige Business‑Events für Incident‑Nachbereitung. Behalten Sie 7–14 Tage.

- Cold (lang): Niedrigvolumige, aber wertvolle Sicherheits‑ und Audit‑Events (Auth‑Änderungen, Berechtigungsupdates, Admin‑Aktionen). Behalten Sie 30–180 Tage, je nach Risiko und Anforderungen.

Hot sollte klein, aber detailliert sein. Cold sollte stabil und durchsuchbar sein, nicht mit jedem Debug‑Line vollgestopft.

Verschiedene Umgebungen brauchen unterschiedliche Regeln:

- Dev: kurze Retention (Stunden bis 1 Tag).

- Staging: genug, um Releases zu vergleichen (2–7 Tage).

- Production: warm und cold länger, aber strikt darüber, was dazugehört.

Zahlen ohne Raten

Starten Sie von echtem Verhalten:

-

Wie lange bemerken Sie einen Vorfall normalerweise (am selben Tag, nächsten Tag, nächste Woche)?

-

Wie lange dauert es, das Problem zu reproduzieren und den Fix zu bestätigen?

-

Welche Events müssen Sie für Sicherheit oder Kundensupport aufbewahren?

Sampling nutzen, um Volumen zu reduzieren ohne blind zu werden

Sampling erhält das Signal, während Sie aufhören, für jede „Alles OK“‑Meldung zu zahlen.

Beginnen Sie mit einer Error‑First‑Regel: Erfassten Sie Fehler zu 100%. Dazu gehören Error‑Logs, Exceptions, Timeouts und jede Anfrage mit 4xx oder 5xx. Wenn etwas kaputtgeht, wollen Sie die komplette Spur.

Zielen Sie dann auf die lautesten Success‑Pfade: Health‑Checks, Hintergrund‑Polling, chatty Retries und Endpunkte, die auf jeder Seite geladen werden.

Praktische Sampling‑Regeln, die das Debuggen ermöglichen

- Halten Sie 100% der Fehler und Warnungen sowie jeder Anfrage über einer Latenz‑Schwelle.

- Sample hochvolumige 200‑Antworten (z. B. 1 von 50 behalten).

- Fügen Sie pro‑Endpoint‑Caps hinzu (z. B. max. 20 Success‑Logs pro Minute pro Route).

- Behalten Sie seltene Events zu 100% (Passwort‑Reset, Billing, Admin‑Aktionen).

- Entfernen Sie Wiederholungen: Wenn dieselbe Meldung 1.000‑mal auftritt, behalten Sie die ersten N und fassen den Rest zusammen.

Rate‑Limits sind das Sicherheitsnetz. Sie verhindern, dass ein Bug (wie eine Retry‑Schleife) Ihr Log‑Volumen über Nacht explodieren lässt.

Dokumentieren Sie die Regeln einfach und stabil. Vorhersehbares Sampling macht das Debugging ruhiger, weil Sie wissen, was vollständig erfasst wird und was absichtlich gesampelt ist.

Redaction‑Basics: Geheimnisse und Nutzerdaten schützen

Redaction reduziert Risiko und oft auch Volumen. Das Ziel ist simpel: Logs sollen beim Debuggen helfen, ohne Geheimnisse oder persönliche Daten zu speichern, die Sie nicht behalten sollten.

Redacten Sie an der Quelle (in Ihrer App), nicht später im Log‑Tool. Wenn ein Geheimnis einmal geloggt wurde, kann es in Backups, Exporten und Alerts kopiert werden.

Konzentrieren Sie sich auf die Orte, die Daten ausspucken:

- Request‑Header

- Cookies

- Auth‑Payloads

- Query‑Parameter

Typische riskante Felder sind Authorization, Cookie, Session‑IDs, Passwortfelder, Reset‑Links, API‑Keys und jede „token“‑Variable. Viele Frameworks loggen außerdem komplette Error‑Objekte mit Request‑Kontext — prüfen Sie Defaults.

Wenn Sie Events über Requests hinweg verknüpfen müssen, maskieren Sie statt zu löschen. Beispielsweise nur die letzten 4 Zeichen eines Tokens behalten oder eine Einweg‑Hash eines E‑Mails loggen statt der E‑Mail selbst.

Eine schnelle Regel für PII: Vermeiden Sie das Loggen von Namen, E‑Mails, Telefonnummern, Adressen und IPs, sofern Sie keinen klaren Grund und eine Retention‑Policy haben.

Automatisierte Checks verhindern Regressionen:

- Fügen Sie ein Denylist‑basiertes Redaction‑Middleware (Header, Cookies, bekannte Felder) hinzu

- Tests, die fehlschlagen, wenn Logs Muster wie

Bearer,sk-oderpassword=enthalten - Einen Pre‑Deploy‑Scan, der aktuelle Logs nach Geheimnissen durchsucht

- Eine kleine Allowlist für „sichere zu loggende“ Felder

Schritt für Schritt: Retention, Sampling und Redaction umsetzen

Beginnen Sie damit, jeden Ort aufzulisten, an dem Logs erzeugt werden. Nicht raten. Beziehen Sie Ihre Web‑App, Background‑Worker/Queues, Edge‑Funktionen, Datenbank‑Logs und alles, was mit Sign‑in zu tun hat (Auth, Identity‑Provider‑Callbacks) mit ein. Eine fehlende Quelle kann Kosten hochhalten und Incidents schwerer zu debuggen machen.

Standardisieren Sie dann eine kleine Log‑Form, damit Sie schnell filtern und laute, einmalige Formate vermeiden. Halten Sie es langweilig: Zeitstempel, Level, Service‑Name und eine Request‑ID (oder Trace‑ID). Ergänzen Sie einen kurzen „Event“‑Namen und einen kleinen JSON‑Kontext.

Setzen Sie Defaults pro Umgebung:

- Production: info/warn/error only

- Staging: debug für kurze Zeiträume erlaubt

- Local dev: alles ist erlaubt

Eine übliche Umsetzungsreihenfolge, die oft funktioniert:

- Inventarisieren Sie Quellen und weisen Sie einen Owner zu

- Übernehmen Sie ein kleines Schema und erzwingen Sie es in neuem Code

- Setzen Sie umgebungsbasierte Log‑Levels mit einem sicheren Produktionsstandard

- Fügen Sie Sampling oder Ratenbegrenzungen für repetitive Events hinzu (Health‑Checks, Polling, Retries)

- Ergänzen Sie Redaction‑Filter für Secrets und PII sowie automatisierte Tests

Rollen Sie Änderungen schrittweise aus. Vergleichen Sie Volumen, Kosten und Nützlichkeit für Incidents vor und nach der Änderung für eine Woche.

Observability‑Kostenüberwachung: Spikes früh erkennen

Wenn Sie nichts tun, springen Log‑Rechnungen oft leise hoch und tauchen erst später auf. Kostenkontrolle beim Logging besteht im Wesentlichen darin, ein paar Zahlen täglich zu beobachten und zu wissen, wo man bei Veränderungen nachsehen muss.

Verfolgen Sie drei Trends:

- Tägliches Ingest‑Volumen (wie viel Sie senden)

- Speicherwachstum (wie viel Sie behalten)

- „Top Talkers“ (Services oder Routen, die am meisten Logs produzieren)

Top Talkers sind oft ein lauter Endpoint, ein Background‑Job in einer Retry‑Schleife oder ein Fehler, der bei jeder Anfrage eine komplette Payload logged.

Budget‑Alerts sind wichtiger als perfekte Dashboards. Setzen Sie Alerts bei einigen Schritten (z. B. 50%, 75%, 90% Ihres Monatsbudgets), damit Sie Zeit zum Handeln haben.

Spikes folgen oft Releases, Migrationen, Config‑Änderungen und Traffic‑Sprüngen. Prüfen Sie nach jedem dieser Ereignisse Ingest und Error‑Volumen in der ersten Stunde. Eine einzelne Debug‑Flag, die an blieb, kann die Kosten über Nacht vervielfachen.

Erstellen Sie eine Kosten‑Triage‑Ansicht

Wenn die Kosten steigen, wollen Sie in Minuten Antworten:

- Welcher Service hat sich seit gestern am stärksten erhöht

- Welcher Endpoint oder Job hat den Anstieg verursacht

- Welches Log‑Level hat sich verändert (info vs error vs debug)

- Welches Feld wurde hinzugefügt (Payload‑Dumps, Header, Stacktraces)

- Welcher Release korreliert mit dem Spike

Ist die Quelle gefunden, ist die Lösung meist: Log‑Level senken, Sampling hinzufügen, ein lautes Feld entfernen oder einen wiederholenden Fehler limitieren.

Halten Sie es schlank: Ein wöchentliches 15‑minütiges Review reicht, solange Sie schnell wachsen.

Beispiel: Ein schnell wachsender Prototyp, der die Logs überwuchs

Ein kleines Team startete einen Prototyp und ging in zwei Wochen von 50 auf 5.000 Nutzer. Kurz nach der Einführung des E‑Mail‑Logins fing die Authentifizierung für einen Teil der Nutzer an zu scheitern. Sie stellten das Log‑Level auf Debug, um den Fehler zu fangen — und ihr Log‑Volumen explodierte über Nacht.

Das Problem war nicht nur „mehr Nutzer.“ Sie loggten vollständige Request‑Bodies, komplette Header und ganze Auth‑Antworten. Darunter lange JWTs, Refresh‑Tokens und gelegentlich Session‑Cookies. Während der Incident‑Antwort kopierten Leute Logs in Chats, was das Leckrisiko vervielfachte.

Sie stellten auf „genug“ Logs um. Statt alles zu dumpen, loggte jedes Auth‑Event: eine Request‑ID, User‑ID (oder anonymisierte ID), Endpoint, Statuscode, Fehlercode, Latenz und eine kurze Reason‑Zeile. Zum Debuggen loggten sie, welcher Schritt fehlgeschlagen war (Token‑Parse, DB‑Lookup, Password‑Check), nicht die rohe Payload.

Sampling machte den größten Unterschied. Sie behielten 100% der Fehler und Timeouts, aber nur 5% erfolgreicher Auth‑Anfragen. Das zeigte weiterhin Trends, ohne für jedes OK zu zahlen.

Redaction schloss die Sicherheitslücke. Tokens und Secrets wurden beim Logger maskiert, sodass Suchen während des Ausfalls keine Credentials offenlegten.

Ihr Retention‑Plan war einfach:

- 7 Tage: vollständige Fehlerlogs (unsampled)

- 14 Tage: gesampelte Request‑Logs (Erfolgsfälle)

- 30 Tage: Sicherheits‑ und Audit‑Events (minimale Felder)

- 90 Tage: nur tägliche Aggregate (Counts, p95‑Latenz)

Häufige Fehler, die Kosten (und Risiko) treiben

Die meisten Probleme entstehen aus einer Gewohnheit: während eines Prototyp‑Sprints „alles“ einzuschalten und dann nie wieder zurückzudrehen, wenn echte Nutzer kommen.

Eine Falle ist, standardmäßig vollständige Request‑ und Response‑Bodies zu loggen. Das fühlt sich nützlich an, multipliziert aber Volumen schnell und erfasst oft Passwörter, Tokens, Zahlungsdaten oder private Nachrichten. Wenn Sie Payloads brauchen, loggen Sie nur eine kleine Allowlist sicherer Felder und nur für kurze Zeit.

Ein weiterer stiller Kostentreiber ist, alles durchsuchbar zu machen. High‑cardinality‑Felder wie user_id, session_id, trace_id, email und vollständige URLs mit Query‑Strings können die Indexgröße explodieren lassen. Lassen Sie die meisten Felder als Plain‑Text und indexieren Sie nur wenige stabile Felder, nach denen Sie wirklich filtern.

Drei Fehler, die meist kurz vor einer Überraschungsrechnung auftreten:

- Debug/Verbose‑Logs nach einem Incident in Produktion anlassen

- Logs für Analytics (Funnels, Kohorten) statt Metriken oder Events verwenden

- Redaction erst anwenden, nachdem Logs zum Vendor geschickt wurden

Redaction muss passieren, bevor etwas die App verlässt. „Wir scrubben es in der Pipeline“ scheitert beim ersten neuen Endpoint, der unerwartet etwas loggt.

Schnelle Checkliste vor Ihrem nächsten Wachstumssprung

Ein Growth‑Spike verwandelt „funktioniert erstmal“ in eine Rechnung und ein Risiko über Nacht.

- Schreiben Sie Ihre Retention‑Tiers nieder und warum sie existieren. Kurze Retention für hochvolumige Debug‑Logs, längere nur für wirklich genutzte Logs.

- Fügen Sie Sampling‑Regeln für die lautesten Pfade hinzu. Sample Routine‑Success‑Logs, behalten Sie vollständige Logs für Fehler und seltene Edge‑Cases.

- Redacten Sie Secrets und personenbezogene Daten, bevor Logs die App verlassen. Wenn Sie es nicht in einen öffentlichen Chat kopieren würden, gehört es nicht in ein Log.

- Aktivieren Sie Budgets und Alerts und testen Sie sie. Prüfen Sie, dass Alerts auslösen und jemand sie sieht.

- Reviewen Sie wöchentlich die Top‑Log‑Quellen mit einer einzelnen Verantwortlichen Person. Eine Person entscheidet über Logging‑Änderungen, damit „temporärer Debug“ nicht dauerhaft wird.

Nächste Schritte: Logging stabilisieren auf dem Weg zur Produktion

Wenn Überraschungsrechnungen weg sind, geht es darum, Logs nützlich zu halten, während die Nutzung wächst. Das ist weniger eine einmalige Änderung als eine Reihe von Gewohnheiten, die verhindern, dass Volumen wieder ansteigt.

Starten Sie mit einem schnellen Audit im Log‑Explorer und sortieren Sie nach dem, was am meisten Daten produziert: der lauteste Service, der meistgenutzte Endpoint und die größten Log‑Zeilen. Fragen Sie für jede: Hilft das beim Beheben eines echten Problems, oder ist es nur „nice to have"?

Beheben Sie die größten Übeltäter zuerst:

- Debug‑Noise, das versehentlich in produktionnahen Umgebungen blieb

- High‑cardinality‑Felder (vollständige URLs mit einzigartigen Query‑Strings, nutzergetriebene Werte)

- Roh‑Payloads (vollständige Request/Response‑Bodies, große JSON‑Blöcke, wiederholte Stacktraces)

Machen Sie Schutzmechanismen schwer rückgängig. Fügen Sie Redaction‑Tests hinzu, die den Build fehlschlagen lassen, wenn Logs Muster wie API‑Keys, JWTs, Passwörter oder gängige Secret‑Präfixe enthalten. Legen Sie einen einfachen „Log‑Contract“ für wichtige Events fest (Auth‑Fehler, Zahlungsfehler, Background‑Job‑Fehler), damit klar ist, was geloggt werden muss und was niemals geloggt werden darf.

Wenn Sie einen AI‑generierten Prototyp übernommen haben, planen Sie Extra‑Zeit für Bereinigung. Solche Projekte liefern oft chatty Default‑Logging, kopierte Snippets, die Header oder Tokens ausgeben, und fragile Auth‑Flows, die wiederholt Fehler erzeugen (und wiederholt Logs).

Wenn Sie externe Hilfe möchten, spezialisiert sich FixMyMess (fixmymess.ai) auf die Diagnose und Reparatur AI‑generierter Codebasen, einschließlich lauter Logs, Geheimnis‑Exponierungen und Produktionshärtung. Ein schnelles Audit kann die Log‑Volumen‑Hotspots und die sichersten ersten Änderungen identifizieren.

Häufige Fragen

What’s the fastest way to stop a surprise logging bill?

Beginnen Sie damit, Debug-/Verbose-Logging in der Produktion auszuschalten und alle Dumps von vollständigen Request-/Response-Bodies zu entfernen. Reduzieren Sie dann die Aufbewahrungsdauer für hochvolumige Logs auf ein paar Tage und fügen Sie Sampling für routinemäßige 200‑OK‑Requests hinzu, während Sie 100% der Fehler erfassen. Diese drei Maßnahmen reduzieren das Volumen meist schnell, ohne die Fehlerbehebung merklich zu erschweren.

What should I log in a prototype to keep it useful but cheap?

Protokollieren Sie standardmäßig Fehler und wichtige Zustandsänderungen, nicht jede erfolgreiche Anfrage. Eine gute Basis ist: Zeitstempel, Level, Service‑Name, Endpoint, Statuscode, Dauer und eine Request‑ oder Trace‑ID sowie ein kurzer Fehlercode bei Problemen. Fügen Sie nur den minimalen Kontext hinzu, den Sie tatsächlich zur Reproduktion von Problemen benötigen.

How do I choose log retention without guessing?

Retention‑Kosten wachsen mit dem Volumen, deshalb brauchen hochvolumige Logs kurze Fenster. Bewahren Sie detaillierte „Hot“-Fehlerlogs 1–3 Tage auf, allgemeine Request‑Logs etwa 7–14 Tage und behalten Sie nur wirklich benötigte Sicherheits-/Audit‑Events länger. Wenn Sie unsicher sind: lieber zuerst kürzere Aufbewahrung wählen und nur verlängern, wenn Sie tatsächlich ältere Logs verwenden.

How can I use sampling without going blind during incidents?

Erfassen Sie 100% aller Fehler, Ausnahmen, Timeouts und ungewöhnlich langsamer Anfragen, damit während Vorfällen keine Beweise fehlen. Für stark frequentierte Erfolgs‑Pfaden sample Sie einen kleinen Prozentsatz, sodass Sie Trends sehen, ohne jedes Ereignis zu speichern. Ergänzen Sie das mit einer harten Ratenbegrenzung, damit eine Retry‑Schleife Ihr Log‑Volumen nicht über Nacht vervielfacht.

What does “high cardinality” mean, and why does it raise costs?

High‑Cardinality‑Felder sind Werte, die nahezu immer einzigartig sind, z. B. vollständige URLs mit Query‑Strings, Session‑Tokens, zufällige IDs oder dynamische Fehlermeldungen. Wenn diese als Tags/Labels indexiert werden, muss das Logging‑Tool extrem viele Kombinationen verfolgen, was die Kosten schnell hochtreibt. Lassen Sie solche Daten aus indizierten Feldern und speichern Sie nur stabile Felder, nach denen Sie tatsächlich filtern.

How do I decide which fields to index for search?

Indexieren Sie nur eine kleine Menge stabiler Felder, nach denen Sie regelmäßig filtern — z. B. Service‑Name, Environment, Log‑Level, Endpoint und einige Fehlercodes. Lassen Sie alles andere als unindizierten JSON/Text, sodass es bei Bedarf verfügbar bleibt, aber nicht die Indexgröße aufbläht. Wenn Suchen zu langsam sind, fügen Sie jeweils nur ein Feld hinzu statt alles auf einmal zu indizieren.

What’s the safest way to prevent tokens and secrets from leaking into logs?

Redactieren Sie, bevor Logs die Anwendung verlassen, denn ist ein Geheimnis einmal geloggt, kann es in Alerts, Exporten und Backups weiterverbreitet werden. Maskieren oder löschen Sie sensible Header und Felder wie Authorization, Cookies, Passwörter, API‑Keys, Reset‑Links und Tokens. Für Korrelation loggen Sie besser einen One‑Way‑Hash oder nur die letzten vier Zeichen statt des Rohwerts.

Why did my logging volume explode right after a release?

Meistens ist es eine Konfigurations‑Flag, die nach dem Troubleshooting anbleibt, oder ein Codepfad, der bei jedem Retry oder jeder Schleife loggt. Auch ein neues, großes Feld wie Request‑Bodies oder sich wiederholende Stacktraces kann das Volumen stark erhöhen. Bei einem Spike zuerst den stärksten „Top‑Talker“ Service/Endpoint identifizieren, den lauten Change rückgängig machen und dann Sampling oder Ratenlimits hinzufügen.

How do I monitor logging costs so spikes don’t surprise me again?

Verfolgen Sie täglich das Ingest‑Volumen, das Speicherwachstum und die „Top Talkers“ nach Service/Endpoint und setzen Sie Budget‑Alerts, die früh im Monat auslösen. Wenn ein Alarm ausgelöst wird, prüfen Sie, was sich geändert hat: neuer Deploy, Config‑Änderung oder ein Endpoint, der zu viele Retries produziert. Behandeln Sie Logging‑Änderungen wie Produktionsänderungen mit einem klaren Verantwortlichen und einer schnellen Nachprüfung nach Deploys.

My prototype was built with an AI tool and the logs are a mess—what should I do?

AI‑generierte Prototypen enthalten oft sehr ausführliches Default‑Logging, kopierte Snippets, die Header oder Tokens ausgeben, und fragile Auth‑Flows, die wiederholte Fehler und Retries auslösen. Wenn Sie nicht wissen, woher der Lärm kommt, kann FixMyMess (fixmymess.ai) ein kostenloses Code‑Audit anbieten, um die größten Log‑Volumen‑Treiber, Risiken bei Geheimnissen und die sichersten ersten Fixes zu finden. Danach kann das Projekt schnell bereinigt und für Produktion gehärtet werden.