Minimale Testsuite für stabilen, KI‑generierten Code, die Bestand hat

Bauen Sie eine minimale Testsuite für KI‑generierten Code mit Smoke‑, API‑Contract‑ und Regressionstests, die dafür sorgen, dass behobene Funktionen nicht wieder kaputtgehen.

Warum instabiler KI‑Code nach einer Reparatur weiter kaputt geht

Instabiler KI‑Code ist der Typ, der bis zur Berührung ganz okay wirkt. Sie beheben einen Fehler und zwei scheinbar unzusammenhängende Bildschirme fallen aus. Ein Deploy, das gestern funktionierte, schlägt heute fehl. Kleine Änderungen führen zu großen Überraschungen, weil der Code versteckte Seiteneffekte und unklare Regeln hat.

In realen Projekten sieht das oft so aus:

- Eine Login‑Änderung bricht die Abrechnung, weil beide auf einem halbfertigen Helfer hängen.

- Die Form einer API‑Antwort ändert sich und die UI fällt stillschweigend in leere Zustände zurück.

- Auth funktioniert lokal, aber in Produktion fehlt eine Environment‑Variable oder ein Secret ist nicht gesetzt.

- Ein schneller Refactor löst zufällige Fehler aus, weil der State am falschen Ort gespeichert wird.

Das ist bei KI‑generierten Prototypen weit verbreitet, weil der Code stückweise erzeugt wird, nicht als zusammenhängendes System geplant. Benennungen driftet, temporäre Hacks werden zu Abhängigkeiten, und ein Sicherheitsnetz fehlt meistens. Teams enden damit, immer wieder Notfall‑Fixes zu machen. Das ist teuer und stressig.

Der günstigste Weg, die Blutung zu stoppen, ist eine kleine, wertstarke Testsuite. Tests sind kein Zauber: sie fangen Fehler früh ab, bevor Nutzer sie sehen. Sie geben Ihnen auch die Sicherheit, um zu refaktorisieren und merkwürdige Teile zu entfernen, ohne zu raten.

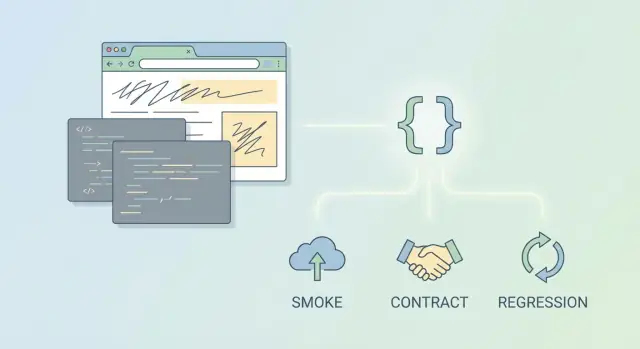

Drei Testarten bieten den größten Schutz bei geringstem Aufwand:

- Smoke‑Tests: Läuft die App grundlegend?

- API‑Contract‑Tests: Bleiben Antworten kompatibel mit UI und Integrationen?

- Regressionstests: Bleibt ein behobener Fehler wirklich behoben?

Ziel ist nicht 100 % Coverage. Erfolg ist einfacher: Sie können deployen ohne Angst, Sie können Code ändern ohne letzte Wochen‑Fixes zu zerstören, und Fehlschläge zeigen genau die Funktion, die gebrochen ist.

Wählen Sie zuerst, was Sie schützen (die 20 %, die 80 % des Schmerzes ausmachen)

Wenn Ihre App von KI‑Tools erzeugt wurde, kann alles fragil erscheinen. Eine minimale Suite funktioniert am besten, wenn sie die wenigen Pfade schützt, die Nutzer täglich treffen, plus die Stellen, an denen eine kleine Änderung fünf andere Dinge kaputt machen kann.

Beginnen Sie damit, die Nutzerreisen aufzulisten, die am meisten Supportaufwand verursachen, wenn sie fehlschlagen. Bleiben Sie praktisch: Was würde das Produkt für einen echten Nutzer als ausgefallen erscheinen lassen? Meistens sind das Login und Registrierung (inklusive Passwort‑Reset), Checkout oder Abo‑Änderungen, Ihr Kern‑Erstellen‑Bearbeiten‑Löschen‑Flow, Webhooks und Datei‑Upload/Download.

Sehen Sie dann auf die Integrationen, die am wahrscheinlichsten auf merkwürdige Weise brechen: Zahlungen, E‑Mail‑Zustellung, Identity‑Provider und Dateispeicher. Sie brauchen keine vollständige End‑to‑End‑Abdeckung. Sie wollen schnelle Checks, die beweisen, dass Sie sich noch verbinden können und eine sinnvolle Antwort bekommen.

Wählen Sie jetzt nur 3 bis 5 Endpunkte oder Abläufe, die niemals ausfallen dürfen. Für ein einfaches SaaS könnten das sein: Login, Projekt erstellen, Teammitglied einladen, Abo kündigen.

Bevor Sie einen Test schreiben, definieren Sie, was „funktioniert“ für jeden davon bedeutet. Halten Sie die Definition kurz und messbar:

- Erwarteter Statuscode und ein paar Schlüsselfelder

- Antwortform (Keys und Typen)

- Eine wesentliche Nebenwirkung (Datensatz erstellt, E‑Mail in Warteschlange, Webhook gesendet)

- Eine zentrale Sicherheitsregel (kein Zugriff auf Daten anderer Nutzer)

Wählen Sie schließlich eine Testumgebung und bleiben Sie dabei. Lokal ist in Ordnung, wenn Setup konsistent ist. Staging ist in Ordnung, wenn Daten kontrolliert sind. Beides zu mischen ist, wie „minimal“ in verwirrendes Rauschen umschlägt.

Smoke‑Tests: schnelle Checks, die offensichtliche Fehler fangen

Smoke‑Tests beantworten eine Frage nach jeder Änderung: Startet die App noch, und antworten die wichtigsten Pfade?

Ein guter Smoke‑Test versucht nicht, alles richtig zu beweisen. Er beweist, dass das Grundlegende nicht völlig kaputt ist. Deshalb sind Smoke‑Tests eine großartige erste Schicht für wacklige, KI‑geschriebene Projekte.

Was rein sollte

Wählen Sie ein paar Ziele, die „die App lebt“ und „Nutzer können das Hauptding tun“ repräsentieren. Zum Beispiel:

- Ein Health‑Check gibt 200 zurück (oder die Startseite lädt)

- Die Login‑Seite rendert (oder der Auth‑Endpunkt antwortet)

- Ein Kern‑API‑Call gibt den erwarteten Status zurück (z. B. aktuellen Nutzer abrufen oder eine Hauptliste)

- Die Datenbankverbindung kann geöffnet werden (nur wenn das ein häufiger Fehler ist)

Halten Sie jeden Test kurz. Zielen Sie auf eine klare Assertion pro Test, wie „gibt 200 zurück“ oder „Antwort enthält userId“. Wenn ein Smoke‑Test fehlschlägt, soll der Grund offensichtlich sein.

Wie Sie sie schnell und zuverlässig halten

Setzen Sie ein striktes Zeitbudget: unter 1–2 Minuten insgesamt. Smoke‑Tests sollten ständig laufen, nicht „wenn sich jemand erinnert“. Eine einfache Routine funktioniert gut:

- Smoke‑Tests lokal vor dem Push ausführen

- Automatisch bei jedem Pull‑Request ausführen

- Merges blockieren, wenn sie fehlschlagen

Beispiel: Sie haben einen Auth‑Flow repariert, der zufällig 500er zurückgab. Fügen Sie einen Smoke‑Test hinzu, der sich mit einem Testkonto anmeldet und dann GET /me aufruft. Wenn es wieder bricht, erfahren Sie es sofort.

API‑Contract‑Tests: Antworten stabil für UI und Integrationen halten

API‑Contract‑Tests prüfen, dass ein Endpunkt sein Versprechen hält: welche Felder auftauchen, welche Typen sie haben und welches Fehlerformat der Client erwarten kann. Sie versuchen nicht, jede Geschäftsregel zu prüfen. Sie verhindern einen der häufigsten Fehler in schnell änderndem Code: ein Backend‑Änderung, die die UI oder einen Partner stillschweigend bricht.

Für eine minimale Suite wählen Sie nur die Endpunkte, deren Änderung am schmerzhaftesten wäre. Das sind meist ein paar Calls, die die UI bei jedem Seitenaufruf macht, plus alles, worauf externe Systeme angewiesen sind.

Eine einfache Auswahlmethode ist, sich den Network‑Tab und die Error‑Logs anzusehen und dann 2–3 contract‑kritische Endpunkte festzuschreiben, z. B.:

- Login oder Session‑Check (

"bin ich angemeldet?") - Aktuelles Nutzerprofil (

"wer bin ich?") - Die Kern‑Erstellen‑Aktion (

"create order","save draft","post message") - Ein kritischer Listen‑Endpunkt (

"meine Projekte","meine Rechnungen")

Decken Sie Erfolg und Fehler ab. Viele instabile Apps scheitern auf den langweiligen Pfaden: fehlende Auth‑Header, ungültige Eingaben, abgelaufene Sessions.

Was zu prüfen ist (und was nicht)

Sperren Sie nur die stabilen Teile ab. Prüfen Sie Dinge, die ein Mensch lesen und zustimmen kann. Überspringen Sie volatile Felder, die bei jedem Lauf anders sind.

- Erforderliche Felder existieren (id, email, status) und die Typen sind sinnvoll

- Fehlerantworten haben immer dieselbe Form (code, message) und den richtigen HTTP‑Status

- Arrays sind Arrays, nicht manchmal null

- Ignorieren Sie Timestamps, zufällige IDs und Reihenfolgen, es sei denn, Reihenfolge ist Teil des Versprechens

Formulieren Sie Erwartungen in klarer Sprache, damit auch ein nicht‑technischer Gründer sie prüfen kann. Beispiel: „Wenn Auth fehlt, gibt /me 401 mit { code, message } zurück. Wenn Auth gültig ist, gibt es 200 mit { id, email } zurück.“ Diese eine Regel verhindert viel Nacharbeit.

Regressionstests: Fixes in dauerhaften Schutz verwandeln

Regressionstests sind „dieser Bug darf nie wiederkommen“‑Tests. In KI‑generierten Codebasen können Fixes beim nächsten Prompt‑Ändern, Dateigenerieren oder Refactor wieder verschwinden. Eine kleine Regression‑Suite sorgt dafür, dass Ihre Fixes bleiben.

Der beste Moment, einen Regressionstest hinzuzufügen, ist direkt nachdem Sie den Bug behoben haben, solange das Versagen noch frisch ist. Wochen später erinnern Sie sich nicht mehr an die genauen Eingaben und den Nutzer‑Impact.

Halten Sie jeden Regressionstest fokussiert auf die kleinste Reproduktion. Erfassen Sie nur, was nötig ist: die spezifischen Eingaben, die wenigen Schritte, die den Bug auslösen, und das erwartete Ergebnis. Wenn der alte Bug zehn Bildschirme Setup brauchte, ist das ein Zeichen, dass Sie einen besseren Test‑Seam brauchen, nicht einen größeren Test.

Ein einfaches Muster:

- Rekreieren Sie die alte fehlerhafte Anfrage oder Nutzeraktion im Test.

- Prüfen Sie das genaue falsche Verhalten, das früher vorkam (Statuscode, Fehlermeldung, falsche Daten).

- Wenden Sie den Fix an.

- Aktualisieren Sie die Assertion auf das korrekte Verhalten und bleiben Sie präzise.

- Geben Sie dem Test einen Namen, sodass das zukünftige Sie die Kosten eines Bruchs versteht.

Testnamen sind unterschätzte Dokumentation. Ein guter Name enthält, was gebrochen ist und warum es wichtig ist, z. B.: rejects_login_when_token_is_missing_prevents_account_takeover.

Konkretes Beispiel: Sie haben einen Passwort‑Reset‑Bug behoben, der verriet, ob ein Nutzer existierte. Der Regressionstest sollte eine Reset‑Anfrage für eine nicht vorhandene E‑Mail schicken und prüfen, dass die Antwort generisch und konsistent bleibt.

Schritt für Schritt: Bauen Sie in einer fokussierten Session eine minimale Suite

Machen Sie Tests leicht zu finden und langweilig zu starten. Erstellen Sie eine kleine Struktur und eine Namensregel, an die Sie nächsten Monat noch halten werden:

tests/smoke/für „läuft es überhaupt?“‑Checkstests/contracts/für API‑Antwort‑Shape‑Checkstests/regression/für bereits behobene Bugs

Benennen Sie Dateien nach Feature (z. B. auth, users, billing), damit Leute die richtigen Tests schnell finden.

Fügen Sie dann eine Handvoll Tests hinzu, die Ihnen schnelle Sicherheit geben. Halten Sie das Setup einfach, damit sie auf jeder Maschine gleich laufen. Ein guter Start ist:

- 3 Smoke‑Tests (Boot, ein Hauptflow, eine kritische API)

- 2 Contract‑Tests (Ihre zwei meistgenutzten Endpunkte)

- 2 Regressionstests (Ihre letzten zwei echten Vorfälle)

Beim Schreiben von Smoke‑Tests denken Sie wie ein müder Nutzer: „Ich öffne die App, ich mache das Hauptding, es funktioniert.“ Bei Contract‑Tests denken Sie wie ein Frontend: „Ich brauche id, name und role, nicht eine überraschende Umbenennung.“ Bei Regressionstests kopieren Sie die exakten Schritte, die in Produktion gebrochen sind, und prüfen dann das behobene Verhalten.

Führen Sie alles zuerst lokal aus und dann denselben Befehl in Ihrer Deployment‑Pipeline. Wenn Tests zu langsam sind, schneiden Sie den Umfang, nicht die Präzision.

Eine Regel hält die Suite lebendig: Wenn Sie ein Feature anfassen, fügen Sie dafür einen Test hinzu oder aktualisieren ihn.

Tests zuverlässig machen: stabiles Data, stabiles Setup, stabiles Cleanup

Eine minimale Suite hilft nur, wenn sie bei jedem Lauf dieselbe Antwort gibt. Die meisten „zufälligen Fehler“ sind nicht zufällig. Sie kommen von gemeinsam genutzten Daten, inkonsistentem Setup oder Tests, die von externen Diensten abhängen.

Halten Sie Testdaten getrennt von echten Daten. Nutzen Sie eine Testdatenbank, ein temporäres Schema oder einen entfernbaren Datensatz, der sicher gelöscht werden kann. Wenn Tests Produktionsdaten berühren können, werden sie sie irgendwann beschädigen oder man traut sich nicht mehr, sie auszuführen.

Machen Sie das Setup vorhersehbar. Legen Sie ein paar bekannte Nutzer und Rollen an und nutzen Sie sie wieder: ein Admin, ein Normalnutzer und ein gesperrter Nutzer. Halten Sie deren Zugangsdaten im Test‑Konfig, damit Sie später keinen Änderungen nachlaufen.

Externe Dienste sind eine häufige Quelle von Flakiness. Treffen Tests echte E‑Mails, Zahlungen oder Webhooks, sehen Sie Timeouts, Ratenbegrenzungen und überraschende Fehler. Faken oder stubben Sie diese Aufrufe, wo möglich, oder testen Sie nur „wir haben die richtige Anfrage geschickt“ und „wir haben die Antwort korrekt behandelt".

Fixtures helfen, Copy‑Paste‑Daten, die driften, zu vermeiden. Pflegen Sie einen kleinen Satz Builder für gängige Objekte wie Nutzer, Projekt oder Bestellung. Nutzen Sie klare Defaults und überschreiben Sie nur, was ein Test wirklich braucht.

Setzen Sie den Zustand zwischen Tests zurück, damit ein Fehler den nächsten nicht vergiftet. Eine einfache Schleife: Daten erstellen, Aktion ausführen, relevante Dinge prüfen, dann aufräumen (Rollback oder Tabellen leeren) und Caches/Flags zurücksetzen.

Häufige Fehler, die Zeit verschwenden und Tests flaky machen

Der schnellste Weg, keine Tests mehr zu haben, ist, alles auf einmal testen zu wollen. Wenn Sie am ersten Tag auf vollständige Coverage abzielen, bleiben Sie beim Wiring des Setups stecken, kämpfen mit Fehlern und schaffen es nie, eine brauchbare Suite auszuliefern.

Eine andere Falle ist, das Falsche zu testen. Pixel‑genaue UI‑Checks und exakte Textvergleiche wirken beruhigend, brechen aber bei harmlosen Änderungen wie einem neuen Button‑Label. Minimale Tests sollten sich auf Ergebnisse konzentrieren: "Nutzer kann sich anmelden", "Rechnungsbetrag ist korrekt", "API liefert die Felder, die die UI braucht".

Tests werden auch flaky, wenn sie vom Internet abhängen. Echte Payment‑, Email‑ oder Analytics‑APIs fallen aus, werden rate‑limitiert oder ändern ihr Verhalten. Stubben Sie Drittparteien und reservieren Sie eine gelegentliche End‑to‑End‑Prüfung für Staging, nicht für jeden Commit.

Achten Sie auf brüchige Assertions. IDs, Timestamps und automatisch generierte Meldungen ändern sich ständig in chaotischen Prototypen. Bevorzugen Sie stabile Checks wie Statuscodes, Schlüssel‑Felder und einfache Muster (z. B. „createdAt existiert und ist ein ISO‑Datum") statt exakter Zeitstempel.

Wenn Sie Flakiness haben, helfen diese Maßnahmen meist schnell:

- Testen Sie Ergebnisse, nicht UI‑Pixel oder exakte Formulierungen

- Stubben Sie Drittanbieter und kontrollieren Sie Antworten

- Vermeiden Sie Assertions auf zufällige IDs und exakte Zeitstempel

- Fügen Sie pro kritischem Endpunkt mindestens einen Sad‑Path‑Test hinzu

- Halten Sie die Suite schnell (Minuten, nicht viele zehn Minuten)

Ignorieren Sie Fehlerpfade nicht. KI‑generierte Apps scheitern oft an abgelaufenen Sessions, fehlenden Environment‑Variablen und malformed Payloads. Wenn Sie nur Happy‑Paths testen, brechen behobene Funktionen immer wieder.

Schnell‑Checkliste: Erfüllt Ihre minimale Suite ihren Zweck?

Eine minimale Suite ist nur minimal, wenn sie schützt, was Sie ausliefern, und schnell genug bleibt, um ständig zu laufen.

Die Suite schützt das Wesentliche

Wenn eines der folgenden fehlschlägt, ist die App nicht sicher zum Deployen:

- Die App startet sauber (keine fehlenden Environment‑Variablen, kein Crash beim Boot).

- Datenbank‑Setup funktioniert (Migrations laufen auf einer frischen DB durch).

- Eine Schlüssel‑Seite oder Ansicht rendert (oft das Dashboard).

- Ihre Top‑3 APIs liefern die Felder, die die UI erwartet (Namen und Typen, die Sie tatsächlich nutzen).

- Dieselben APIs liefern konsistente Fehlerformen (damit die UI eine hilfreiche Meldung zeigen kann).

Die Suite bleibt einfach zu starten und vertrauenswürdig

Geschwindigkeit und Wiederholbarkeit sind wichtiger als Umfang:

- Die letzten zwei kritischen Bugs, die Sie behoben haben, haben jeweils einen Regressionstest.

- Tests laufen in wenigen Minuten auf einem normalen Laptop durch.

- Eine Person kann alles mit einem einzigen Befehl ausführen, ohne tribal knowledge.

Wenn ein Test fehlschlägt, sollten Sie sofort etwas lernen. Ein guter Fehler weist auf eine wahrscheinliche Ursache hin ("Login‑Token fehlt", "API‑Feld umbenannt"), nicht auf ein vages Timeout.

Beispiel: Einen behobenen Auth‑Flow vor erneutem Zerbrechen schützen

Eine typische Geschichte: Ein Gründer liefert einen KI‑gebauten Prototyp mit Login und Abonnements. In Demos klappt alles, aber reale Nutzer stoßen auf merkwürdige Fehler. Logins schleifen zurück zur Anmeldeseite, Sessions laufen sofort ab, und der Checkout bricht, weil die App denkt, der Nutzer sei ausgeloggt.

Jemand repariert die Auth‑Logik, räumt Cookies oder Tokens auf, und die App hält endlich eine Session. Zwei Wochen später landet eine kleine Änderung (oft an einer anderen Stelle im Code) und der Login ist wieder kaputt. Niemand hat „auth“ angefasst, aber ein neues Middleware‑Stück, ein Refactor oder eine Environment‑Änderung hat das Verhalten verändert.

Eine minimale Suite verhindert dieses Zurückfallen, indem sie drei kleine Schutzschichten um den Flow legt:

- Ein Smoke‑Test, der die Login‑Route aufruft und ein klares Erfolgssignal prüft (200 OK plus Session‑Cookie oder Token vorhanden).

- Ein Contract‑Test, der die Form der Session‑Antwort prüft (z. B. user id, email, subscriptionStatus), damit die UI nicht bricht, wenn Felder verschoben oder umbenannt werden.

- Ein Regressionstest, der den genauen Fehler reproduziert, den Sie gesehen haben, z. B. „nach Login gibt

GET /me401 zurück" oder „Seitenaktualisierung verliert die Session."

Halten Sie die Prüfungen einfach. Sie wollen nicht jede Ecke testen. Sie schützen, was Geld bringt: Menschen können sich anmelden und bleiben angemeldet.

Der Nutzen zeigt sich beim nächsten Code‑Änderung. Statt Nutzer‑Reports „Ich kann mich nicht einloggen" schlägt der Build schnell fehl mit einer Meldung wie "session response missing subscriptionStatus." Das ist ein fünfminütiger Fix, kein mehrtägiges Chaos.

Es reduziert auch Hin‑und‑Her mit Auftragnehmern und Agenturen. Man streitet nicht mehr, ob Auth auf einer Maschine funktioniert. Der Test ist der Schiedsrichter.

Nächste Schritte: Halten Sie die Suite minimal und liefern Sie weiter sicher aus

Eine minimale Suite funktioniert nur, wenn sie an realen Schmerzen ausgerichtet bleibt. Ziel ist nicht „mehr Coverage“. Ziel ist weniger Überraschungen nach jeder Änderung.

Wählen Sie Ihre nächsten fünf Tests basierend auf dem, was Ihnen tatsächlich Zeit gekostet hat: Support‑Tickets, Ausfälle und die Teile der App, vor denen Sie sich fürchten, sie anzufassen. Nehmen Sie die letzten drei Produktionsfehler (oder Beinahe‑Ausfälle) und verwandeln Sie jeden in einen Regressionstest, der auf dieselbe Weise fehlschlägt wie in echt.

Um Momentum zu behalten, ohne dass Tests Ihre Woche übernehmen:

- Nach jedem Bugfix: Fügen Sie 1 kleinen Regressionstest hinzu, der beweist, dass der Fix hält.

- Nach jedem Incident: Fügen Sie 1 Smoke‑Test hinzu, der ihn schnell erkannt hätte.

- Alle paar Wochen: Fügen Sie 1 Contract‑Test für Ihren meistgenutzten Endpunkt oder Ihre Integration hinzu.

- Halten Sie eine kurze Liste der „top breakpoints“ und entfernen Sie Tests, die heutige Risiken nicht mehr abbilden.

- Hören Sie auf, wenn neue Tests keine echten Probleme mehr fangen. Das ist Ihre aktuelle minimale Menge.

Wenn die Codebasis chaotisch ist, kann zu schnelles Ausweiten der Tests nach hinten losgehen. Wenn Setup unvorhersehbar ist, bekommen Sie flaky Tests, die ignoriert werden. Machen Sie in dem Fall zuerst einen kurzen Stabilisierungspass: bauen Sie einen sauberen Boot‑Pfad, erstellen Sie ein zuverlässiges Test‑DB‑Setup und entfernen Sie offensichtliche Stolperfallen wie exponierte Secrets oder fragilen globalen Zustand.

Wenn Sie einen KI‑generierten Prototypen geerbt haben, der immer wieder regressiert, spezialisiert sich FixMyMess (fixmymess.ai) darauf, KI‑erstellte Codebasen zu diagnostizieren und zu reparieren und dann genau genug Smoke‑, Contract‑ und Regressionstests hinzuzufügen, damit Fixes nicht beim nächsten Change wieder verschwinden.

Behandeln Sie Ihre Suite wie einen Sicherheitsgurt: klein, immer an und auf die Unfälle konzentriert, die Sie bereits hatten.

Häufige Fragen

Was sollte ich zuerst testen, wenn meine KI‑generierte App ständig kaputt geht?

Beginnen Sie mit dem, was das Produkt für einen echten Nutzer „ausfallen“ lassen würde: Einloggen, die Hauptseite laden und die zentrale Aktion abschließen (Erstellen/Bearbeiten/Checkout). Wählen Sie 3–5 Abläufe oder Endpunkte, die Sie sich nicht leisten können, zu verlieren, und ignorieren Sie vorerst alles andere.

Wie viele Tests brauche ich, bevor die Suite wirklich nützlich ist?

Eine sinnvolle minimale Menge sind 3 Smoke‑Tests, 2 Contract‑Tests und 2 Regressionstests. Das reicht meist, um offensichtliche Fehler zu erkennen, unbeabsichtigte API‑Änderungen zu verhindern und die letzten Vorfälle dauerhaft zu blockieren.

Was gilt als Smoke‑Test und was nicht?

Smoke‑Tests sind einfache "läuft es und antwortet es?"‑Checks: Die App startet, Auth antwortet und eine Kern‑API funktioniert. Wenn ein Smoke‑Test langen Aufbau erfordert oder viele Geschäftsregeln prüft, ist er kein Smoke‑Test mehr.

Was genau prüft ein API‑Contract‑Test?

Ein Contract‑Test legt die Antwortfelder und das Fehlerformat fest, auf die UI oder Integrationen sich verlassen (erforderliche Schlüssel und Basistypen). Er muss nicht jede Regel prüfen; er verhindert stille Brüche, wenn jemand Felder umbenennt oder entfernt.

Wie schreibe ich einen Regressionstest, der verhindert, dass der Fehler zurückkommt?

Verwandeln Sie jeden echten Vorfall in eine kleine Reproduktion: die genaue Anfrage oder Aktion, die fehlgeschlagen ist, plus eine präzise Erwartung für das korrekte Verhalten. Schreiben Sie den Test direkt nach dem Fix, solange die Eingaben und die Nutzerfolge noch klar sind.

Warum sind meine Tests flach, obwohl der Code in Ordnung aussieht?

Nutzen Sie eine einzige Testumgebung und machen Sie sie vorhersehbar mit stabilem Seed‑Data und kontrollierter Konfiguration. Die meisten "zufälligen" Fehler kommen von gemeinsamem Zustand, übrig gebliebenen Daten oder Abhängigkeiten zu externen Diensten, die ausfallen.

Wie verhindere ich, dass Environment‑Variable‑Probleme wieder die Produktion kaputt machen?

Testen Sie den Boot‑Pfad so, dass fehlende Konfiguration sofort auffällt, und lassen Sie die App klare Fehler melden. Wenn Auth lokal funktioniert, in Produktion aber nicht, sind häufige Ursachen fehlende Environment‑Variablen, falsche Cookie‑Einstellungen oder inkonsistente Secrets zwischen Umgebungen.

Sollte meine minimale Suite echte Stripe/Email/Webhook‑Dienste treffen?

Standardmäßig sollten Drittanbieter‑Aufrufe gestubbt oder gefälscht werden, sodass Tests nur das prüfen, was Sie kontrollieren: Sie senden die richtige Anfrage und verarbeiten eine bekannte Antwort. "Echte" Integrations‑Checks belassen Sie für gelegentliche Staging‑Läufe, denn diese Dienste können Ratenbegrenzungen oder unerwartete Änderungen haben.

Wie verhindere ich, dass Tests bei harmlosen Änderungen wie IDs oder Zeitstempeln brechen?

Vermeiden Sie Assertions auf exakte Zeitstempel, zufällige IDs oder sich natürlich ändernde Payloads. Prüfen Sie nur stabile Dinge, über die sich ein Mensch einigen kann: Statuscodes, erforderliche Felder und konsistente Fehlerformate.

Wann sollte ich aufhören, Tests hinzuzufügen, und stattdessen den Code stabilisieren oder neu aufbauen?

Wenn Sie keinen stabilen Boot‑Pfad erhalten, Auth kaputt ist, Secrets offenliegen oder die Architektur zu verworren ist, um reproduzierbare Tests aufzubauen, reparieren Sie zuerst die Grundlage. FixMyMess kann den Codebestand analysieren, die fragilen Teile beheben und eine kleine Reihe von Smoke‑, Contract‑ und Regressionstests hinzufügen, damit Fixes Bestand haben.