Moderations-Workflow für Community-Apps

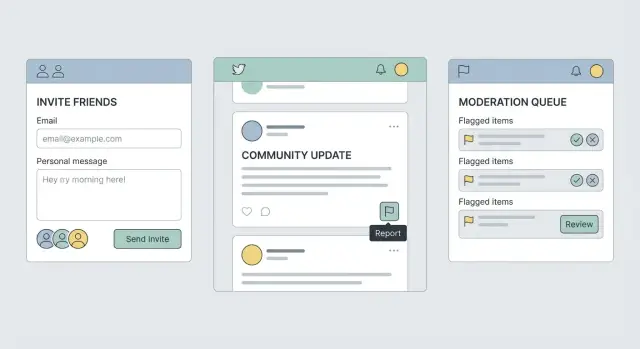

Ein praktischer Plan für einen Moderations-Workflow in Community-Apps: Einladungen, rollenbasierte Aktionen, Meldungen und Prüfschritte, die Ihren Raum sicher halten.

Warum Sicherheits-Workflows eine Community-App machen oder zerstören

Eine Community-App kann am ersten Tag freundlich wirken und bis zur zweiten Woche chaotisch sein. Dieser Wechsel liegt meist nicht an Funktionen. Er passiert, wenn es keinen klaren Sicherheits-Workflow gibt: Nutzer wissen nicht, wie sie Probleme melden, Moderatoren wissen nicht, was als Nächstes zu tun ist, und schlechte Akteure merken, dass sie Grenzen ohne Konsequenzen austesten können.

Ohne Plan wiederholen sich die gleichen Probleme: Spam-Accounts posten Links, Belästigungen in Antworten und Direktnachrichten, das Vortäuschen vertrauenswürdiger Mitglieder und Betrugsversuche gegen neue Nutzer. Schon wenige Vorfälle können den Ton setzen. Regelmäßige Mitglieder hören auf zu posten, und die Leute, die Sie am meisten halten wollen, gehen zuerst.

Schicke Features beheben das selten. Einladungen und Meldemöglichkeiten sind wichtiger, weil sie steuern, wer hereinkommt und was passiert, wenn etwas schiefgeht. Wenn Einladungen leicht missbräuchlich verwendet werden können, sehen Sie Wellen von Accounts mit geringer Mühe. Wenn das Melden verwirrend oder sinnlos wirkt, streiten Mitglieder öffentlich, gehen still oder kümmern sich anderweitig.

Ein solider Moderations-Workflow für eine Community-App bedeutet nicht, streng zu sein. Er bedeutet konsistent zu sein. Dasselbe Verhalten sollte zum selben nächsten Schritt führen, und Mitglieder sollten wissen, was sie erwarten können.

Für ein kleines Team bedeutet "sicher genug zum Starten" meist, dass Sie zuverlässig vier Dinge tun können:

- Missbrauch an der Tür mit grundlegenden Einladungsprüfungen und Ratenbegrenzungen reduzieren.

- Jedem erlauben, in wenigen Klicks zu melden, mit klaren Gründen und optionalen Details.

- Moderatoren eine kleine Aktionsauswahl (Warnen, Inhalt entfernen, stummschalten, sperren) mit klarer Eskalation geben.

- Eine schlanke Aufzeichnung dessen führen, was passiert ist (wer was wann und warum getan hat).

Wenn Ihre App schnell mit KI-Tools gebaut wurde, testen Sie diese Abläufe früh. Teams entdecken oft, dass Authentifizierung, Berechtigungen oder Meldebildschirme zwar gut aussehen, aber in der Praxis versagen.

Klare Regeln definieren, die Sie tatsächlich durchsetzen können

Regeln funktionieren nur, wenn Sie sie jedes Mal gleich anwenden können. Beginnen Sie damit, in einem Satz zu definieren, für wen die Community gedacht ist, und fügen Sie einen Satz darüber hinzu, wofür sie nicht gedacht ist. Beispiel: „Eine Peer-Gruppe für neue Produktmanager. Kein Ort, um Dienstleistungen zu verkaufen oder für fremde Jobs zu rekrutieren.“ Diese Zeile lenkt spätere Entscheidungen.

Wandeln Sie Ihre Regeln dann in ein paar klare Kategorien um, die Sie schnell taggen und bearbeiten können. Wenn sich eine Regel keiner Kategorie zuordnen lässt, ist sie schwer durchzusetzen.

- Spam und Betrug (Massensendungen, Referral-Links, gefälschte Gewinnspiele)

- Belästigung und Hass (Beleidigungen, Drohungen, gezieltes Angreifen einer Person)

- Unsichere Inhalte (Ermutigung zu Selbstverletzung, sexuelle Inhalte mit Minderjährigen)

- Fehlinformationen (gefährliche medizinische Behauptungen, Identitätsvortäuschung)

- Verletzung der Privatsphäre (Doxxing, Teilen privater Screenshots)

Entscheiden Sie anschließend, was automatisch und was menschlich geprüft werden muss. Halten Sie die „automatische“ Liste kurz und offensichtlich. False Positives wirken unfair und bringen Menschen dazu, Meldungen zu misstrauen.

Eine praktische Aufteilung sieht so aus: automatische Blockade bei klaren Spam-Mustern, offensichtlichen Betrugsversuchen, Doxxing und Kindesmissbrauch; automatisches Verbergen von Inhalten bei wiederholten Meldungen, Schimpfwörtern oder Identitätsvortäuschung; und menschliche Überprüfung bei kontextabhängigen Fällen (Streitigkeiten, Sarkasmus, Grenzfälle).

Schreiben Sie kurze, benutzerorientierte Meldungen, bevor Sie sie brauchen. Sie sollten sagen, was passiert ist, warum und was als Nächstes zu tun ist.

Beispiel für eine Löschmitteilung: "Wir haben Ihren Beitrag entfernt, weil er einen Verkaufslink enthielt. Dieser Raum ist für Diskussionen, nicht für Werbung. Sie können ohne Links erneut posten."

Beispiel für eine Warnung: "Bitte hören Sie auf, über persönliche Merkmale zu kommentieren. Kritisieren Sie Ideen, nicht Personen. Beim nächsten Mal kann eine vorübergehende Stummschaltung folgen."

Ein Einladungs- und Onboarding-Flow, der Missbrauch reduziert

Ein guter Einladungs- und Onboarding-Flow erfüllt zwei Dinge gleichzeitig: Er hilft echten Menschen schnell beizutreten und macht es schlechten Akteuren unangenehm, massenhaft aufzutauchen. Wenn das gelingt, bleibt die Moderation ruhiger, weil weniger Probleme in den Raum gelangen.

Die richtige "Tür" für Ihre Community wählen

Wählen Sie die einfachste Eintrittsmethode, die zu Ihrem Risiko passt:

- Offener Beitritt: am besten für risikoarme Räume, aber erwarten Sie mehr Spam und gelegentliche Trolle.

- Nur auf Einladung: ideal am Anfang und für kostenpflichtige Gruppen; langsameres Wachstum, sichererer Ton.

- Warteliste: nützlich, wenn Sie Profile prüfen oder Wachstum kontrollieren müssen.

- Empfehlungen: stark, wenn Mitglieder neue Leute empfehlen und Sie Missbrauch zurückverfolgen können.

Sie können streng starten und später lockern. Regeln zu verschärfen, nachdem die Community chaotisch ist, ist deutlich schwieriger.

Leichte Reibung hinzufügen, die Massennutzungen blockiert

Die meisten Missbrauchsfälle sind keine einzelnen schlechten Tage. Es sind wiederholte Versuche, automatisierte Anmeldungen und Link-Verbreitung. Einige Schutzmaßnahmen helfen enorm:

- Einladungslinks ablaufen lassen (z. B. 24 bis 72 Stunden) und einmalig nutzbare Codes unterstützen.

- Erstellen von Einladungen und Anmeldungen limitieren (pro Konto, pro IP, pro Gerät, wenn möglich).

- Eine verifizierte E-Mail vor dem Posten oder Versenden von DMs verlangen; bei höherem Risiko optional eine Telefonnummer prüfen.

- Begrenzen, wie viele Konten von einem Gerät in einem Zeitraum erstellt werden können.

Koppeln Sie Reibung an Rechte. Neue Konten können lesen und reagieren, während Posten, externe Links und DMs erst nach Verifizierung oder einer kurzen „Bewährungszeit“ freigeschaltet werden.

Onboarding, das Normen setzt, bevor Probleme beginnen

Onboarding ist nicht nur ein Willkommensbildschirm. Es ist Ihre erste Chance, Erwartungen in klarer Sprache zu setzen. Eine kurze "Community-Versprechen"-Checkbox plus ein paar Fragen reduzieren schlechtes Verhalten und geben Moderatoren später etwas Konkretes, worauf sie verweisen können.

Beispiel: Eine lokale Gründergruppe kann fragen: „Was baust du?“ und „Wofür bist du hier: Feedback, Recruiting oder Networking?“ Dann drei Regeln anzeigen: keine Belästigung, kein Spam und Pitches nur im richtigen Kanal.

Genug protokollieren, um zu untersuchen — aber nicht so viel, dass es beunruhigt

Bei Einladungen protokollieren Sie nur das, was hilft, Missbrauch nachzuverfolgen, ohne unnötig persönliche Daten zu sammeln:

- Einladender ID, Einladungsart und wann sie erstellt und genutzt wurde

- Einladungsstatus (abgelaufen, genutzt, widerrufen) und wie oft ein Versuch stattfand

- Basis-Signale wie IP-Region oder ein Geräte-Fingerprint-Hash (wenn Sie ihn verwenden), nicht rohe Gerätedaten

- Die ersten Aktionen eines neuen Kontos (Beitritt, Post, DM gesendet) mit Zeitstempeln

Ein Meldesystem bauen, das einfach zu benutzen und schwer zu missbrauchen ist

Ein gutes In-App-Meldesystem sollte Sekunden dauern, den Meldenden schützen und Moderatoren genug Kontext geben, um zu handeln.

Platzieren Sie "Melden" dort, wo Schaden tatsächlich passiert: an Beiträgen und Kommentaren, in Direktnachrichten und Nachrichtenverläufen, auf Benutzerprofilen (bei Identitätsvortäuschung oder wiederholter Belästigung) und auf Gruppen- oder Channel-Ebene (für Spam-Netzwerke).

Halten Sie das Meldformular kurz. Fragen Sie zuerst nach einer Kategorie (Belästigung, Spam, Hass, Identitätsvortäuschung, Sorge um Selbstschädigung, Drohung mit Gewalt, Doxxing, anderes). Bieten Sie dann optionale Notizen und eine einfache Möglichkeit, Beweise anzuhängen, z. B. einen Screenshot oder eine automatisch erfasste Nachricht-ID.

Lassen Sie Leute sich beim Melden schützen. Eine "Blockieren"- oder "Stummschalten"-Option im Meldebildschirm reduziert sofort Schaden. Wenn Blockieren auch den Zugang zu einer gemeinsamen Gruppe ändert, weisen Sie darauf hin, bevor der Nutzer bestätigt.

Setzen Sie Erwartungen auf dem Abschlussbildschirm. Sagen Sie, was als Nächstes passiert, was Sie teilen können und was nicht, und wie lange eine typische Antwort dauert. Wenn Sie keinen exakten Zeitrahmen versprechen können, geben Sie eine Spanne an und erklären Sie, was sie verändert (Schwere des Falls, Wiederholung, fehlende Details).

Machen Sie den Ablauf schwerer missbrauchbar. Begrenzen Sie Meldungen von neuen Konten, achten Sie auf wiederholte Falschanzeigen und verlangen Sie eine kurze Begründung, wenn jemand dieselbe Person erneut meldet. Vermeiden Sie es, Details preiszugeben, die den Meldenden identifizieren könnten.

Notfälle brauchen einen schnelleren Weg. Fügen Sie eine "dringend"-Option nur für Hochrisikokategorien hinzu und lösen Sie sofortige Warnungen aus bei:

- glaubhaften Gewaltdrohungen

- Suizid- oder Selbstverletzungsandrohungen

- Doxxing (Wohnadresse, Arbeitsplatz, private Telefonnummer)

- Kinderschutzbedenken

Beispiel: Jemand erhält eine DM mit seiner Adresse. Er meldet die DM, wählt "Doxxing", die App hängt die Nachricht automatisch an, und er blockiert den Absender. Der Bestätigungsbildschirm erklärt, dass die Nachricht für die Überprüfung gesperrt wurde, und ein Moderator sieht sie oben in der Warteschlange mit einem Dringlichkeits-Tag.

Moderationsaktionen und Eskalationsregeln

Ein Moderations-Workflow braucht zwei Dinge: ein klares Aktionsmenü und klare Regeln, wann welche Aktion anzuwenden ist. Ohne das wirken Entscheidungen zufällig, und schlechte Akteure finden Lücken.

Aktionen, die unterstützen — nicht nur bestrafen

Beginnen Sie mit einer kleinen Auswahl an Aktionen, die die meisten Fälle abdecken:

- Inhalt entfernen (Beitrag/Kommentar verbergen oder löschen)

- Verwarnen (Regel nennen und was sich ändern muss)

- Timeout (vorübergehend nur lesen oder nicht posten dürfen)

- Suspendieren (Konto für eine bestimmte Anzahl Tage pausieren, Rückkehr nach Überprüfung)

- Sperren (permanente Entfernung, mit Geräte-/IP-Sicherungen, wenn Sie diese anwenden)

Weiche Maßnahmen sind ebenfalls wichtig, besonders bei Grenzfällen oder wenn ein Thread hitzig wird. Dinge wie Slow Mode, vorübergehende Link-Beschränkungen oder Genehmigungspflicht für brandneue Konten können Schaden verhindern, ohne sofort zu sperren.

Eskalation und Einsprüche

Definieren Sie, wer was tun kann. Ein einfacher Pfad funktioniert: Moderator bearbeitet die Erstreaktion, Admin geht mit Wiederholungen und Randfällen um, und der Eigentümer trifft Entscheidungen zu permanenten Sperren oder Hochrisikofällen (Belästigung, Doxxing, Drohungen). Für schwer rückgängig zu machende Aktionen (z. B. Sperre) verlangen Sie eine Bestätigung durch eine zweite Person.

Einsprüche sollten möglich sein, aber nicht überall. Erlauben Sie Einsprüche bei langen Timeouts, Suspendierungen und Sperren. Nicht bei offensichtlichem Spam oder klaren Sicherheitsverstößen. Idealerweise weist eine andere Person als der ursprüngliche Entscheider den Einspruch zu und setzen Sie eine Frist (z. B. innerhalb von 7 Tagen), damit Fälle nicht ewig offen bleiben.

Konsistenz wird leichter mit drei kleinen Werkzeugen: vorformulierten Gründen, die zu Ihren Regeln passen, internen Notizen, die Mitglieder nicht sehen, und einem einfachen Strike-Zähler, damit Wiederholungen vorhersehbar eskalieren.

Schritt-für-Schritt: den kompletten Workflow von Einladung bis Lösung einrichten

Behandeln Sie den Workflow wie eine Produktionslinie: wer was tun kann, wohin Meldungen gehen und wie Entscheidungen getroffen werden. Richten Sie ihn einmal ein und halten Sie sich daran.

Schritt 1: Moderationsrollen und Berechtigungen definieren

Beginnen Sie mit Rollen, die Sie in einem Satz erklären können: Mitglied, Vertrauter, Moderator, Admin. "Vertrauter" hilft, weil bewährten Mitgliedern mehr Freiheit (Links posten, andere einladen) gegeben werden kann, ohne volle Moderationsrechte.

Schreiben Sie auf, was jede Rolle sehen und tun kann. Halten Sie es langweilig und spezifisch.

Eine kurze Checkliste:

- Wer kann neue Nutzer einladen

- Wer kann Identitäten von Meldenden sehen

- Wer kann Inhalte verbergen vs. löschen

- Wer kann Timeouts verhängen vs. sperren

- Wer kann das Moderationsprotokoll einsehen

Schritt 2: Warteschlangen-Status für Meldungen erstellen

Geben Sie jeder Meldung einen Status, damit nichts verloren geht. Eine einfache Menge: Neu, Triage, Gelöst, Einspruch.

Neu bedeutet, sie ist gerade eingegangen. Triage bedeutet, ein Moderator prüft Kontext (Nachrichtenverlauf, Screenshots, frühere Meldungen). Gelöst heißt, es wurde eine Aktion durchgeführt oder die Meldung wurde mit einer Begründung geschlossen. Einspruch bedeutet, der Nutzer hat die Entscheidung angefochten und es braucht eine zweite Prüfung.

Schritt 3: Benachrichtigungen, die Leute informieren

Benachrichtigen Sie Moderatoren, wenn eine Meldung als Neu eingeht und erneut, wenn sie zu lange liegt. Informieren Sie den Meldenden, wenn die Meldung als Gelöst markiert wurde, auch wenn Sie keine Details teilen können. Eine kurze Nachricht wie "Danke, wir haben das geprüft und Maßnahmen ergriffen" verhindert Wiederholungsmeldungen und Frust.

Vermeiden Sie laute Alerts. Bündeln Sie niedrig priorisierte Elemente, senden Sie aber sofortige Warnungen bei Hochrisiko-Fällen (Drohungen, Doxxing, Kindesschutz, Betrug).

Schritt 4: Ratenbegrenzungen und Missbrauchschecks hinzufügen

Missbrauch zeigt sich oft über Einladungen und Meldungen. Fügen Sie früh einfache Limits hinzu:

- Einladungen pro Konto pro Tag begrenzen (strenger für neue Konten)

- Wiederholte Meldungen eines Nutzers in kurzer Zeit drosseln

- Meldungs-Bursts erkennen und zur Überprüfung routen

- Für schwere Kategorien eine kurze Begründung verlangen

- Konten mit vielen abgewiesenen Meldungen für genauere Prüfung markieren

Schritt 5: Ein Entscheidungs-Template für Konsistenz verwenden

Jede Moderationsaktion sollte dieselben Mindestfelder dokumentieren: Grund, Aktion und Follow-up.

- Grund: welche Regel betroffen war (in Klartext)

- Aktion: was passiert ist (Beitrag verbergen, Verwarnung, 24h-Stummschaltung, Sperre)

- Follow-up: was der Nutzer als Nächstes tun kann (bearbeiten und erneut posten, Einspruch, Sicherheitsressourcen)

Wenn Ihre App mit KI gebaut wurde, planen Sie extra Zeit, um Randfälle zu testen — zum Beispiel, ob "Stummschalten" wirklich Benachrichtigungen blockiert oder ob versteckte Inhalte noch in der Suche auftauchen.

Protokolle, Audit-Trails und Privacy-Grundlagen

Eine Community kann sich moderiert anfühlen und trotzdem unfair sein. Gute Protokolle beheben das. Sie erlauben die Überprüfung von Entscheidungen, das Erkennen von Mustern und das Erklären, was passiert ist, ohne sich auf Erinnerungen zu verlassen.

Entscheiden Sie, was Sie aufzeichnen müssen, um Entscheidungen nachvollziehbar zu machen — und nichts darüber hinaus. Speichern Sie die Fakten, die nötig sind, um einen Fall zu verstehen, nicht eine vollständige Kopie des Privatlebens aller.

Ein Minimum, das sich meistens bewährt:

- Meldungsdetails: Kategorie, Freitext-Begründung, relevante Nachricht-/Beitrags-IDs

- Getroffene Aktion: keine, Verwarnung, Inhaltsentfernung, Stummschaltung, Sperre (inkl. Dauer)

- Zeitstempel: wann gemeldet, wann geprüft, wann gehandelt

- Akteure: wer gemeldet hat, welcher Moderator es bearbeitet hat, wer Eskalationen genehmigt hat

- Verweis auf Beweise: Anlage-IDs oder Nachrichten-Snapshots (nur das Nötigste)

Privacy-Probleme entstehen oft durch "just in case"-Daten. Vermeiden Sie das Protokollieren voller Nachrichtenverläufe, roher IP-Adressen oder das Kopieren kompletter Nutzerprofile in jeden Meldungseintrag. Wenn Sie sensible Inhalte speichern müssen (Screenshots, Nachrichten-Auszüge), begrenzen Sie, wer sie sehen kann. Die Trennung von "Content-View"-Berechtigungen und "Action"-Berechtigungen hilft Junior-Mods, die Warteschlange zu bearbeiten, ohne private Inhalte zu durchsuchen.

Audit-Trail-Grundlagen

Jede Moderationsaktion sollte ein klares Ereignis schreiben: wer was wem wann und warum getan hat. Machen Sie "warum" für schwere Aktionen (lange Stummschaltungen, Sperren) verpflichtend. Wenn Sie das Bearbeiten von Meldungen erlauben, behalten Sie eine Versionshistorie, damit Änderungen sichtbar bleiben.

Einfache Dashboards, die wirklich helfen

Sie brauchen keine ausgefeilte Analytik. Ein kleines Dashboard, das täglich aktualisiert wird, reicht:

- Größe der Warteschlange und älteste offene Meldung

- Wiederholungstäter (Nutzer mit mehreren bestätigten Maßnahmen)

- Top-Meldekategorien

- Arbeitslast der Moderatoren (Fälle pro Moderator)

- Umgekehrte Entscheidungen (Einsprüche, die eine Entscheidung zurückgenommen haben)

Legen Sie Aufbewahrungsregeln vor dem Start fest. Bewahren Sie Aktionsprotokolle länger auf als rohe Beweise. Beispiel: Audit-Ereignisse 12–24 Monate behalten, Anhänge und Nachrichten-Snapshots kürzer (30–90 Tage), außer der Fall ist eskaliert.

Häufige Fehler, die unsichere oder ungerechte Ergebnisse erzeugen

Die meisten Community-Apps scheitern an Sicherheit aus einem einfachen Grund: Die Regeln stehen geschrieben, aber die Workflows nicht.

Zu viel Macht in einem Moderator-Konto

Ein häufiger Fehler ist, Moderatoren vollständigen Zugriff auf Profile, E-Mails, IP-Daten, private Nachrichten oder Abrechnungsdetails zu geben, nur damit sie grundlegende Meldungen bearbeiten können. Das ist riskant für die Privatsphäre und kann echten Schaden anrichten, wenn jemand missbräuchlich handelt oder emotional entscheidet.

Begrenzen Sie Berechtigungen eng und aufgabenbasiert. Ein Moderator, der einen Beitrag verbergen kann, sollte nicht automatisch die gesamte Benutzerhistorie sehen oder Mitgliederlisten exportieren dürfen.

Keine Schutzmechanismen gegen Spam und koordinierte Angriffe

Wenn Einladungen und Meldungen unbegrenzt nutzbar sind, nutzen schlechte Akteure das aus. Sie sehen Invite-Spam, Fake-Accounts und koordinierte Meldestürme, um jemanden mundtot zu machen.

Fügen Sie Reibung hinzu, die normale Nutzer nicht bestraft: begrenzen Sie Einladungen für neue Mitglieder, drosseln Sie wiederholte Meldungen, erkennen Sie Burst-Muster und verlangen Sie kurze Begründungen bei bestimmten Meldetypen.

Randfälle, die Vertrauen zerstören

Moderation wird in den Ecken schwierig: Ein Beitrag wird gelöscht, bevor er geprüft ist; zwei Nutzer blockieren sich gegenseitig; ein Mitglied ist in einer Gruppe gesperrt, aber nicht in der ganzen App; oder eine gemeldete Nachricht liegt in einem privaten Thread. Wenn die UI "Meldung abgesendet" sagt, Moderator:innen aber die Inhalte nicht sehen können, fühlen sich Nutzer ignoriert.

Stellen Sie sicher, dass jede Meldung sauber aufgelöst werden kann, auch wenn Inhalte fehlen. Speichern Sie einen minimalen Snapshot (was passiert ist, wann und warum), sodass Reviewer ohne unnötige Daten handeln können.

Verwirrende Mitteilungen und fehlende Einsprüche

Generische Benachrichtigungen wie "Sie haben Richtlinien verletzt" ohne Kontext lassen Menschen sich willkürlich bestraft fühlen. Schweigen nach einer Meldung hat denselben Effekt.

Jede Aktion sollte einen verständlichen Grund, die nächsten Schritte und Informationen zu Einsprüchen enthalten (wenn diese vorgesehen sind). Schon eine einfache "Überprüfung anfordern"-Option reduziert Abwanderung und öffentliche Ausbrüche.

Kurze Checkliste vor dem Launch

Sie können schnell live gehen und trotzdem sicher sein, wenn Sie die langweiligen Details vor dem Eintreffen echter Nutzer überprüfen.

Führen Sie diese Checkliste in einem Staging-Build (oder privater Beta) aus und schreiben Sie auf, was Sie sehen. Wenn etwas für Sie unklar ist, wird es auch für Moderatoren und Nutzer unklar sein.

- Einladungen verhalten sich vorhersehbar: Einladungen laufen ab, können widerrufen werden und können nicht versehentlich wiederverwendet werden. Testen Sie, was passiert, wenn jemand eine Einladung weiterleitet.

- Melden ist wirklich schnell: Von Beiträgen, Kommentaren, DMs und Profilen kann ein Nutzer in etwa zwei Taps melden, eine kurze Notiz hinzufügen und absenden.

- Moderatoren haben eine klare Warteschlange: neue Meldungen landen in einem einzigen Posteingang mit Basisfiltern (neu, in Prüfung, gelöst).

- Jede Aktion hinterlässt einen Audit-Eintrag: Sperren, Stummschaltungen, Löschungen, Verwarnungen, Rollenänderungen und Meldungsergebnisse schreiben alle einen Logeintrag mit wer, wann und warum.

- Blockierungen werden durchgesetzt: blockierte Nutzer können den Blockenden nicht kontaktieren (DMs, Antworten, Erwähnungen). Prüfen Sie, dass Blockieren keine Präsenzinformationen wie Online-Status preisgibt.

Nach der Checkliste machen Sie fünf schnelle Abuse-Drills mit einem Teamkollegen: einen Spam-Burst, einen Identitätsvortäuschungsversuch, einen Belästigungs-Thread (Antworten und DMs), einen Umgehungsversuch (neues Konto nach Sperre) und einen Falschmeldungsversuch (Melde-Funktion instrumentalisieren).

Beispiel-Szenario und nächste Schritte, um sicher live zu gehen

Ein realistischer Test ist einfach: Ein brandneues Mitglied tritt per Einladung bei und beginnt innerhalb weniger Minuten, Spam-DMs zu senden.

Für das Zielmitglied sollte der Ablauf schnell und schützend wirken. Es öffnet die DM, tippt Blockieren und dann Melden. Das Meldeformular ist kurz: Grund wählen (Spam), optional eine Notiz hinzufügen und absenden. Die Bestätigung sollte klar sein: "Danke, wir haben Ihre Meldung erhalten. Sie erhalten keine Nachrichten mehr von diesem Konto."

Für Moderatoren sollte die Meldung mit genügend Kontext ankommen, um zu handeln, ohne unnötig private Daten freizugeben: Kontoalter, Einladungsquelle (wer eingeladen hat), Anzahl jüngster Nachrichten, der gemeldete Inhalt und ob andere Nutzer dasselbe Konto gemeldet haben.

Der Entscheidungspunkt ist meist Timeout vs. Sperre. Bei geringfügigen, erstmaligen, niedrigvolumigen Fällen kann ein kurzer Timeout plus Verwarnung reichen. Bei brandneuen Konten, vielen schnellen DMs und mehreren Meldungen ist Sperre die sicherere Maßnahme. Wichtig ist Konsistenz: ähnliches Verhalten sollte zu ähnlichen Ergebnissen führen.

Eine einfache Entscheidungsregel:

- Timeout bei geringfügigen, erstmaligen, niedrigvolumigen Fällen.

- Sperre bei hohem Volumen Spam, wiederholtem Verhalten oder mehreren Meldungen.

- Einladungsrechte entziehen (oder den Einladenden markieren), wenn derselbe Einladende ständig schlechte Akteure bringt.

- An Admin eskalieren bei Drohungen, Minderjährigen oder Doxxing.

Meldende sollten eine Statusmeldung bekommen, die keine privaten Details offenlegt: "Wir haben Ihre Meldung geprüft und Maßnahmen gemäß unseren Regeln ergriffen." Falls Sie Einsprüche anbieten, halten Sie sie einfach. Der gesperrte Nutzer kann eine Überprüfung anfragen, sollte aber nicht aus demselben gesperrten Konto Moderator:innen kontaktieren können.

Wenn Sie ein KI-generiertes Prototyp übernommen haben, bei dem Rollen, Audit-Logs oder Meldeflüsse unter diesen Tests versagen, kann FixMyMess (fixmymess.ai) diagnostizieren, was kaputt ist, und helfen, die Sicherheitsgrundlagen vor dem Launch zum Laufen zu bringen — inklusive eines kostenlosen Code-Audits.