Monitoring-Grundlagen für Gründer: Metriken und Alerts zum Start

Monitoring-Grundlagen für Gründer: Beginnen Sie mit Fehlern, Latenz, Uptime und Queue-Tiefe. Verwenden Sie einfache Alerts und Schwellen, um Ausfälle früh zu erwischen.

Was Monitoring ist (und warum Gründer sich ohne es blind fühlen)

Monitoring ist, wie Sie herausfinden, dass Ihre App krank ist, noch bevor Nutzer es sagen. Es sind die Signale und Alerts, die eine Frage schnell beantworten: funktioniert das Produkt gerade für echte Menschen?

Gründer fühlen sich blind, weil die meisten Fehler nicht wie ein kompletter Ausfall aussehen. Die Seite lädt, aber das Login funktioniert nicht. Zahlungen timeouten bei einem Teil der Nutzer. Ein Hintergrundjob hört auf, E-Mails zu senden. Ohne Monitoring erfahren Sie davon durch wütende Nachrichten, verlorene Umsätze oder einen Kollegen, der sagt: „Irgendetwas fühlt sich langsam an.“

Das Ziel ist kein perfektes Dashboard. Das Ziel ist Frühwarnung. Gutes Monitoring ist leise an guten Tagen und laut an schlechten.

Mindestens sollten Sie wissen:

- Nutzer scheitern (und wie viele)

- Wo es scheitert (welche Seite, Endpoint oder Job)

- Wann es begonnen hat (klarer Zeitstempel und Trend)

- Wer handeln muss (ein Alert, der die richtige Person erreicht)

Wenn Sie nur eine Sache aus dem Monitoring mitnehmen, dann diese: Sie sollten die Frage „Ist das gerade kaputt, und wird es schlimmer?“ in unter einer Minute beantworten können.

Starten Sie klein und verbessern Sie sich jede Woche. Fügen Sie eine Metrik, einen Alert oder ein Log-Detail nach dem anderen hinzu. Wenn Sie eine AI-generierte Codebasis geerbt haben, ist das sogar noch wichtiger. Eine App kann in einer Demo „funktionieren“, während Auth-Flows kaputt sind, Geheimnisse exponiert oder Hintergrundjobs still scheitern.

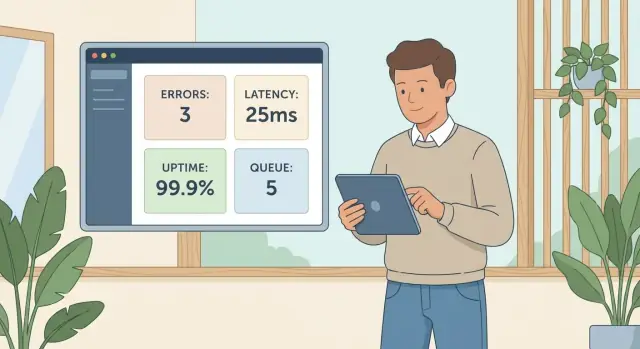

Das Starter-Set: vier Signale, die die meisten Ausfälle auffangen

Die meisten frühen Produktionsvorfälle zeigen sich als eines von vier Problemen: Nutzer bekommen Fehler, Seiten werden langsam, die App ist unerreichbar oder Hintergrundarbeit bleibt stehen.

Ein Starter-Set, das diese Ausfallarten abdeckt:

- Fehler (Rate und Top-Fehlertypen)

- Latenz (wie lange wichtige Requests dauern)

- Uptime (ist die App von außerhalb Ihres Netzwerks erreichbar)

- Queue-Tiefe (stapeln sich Hintergrundjobs)

Diese vier decken sowohl die Haustür als auch den Backroom ab. Fehler und Latenz erfassen, was Nutzer gerade fühlen. Uptime fängt Totalausfälle und offensichtliche Deploy- oder Netzwerkfehler ab. Queue-Tiefe fängt stille Fehler, die erst Stunden später in der UI auftauchen.

Auf Nutzerproblem gemappt:

- Fehler: „Ich kann mich nicht einloggen“ oder „Checkout fehlgeschlagen.“

- Latenz: „Es lädt ewig“, obwohl es technisch funktioniert.

- Uptime: „Die Seite ist down.“

- Queue-Tiefe: „Mein Bericht ist nie angekommen“ oder „E-Mails werden nicht mehr gesendet.“

Logs und Tracing sind großartig zur Diagnose, aber sie sind schwerer sinnvoll zu alerten, wenn Sie anfangen. Metriken plus einfache Alerts bringen Sie meist am schnellsten zu „etwas stimmt nicht“.

Fehler: der schnellste Weg zu wissen, dass Nutzer blockiert sind

Wenn Sie nur eine Sache zuerst tracken, dann Fehler. Sie sind das klarste Signal dafür, dass echte Menschen eine Aufgabe nicht abschließen können.

Starten Sie mit zwei Zahlen:

- Fehlerquote: der Prozentanteil der Requests, die fehlschlagen

- Fehleranzahl: wie viele Fehler passiert sind

Die Quote zeigt die Auswirkung. Die Anzahl zeigt das Volumen. Eine kleine Fehlerquote kann trotzdem schaden, wenn der Traffic hoch ist.

Teilen Sie Fehler früh in Client vs Server auf:

- 4xx (Client-Fehler) bedeuten oft falsche Eingaben, abgelaufene Sessions oder Routen, die nicht mehr existieren.

- 5xx (Server-Fehler) bedeuten normalerweise, dass Ihr System versagt hat: abgestürzte API, kaputte Query, fehlerhaftes Deployment, Misconfig.

Sie brauchen am ersten Tag keine perfekte Kennzeichnung, aber diese Trennung macht die Triage schneller.

Alerts sollten auf Mustern, nicht auf einzelnen Ereignissen basieren. Ein einmaliger 500er kann Rauschen sein. Ein Spike oder anhaltend erhöhte Rate ist ein Feuer.

Ein praktisches Starter-Set:

- Plötzlicher Spike: Fehlerquote springt über die Baseline für 5–10 Minuten

- Andauerndes Problem: Fehlerquote bleibt 15–30 Minuten über einem Schwellenwert

- 5xx-fokussiert: Alarm bei Server-Fehlern, auch wenn die Gesamtfehler niedrig sind

Fügen Sie einen „Money Path“-Alert für den Flow hinzu, der am wichtigsten ist: Login, Signup oder Checkout. Wenn Login-500s nach einem Release von 0.1% auf 5% steigen, wollen Sie das wissen, bevor Kunden Ihnen schreiben.

Latenz: erkennen Sie Verzögerungen, bevor Support-Tickets entstehen

Latenz ist, wie lange ein Nutzer wartet, nachdem er klickt, tippt oder aktualisiert. Selbst wenn Ihre App „up“ ist, fühlt sich hohe Latenz wie ein Fehler an. Leute brechen ab, versuchen es erneut oder denken, ihr Konto sei gesperrt.

Zwei Zahlen erzählen die klare Geschichte:

- p50: die typische Erfahrung

- p95: die „häufigen Ausreißer“-Erfahrung

Wenn p50 in Ordnung, aber p95 stark steigt, ist die Mehrheit der Nutzer okay, aber ein spürbarer Teil wartet lange. Das sind die Leute, die Tickets schreiben.

Überwachen Sie nicht jeden Route am ersten Tag. Segmentieren Sie Latenz nach Aktionen, die für das Geschäft am wichtigsten sind. Eine langsame Einstellungsseite ist nervig. Ein langsames Login stoppt Wachstum.

Gängige Startpunkte:

- Login und Signup

- Checkout oder Zahlungsbestätigung

- Suche und Ergebnisseiten

- Jede „Create“-Aktion (neue Bestellung, neues Ticket, neuer Post)

Alerts funktionieren am besten, wenn sie eine Änderung erkennen, nicht einen einzelnen schlechten Moment. Eine einfache Regel: Alarmieren, wenn p95 deutlich über dem Normalwert steigt oder lange hoch bleibt, sodass Nutzer es fühlen.

Ein nützliches Startset:

- p95-Latenz ist 2x Baseline für 10 Minuten

- p95 überschreitet ein hartes Limit (z. B. 2–3 Sekunden) für 5–10 Minuten

- p50 steigt über 15 Minuten (oft Kapazitäts- oder DB-Probleme)

- p95 spike nur auf einem Endpoint (oft ein Codepfad oder externes API-Problem)

Beispiel: Die Homepage lädt noch schnell, aber p95 für Ihr Login-Endpoint steigt nach einem Deploy von 400ms auf 4s. In einem schnellen Test merken Sie das vielleicht nicht, neue Nutzer aber schon.

Uptime: bestätigen Sie, dass die App von außen erreichbar ist

Uptime beantwortet eine Frage: Kann ein echter Nutzer Ihre App gerade erreichen? Sie fängt Totalausfälle, schlechtes DNS, abgelaufene SSL oder ein fehlgeschlagenes Deployment ein.

Uptime bedeutet nicht, dass Ihr Produkt funktioniert. Sie können 200 OK zurückgeben, während Login kaputt ist, Zahlungen fehlschlagen oder die Seite leer ist, weil ein Script abgestürzt ist. Behandeln Sie Uptime als Rauchmelder, nicht als tiefergehende Untersuchung.

Verwenden Sie einen externen Check, der von außerhalb Ihrer Infrastruktur läuft – so wie Kunden sich verbinden. Er kann Ihre Homepage, einen leichten Health-Endpoint oder eine einfache Ping-Route treffen, die bestätigt, dass der App-Server schnell antwortet.

Um Rauschen zu vermeiden, alarmieren Sie bei aufeinanderfolgenden Fehlern, nicht bei einem einzelnen Ausrutscher.

Ein Starter-Setup:

- Prüfen alle 1–5 Minuten von mindestens 2 Standorten

- Alarm nach 2–3 aufeinanderfolgenden Fehlern

- Benachrichtigen Sie zuerst einen Menschen (Push oder SMS), dann eskalieren, wenn nicht bestätigt

- Fügen Sie die fehlerhafte URL, den Statuscode und die Antwortzeit in den Alert ein

Planen Sie auch geplante Ausfallzeiten ein. Pausieren Sie Alerts oder markieren Sie das Fenster, damit Sie nicht wegen erwarteter Ausfälle panicen.

Beispiel: Sie pushen einen Freitag-Hotfix und Ihre Reverse-Proxy-Konfiguration ist falsch. Die App läuft zwar, ist aber für das öffentliche Internet nicht erreichbar. Ein externer Uptime-Check fängt das innerhalb weniger Minuten.

Queue-Tiefe: erkennen Sie Hintergrundjobs, die stillstehen

Einige der schmerzhaftesten Fehler zeigen sich nicht als klarer Fehler. Sie zeigen sich, weil Arbeit im Hintergrund liegt: Passwort-Reset-E-Mails, Dateiimporte, Payment-Webhooks, Verarbeitungsjobs, nächtliche Reports. Die UI sieht gut aus, während Kunden Stunden warten.

Queue-Tiefe ist, wie viel Arbeit gewartet wird. Tracken Sie auch das Job-Alter (wie lange der älteste Job schon wartet). Tiefe zeigt Volumen. Alter zeigt Nutzer-Auswirkung.

Was zu tracken ist

Halten Sie es klein und sichtbar:

- Queue-Größe (ausstehende Jobs)

- Alter des ältesten Jobs (Zeit seit dem Einreihen)

- Verarbeitungsrate (abgeschlossene Jobs pro Minute), falls verfügbar

Alerts, die Probleme früh erwischen

Starten Sie mit Schwellenwerten, die Sie später verfeinern können:

- Queue-Größe bleibt 10 Minuten über 100

- Alter des ältesten Jobs überschreitet 5 Minuten (Warnung) oder 15 Minuten (dringend)

- Queue-Größe steigt 15 Minuten lang, während der Traffic normal ist

Wenn Sie mehrere Queues laufen haben (E-Mails vs Importe), alarmieren Sie pro Queue. Ein feststeckender Worker sollte nicht von einer anderen, gesunden Queue verdeckt werden.

Wenn Tiefe oder Alter steigen, liegt die Ursache oft an einem dieser Punkte: ein Worker-Prozess ist down, ein Retry-Loop fügt denselben fehlerhaften Job immer wieder hinzu, oder eine Abhängigkeit ist langsam (E-Mail-Provider, DB, Drittanbieter-API).

Beispiel: „E-Mails wurden nicht mehr gesendet.“ Uptime sieht gut aus. Aber das Queue-Alter steigt auf 40 Minuten, weil der Worker nach einem Deploy abgestürzt ist. Ein Queue-Age-Alert hätte das gefangen, bevor Kunden nach dem Reset-Link fragen.

Wie Sie Ihre ersten Alerts in 60 Minuten einrichten (Schritt für Schritt)

Sie brauchen am ersten Tag kein komplexes Setup. Der schnellste Gewinn ist ein kleines Set von Alerts, das an echten Nutzeraktionen hängt.

Schritt 1: Schreiben Sie die Aktionen auf, die Ihnen Geld bringen

Wählen Sie 3–5 Kernaktionen. Wenn eine davon kaputtgeht, sind Nutzer schnell blockiert.

- Sign up

- Log in

- Checkout starten oder zahlen

- Das Hauptobjekt in Ihrer App erstellen (Project, Order, Post)

- Export, Invite oder Share

Schritt 2: Fügen Sie pro Aktion eine Metrik und einen Alert hinzu

Halten Sie es minimal: eine Metrik, die zeigt, dass die Aktion fehlschlägt, und einen Alert, den Sie wirklich sehen.

- Für Signup und Login: alerten Sie bei Fehlerquote (oder fehlgeschlagenen Requests) über ein kurzes Fenster.

- Für Zahlungen: alerten Sie bei Spike in 4xx und 5xx sowie bei Latenz (langsame Zahlungen schlagen oft still fehl).

- Für Create/Export: alerten Sie bei Hintergrundjob-Fehlern oder Queue-Problemen, wenn es asynchron läuft.

Schritt 3: Setzen Sie Schwellen auf Basis normalen Verhaltens

Nutzen Sie die letzten Tage normalen Verhaltens. Wenn Login-Fehler normalerweise nahe null sind, fängt ein Schwellenwert wie „mehr als 5 Fehler in 5 Minuten“ oft echte Probleme ohne viel Rauschen. Für Latenz starten Sie mit „2x langsamer als üblich“ statt nach der perfekten Zahl zu suchen.

Schritt 4: Senden Sie Alerts dorthin, wo Sie sie wirklich sehen

Ein Alert, der im Dashboard verstaubt, ist kein Alert. Leiten Sie ihn an Team-Chat, Telefonbenachrichtigungen oder das, was Sie tagsüber prüfen.

Schritt 5: Wöchentlich prüfen und anpassen

Einmal pro Woche schauen Sie, was ausgelöst wurde.

- Wenn ein Alert laut ist, erhöhen Sie den Schwellenwert oder fügen Sie eine Dauerbedingung hinzu (erst alerten, wenn es 10 Minuten andauert).

- Wenn Sie einen Vorfall verpasst haben, senken Sie den Schwellenwert oder fügen Sie einen flow-spezifischen Alert hinzu.

Häufige Fehler, die Monitoring nutzlos machen

Der schnellste Weg, Monitoring zu verschwenden, ist, es wie eine Checkbox zu behandeln. Monitoring geht weniger um schicke Dashboards und mehr darum, ein paar klare Signale zu bekommen, die zu einer Handlung führen.

Alert-Fatigue

Wenn Ihr Handy bei jedem kleinen Spike vibriert, fangen Sie an, alles zu ignorieren. Setzen Sie Schwellen so, dass Alerts „jemand ist wahrscheinlich blockiert“ oder „das wird bald für Nutzer sichtbar“ bedeuten – nicht „ein Graph hat sich bewegt“.

Nur Uptime überwachen

Ihre App kann „up“ sein, während der wichtigste Flow kaputt ist (Login, Checkout, Passwort-Reset). Wenn Sie nur einen Uptime-Ping haben, denken Sie, alles sei in Ordnung, während Kunden vor einem drehenden Button starren.

Alerts ohne nächsten Schritt

Alerts sollten auf eine nächste Aktion verweisen, nicht nur eine beängstigende Zahl.

- Weisen Sie für jeden Alert einen Owner zu (auch wenn es „on-call diese Woche“ ist).

- Geben Sie Kontext: Endpoint, Zeitfenster, wie schlimm es ist.

- Fügen Sie Deploy-Kontext hinzu: „neues Release vor 12 Minuten“ ändert die Reaktion.

- Halten Sie eine einzeilige Playbook-Anweisung: „Wenn 500s spike, roll back und Auth-Logs prüfen.“

Queue-Größe beobachten, aber Queue-Alter ignorieren

Eine kleine Queue kann trotzdem kaputt sein, wenn der älteste Job 20 Minuten wartet. Größe zeigt Volumen. Alter zeigt, ob Arbeit vorankommt.

Beispiel: Ihr Worker verliert nach einer Credential-Änderung DB-Zugriff. Die Queue-Länge bleibt flach, weil Jobs schnell fehlschlagen und retryen, aber das Queue-Alter steigt und Nutzer sehen „Bericht wird per E-Mail zugeschickt“ für immer. Wenn Sie auf Alter (und Retries) alerten, fangen Sie es früh.

Schnelle Checkliste: Sind Sie für den nächsten Vorfall abgedeckt?

Wenn Sie diese Woche sonst nichts tun, stellen Sie sicher, dass Sie eine Frage schnell beantworten können: „Sind Nutzer gerade blockiert?“

Wählen Sie Ziele, die zu Ihrer App heute passen, und verschärfen Sie sie später.

- Fehler: Ein Alert für anhaltende 5xx und ein klares „das ist schlimm“-Schwellenwert für Ihren Hauptflow (z. B. >1% für 5 Minuten).

- Latenz: p95-Antwortzeit für 2–3 Schlüsselendpunkte (Login, Checkout, Suche oder Ihre Haupt-API) mit einem für Nutzer tolerierbaren Ziel (z. B. p95 >1,5s für 10 Minuten).

- Uptime: Ein externer Check, der nur nach aufeinanderfolgenden Fehlern alarmiert (z. B. 3 Fehler in Folge).

- Queue-Gesundheit: Sichtbarkeit, ob Jobs mithalten. Alert bei Queue-Alter und bei langanhaltendem Anstieg der Tiefe.

- Menschen/Prozess: Eine Person ist verantwortlich, wenn ein Alert feuert, mit einfachem Eskalationspfad.

Ein schneller Realitätscheck: Bitten Sie eine(n) Freund(in), Ihre App vom Handy aus zu nutzen und die Hauptaktion zu testen. Wenn sie fehlschlägt, würden Ihre Alerts Sie innerhalb von 5 Minuten informieren? Wüssten Sie, ob es Fehler, Langsamkeit, Erreichbarkeit oder feststeckende Jobs sind?

Beispiel: Ein kaputtes Login erwischen, bevor Kunden es melden

Sie schicken eine kleine Änderung am Freitagnachmittag: eine Anpassung an Signup- und Login-Bildschirmen. Im schnellen Test sieht alles gut aus. Für einige Nutzer schlägt das Login aber fehl, obwohl das Passwort korrekt ist.

Innerhalb von Minuten bewegen sich zwei Signale, die schwer zu übersehen sind:

- Fehler spike auf dem Auth-Endpoint.

- Gleichzeitig steigt die Latenz, weil das Backend einen DB-Call (oder einen externen Auth-Check) erneut versucht, bevor es fehlschlägt.

Wenn Ihre Alerts Zeitfenster und Deploy-Kontext einschließen, können Sie das mit Ihrem Release abgleichen und schnell entscheiden.

Eine saubere Reaktion sieht so aus:

- Rollback des letzten Deploys

- Bestätigen, dass Fehler wieder auf normales Niveau fallen

- Bei Zeit neu deployen mit einer sichereren Fixvariante

Danach fügen Sie zwei gezielte Alerts für den Login-Flow hinzu:

- Alert, wenn die Fehlerquote des Login-Endpunkts einen kleinen Schwellenwert für 5 Minuten überschreitet.

- Separater Alert, wenn dessen Latenz relativ zur Baseline stark steigt.

Das ist auch ein Bereich, in dem AI-generierter Code Sie ausbremsen kann. Sie finden womöglich einen Login-Aufruf, der drei verschiedene Auth-Helper, kopierte Middleware und eine halb-fertige Retry-Schleife berührt. Die Symptome zeigen sich als Fehler und Langsamkeit, während die eigentliche Ursache im unordentlichen Kontrollfluss liegt.

Nächste Schritte: klein anfangen, dann Ursachen beheben

Starten Sie mit einem winzigen Set an Signalen und lassen Sie echte Vorfälle entscheiden, was Sie ergänzen. Das Ziel ist nicht „perfekte Abdeckung“, sondern Ausfälle früh zu bemerken und eine klare nächste Aktion zu haben.

Beginnen Sie mit den vier Signalen (Fehler, Latenz, Uptime, Queue-Tiefe). Lassen Sie sie ein bis zwei Wochen laufen. Wenn etwas schiefgeht, widerstehen Sie der Versuchung, fünf neue Alerts hinzuzufügen. Schreiben Sie auf, was passiert ist und was es früher klarer gemacht hätte.

Eine kurze Incident-Notiz reicht aus:

- Was Nutzer gesehen haben und wann es begann

- Was sich vor dem Ausfall geändert hat (Deploy, Config, Drittanbieter-Ausfall)

- Der Fix, den Sie ausgerollt haben (oder das Rollback)

- Ein Präventionsschritt (Test, Guardrail, Alert-Anpassung, fehlendes Log)

Fügen Sie nur dann einen neuen Alert hinzu, wenn Sie beantworten können: „Wenn das feuert, wer macht in den nächsten 10 Minuten was?“ Wenn die Antwort „erst mal untersuchen“ ist, gehört es ins Dashboard, nicht aufs Pager.

Wenn Alerts immer wieder auf dieselben Fehler zeigen (Login bricht nach kleinen Änderungen, Geheimnisse werden in Logs geleakt, Hintergrundjobs häufen sich nachts), ist das meist ein Codebasis-Problem, kein Monitoring-Problem. Wenn Sie eine AI-generierte App von Tools wie Lovable, Bolt, v0, Cursor oder Replit geerbt haben und sie sich in Produktion anders verhält als in Demos, kann ein gezieltes Audit viel Rätselraten sparen. FixMyMess (fixmymess.ai) führt Codebase-Diagnose und Reparatur genau für diese Situation durch, inklusive Security-Härtung und Deployment-Vorbereitung.

Häufige Fragen

What’s the minimum monitoring I should set up first?

Beginnen Sie mit dem kleinstmöglichen Set, das Ihnen sagt, ob reale Nutzer blockiert sind: Fehlerquote, Latenz (p95), externe Uptime-Checks und Queue-Gesundheit (Tiefe und Alter). Diese Kombination fängt die meisten frühen Zwischenfälle ab, ohne Sie in Daten zu ertränken.

Why do apps feel “fine” in a quick test but break for users?

Weil die meisten Fehler partiell sind. Die Seite kann laden, während das Login fehlschlägt, bei manchen Nutzern der Checkout ausfällt oder Hintergrundjobs stillstehen. Monitoring gibt Frühwarnungen, damit Sie Probleme nicht erst durch wütende Nachrichten oder entgangene Umsätze erfahren.

Should I watch error rate or error count?

Verfolgen Sie beides: Fehlerquote (Prozent der fehlgeschlagenen Requests) und Fehleranzahl (wie viele Fehler insgesamt). Die Quote zeigt die Auswirkung, die Anzahl das Volumen. Eine niedrige Quote kann trotzdem schmerzhaft sein, wenn viel Traffic da ist.

How do I quickly tell if errors are “our fault” or user behavior?

Teilen Sie Fehler früh in 4xx und 5xx auf. 4xx deutet meist auf Client-Probleme hin (falsche Eingaben, abgelaufene Sessions), 5xx bedeutet meistens, dass Ihr System versagt hat (kaputter API, fehlerhafte Query, Deployment-Problem). Diese einfache Trennung beschleunigt die Triage.

What’s a practical way to set error alerts without constant noise?

Alarmieren Sie nach Mustern, nicht nach Einzelereignissen. Ein einmaliger 500er ist oft Rauschen. Ein anhaltend erhöhter Fehleranteil oder ein plötzlicher Spike über 5–10 Minuten ist in der Regel ein echter Vorfall. Fügen Sie einen flow-spezifischen Alarm für Ihren wichtigsten Pfad (Login, Signup, Checkout) hinzu.

Which latency numbers matter most (p50 vs p95)?

Beobachten Sie p50 und p95. p50 zeigt die typische Erfahrung, p95 die „häufigen Ausreißer“, die zu Beschwerden führen. Wenn p50 okay ist, aber p95 steigt, sitzen bemerkbar viele Nutzer lange fest, obwohl die App technisch funktioniert.

Isn’t an uptime check enough?

Betrachten Sie Uptime wie einen Rauchmelder: Sie zeigt, ob die App von außen erreichbar ist, aber nicht, ob Kernabläufe funktionieren. Sie können 200 OK zurückgeben, während Login oder Checkout kaputt sind. Kombinieren Sie Uptime-Checks mit flow-spezifischen Fehler- und Latenz-Alerts, um partielle Ausfälle zu erfassen.

What’s the difference between queue depth and queue age?

Queue-Tiefe ist wie viele Jobs warten, Queue-Alter ist wie lange der älteste Job schon hängt. Tiefe zeigt Volumen, Alter zeigt Nutzerwirkung. Eine kleine Queue kann trotzdem kaputt sein, wenn der älteste Job seit langer Zeit wartet.

How can I set up my first useful alerts in about an hour?

Wählen Sie 3–5 Aktionen, die Ihnen Geld einbringen (Login, Signup, Checkout, Create/Export). Für jede Aktion fügen Sie eine Metrik hinzu, die Ausfall zeigt (Fehler oder Queue-Gesundheit), und einen Alarm, den Sie auch wirklich sehen. Nutzen Sie das letzte normale Verhalten als Basis und justieren Sie wöchentlich.

What if I inherited an AI-generated codebase and incidents keep repeating?

AI-generierte Apps verhalten sich in Produktion oft anders als in Demos: unordentlicher Kontrollfluss, versteckte Retry-Loops, kaputte Auth-Helpers oder Geheimnisse/Config-Probleme. Wenn wiederkehrende Probleme wie kaputtes Login oder hängende Jobs auftreten, kann FixMyMess eine kostenlose Code-Audit durchführen und den Code reparieren und härten.