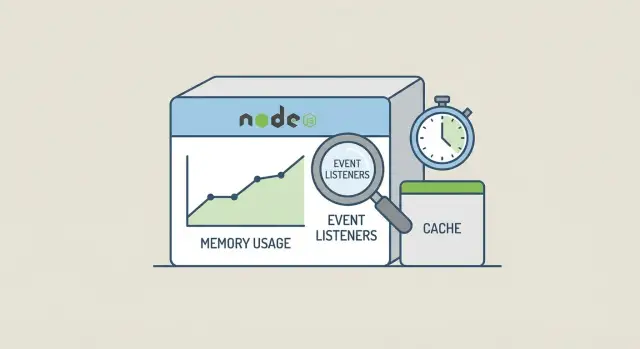

Node.js-Speicherleck: ausufernde Listener, Caches und Timer finden

Finde ein Node.js-Speicherleck, indem du ausufernde Listener, Caches und Timer entdeckst, und belege die Behebung mit Heap-Snapshots und wiederholbaren Tests.

Wie sich ein Speicherleck in einer Node.js-App zeigt

Ein Node.js-Speicherleck liegt vor, wenn deine App Speicher behält, den sie nicht mehr braucht. Entscheidend ist, dass der Speicherverbrauch über die Zeit ansteigt und nie vollständig zurückfällt, auch nachdem die Arbeit, die den Peak ausgelöst hat, abgeschlossen ist.

In Produktion zeigt sich das oft als schleichender Anstieg: Minuten oder Stunden läuft alles noch, dann werden Antworten langsamer, der Prozess führt häufiger Garbage Collection durch, und schließlich startet die App neu oder stürzt mit einem Out-of-Memory-Fehler ab. Bei einfachen Metriken siehst du eventuell, dass RSS und Heap über Deploys, Traffic-Zyklen oder Hintergrundjobs hinweg nach oben tendieren.

Typische Anzeichen sind:

- Memory steigt nach jeder Anfrage oder Joblauf

- GC-Pausen werden länger und häufiger

- Neustarts werden vorhersehbar (zum Beispiel jede Nacht nach einem Batch)

- Container erreichen Memory-Limits selbst bei normalem Traffic

- Die App wird langsamer, ohne offensichtlichen CPU-Anstieg

Nicht alles, was ansteigt, ist ein Leak. Manches Wachstum ist normal: ein aufwärmender Cache, ein einmaliger Kompilierungsschritt oder ein Traffic-Burst, der nachlässt. Manche „Lecks“ sind eigentlich beabsichtigtes Caching ohne ausreichende Limits. Der Unterschied ist, ob sich die Speicherstände stabilisieren. Eine gesunde App kann hochspringen und dann um eine Basislinie schwanken. Eine leaky App setzt kontinuierlich neue Basislinien.

Ein einfaches Beispiel: ein Prototyp fügt bei jeder Anfrage einen Event-Listener hinzu, entfernt ihn aber nie. Jede Anfrage „endet“, aber der Listener hält weiterhin Referenzen auf Daten dieser Anfrage. Der Speicher steigt Schritt für Schritt, bis es kritisch wird.

Um Leaks ohne Raten zu beheben, brauchst du zwei Dinge: eine wiederholbare Art, das Wachstum auszulösen, und eine Möglichkeit, zu beweisen, dass der Fix wirkt. Dieser Beweis sieht normalerweise so aus: der Speicher flacht ab und Heap-Snapshots zeigen, dass die ehemals wachsenden Objekte nicht mehr wachsen.

Schnelle Eingrenzung: bestätige, dass du das richtige Problem verfolgst

Bevor du nach einem Node.js-Speicherleck suchst, stell sicher, dass die App tatsächlich leakt (Speicher steigt und bleibt hoch) und nicht nur einen temporären Spike verarbeitet (Speicher steigt und fällt nach GC wieder).

Fange an, mehrere Zahlen gleichzeitig zu beobachten. Eine einzelne Metrik kann irreführen, besonders in Prototyp-Code, in dem „Quick Fixes“ oft die eigentliche Ursache verbergen.

- Prozessspeicher (RSS): gesamter Speicher laut OS für den Prozess.

- Heap used: JavaScript-Objekte, die von V8 verwaltet werden.

- Event-Loop-Latenz: steigt sie, hängt die App oder macht GC Probleme.

- Request-Latenz: Leaks zeigen sich oft als langsamere Antworten über die Zeit.

- Fehlerquote / Timeouts: ein „Leak“ kann auch Retry-Stürme oder hängende Background-Jobs sein.

Unterscheide anschließend auf hoher Ebene zwischen „Heap-Wachstum“ und „nativem Speicher“-Wachstum. Wenn Heap used über mehrere Minuten bei gleichbleibender Last weiter ansteigt, hältst du wahrscheinlich JS-Objekte (Listener, Caches, Closures, Arrays, Maps) zurück. Wenn RSS wächst, aber Heap used weitgehend stabil bleibt, dann vermute Speicher außerhalb des JS-Heaps: große Buffers, Streams, die nicht geschlossen werden, native Add-ons oder eine Logging-/Metrik-Library, die Daten behält.

Prototyp-zu-Production-Leaks kommen meist von ein paar Gewohnheiten: globale Singletons, die Zustand anhäufen, Caches ohne Größenlimit, Event-Listener, die pro Request hinzugefügt werden, und Timer, die ohne Abbruch weiterlaufen. Diese Muster tauchen oft in von AI-Tools generiertem Code auf, wo etwas einmal „funktioniert“, aber keine Cleanups vorhanden sind.

Setze dir ein einfaches Ziel, bevor du Code änderst: reproduziere das Wachstum in Minuten, nicht Tagen. Wähle eine Route oder einen Job, der das Problem auslöst, wende gleichmäßigen Load an und definiere „Erfolg“ so: nach Teststart steigt der Speicher in einem wiederholbaren Muster (zum Beispiel +20 MB alle 2 Minuten). Sobald du das hast, kannst du den Fix später beweisen.

Wenn du einen chaotischen Prototyp geerbt hast und nicht einmal stabile Messungen bekommst, ist genau das der Punkt, an dem ein kurzer Audit (wie ihn FixMyMess anbietet) die größten Retentionsrisiken aufdeckt, bevor du die halbe App neu schreibst.

Mach das Leak reproduzierbar, bevor du am Code drehst

Ein Node.js-Speicherleck ist schwer zu fixen, wenn es nur „manchmal“ auftritt. Bevor du etwas änderst, verwandle das Problem in eine wiederholbare Aktion, die Speicher auf Kommando steigern lässt.

Wähle eine Ursache, die der realen Nutzung entspricht. Gute Kandidaten sind eine einzelne HTTP-Route, ein Tick eines Hintergrundjobs, ein WebSocket-Connect-/Disconnect-Zyklus oder eine Import-Aufgabe. Nimm die kleinste Aktion, die den Anstieg noch verursacht.

Wiederhole diesen Trigger in einer Schleife. Manuell geht es (die gleiche Seite 50x neu laden), aber ein kleines Script ist besser, weil es menschliche Variation eliminiert. Es geht nicht um Lasttests, sondern um Konsistenz.

Halte die Variablen stabil während du reproduzierst:

- Benutze denselben Nutzeraccount und dieselben Berechtigungen bei jedem Lauf

- Benutze dieselbe Eingabegröße (gleiches Payload, gleiche Anzahl Datensätze)

- Dieselbe Umgebung (lokal oder staging, nicht gemischt)

- Starte die App zwischen Experimenten neu, damit du mit sauberer Basis beginnst

- Schalte irrelevanten Traffic aus, damit Hintergrundrauschen das Muster nicht überdeckt

Definiere ein klares Bestehen/Nicht-Bestehen-Metrik. Eine einfache ist: nachdem die Schleife stoppt und du während des Tests eine Garbage Collection erzwingst, sollte der Heap nahe an die Basis zurückkehren. Wenn er Lauf für Lauf weiter steigt, hast du einen verlässlichen Repro.

Konkretes Beispiel: Memory wächst, wenn Nutzer einen „Live-Updates“-Screen öffnen. Baue eine Schleife, die sich per WebSocket verbindet, 3 Sekunden wartet, dann trennt, und das 200-mal wiederholt. Wenn der Heap mit jedem Connect-Zyklus wächst, hast du den Leak auf Listener, Timer oder pro-Verbindung Caches eingegrenzt.

Auch hier scheitern Prototyp-Apps häufig. Wurde dein Code von Tools wie Replit, v0 oder Cursor generiert und das Leak ist schwer reproduzierbar, kann FixMyMess in einem kurzen Audit die eine Aktion isolieren, die das Wachstum zuverlässig auslöst, bevor du Stunden mit Raten verbringst.

Heap-Snapshots: das Werkzeug, das Leaks sichtbar macht

Ein Heap-Snapshot ist ein Abbild der Objekte, die dein Node.js-Prozess in einem Moment im Speicher hält. Er zeigt, wie viele Objekte existieren, wie groß sie sind und was sie am Leben hält. Bei Node.js-Speicherlecks ist das oft der schnellste Weg, das Rätsel zu lösen.

Was er dir sagen kann: welche Objekttypen wachsen (Arrays, Maps, Strings, Closures) und die Pfade, die diese Objekte erreichbar halten. Was er nicht sagen kann: die exakte Codezeile, die das Objekt erzeugt hat, oder ob ein kurzfristiger Spike an sich „schädlich“ ist. Du brauchst immer noch einen reproduzierbaren Test und etwas Detektivarbeit.

Ein Schlüsselkonzept bei Snapshots sind Retainer. Ein Objekt wird nicht garbage-collected, wenn etwas noch darauf verweist. Retainer sind die Kette von Referenzen, die ein Objekt am Leben halten, zum Beispiel: ein globales Singleton enthält eine Map, die Map enthält Request-Payloads, und diese Payloads enthalten große Strings. Das „Leak“ ist meist nicht das sichtbare Objekt, sondern der Retainer, der eigentlich gelöscht werden sollte.

Plane, drei Snapshots zu machen, damit du vergleichen kannst, was über die Zeit wächst:

- Basis: direkt nach dem Start, vor der Last

- Snapshot 2: nach einer bekannten Lastmenge (z. B. 200 Requests)

- Snapshot 3: nach mehr derselben Last (z. B. 600 Requests)

Wenn dieselben Objektgruppen von Snapshot 2 zu Snapshot 3 zunehmen, ist das ein starkes Signal. Wenn der Speicher steigt, aber die Objektanzahlen stabil bleiben, könnte es an Buffers, nativen Add-ons oder normalem Caching liegen.

Datenschutz ist wichtig. Heap-Snapshots können Nutzerdaten, Tokens, Cookies, Request-Payloads und sogar exponierte Geheimnisse enthalten, die Prototypen manchmal im Speicher haben. Behandle Snapshots wie Produktionsdaten: sicher speichern, sparsam teilen und löschen, wenn du fertig bist.

Schritt-für-Schritt: Snapshots erfassen und vergleichen, um Wachstumsquellen zu finden

Wenn du ein Node.js-Speicherleck vermutest, sind Heap-Snapshots der schnellste Weg, mit dem Raten aufzuhören. Der Trick ist, Snapshots um eine wiederholte Aktion herum zu nehmen, sodass du siehst, was bei jeder Wiederholung wächst.

1) Drei Snapshots um dieselbe Aktion erfassen

Starte deine App so, dass du Heap-Snapshots erstellen kannst (zum Beispiel über den Debugger oder Inspector). Wiederhole dann eine Nutzeraktion, die das Leak auslöst (eine Anfrage, ein Seitenaufruf, einen Hintergrundjoblauf).

Nutze diesen Rhythmus:

- Snapshot A: Basis nehmen, wenn die App „stabil“ ist

- Führe dieselbe Aktion N-mal aus (anfangs 20–50)

- Snapshot B: zweiten Snapshot sofort danach nehmen

- Führe dieselbe Aktion N-mal erneut aus

- Snapshot C: dritten Snapshot nehmen

Wenn Snapshot B größer ist als A und C größer als B um einen ähnlichen Betrag, ist das ein starker Hinweis auf ein Leak pro Iteration.

2) Snapshots vergleichen und den Retentionspfad verfolgen

Öffne die Vergleichsansicht zwischen A und B (und dann zwischen B und C). Konzentriere dich auf Objekttypen, die zunehmen, nicht auf einmalige Peaks.

Achte auf:

- Konstruktor-Namen, die steigen (zum Beispiel: Array, Map, Listener, Timeout, Buffer)

- Sammlungen, die wachsen (Map-Einträge, Set-Items, gecachte Objekte)

- Abgetrennte oder „unreachable“ wirkende Objekte, die trotzdem retained sind

- Den Retentionspfad (was hält das Objekt im Speicher)

Der Retentionspfad ist der entscheidende Punkt. Oft zeigt er auf ein globales Singleton, ein Module-Level-Cache, einen Event-Emitter oder eine Timer-Liste.

3) Notiere, was du siehst, bevor du Code änderst

Mach dir beim Inspizieren kurze Notizen, damit du den Faden nicht verlierst:

- Die 2–3 am stärksten wachsenden Konstruktor-Namen

- Die retaining root (global, Module-Export, Request-Handler-Closure)

- Dateiname- oder Modulhinweise aus dem Snapshot

- Grobe Wachstumsrate (zum Beispiel: +500 Objekte pro 50 Requests)

Diese kurze Liste macht den Fix fokussiert. Sie ist auch dieselbe Evidenz, die Teams wie FixMyMess in einer kostenlosen Prüfung nutzen, um festzustellen, ob das Leak von Listenern, Caches oder Timern stammt, bevor sie am Code drehen.

Ausufernde Event-Listener: das häufigste Prototyp-Leak

Ein klassisches Node.js-Speicherleck im Prototyp ist simpel: ein Listener wird immer wieder hinzugefügt, aber nie entfernt. Der Speicher wächst langsam, bis der Prozess zu pausieren, Timeouts zu verursachen oder abzustürzen beginnt.

Das passiert oft, wenn eine „Setup“-Funktion bei jeder Anfrage, jedem Reconnect oder Job läuft und emitter.on(...) aufruft, ohne zu prüfen, ob bereits ein Abo besteht. Jeder neue Listener kann zusätzliche Daten am Leben halten, besonders wenn der Handler über Request-Objekte, Nutzerdaten oder große Buffers schließt.

Häufige Orte:

EventEmitter-Instanzen, die als globale Busse verwendet werden- WebSocket-Verbindungen, die reconnecten und neu subscriben

- HTTP-Streams, bei denen

data- underror-Handler sich anhäufen - Datenbankclients, die bei jeder Query Listener anhängen

process-Events wieuncaughtExceptionoderSIGTERM, die mehrfach registriert werden

Heap-Snapshots können dieses Muster aufdecken. Suche nach einer wachsenden Anzahl von Funktionen in Listener-Arrays (häufig an einem Emitter) oder vielen ähnlichen Closures, die dieselben äußeren Variablen referenzieren. Ein starkes Indiz ist, wenn retained Objekte wie Request-/Response-Daten an einer Listener-Funktion oder deren Closure hängen.

Konkretes Beispiel: Eine Express-Route ruft subscribeToUpdates(userId) bei jeder Anfrage auf, und diese Funktion fügt ws.on('message', ...) hinzu. Wenn beim Ende der Anfrage oder beim Disconnect nicht unsubscribed wird, hält der WebSocket alte Handler und deren erfasste Daten fest.

Fixes sind meist unspektakulär, aber wirkungsvoll:

- Verwende

oncefür Events, die nur einmal feuern sollen - Rufe

off/removeListenerbei Cleanup (Disconnect, Request-Ende, Job-Finish) auf - Vermeide per-Request-Subscriptions an globalen Emittern; leite Events durch ein scoped Objekt

- Speichere die Handlerfunktion, damit du genau dieselbe Referenz später entfernen kannst

- Bau Guardrails ein: logge

listenerCountund behandle Warnungen als echte Bugs

Wenn du AI-generierten Code geerbt hast, beginnt FixMyMess oft damit, Listener-Lebenszyklen zu kartieren und versteckte „subscribe on every call“-Fallen zu entfernen.

Caches, die nur wachsen: Maps, Memoization und globale Singletons

Viele „Speicherlecks“ in Prototypen sind nicht mysteriöse Bugs, sondern Caches, die nicht loslassen. Bei einer Node.js-Leak-Suche ist das einer der ersten Orte, den man prüft, weil das Problem oft erst bei hohem Traffic oder langer Laufzeit sichtbar wird.

Das klassische Muster ist eine Map oder ein einfaches Objekt als schnelles Lookup ohne Größenlimit und ohne Ablauf. Wenn der Key aus Benutzereingaben (Suchbegriffe, URLs, Header, User-IDs, Prompts) besteht, kann die Anzahl einzigartiger Keys endlos wachsen.

Was du anschauen solltest:

- Alles, das Daten über Anfragen hinweg speichert: Module-Level-Variablen, Singletons oder Utility-Dateien, die einen Cache exportieren

Einige häufige Übeltäter:

- Eine Request-Dedupe-Map (

inFlightRequests.get(key)), die bei Fehlerpfaden nie gelöscht wird - Memoization um teure Funktionen, die nach roher Eingabe keyed ist

- Eine globale „letzte Antworten“-Map für Debugging oder Analytics

- Caches, die komplette Response-Objekte, DB-Rows oder Buffers speichern

- Session-ähnliche Daten im Speicher statt in einem echten Store

Szenario: Du cachest GET /search?q=... nach dem kompletten Query-String. Nach einer Woche hast du hunderttausende einzigartige Queries und jeder Wert enthält ein großes JSON-Payload. Heap-Snapshots zeigen oft eine große Map (oder ein Objekt), das Arrays, Strings und verschachtelte Objekte behält.

Sichere Cache-Patterns:

- Füge eine harte Max-Größe hinzu (evict LRU oder älteste Einträge)

- Ergänze TTL-Expiry und bereinige in regelmäßigen Intervallen, die gestoppt werden können

- Normalisiere Keys (lowercase, trim, Param-Sortierung), um Key-Explosionen zu reduzieren

- Speichere IDs oder kleine Summaries statt ganzer Objekte oder roher Antworten

- Lösche Einträge immer bei Fehlern und Timeout-Pfaden

In AI-generierten Prototypen sind diese Caches oft über Utility-Dateien und Singletons verteilt. FixMyMess findet häufig 2–3 separate wachsende Maps in einem Codebase, die deutlich mehr halten als nötig.

Intervals und Hintergrund-Schleifen, die nie enden

Timer sind eine einfache Quelle für ein Node.js-Speicherleck, besonders in Apps, die als Prototyp gestartet wurden. Der klassische Fehler: ein neues setInterval() (oder verkettetes setTimeout()) wird innerhalb eines Request-Handlers erzeugt und nie gecleart. Jede Anfrage fügt eine weitere Hintergrundschleife hinzu, die Referenzen am Leben hält.

Das passiert oft bei „Quick“-Features: Polling eines Drittanbieter-APIs, Retry verlorener Jobs, Queue-Checks oder Cache-Refreshes. Wenn dieser Code innerhalb einer Route oder pro Nutzer sitzt, schließt der Timer über Request-Daten (User-ID, Auth-Token, Payload) und diese Closure bleibt im Speicher, solange der Timer existiert.

Beispiel: Eine Express-Route /start-sync setzt ein Interval, das alle 2 Sekunden Fortschritt abfragt. Wenn der Nutzer die Seite refreshed oder dieselbe Route zweimal aufruft, hast du zwei Intervalle für denselben Nutzer. Multipliziert mit realem Traffic steigt der Speicher stetig.

Heap-Snapshots geben oft starke Hinweise. Du siehst wachsende Mengen timer-bezogener Objekte und retained Closures, die zurück zu Request- oder Session-Objekten verweisen. Wenn die Snapshot-Vergleiche mehr „listeners“ und Timeout-Objekte nach jedem Testlauf zeigen, wächst die Timer-Liste.

Übliche Fix-Pattern:

- Erstelle geplante Timer einmal beim Start, nicht innerhalb von Routen

- Speicher Timer-IDs und rufe

clearInterval()/clearTimeout()auf, wenn der Job fertig ist - Koppel die Lebensdauer eines Timers an die Verbindung: cancel bei Disconnect, Logout oder wenn ein WebSocket schließt

- Vermeide Duplikate (z. B. ein Interval pro Nutzer oder Workspace)

- Bevorzuge eine einzelne Worker-Schleife, die Jobs aus einer Queue abholt, statt einen Timer pro Request

Nach der Änderung wiederhole denselben Load und erstelle neue Heap-Snapshots. Bei einem echten Fix wachsen timer-bezogene Objekte nicht mehr und der Speicher beginnt sich zu stabilisieren.

Wenn deine App in Tools wie Lovable, Bolt oder Replit generiert wurde und Timer über Routen verteilt sind, kann FixMyMess in einem kurzen Audit genau aufzeigen, wo die Schleifen erzeugt werden und warum sie nie gestoppt werden.

Beweise den Fix: Test erneut laufen lassen und Speicherstabilität bestätigen

Ein echter Fix ändert, was die App im Speicher behält. Ein Workaround ändert nur das, was du bemerkst. Serverneustarts, mehr Container-Memory oder erzwungene GC können Graphen kurzfristig verbessern, aber das Leak bleibt.

Behandle den Beweisschritt wie ein Laborexperiment. Nutze exakt dieselben Reproduktionsschritte, dieselben Datenmengen und Laufzeit-Einstellungen wie zu Beginn.

Erstelle eine neue Reihe Heap-Snapshots: einen beim sauberen Start, einen nachdem das Leak Zeit hatte zu wachsen, und (wenn dein Test einen Cooldown enthält) einen nachdem die Last stoppt. Vergleiche sie mit deinen früheren „vorher“-Snapshots.

Du bist fertig, wenn zwei Dinge zutreffen:

- Die Objekttypen, die früher wuchsen (z. B. Arrays von Listenern, Map-Einträge, gecachte Responses, Timer-Closures) hören auf, zwischen Snapshots zuzunehmen.

- Nachdem die Last endet, steigt und fällt der Heap und legt sich dann auf einem stabilen Bereich fest, statt bei jedem Lauf weiter anzusteigen.

Ein einfaches Beispiel: Du hast entfernt, dass pro Request ein stray setInterval erzeugt wurde. Beim nächsten Lauf sollte Snapshot zwei nicht mehr tausende identischer Interval-Callbacks zeigen, die Request-Daten halten, und Snapshot drei sollte nicht signifikant höher sein als Snapshot zwei.

Wenn das Leak angeblich "gefixt" ist, der Heap aber weiterhin steigt, prüfe, ob du das Wachstum nur verschoben hast. Häufige Maskierungen sind: eine LRU-Cache-Implementierung ohne Größenlimit, oder Listener werden in einem Pfad entfernt, aber nicht bei Fehlern.

Für langfristige Sicherheit füge einen kleinen Regressionscheck vor dem Release hinzu. Kurz und langweilig, aber effektiv:

- Fahre einen kleinen Load-Test für 2–5 Minuten auf einem Staging-Build

- Zeichne Peak RSS/Heap auf und fehlschlage bei Überschreitung einer sinnvollen Schwelle

- Optional: speichere einen Heap-Snapshot-Artefakt und vergleiche Retained-Objektzahlen

Wenn du einen AI-generierten Prototyp geerbt hast, kommen Leaks oft von verknüpftem globalen Zustand, duplizierten Listenern oder Hintergrundjobs, die während des Experimentierens hinzugefügt und nie entfernt wurden. In solchen Fällen ist ein fokussierter Audit plus gezieltes Refactoring meist schneller als Flickwerk. FixMyMess bietet eine kostenlose Code-Prüfung, lokalisiert, was wächst, und hilft, den Prototyp in produktionsreife, verifizierte Fixes zu überführen.

Häufige Fehler, die Stunden kosten

Ein Snapshot allein ist kein Beweis. Eine einzelne Heap-Ansicht kann viele Objekte zeigen, aber nicht, was wächst. Du brauchst mindestens zwei Snapshots, die an denselben Punkten deines Tests aufgenommen wurden, um zu sehen, welche Konstruktoren und Retainer zunehmen.

Rauschen ist der andere Zeitfresser. Wenn du die App mit gemischten Traffic-Mustern triffst (Login, Uploads, Crons, zufällige Seiten), siehst du Wachstum, das schwer zu erklären ist. Halte eine wiederholbare Schleife, die das vermutete Leak auslöst, und ändere dann nur eine Sache auf einmal.

Es ist auch leicht, GC die Schuld zu geben. Node.js-GC kann unter Last „träge“ wirken, aber wenn der Speicher kontinuierlich steigt und nie zurückfällt, wird etwas noch stark referenziert. Übliche Übeltäter sind globale Maps, Arrays in Modulen, Closures, die große Objekte einfangen, und Event-Listener, die pro Request hinzugefügt, aber nie entfernt werden. Konzentriere dich beim Jagen eines Node.js-Speicherlecks auf das, was Referenzen hält, nicht auf GC-Settings.

Ein weiterer Trugschluss ist, das Symptom zu patchen statt die Ursache. Einen Cache „wenn er groß wird“ zu leeren, verheimlicht das Problem vielleicht für eine Woche — dann ist es wieder da.

Was du stattdessen tun solltest

Ziele auf Fixes, die Wachstum unmöglich machen:

- Setze Größenlimits und Eviction (TTL oder LRU) für In-Memory-Caches

- Sorge dafür, dass Listener einmal registriert oder bei Cleanup entfernt werden

- Stoppe Timer und Intervals, wenn ein Job fertig ist oder ein Socket schließt

- Vermeide das Speichern von Request-Objekten, Sessions oder großen Responses in Globals

Beispiel: Ein Prototyp fügt pro Nutzer-Session setInterval hinzu, um „Daten zu refreshen“, löscht das Interval aber nie beim Logout. Der Heap wirkt zufällig, bis du einen Login/Logout-Loop ausführst und Snapshots vergleichst. Dann taucht ein einzelner retained Timer-Callback als Root auf.

Wenn du eine AI-generierte Node-App geerbt hast und dasselbe Leak nach Schnellpatches wiederkehrt, beginnt FixMyMess in der Regel mit einem kurzen Audit, um den genauen Retentionspfad aufzudecken, und wendet dann echte Cleanup- und Begrenzungsmaßnahmen an, damit es dauerhaft weg bleibt.

Kurze Checkliste und nächste Schritte

Ein Node.js-Speicherleck ist leicht diskutierbar und schwer zu beweisen. Nutze diese kurze Checkliste, um fokussiert zu bleiben und sicherzustellen, dass du nachweisen kannst, dass das Leak weg ist, nicht nur „besser auf deinem Rechner“.

Kurze Checkliste

- Kannst du das Speicherwachstum in unter 10 Minuten mit einem wiederholbaren Test reproduzieren (gleiche Endpunkte, gleiche Payloads, gleiche Concurrency)?

- Hast du mindestens 3 Heap-Snapshots (Basis, Mitten im Lauf, nahe am Fehler) gemacht und verglichen, was zwischen ihnen wächst?

- Hast du gezielt die üblichen Verdächtigen inspiziert: Event-Listener, In-Memory-Caches (Maps, Arrays, Memoization) sowie Timer/Intervals?

- Nach Code-Änderungen: Hast du denselben Test erneut ausgeführt und bestätigt, dass der Speicher stabil bleibt (und GC-Zyklen nicht weiter steigen)?

- Hast du auch Nebenindikatoren geprüft, die auf die Ursache hinweisen, wie Listener-Counts, offene Handles und ständig wachsende Key-Zahlen in Maps?

Wenn ein Punkt fehlschlägt, stoppe und behebe zuerst deinen Prozess. Die meiste verlorene Zeit entsteht, wenn Code geändert wird, bevor das Problem reproduzierbar ist, oder wenn nur ein Snapshot genommen und geraten wird.

Nächste Schritte

Nachdem du Stabilität bewiesen hast, sorge dafür, dass der Erfolg bleibt:

- Füge einen einfachen Soak-Test in deine Release-Routine ein (10–20 Minuten reichen oft, um Regressionen zu fangen)

- Bau Guardrails um wachstumsanfälligen Code: Cache-Limits, Listener-Removal beim Cleanup und Interval-Stopps, wenn Arbeit erledigt ist

- Dokumentiere „Ownership“ für Hintergrundschleifen und Singletons, damit sie sich nicht vervielfältigen, während die App wächst

Wenn deine App als AI-generierter Prototyp gestartet wurde, stammen Leaks oft aus verknüpftem globalem Zustand, duplizierten Listenern oder Hintergrundjobs, die während des Experiments hinzugefügt und nie entfernt wurden. In solchen Fällen ist ein fokussiertes Audit plus gezieltes Refactoring meist schneller als Flickwerk. FixMyMess bietet einen kostenlosen Code-Audit an, lokalisiert, was wächst, und hilft, den Prototyp in produktionsreife, verifizierte Fixes zu überführen.