PII in Logs maskieren: E‑Mails, Tokens und IDs

Schwärze PII in Logs mit praktischen Maskierungsmustern für E‑Mails, Tokens und IDs, damit du debuggen kannst, ohne Nutzerdaten offenzulegen.

Was in Logs als PII zählt (und warum es immer wieder auftaucht)

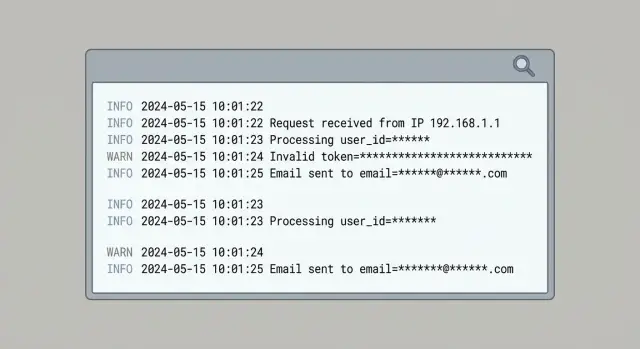

PII (personenbezogene Daten) sind alle Informationen, die eine Person allein identifizieren können oder in Kombination mit anderen Daten identifizierend werden. In Logs und Analytics sind das meist E-Mail-Adressen, Telefonnummern, Namen, Wohn- oder Rechnungsadressen und IP-Adressen. Dazu gehören auch „technische“ Kennungen, die in der Praxis oft auf eine einzelne Person verweisen: Benutzer‑IDs, Geräte‑IDs, Werbe‑IDs, Session‑IDs, Cookies und genaue Standortdaten.

PII taucht auf, weil Logging oft unter Zeitdruck ergänzt wird — gerade wenn etwas kaputt ist. Die typische Abkürzung lautet „log das ganze Objekt“ und räume später auf. Dieses „ganze Objekt“ enthält häufig Felder, die man nie speichern wollte.

Typische Eintrittspunkte sind Request‑Bodies (Signup, Passwort‑Reset, Support‑Nachrichten), Header (Authorization‑Tokens, Cookies und manchmal E‑Mail in benutzerdefinierten Headern), Error‑Objekte (die das Original‑Request oder serialisierte Nutzerdaten enthalten können), Query‑Strings (Tracking‑Parameter, in URLs eingefügte E‑Mails) und SDK‑Payloads von Drittanbietern, die Gerät‑ und Netzwerkinfos automatisch erfassen.

Analytics‑Events bergen dasselbe Risiko. Teams kopieren Felder aus Server‑Logs in Events wie user_email, session oder Debug‑Properties, um Charts einfacher zu bauen. Diese Events verteilen sich dann auf mehrere Anbieter und Dashboards und vergrößern die Problemfläche eines einzelnen Fehlers.

Redaktion ist besser als „sei einfach vorsichtig“, weil der Fehlerfall vorhersehbar ist: ein neuer Endpoint wird ausgeliefert, jemand fügt einen Debug‑Log hinzu oder eine Bibliothek ändert, was sie serialisiert. Behandle Redaction als Standard‑Sicherheitslage, nicht als Entwickler‑Option.

Entscheide, was du wirklich zum Debuggen brauchst

Bevor du etwas schwärzt, kläre wofür deine Logs gedacht sind. Die meisten Teams sammeln deutlich mehr, als sie nutzen, und genau in diesen zusätzlichen Details verstecken sich E‑Mails, Tokens und rohe Header.

Schreibe die konkreten Fragen auf, die Logs während eines Incidents beantworten sollen. Wenn eine Logzeile nicht hilft, eine dieser Fragen zu beantworten, ist sie ein guter Kandidat zum Entfernen oder Kürzen.

Die meisten Debugging‑Bedürfnisse lassen sich auf ein paar Basics reduzieren: was ist fehlgeschlagen und wann, welcher Endpoint/ welche Version wurde getroffen, ob der Fehler vor oder nach der Auth passiert ist, ob eine Abhängigkeit den Fehler verursacht hat und ob mehrere Fehler zur selben Anfrage oder Session gehören.

Definiere daraus eine sichere „minimal nützliche“ Log‑Form, auf die du dich überall verlassen kannst: Timestamp, ein Request‑ID (oder Trace‑ID), Routename, Statuscode und ein interner Fehlercode. Füge kleine, kontrollierte Kontexte hinzu wie Feature‑Flags oder einen kurzen Komponenten‑Namen. Vermeide es, ganze Objekte zu dumpen.

Halte Nutzer‑Support getrennt von Engineering‑Bedürfnissen. Support muss oft einen Nutzer finden und den Impact einschätzen, das erfordert aber nicht, die E‑Mail in jedem Event zu speichern. Sauberer ist es, einen stabilen internen Nutzer‑Key in Logs zu speichern und die Nutzer‑Auflösung in einem gesicherten Admin‑System zu belassen.

Einige Dinge sollten niemals geloggt werden, auch nicht „vorübergehend“: Passwörter und Einmalcodes, vollständige Tokens und API‑Keys, Session‑Cookies, rohe Authorization‑Header und komplette Request/Response‑Bodies.

Beispiel: Wenn Nutzer „Login fehlgeschlagen“ melden, reicht request_id=abc123, route=/login, status=401, error=AUTH_INVALID_TOKEN, auth_stage=post-parse. Damit kannst du debuggen, ohne das Token zu speichern.

Maskierungsmuster für E‑Mail‑Adressen

E‑Mail‑Adressen tauchen in Logs auf, weil sie leicht zu erfassen sind: Signup‑Formulare, Passwort‑Resets, Einladungen, Support‑Tickets und „user not found“-Fehler. Wenn du PII in Logs schwärzen willst, ohne Debug‑Wert zu verlieren, behalte gerade genug, um Muster zu erkennen (z. B. die Domain), ohne die komplette Adresse offenzulegen.

Ein sicherer Standard ist, die Domain und nur einen kleinen Hinweis auf den lokalen Teil zu lassen, z. B. j***@example.com oder jo***@example.com. Das reicht normalerweise, um zu erkennen, dass Fehler bei example.com gehäuft auftreten, ohne Identitäten preiszugeben.

Plus‑Adressen brauchen besondere Behandlung. [email protected] und [email protected] sind oft dasselbe Postfach. Wenn du naive Maskierung anwendest, behandelst du eine Person womöglich als mehrere Nutzer. Normalisiere vor der Maskierung: kleinschreiben, das +tag entfernen und dann maskieren.

Wenn du stabile Korrelation über Events brauchst, verwende lieber einen keyed hash statt teilweiser Offenlegung: hash(email) + "@" + domain. Nutze ein Anwendungspasswort (eine Pepper), damit der Hash nicht aus Listen häufiger E‑Mails zurückgeraten werden kann. Logge niemals die rohe E‑Mail neben dem Hash.

Freier Text ist die größte Leckquelle: Exception‑Meldungen, Debug‑Prints und kopierte Request‑Bodies. Füge eine Scan‑und‑Replace‑Stufe an deinen Logger, damit E‑Mails auch dann gesäubert werden, wenn sie in Sätzen auftauchen.

Gängige Optionen, die nützlich bleiben:

- Domain + erste 1–2 Zeichen des lokalen Teils:

ma***@gmail.com - Domain + nur lokale Länge:

[email protected] - Keyed hash + Domain:

a9f3c1…@example.com - Vollständiger Ersatz bei hohem Risiko:

[REDACTED_EMAIL]

Was immer du wählst: setze es an einer Stelle durch (ein gemeinsames Logging‑Hilfsmodul), damit es in allen Diensten und Analytics konsistent ist.

Maskierungsmuster für Tokens, API‑Keys und Session‑IDs

Secrets leaken, weil sie an „langweiligen“ Stellen geloggt werden, ohne dass ein Entwickler nachdenkt: im Authorization‑Header, in Cookies, in Query‑Strings und in JSON‑Feldern wie token, apiKey, sessionId oder csrf. Die Regel ist einfach: Logge niemals rohe Secrets, auch nicht bei Fehlern.

Verschiedene Secrets brauchen unterschiedliche Behandlung. API‑Keys sind oft langlebig und sollten wie Passwörter behandelt werden. JWTs können lesbare Claims enthalten — das Loggen kann also E‑Mails oder Nutzer‑IDs preisgeben. Session‑IDs und CSRF‑Tokens sind vielleicht kurzlebig, können aber trotzdem zu Session‑Hijacking führen.

Ein praktisches Muster ist, gerade genug zur Korrelation zu behalten:

- Prefix + Suffix: die ersten 4 und letzten 4 Zeichen behalten

- Nur Länge:

len=32, wenn Korrelation nicht nötig ist - Typ‑Tags:

kind=jwtoderkind=api_keyfür Parsing/Debug - Stabiler Hash: ein Einweg‑Hash, wenn konsistentes Matching gebraucht wird

Mach deinen Redactor robust gegenüber realen Strings. Secrets erscheinen als Bearer \u003ctoken\u003e, aber auch in zusammengefügten Nachrichten, ohne Leerzeichen oder in seltsamer Groß-/Kleinschreibung. Schwärze per Muster, nicht per „schöner Formatierung“.

Hier ein einfaches Vorher/Nachher‑Beispiel:

BEFORE error=\"upstream 401\" Authorization=\"Bearer eyJhbGciOi...\" cookie=\"sid=s%3A0f1a9...\" query=\"?api_key=sk_live_ABC123...\"\nAFTER error=\"upstream 401\" Authorization=\"Bearer eyJh...9Q2w\" cookie=\"sid=\u003credacted len=48\u003e\" query=\"?api_key=sk_l...8xKQ\"\n```

## Umgang mit Benutzer‑IDs, Geräte‑IDs und anderen Kennungen

Nicht alle IDs sind harmlos. Wenn eine Kennung einer realen Person zugeordnet werden kann (direkt oder durch Kombination mit anderen Daten), behandle sie als personenbezogen. Das umfasst viele „interne“ Felder wie `user_id`, `account_id`, `device_id`, `ip_address` und „anonymisierte“ Cookie‑IDs, wenn sie über die Zeit persistent sind.

Eine nützliche Regel: Wenn du damit eine Person in deiner Datenbank finden kannst, gilt sie als sensibel.

### Bevorzuge stabile, nicht‑umkehrbare IDs zum Debuggen

Du musst trotzdem Events bei einem Incident verbinden können. Das sicherste Muster ist eine stabile, aber nicht umkehrbare Darstellung, z. B. ein gesalzener Hash. So erhältst du wiederholbare Korrelation, ohne den ursprünglichen Wert offenzulegen.

Beispiel: Statt `user_id=483920` logge `user_key=hash(tenant_salt + user_id)`. Halte das Salt aus den Logs fern, rotiere es bei Bedarf und verwende separate Salts pro Environment.

Um Logs nützlich zu halten, füge Korrelationfelder hinzu, die nicht an eine Person gebunden sind: `request_id` für eine einzelne Anfrage, `trace_id` zum Verfolgen über Services hinweg, ein kurzlebiger `session_key`, der schnell verfällt, und `tenant_id`, wenn er eine Organisation statt einer einzelnen Person identifiziert.

Multi‑Tenant‑Apps brauchen besondere Sorgfalt. Ein `tenant_id` ist oft sicher, wenn er eine Firma oder ein Workspace identifiziert, nicht einen einzelnen Nutzer. Hashe Nutzer‑IDs nicht global über alle Tenants hinweg. Verwende `hash(tenant_id + user_id)`, damit Kennungen nicht über Tenants hinweg abgeglichen werden können.

## Strukturierte vs unstrukturierte Logs (und wie man beide schwärzt)

In unstrukturierten Logs schleicht sich PII am häufigsten ein. Ein schnelles `console.log(user)` oder ein Error, der Request‑Header enthält, kann E‑Mails, Tokens und IDs in eine einzige unübersichtliche Zeile schreiben. Ist das einmal in ein Logging‑Tool verschoben, ist es schwer, es später sauber zu bereinigen.

Strukturiertes Logging (typischerweise JSON) macht Redaction vorhersehbar. Statt mit Regex über eine ganze Zeile zu raten, kannst du gezielt Felder wie `user.email`, `auth.token` oder `request.headers.authorization` ansprechen.

Schwärze zunächst auf Feldebene, dann nutze Regex als Sicherheitsnetz für freien Text. Nur‑Regex‑Schwärzung auf kompletten Zeilen übersieht Randfälle und kann auch übermäßig viel wegschwärzen, was Debugging erschwert.

Praktisch ist es, stabile Metadaten zu loggen (Endpoint, Status, Feature‑Flag, kurzer Fehlercode), die „Form“ statt des Inhalts zu bewahren (Token‑Länge, E‑Mail‑Domain, letzte 4 Zeichen) und freien Text in `message` plus strukturierten `context` zu trennen. Füge dann einen finalen Scrub‑Schritt für verbleibende E‑Mail‑ähnliche oder Token‑ähnliche Strings hinzu.

Mach das einfach, indem du eine einzige `redact()`‑Utility bereitstellst und überall einsetzt (Logging, Fehlerberichterstattung, Analytics). Wenn verschiedene Teams ihre eigenen Regeln implementieren, übersiehst du Dinge.

```js

export function redact(value) {

if (value == null) return value;

const s = String(value);

// emails

const email = s.replace(/[A-Z0-9._%+-]+@([A-Z0-9.-]+\\.[A-Z]{2,})/gi, "\u003credacted:@$1\u003e");

// bearer tokens / api keys (best-effort)

return email.replace(/\\b(Bearer\\s+)?[A-Za-z0-9-_]{20,}\\b/g, "\u003credacted:token\u003e");

}

Schritt für Schritt: Redaction in deine Logging‑Pipeline einbauen

Redaction funktioniert am besten, wenn sie automatisch ist. Ziel ist, sensible Werte zu entfernen, bevor irgendetwas die laufende Anwendung verlässt, damit du dich nicht auf Vendor‑Einstellungen oder spätere Cleanup‑Jobs verlassen musst.

Beginne damit, jeden Ort zu listen, an dem Logs und Events erzeugt werden. Teams erinnern sich an den API‑Server und vergessen dann Worker, Reverse‑Proxy, Mobile‑Client oder einen Browser‑Error‑Reporter.

Definiere danach eine „Redaction‑Map“: Feldnamen, die niemals weitergegeben werden sollen (wie email, authorization, cookie, set-cookie, password, token) plus musterbasierte Regeln für unordentlichen freien Text.

Füge dann direkt vor dem Export eine Redaction‑Schicht hinzu, idealerweise in einer gemeinsamen Funktion, sodass sie schwer zu umgehen ist. Rollout kontrolliert: Tests hinzufügen, schrittweise ausrollen und prüfen, ob das Debugging weiterhin funktioniert.

Beweise es mit Tests, nicht mit Hoffnung

Nutze unordentliche Fixtures: eine Anfrage mit Authorization: Bearer ..., einen JSON‑Body mit email und eine URL mit einem Reset‑Token. Deine Tests sollten bestätigen, dass die sensiblen Teile ersetzt werden, während der verbleibende Kontext noch erklärt, was passiert ist.

PII in Analytics‑Events schwärzen, ohne Einblicke zu verlieren

Analytics leakt dieselben Daten wie Logs: URLs, Referrer, Formularwerte und Fehlermeldungen. Der Unterschied ist, wohin sie gelangen. Analytics‑Daten werden öfter kopiert und länger aufbewahrt.

Ein guter Default: sende weniger, aber konsistent. Ersetze Benutzer‑Eigenschaften durch eine pseudonyme ID und sende nur grobe Attribute, die du wirklich nutzt (Plans, App‑Version, Land, Gerätetyp). Produktfragen lassen sich meist beantworten, ohne rohe Kennungen zu versenden.

Die Muster sind bekannt: vermeide E‑Mail/Telefon/Vollname als Identifier, fasse sensible Strings zusammen (vorhanden/nicht vorhanden, Länge oder Kategorie), entferne Query‑Strings und Fragmente aus URLs und sende bei Fehlern einen Fehlercode und eine Kategorie statt kompletter Payloads, die Nutzereingaben enthalten können. Wenn du korrelieren musst, hashe mit einem geheimen Salt und sende niemals den rohen Wert.

Rohe URLs sind eine gängige Leckquelle. Passwort‑Reset‑Links können token=... enthalten, Einladungslinks E‑Mails in Query‑Strings — und diese Werte werden als Page‑View‑Properties erfasst.

Ein Signup‑Event braucht normalerweise nicht [email protected]. Meistens reicht signup_method=email, optional email_domain=company.com und ob die Bestätigung erfolgreich war.

Häufige Fehler, die weiterhin PII leaken

Die meisten Lecks entstehen nicht durch eine „falsche“ Redaction‑Regel. Sie passieren, weil jemand während eines Incidents mehr Detail braucht oder weil ein Codepfad anders loggt als der Rest.

Incident‑Modus, der nie ausgeschaltet wird

Ein klassischer Fehler ist, während eines Ausfalls vollständiges Request‑Logging einzuschalten (Bodies, Header, Query‑Strings), den Bug zu fixen und das zusätzliche Logging zu vergessen. Wochen später enthalten Logs Passwörter in Payloads, Bearer‑Tokens in Headern und E‑Mails in Query‑Params.

Redaction hilft, aber sie kann nicht retten, wenn du weiterhin deutlich mehr sammelst, als nötig ist.

Zu enge oder inkonsistente Redaction

Nur ein email‑Feld zu maskieren reicht nicht. PII verbirgt sich unter verschiedenen Keys und verschachtelten Strukturen und tritt an Stellen auf, die man vergisst: Worker, Background‑Jobs, Client‑seitiges Logging und Error‑Reporting.

Wenn du ein Ende‑zu‑Ende‑Versprechen geben willst, müssen dieselben Regeln überall laufen, wo Logs erzeugt werden, und es müssen Tests mit echten, unordentlichen Eingaben existieren.

Schnelle Checkliste vor dem Release

Mach einen letzten Check mit einem einfachen Ziel: genug Details behalten, um zu debuggen, was passiert ist und wo, aber keine Secrets oder direkte Identifikatoren speichern.

- Suche nach den schlimmsten Kandidaten: Passwörter, Authorization‑Header, Cookies und vollständige Tokens. Wenn du nur beweisen musst, dass ein Token existiert, logge nur einen kurzen Fingerabdruck (erste 6 und letzte 4 Zeichen) oder einen Einweg‑Hash.

- Achte darauf, dass E‑Mail‑Adressen und Telefonnummern überall maskiert sind, auch in Freitext und Stacktraces.

- Ersetze Benutzer‑Identifikatoren durch anonyme IDs (oder hashe sie mit einem stabilen Salt), damit du eine Reise verfolgen kannst, ohne den Originalwert preiszugeben.

- Prüfe Analytics‑Events auf rohe Kennungen und vollständige URLs. Query‑Strings transportieren oft Reset‑Tokens, Einladungs‑Codes oder Session‑Hinweise.

- Füge automatisierte Tests hinzu, die typische Payloads (Signup, Login, Passwort‑Reset, Webhook‑Fehler) durch deinen Logger jagen und prüfen, dass keine Secrets ausgeben werden.

Ein einfacher Spot‑Check: löse einen fehlgeschlagenen Login in Staging aus und schaue dir die genaue Logzeile an. Wenn sie eine E‑Mail, ein Cookie oder einen Auth‑Header enthält, bist du noch nicht fertig.

Nächste Schritte: schnell feststellen, was leaket, und es beheben

Beginne mit dem Beweis. Scanne aktuelle Logs und Analytics‑Payloads, um zu finden, was tatsächlich auftaucht: E‑Mail‑Muster, token‑ähnliche Strings, vollständige Namen, Adressen, IPs und Debug‑Dumps, die dauerhaft gespeichert wurden.

Wenn du Wiederholungen siehst, behandle sie als kleines Backlog. Behebe zuerst die höchsten Risiken (Auth, Passwort‑Reset, Signup, Billing, Support‑Formulare), dann arbeite dich nach außen vor. Stoppe neue Leaks, bevor du dich um das Bereinigen alter Daten sorgst.

Wenn du einen AI‑generierten Codebestand geerbt hast, geht diese Arbeit oft schnell voran, weil die Leckstellen sich in den Dateien wiederholen (volle Request‑Dumps, Header, Cookies, Environment‑Variablen). Fixe es einmal an der Logging‑Schnittstelle und du beseitigst ganze Klassen von Fehlern.

Wenn du externe Hilfe brauchst, konzentriert sich FixMyMess (fixmymess.ai) darauf, AI‑generierte Apps zu diagnostizieren und zu reparieren, inklusive sicherer Logging‑Defaults, Reparatur gebrochener Auth‑Flows und Security‑Hardening, sodass Prototypen sicher in Produktion laufen können.