Prompt‑Versionierung: Einfach Änderungen verfolgen und zurücksetzen

Prompt‑Versionierung einfach gemacht: Protokolliere, was du gefragt hast, was sich geändert hat und warum, damit du Ausgaben vergleichen, schnell zurückrollen und Regressionen reduzieren kannst.

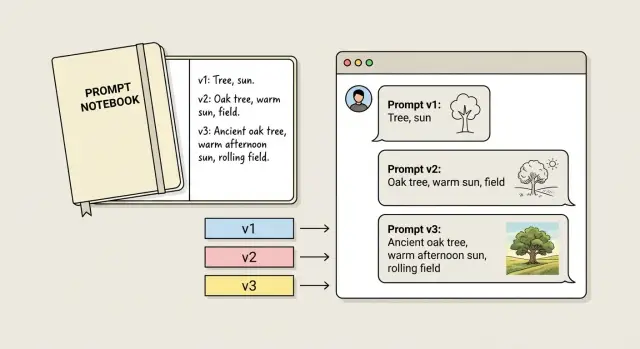

Warum Ausgaben nach einer „Verbesserung“ des Prompts regressieren\n\nOutput‑Regression bedeutet, dass ein Prompt, der früher gute Ergebnisse lieferte, nach einer Änderung schlechtere Ergebnisse liefert. Manchmal ist das subtil (ein paar mehr Fehler). Manchmal ist es offensichtlich (das Modell ignoriert die Hauptregel).\n\nRegression zeigt sich häufig als:\n\n- Tonverschiebung (zu formell, zu werblich, zu locker).\n- Strukturbrüche (fehlende Überschriften, falsches Format, zusätzliche Abschnitte).\n- Geringere Genauigkeit (mehres Raten, Widersprüche, weniger Einschränkungen).\n- Vergessene Vorgaben (Wortanzahl, verbotene Formulierungen, verlangte Elemente).\n- Weniger Konsistenz (zwei Läufe liefern sehr unterschiedliche Antworten).\n\nKleine Prompt‑Änderungen können große Verschiebungen verursachen, weil ein Prompt kein Schritt‑für‑Schritt‑Checkliste ist, der vom Modell Wort für Wort befolgt wird. Er ist ein Set von Signalen, die um Aufmerksamkeit konkurrieren. Ein Satz hinzufügen, ein Beispiel entfernen oder die Reihenfolge von Anweisungen ändern — und du veränderst, was das Modell als „wichtigster“ Anteil behandelt.\n\nTypische Auslöser sind widersprüchliche Regeln, das Vergraben einer wichtigen Einschränkung weiter unten im Prompt, das Ersetzen eines konkreten Beispiels durch ein vages, ein längerer Prompt, in dem Details weniger Aufmerksamkeit bekommen, oder die Änderung eines einzelnen Wortes, das die Bedeutung verschiebt (zum Beispiel „kurz“ vs. „minimal“).\n\nDas Kostenintensive ist oft nicht die schlechte Ausgabe selbst, sondern der Verlust des Kontexts: was sich geändert hat und warum. Eine Woche später erinnerst du dich vielleicht: „Version B war besser“, aber du kannst nicht erklären, was „besser“ bedeutete, welche Testeingabe du verwendet hast oder was genau geändert wurde.\n\nDeshalb ist Prompt‑Versionierung wichtig. Das Ziel ist nicht Perfektion. Es sind reproduzierbare Ergebnisse und einfache Rollbacks. Wenn du sagen kannst: „v1.3 hat eine strengere Formatregel hinzugefügt und den freundlichen Ton zerstört“, kannst du in Minuten zurückrollen statt zehn zufällige Änderungen auszuprobieren.\n\nDas gilt besonders, wenn Prompts echte Arbeit berühren: Onboarding‑E‑Mails, Support‑Antworten, interne Dokumente oder Code‑Snippets. Eine winzige Wortwahländerung kann stillschweigend dazu führen, dass Code die Eingabevalidierung weglässt oder Geheimnisse preisgibt — und das merkst du vielleicht erst später.\n\nBehandle Prompts wie Produktänderungen: protokolliere jede Bearbeitung, behalte eine bekannte gute Version und mache jede Änderung leicht rückgängig.\n\n## Was du tracken solltest (und was du ignorieren kannst)\n\nGute Prompt‑Versionierung erfasst wenige Details, die die meisten Regressionen erklären. Das Ziel ist simpel: das zukünftige Du (oder ein Teamkollege) soll die gleiche Anfrage erneut ausführen können und verstehen, warum die Ergebnisse anders aussehen.\n\n### Diese Dinge tracken (sie verursachen echte Regressionen)\n\nFür jede Version halte eine kleine Aufzeichnung bereit, die Folgendes enthält:\n\n- Den exakten Prompt‑Text, kopiert wie er ist (inklusive Systemnachricht oder „versteckter“ Anweisungen).\n- Den Modellnamen und wichtige Einstellungen (insbesondere Temperature). Wenn Tools oder Funktionsaufrufe aktiviert sind, notiere das ebenfalls.\n- Die Eingabe, die du verwendet hast (Referenztexte, Beispiel‑Snippets, Dateien, Einschränkungen, Formatierungsregeln).\n- Eine „goldene“ Ausgabe, die du als gut befunden hast, plus 1–2 Sätze, warum sie gut war.\n- Den Testfall, den du zur Bewertung genutzt hast (die gleiche Nutzeranfrage oder dieselben Beispieldaten).\n\nDas sind meist nur ein paar Zeilen. Der größte Zeitgewinn ist, die Erfolgskriterien aufzuschreiben. Leute erinnern sich an den Prompt, vergessen aber, was sie eigentlich erhalten wollten.\n\n### Diese Dinge kannst du ignorieren (sie helfen selten)\n\nEinige Details wirken nützlich, erklären aber selten Regressionen:\n\n- Winzige Formatierungsänderungen, die keine Bedeutungsänderung bringen.\n- Lange Abhandlungen über die Absicht (außer einer kurzen „Warum wurde das geändert“‑Notiz).\n- Kosmetische Metadaten, sofern sie Routing oder Verhalten nicht beeinflussen.\n- Dutzende Ausgabe‑Beispiele. Eine repräsentative goldene Ausgabe schlägt zehn zufällige.\n\nEin häufiges Muster: du senkst die Temperature für konsistentere Antworten. Eine Woche später wirken Ausgaben steif und lassen zentrale Details aus. Wenn du die Temperature‑Änderung und eine frühere goldene Ausgabe protokolliert hast, kannst du sicher zurückrollen statt zu raten.\n\n## Ein einfaches Versionsschema, das du wirklich nutzt\n\nPrompt‑Versionierung funktioniert nur, wenn sie leicht bleibt. Wenn es zu einer Zeremonie wird, hörst du auf, es gerade dann zu tun, wenn du es am meisten brauchst.\n\nVerwende kurze Versions‑IDs, auf die du überall verweisen kannst: v1, v1.1, v2.\n\n- Major‑Versionen (v1, v2, v3): Das Ziel hat sich geändert (neues Publikum, neues Format, neue Einschränkungen, neue Bewertungsregeln). Erwarte andere Ausgaben.\n- Minor‑Versionen (v1.1, v1.2): Das Ziel bleibt gleich, du hast Wortwahl, Reihenfolge, ein Beispiel oder eine Regel angepasst.\n- Hotfixes (v1.1a): Ein schneller Patch oder ein Rollback, um Verhalten wiederherzustellen.\n\nHalte einen Zielsatz pro Version. Wenn du die Aufgabe des Prompts nicht in einem Satz beschreiben kannst, ist die Änderung wahrscheinlich größer, als du denkst.\n\nVersuche, pro Version genau eine sinnvolle Änderung zu machen. Wenn du Ton, Einschränkungen und Beispiele gleichzeitig änderst, weißt du nicht, was die Verbesserung (oder den Bruch) verursacht hat.\n\n## Die minimal Aufwand‑Einrichtung: eine Datei, gleiche Struktur jedes Mal\n\nWenn du nur eins machst: speichere Prompt‑Versionen an einem Ort. Ein Dokument, eine Notiz oder eine Datei im Repo reicht. Die Frage, die in 30 Sekunden beantwortet werden können muss: „Was hat sich geändert und wann wurde die Ausgabe schlechter?“\n\nWähle einen Dateinamen, den du dir merkst (zum Beispiel: prompts.md oder prompt_versions.md). Nutze dann jedes Mal dieselbe Struktur.\n\n### Eine einfache Vorlage zum Kopieren\n\nVerwende dieselben Abschnitte jedes Mal: den Prompt, das Änderungsprotokoll für diese Version, ein goldenes Ausgabe‑Beispiel und eine kurze „bekannte Probleme“‑Zeile.\n\nmd\n# Prompt: Support Reply Writer\n\n## v1.3 (2026-01-21)\n\n### Prompt\n[Paste the full prompt here. No snippets.]\n\n### Change log\n- Why: Reduce overly formal tone.\n- What changed: Added \"Write like a helpful human\" and removed \"Use professional language\".\n\n### Golden output\n[Paste the exact best output you want to preserve.]\n\n### Known issues\nSometimes forgets to ask one follow-up question.\n\n\nEin paar Regeln sorgen dafür, dass das langfristig hält:\n\n- Füge den vollständigen Prompt jedes Mal ein. Teilweise Prompts sind der Anfang der Verwirrung.\n- Schreibe das „Warum“ in klaren Worten. „Qualität verbessern“ ist kein Warum. „Vermeidet Bullet‑Points in kurzen E‑Mails“ ist eines.\n- Behalte pro Version genau eine goldene Ausgabe. Wähle das Beispiel, das du am liebsten nicht verlieren würdest.\n\n### Wie eine „goldene Ausgabe“ aussehen sollte\n\nGoldene Ausgabe ist nicht „die beste Ausgabe aller Zeiten“. Sie ist ein Schnappschuss, den du später vergleichen kannst.\n\nNutze eine echte Eingabe und füge die genaue Ausgabe ein, die du genehmigt hast – inklusive Formatierung, Ton und benötigten Abschnitten. Wenn eine neue Version anfängt, übertriebene Claims hinzuzufügen oder wichtige Details zu überspringen, merkst du es sofort.\n\nFüge eine „bekannte Probleme“‑Zeile hinzu, auch wenn es klein wirkt. Sie verhindert, dass du (oder ein Kollege) dieselbe Sache zweimal „reparierst“ und dabei etwas anderes brichst.\n\n## Schritt für Schritt: wie du einen Prompt änderst, ohne die gute Ausgabe zu verlieren\n\nDas Ziel ist simpel: behalte ein bekannt‑gutes Ergebnis, zu dem du jederzeit zurückkehren kannst.\n\nBeginne mit einer Basisaufgabe, die wichtig ist und leicht erneut ausführbar ist, z. B.: „Fasse diese Kunden‑E‑Mail in 3 Bullet‑Points zusammen und schreibe eine höfliche Antwort.“ Führe deinen aktuellen Prompt einmal aus, speichere den Prompt‑Text als v1 und speichere die exakte Eingabe und Ausgabe.\n\nFormuliere dann eine kurz‑textliche Prüfung, was „gut“ bedeutet. Vermeide vage Ziele wie „besser“ oder „hilfreicher“. Mach es zu etwas, das du schnell beurteilen kannst.\n\nEin praktischer Ablauf:\n\n1. Baseline einfrieren: speichere v1 Prompt + Baseline‑Eingabe + Ausgabe.\n2. Schreibe eine Pass/Fail‑Regel: 2–4 Zeilen (z. B.: „Keine erfundenen Fakten. Verwendet den Kundennamen. Enthält einen klaren nächsten Schritt. Unter 120 Wörtern.“).\n3. Ändere eine Sache: editiere nur eine Anweisung, Einschränkung oder ein Beispiel und speichere als v1.1.\n4. Führe dieselbe Baseline erneut aus: gleiche Eingabe, gleiche Einstellungen.\n5. Entscheide schnell: besteht es, behalte v1.1. Scheitert es, rolle zurück und probiere eine andere einzelne Änderung.\n\nWenn du „sei kreativer“ hinzufügst und das Modell anfängt, Details zu erfinden, ist das eine Regression gegenüber „keine erfundenen Fakten“. Behalte v1 als sichere Kopie. Versuche eine engere Änderung wie „verwende einen wärmeren Ton“, ohne neue Informationen einzuladen.\n\nErst wenn v1.1 besteht, solltest du das Ziel erweitern (neues Ausgabeformat, mehr Edge‑Cases). Dann macht ein v2 Sinn.\n\n## Wie du eine Prompt‑Änderung schnell testest (ohne zu überdenken)\n\nSchnelles Testen ist größtenteils Konsistenz. Wenn du Prompt und Eingaben gleichzeitig änderst, weißt du nicht, was die Verschiebung verursacht hat.\n\nWähle eine kleine Menge realer Beispiele, die du jede Woche wirklich ausführst. Nimm ein leicht chaotisches Beispiel mit.\n\nEine wiederholbare Routine:\n\n- Wähle 3–5 Testeingaben.\n- Friere alles andere ein (Modell, Temperature, Tools, Systemnachricht).\n- Führe Version A und Version B mit denselben Eingaben aus.\n- Vergleiche neben‑ und notiere pro Test einen Einzeiler.\n- Wenn B insgesamt besser ist, promote sie und dokumentiere den Wechsel.\n\nHalte die Bewertung einfach:\n\n- Korrekt: Hat es die Aufgabe ohne Auslassung wichtiger Details erfüllt?\n- Sicher: Wurden keine Secrets geleakt, keine riskanten Behauptungen gemacht oder schädliche Anweisungen befolgt?\n- Im Format: Entspricht es der benötigten Struktur (Überschriften, JSON, Ton, Länge)?\n\nBeispiel: Du fügst „sei knapp“ zu einem Support‑Reply‑Prompt hinzu. Zwei Tests sehen besser aus. Beim dritten (eine wütende Rückerstattungsanfrage) fragt das Modell nicht nach der Bestellnummer und liefert eine vage Entschuldigung. Das ist eine Regression in der Korrektheit, auch wenn es besser lesbar ist.\n\n## Beispiel‑Szenario: ein kleiner Tweak, der stillschweigend Ergebnisse bricht\n\nEin Gründer nutzt einen Prompt, um Support‑E‑Mails zu verfassen. Die Aufgabe ist simpel: schnell antworten, ruhig bleiben und niemals etwas versprechen, das das Produkt nicht kann.\n\nVersion 1 funktioniert gut. Sie weist das Modell an, nur zu zitieren, was der Kunde gesagt hat, zwei nächste Schritte anzubieten und eine klärende Frage zu stellen.\n\nNach ein paar Wochen möchte der Gründer einen wärmeren Ton und etwas kürzere E‑Mails. Sie erstellen v2. Die E‑Mails klingen netter, aber ein neues Problem taucht auf: Das Modell fängt an, Details zu erfinden wie „Ich habe Ihr Konto geprüft“ oder „Ihre letzte Zahlung ist fehlgeschlagen“. Das ist riskant, wenn der Support diese Informationen gar nicht sehen kann.\n\nDas Änderungsprotokoll zeigt eine einzige neue Zeile in v2:\n\ntext\nv2 change: “Be helpful by filling in missing context when it seems obvious.”\n\n\nDiese einzelne Anweisung ermutigt zum Raten. Da das Änderungsprotokoll spezifisch ist, kann der Gründer den Auslöser benennen und schnell beheben.\n\nSie rollen auf v1.1 zurück (die letzte bekannte gute Version) und übernehmen nur die sicheren Teile von v2: wärmere Begrüßung, kürzerer Abschluss und die Struktur mit „zwei nächsten Schritten“. Alles, was Raten erlaubt, wird entfernt und durch eine harte Regel ersetzt: „Wenn du dir nicht sicher bist, frage nach, statt anzunehmen."\n\n## Häufige Fehler, die Regressionen schwer debugbar machen\n\nPrompt‑Regressionen sind meist selbstverschuldet, nicht weil die Idee schlecht war, sondern weil die Änderung die Ursache versteckt hat.\n\nDer größte Fehler ist, zu viel auf einmal zu ändern. Wenn du Ziel, Ton, Formatregeln und Beispiele in einem Commit änderst, kannst du nicht sagen, was das Ergebnis gebrochen hat. Die Reparatur wird dann oft Raten, und Leute fügen noch mehr Anweisungen hinzu, um zu kompensieren.\n\nEin weiterer Fehler ist, keine bekannte gute Ausgabe zu speichern. Ohne Vorher/Nachher streitet man aus der Erinnerung.\n\nDie Fehler, die am meisten Zeit kosten:\n\n- Mehrere Änderungen auf einmal, so dass keine klare Ursache existiert.\n- Keine gespeicherte „gute“ Ausgabe und keine gespeicherte Eingabe, die sie erzeugt hat.\n- Testdaten wurden geändert und man gibt dem Prompt die Schuld.\n- Einstellungen drifteten zwischen Läufen (Modellversion, Temperature, Systemnachricht, Tool‑Config).\n- Es wurde nur der finale Prompt‑Text gespeichert, nicht aber das Warum oder die Erwartung.\n\nDisziplin schlägt Cleverness: ändere eine Sache, halte Testeingaben fest und schreibe den Grund für jede Änderung in einem Satz.\n\n## Schnell‑Checkliste, bevor du eine neue Prompt‑Version auslieferst\n\nBevor du eine neue Prompt‑Version auslieferst, mach einen schnellen Check, dass du das letzte gute Ergebnis reproduzieren und im Fall von Qualitätsverlust schnell zurückrollen kannst.\n\n### Der 5‑Minuten‑Ship‑Check\n\n- Kannst du die letzte gute Ausgabe reproduzieren? Nutze gespeicherte Eingaben und bestätige, dass du das Baseline‑Ergebnis noch erhältst.\n- Hast du nur eine Variable geändert? Eine sinnvolle Änderung pro Version hält Ursache und Wirkung klar.\n- Hast du einen Pass/Fail‑Test? Wähle 2–3 Checks, die du schnell beurteilen kannst (erforderliche Felder, genaues Format, keine erfundenen Fakten).\n- Welche Art von Fehler ist es? Kategorisiere ihn: Format, Fakten, Sicherheit oder Ton.\n- Ist Rollback schneller als Patchen? Wenn du mehrere Fixes auf einer wackeligen Änderung stapelst, rolle zurück und mache die Änderung sauber neu.\n\nWenn deine Prompts Code erzeugen oder App‑Verhalten ändern, nimm das noch ernster. Reproduziere, isoliere eine Änderung, teste Pass/Fail und rolle früh zurück.\n\n## Nächste Schritte: mach es zur Gewohnheit (und wann du Hilfe brauchst)\n\nDer einfachste Weg, Prompt‑Versionierung beizubehalten, ist, aufzuhören, deinen besten Prompt als Einmalstück zu behandeln. Mach daraus eine wiederverwendbare Vorlage mit klaren Platzhaltern (Ziel, Publikum, Einschränkungen, Beispiele). Wenn du immer von derselben Form ausgehst, siehst du schneller, was sich geändert hat, und Rollbacks bleiben einfach.\n\nMach die Gewohnheit so klein, dass du sie nicht überspringen kannst:\n\n- Nutze eine kurze ID plus Datum (z. B.: support_reply_v07_2026-01-21).\n- Füge eine einzeilige, klare Notiz zur Änderung hinzu.\n- Speichere die bekannte gute Ausgabe mit der Version, nicht im Chat‑Verlauf.\n- Notiere, was du verbessern wolltest und was schlechter wurde (falls es passiert).\n\nManchmal liegt das Problem nicht im Prompt. Wenn du inkonsistentes Verhalten über Nutzer siehst, fehlende Daten, defekte Auth oder Fehler, die nur in Produktion auftreten, kann es ein App‑Problem sein.\n\nWenn du eine AI‑generierte App von Tools wie Lovable, Bolt, v0, Cursor oder Replit geerbt hast und Prompt‑Anpassungen nicht ausreichen, kann ein Remediation‑Team wie FixMyMess (fixmymess.ai) ein kostenloses Code‑Audit durchführen, um Probleme wie gebrochene Auth, exponierte Secrets und Sicherheitslücken zu identifizieren, bevor du entscheidest, ob du reparierst oder neu aufbaust.

Häufige Fragen

Was bedeutet „Output Regression“ bei Prompts?

Es ist, wenn ein Prompt, der früher gute Ergebnisse geliefert hat, nach einer Änderung schlechtere Ergebnisse liefert. Die Ausgabe kann sich etwa im Ton verschieben, benötigte Struktur vermissen, Einschränkungen ignorieren oder weniger konsistent zwischen Läufen sein.

Warum kann eine winzige Prompt‑Änderung große Unterschiede in der Ausgabe verursachen?

Weil das Modell auf das Gesamtbild an Signalen reagiert und nicht Anweisungen wie eine strikte Checkliste abarbeitet. Eine kleine Formulierungsänderung, ein anderes Reihenfolge oder ein längerer Prompt kann verschieben, was das Modell als besonders wichtig betrachtet.

Was ist der schnellste Weg, eine Regression zu debuggen?

Führe dieselbe Eingabe unter identischen Einstellungen einmal mit der alten und einmal mit der neuen Version aus. Wenn du das vorherige „gute“ Ergebnis nicht reproduzieren kannst, arbeitest du im Dunkeln — sperre zuerst Prompt‑Text, Modell und Einstellungen ein.

Was sollte ich für jede Prompt‑Version tracken?

Speichere den vollständigen Prompt‑Text, den Modellnamen und wichtige Einstellungen wie Temperature. Speichere außerdem die genaue Testeingabe, eine „goldene Ausgabe“, die du genehmigt hast, und eine kurze Notiz, warum diese Ausgabe gut war.

Wann sollte ich eine Major‑ vs. Minor‑Version (und Hotfix) verwenden?

Major‑Versionen sind für geänderte Ziele (neues Publikum, neues Format, neue Bewertungsregeln). Minor‑Versionen sind kleine Anpassungen bei gleichem Ziel, und Hotfixes sind schnelle Patches oder Rollbacks, um Verhalten sofort wiederherzustellen.

Warum ist „eine bedeutende Änderung pro Version“ so wichtig?

Weil es Ursache und Wirkung klar macht. Wenn du Ton, Formatregeln und Beispiele gleichzeitig änderst, weißt du nicht, welche Änderung geholfen oder geschadet hat — du kannst also nicht sicher den guten Teil behalten und den schlechten rückgängig machen.

Was sollte eine „goldene Ausgabe“ beinhalten?

Eine goldene Ausgabe sollte eine reale Ausgabe aus einer echten Eingabe enthalten, genau so eingefügt, wie sie erzeugt wurde — inklusive Formatierung und Ton. Sie ist kein Perfektionsziel, sondern ein Referenzpunkt, damit du schnell erkennst, wenn eine neue Version Anforderungen überspringt oder Details erfindet.

Wie teste ich Prompt‑Änderungen ohne zu überdenken?

Verwende eine kleine, wiederholbare Menge echter Eingaben und führe beide Versionen mit demselben Modell und denselben Einstellungen aus. Beurteile sie mit einfachen Pass/Fail‑Checks wie „keine erfundenen Fakten“, „bleibt im Format“ und „enthält den erforderlichen nächsten Schritt“, damit du schnell entscheiden kannst.

Warum fangen Prompts an, Details zu erfinden, wenn ich sie netter oder kürzer machen will?

Formulierungen wie „sei kreativer“ oder „fülle fehlenden Kontext aus“ können das Modell dazu bringen zu raten, was oft die Genauigkeit verringert. Wenn Genauigkeit wichtig ist, bevorzuge Regeln wie „Wenn du unsicher bist, frage nach, statt etwas anzunehmen“ und behalte „keine erfundenen Fakten“ als harte Einschränkung.

Wann ist es kein Prompt‑Problem und was sollte ich stattdessen tun?

Ein Prompt‑Rollback behebt keine Probleme, die aus der Anwendung selbst stammen, etwa defekte Authentifizierung, exponierte Secrets oder unsichere Codepfade, die nur in Produktion auftreten. Wenn du eine AI‑generierte App von Tools wie Lovable, Bolt, v0, Cursor oder Replit geerbt hast und Prompt‑Anpassungen nicht ausreichen, kann FixMyMess ein kostenloses Code‑Audit durchführen und helfen, ob repariert oder neu aufgebaut werden muss.