Sichere große CSV-Importe in Produktion ohne App-Abstürze

Lerne, wie du große CSV-Importe in Produktion sicher machst: Stream-Parsing, zeilenweise Validierung, partielle Fehlerbehandlung und klare Fehlerberichte, ohne die App abstürzen zu lassen.

Warum große CSV-Importe in Produktion fehlschlagen

Ein CSV-Import kann mit einer kleinen Testdatei problemlos aussehen und dann beim ersten Hochladen einer echten Kunden-Datei mit 300.000 Zeilen auseinanderfallen. In Produktion sind Netzwerke langsamer, Zeitlimits strenger und die Daten unordentlicher. Wenn der Import als schnelles Feature gebaut wurde, geht man meistens davon aus, dass alles sauber und klein ist.

Der häufigste Fehler ist der Speicherverbrauch. Viele Importe lesen die gesamte Datei in den Arbeitsspeicher, parsen sie in Objekte, validieren und behalten alles in Arrays bis zum Ende. Eine Datei, die sich „nicht so groß“ anfühlt, kann trotzdem den Speicher sprengen, wenn sie in interne Strukturen expandiert. Kommen noch ein paar gleichzeitige Uploads hinzu, beginnt der Server zu swappen, zu verzögern oder neu zu starten.

Der zweite große Fehler ist die Zeit. Web-Requests und serverless Jobs haben oft harte Ausführungsgrenzen. Selbst wenn ein Import in 10 Minuten fertig wäre, kann er nach 60 Sekunden beendet werden und du bleibst mit halb geschriebenen Daten sitzen.

Weitere häufige Bruchstellen:

- Speicherspitzen durch Laden der ganzen Datei oder zu viel Buffering

- Timeouts durch Validierung und Datenbank-Schreibvorgänge innerhalb der Anfrage

- Eine fehlerhafte Zeile, die den gesamten Import zum Absturz bringt

- Duplikate durch Retries, Doppelklicks oder erneutes Hochladen derselben Datei

- Teilweise Schreibvorgänge, die Daten inkonsistent zurücklassen

Was Nutzer erleben, ist einfach: die Seite friert ein, der Spinner hört nicht auf, oder sie bekommen eine vage „Import fehlgeschlagen“-Meldung ohne Hinweis, was zu tun ist. Schlimmer noch: fehlende Zeilen werden vielleicht erst Tage später bemerkt.

Was dein Team braucht, sind vorhersehbare Ergebnisse und Belege. Du willst wissen, wie viele Zeilen akzeptiert, abgelehnt oder übersprungen wurden – plus die genauen Gründe. Diese Klarheit macht aus einem beängstigenden Vorgang eine Routine.

Ein kleines Beispiel: Ein Kunde lädt eine Verkaufsliste hoch, in der Spalte E-Mail ist Zeile 18.237 leer. Wenn dein Importer eine einzelne Exception wirft und stoppt, verlierst du Stunden und Vertrauen. Wenn er den Zeilenfehler protokolliert und weiterarbeitet, ist der Job fertig und du gibst einen Bericht zurück, mit dem der Kunde arbeiten kann.

Was „sicher“ für deinen CSV-Import bedeutet

Ein CSV-Import ist sicher, wenn er fertig wird, ohne deine App abzuschießen, und das Ergebnis vorhersehbar ist. Die meisten Produktionsfehler entstehen, weil der Import versucht, zu viel auf einmal zu tun oder weil die Regeln unklar sind.

Beginne damit, zu entscheiden, was „Erfolg“ für deine Nutzer bedeutet:

- Alles-oder-nichts: Wenn eine Zeile falsch ist, wird nichts gespeichert.

- Partieller Erfolg: Gute Zeilen werden importiert, schlechte Zeilen werden mit klaren Gründen abgelehnt.

Partieller Erfolg ist meist nutzerfreundlicher, erfordert aber sorgfältiges Design, damit du nicht mit halb erstellten Daten dastehst, die andere Teile der App kaputt machen.

Setze Erwartungen von Anfang an. Ein guter Import ist nicht grenzenlos: Begrenze Dateigröße und Zeilenanzahl klar und sei strikt bei Pflichtspalten. Wenn eine Spalte erforderlich ist (wie E-Mail, SKU oder user_id), fail schnell, bevor du schwere Arbeit machst. Ist ein Feld optional, behandle fehlende Werte als normal und dokumentiere, welchen Default du anwendest.

Strikte vs. flexible Regeln

Sei strikt bei der Struktur, flexibel beim Inhalt.

- Struktur: erforderliche Header, Datentypen, Beziehungen, von denen deine App abhängt.

- Inhalt: zusätzliche Spalten, die du ignorierst, optionale Felder, kleine Formatunterschiede, die du normalisieren kannst (z. B. Trim von Leerzeichen).

Eine einfache Möglichkeit, Sicherheit zu definieren, ist, diese Fragen zu beantworten:

- Welche Limits setzt du (Zeilen, Größe, Pflicht-Header)?

- Welche Fehler stoppen den gesamten Import und welche lehnen nur eine Zeile ab?

- Was protokollierst du für den Support, und was zeigst du dem Nutzer?

- Wie verhinderst du, dass dieselbe Datei zweimal importiert wird?

Der letzte Punkt ist Idempotenz. Gib jedem Import einen stabilen Schlüssel (z. B. Dateiprüfsumme plus Nutzer und ein Zeitfenster) und mache wiederholte Einreichungen sicher.

Stream-Parsing statt das ganze File laden

Die gesamte CSV in den Speicher zu laden funktioniert in Demos, bricht aber in Produktion zusammen. Eine einzige Kunden-Datei kann hunderte MB groß sein. Liest deine App sie auf einmal, steigen Speicher, Requests laufen aus und der ganze Server kann neu starten.

Streaming hält den Speicherverbrauch konstant. Statt einen riesigen String oder ein großes Array zu bauen, liest du kleine Stücke, parst ein paar Zeilen, verarbeitest sie und gehst weiter. Richtig gemacht ist Streaming die Grundlage für zuverlässige Importe, weil es begrenzt, wie viel Schaden eine schlechte Datei anrichten kann.

Wie Streaming in der Praxis aussieht

Ein Streaming-Parser liest Bytes vom Upload in kleinen Stücken und gibt vollständige Zeilen aus, sobald sie verfügbar sind. Dein Import-Code verarbeitet Zeile für Zeile oder in kleinen Batches, sodass der Fortschritt auch bei riesigen Dateien weitergeht.

Hier zeigen sich auch reale CSV-Eigenheiten:

- Encoding: Erzwinge UTF-8 (oder erkenne es) und fail schnell, wenn es nicht dekodierbar ist.

- Delimiter: Unterstütze Komma vs. Semikolon, wo relevant, aber rate nicht endlos herum.

- Gequotete Felder: Nutze einen echten CSV-Parser, damit Kommas in Anführungszeichen die Spalten nicht splitten.

- Newlines: Akzeptiere Windows- und Unix-Zeilenenden, ohne Zeilen falsch zu zählen.

Bevor du Tausende von Zeilen verarbeitest, fange fatale Datei-Probleme früh ab. Wenn Header fehlen oder Spalten nicht zu deiner Erwartung passen, erzeugt Weiterverarbeitung nur Lärm.

Ein einfacher Early-Gate-Check umfasst:

- Datei ist nicht leer und hat eine Header-Zeile

- Erforderliche Spalten existieren

- Delimiter- und Quote-Regeln parsen die ersten N Zeilen sauber

- Spaltenanzahl liegt in einem vernünftigen Maximum (schützt gegen kaputtes Quoting)

Zeilenweise Validierung, die Probleme früh erkennt

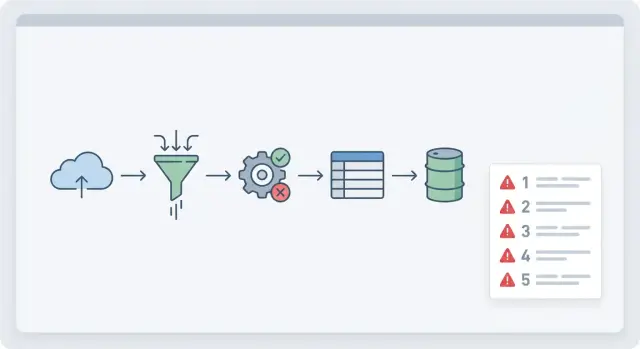

Behandle Validierung wie einen Trichter: Prüfe die Datei einmal, dann jede Zeile beim Streamen.

Datei-Level-Prüfungen beantworten „Ist das die richtige Datei?“ bevor du die Datenbank berührst. Bestätige Header-Namen, Dateicodierung, Delimiter und grobe Größenlimits. Ist der Header falsch, stoppe früh mit einer klaren Meldung.

Zeilen-Level-Prüfungen beantworten „Ist diese Zeile brauchbar?“ und sollten unabhängig für jede Zeile laufen. Eine fehlerhafte Zeile darf den Import nicht abstürzen oder den Batch vergiften.

Ein praktischer Zeilen-Validator prüft:

- Pflichtfelder (fehlende E-Mail, leere SKU)

- Typen und Bereiche (Mengen sind nicht negativ, Preise in sinnvollen Grenzen)

- Daten und Formate (ungültige Daten wie 2025-02-30)

- Erlaubte Werte (Status muss active, paused oder archived sein)

- Geschäftsregeln (unique keys, gültige Beziehungen wie vorhandene customer_id)

Normalisiere Eingaben vor der Validierung, damit du Daten nicht ablehnst, die im Grunde in Ordnung sind. Entferne führende/abschließende Leerzeichen, standardisiere Groß-/Kleinschreibung dort, wo es hilft (z. B. E-Mails) und behandle gängige Null-Werte ("N/A", "null", "-") als leer. Wende dieselbe Normalisierung überall an, damit Duplikate nicht als „ACME“ vs. „acme " durchrutschen.

Halte Validierungsnachrichten kurz und handlungsfähig. Ein gutes Muster ist: Zeilennummer, Spalte, Problem und ein Hinweis.

Beispiel: „Zeile 128, start_date: ungültiges Datum. Nutze JJJJ-MM-TT.“

Idempotenz und Duplikatschutz

Ein CSV-Import scheint einfach, bis jemand auf „Importieren" zweimal klickt, der Browser retryt oder zwei Kollegen dieselbe Datei gleichzeitig hochladen. Ohne Idempotenz entstehen nicht nur Duplikate, sondern auch widersprüchliche Updates und kaputte Summen.

Entscheide zuerst, wie das System „diese Zeile erneut“ erkennt. Zeilennummern sind nicht stabil, wenn Nutzer die Datei sortieren oder bearbeiten, also kombiniere sie mit Schlüssel-Feldern, die den Datensatz beschreiben.

Gängige Ansätze:

- Natürliche Schlüssel (E-Mail für einen User, SKU für ein Produkt)

- Externe IDs (eine ID aus dem Quellsystem)

- Ein zusammengesetzter Schlüssel (organization_id + invoice_number)

- Ein Datei-Ebenen-Import-Schlüssel plus ein Zeilen-Fingerprint (Hash der Schlüssel-Felder)

Retries sollten von vornherein sicher sein. Erzeuge beim Upload eine „Importsitzung“, speichere jede Zeile mit ihrem Ergebnis gegen diese Sitzung und füge pro Zeile einen Idempotency-Key hinzu, den du per Unique-Constraint in der Datenbank sicherst. Kommt dieselbe Zeile erneut, überspringe sie oder führe ein Update aus, je nach Regel.

Race-Conditions treten auf, wenn zwei Importe dieselben Datensätze gleichzeitig verändern. Nutze Datenbank-Constraints als letzte Absicherung und kontrolliere die Parallelität. Beispiel: verarbeite Importe für denselben Tenant nacheinander oder sperre beim Schreiben nach einem natürlichen Schlüssel.

Teilfehler ohne Datenkorruption

Teilfehler sind normal bei Kundendateien. Das Risiko sind nicht ein paar fehlerhafte Zeilen, sondern halb geschriebene Daten, die den Rest der App kaputt machen.

Dein Ziel sollte einfach sein: Der Import endet in einem bekannten guten Zustand, oder die Datenbank bleibt unverändert.

Wähle eine klare Fehler-Policy

Wähle eine Policy und mache sie in der UI sichtbar:

- Alles-oder-nichts: jede ungültige Zeile lehnt den gesamten Import ab

- Teilweise Akzeptanz: gültige Zeilen werden gespeichert, ungültige werden berichtet

- Schwellenwert: akzeptiere nur, wenn Fehler unter einem Satz Limit bleiben (z. B. 2%)

Was auch immer du wählst, füge einen Staging-Schritt hinzu. Parse und validiere in eine Staging-Tabelle (oder temporären Speicher) zuerst. Schreibe finale Datensätze nur, nachdem der Batch Prüfungen besteht. Erlaubst du partielle Akzeptanz, stage trotzdem zuerst und committe dann nur die guten Zeilen in kontrollierten Transaktionen pro Batch.

Verfolge pro Zeile das Ergebnis, damit du ohne Rätselraten erklären kannst, was passiert ist. Ein kleines Set an Statuswerten reicht: success, failed, skipped (duplicate/empty), updated (hat einen vorhandenen Datensatz gematcht).

Abhängige Zeilen vorsichtig behandeln

Abhängigkeiten sind die Stelle, an der partielle Importe gefährlich werden.

Beispiel: eine CSV enthält Customers und Orders. Ein Order zu speichern ohne den zugehörigen Customer erzeugt kaputte Daten.

Wähle eine Regel und halte dich daran:

- Eltern zuerst verlangen (child-Zeilen fehlschlagen lassen, wenn der Parent fehlt)

- Zwei-Pass-Import (erst Eltern laden, dann Kinder)

- Abhängige Zeilen quarantänisieren (Kinder zurückhalten, bis Parent erstellt ist)

Wenn du „teilweisen Erfolg“ meldest, verwende klare Sprache: wie viele Zeilen wurden gespeichert, wie viele nicht und ob etwas übersprungen oder aktualisiert wurde.

Nutzerfreundliche Fehlerberichte, die man tatsächlich beheben kann

Ein CSV-Import kann technisch korrekt sein und trotzdem als kaputt empfunden werden, wenn der Fehlerbericht verwirrend ist. Das Ziel ist: den Leuten sagen, was passiert ist, was sie beheben müssen und wie sie es erneut versuchen, ohne zu raten.

Beginne mit einer einfachen Zusammenfassung oben: Gesamtzeilen, importiert, übersprungen, fehlgeschlagen. Bei partiellem Erfolg sag klar, dass einige Zeilen gespeichert wurden.

Dann zeige zeilenweise Details, die auf das genaue Problem hinweisen:

- Zeilennummer (so wie der Nutzer sie in der CSV sieht)

- Spaltenname

- Den erhaltenen Wert

- Was erwartet wurde (Format oder Regel)

- Eine kurze, handlungsfähige Nachricht

Mache Meldungen spezifisch. „Ungültiger Wert“ ist frustrierend. „Datum muss JJJJ-MM-TT sein, gefunden: 3/7/24“ lässt sich beheben. Wenn ein Feld nur wenige Optionen zulässt, liste sie auf.

Vermeide das Offenlegen sensibler Details. Zeige keine Stacktraces, SQL-Fehler, internen IDs oder irgendetwas, das auf Sicherheitskonfigurationen hindeutet. Mappe interne Fehler auf sichere Meldungen wie: „Wir konnten diese Zeile nicht speichern. Bitte versuchen Sie es erneut oder kontaktieren Sie den Support, wenn das Problem wiederholt auftritt."

Mach das erneute Hochladen schmerzfrei. Bewahre die einmal gewählte Spaltenzuordnung und biete eine Fehlerdatei an, die sie bearbeiten und erneut hochladen können (oft die Originalzeilen plus eine zusätzliche "error"-Spalte).

Schritt-für-Schritt: ein produktionsbereiter Import-Workflow

Ein Workflow, der mit echten Daten überlebt, geht davon aus, dass etwas schiefgehen wird: ein falsches Datum, ein fehlendes Pflichtfeld, ein doppelter Schlüssel oder eine größere Datei als erwartet.

Der Workflow

-

Erzeuge zuerst eine Importsitzung. Wenn der Nutzer eine Datei hochlädt, lege eine Importsitzung mit Upload-Infos, erwarteter Schema-/Version und Status (queued/running/complete) an. Speichere die Rohdatei in dauerhaftem Speicher und ihre Checksumme, damit du beweisen kannst, was verarbeitet wurde.

-

Stream-parse und stage in Batches. Parse die CSV als Stream und schreibe Zeilen in eine Staging-Tabelle (oder temporären Speicher) in kleinen Batches (z. B. 500–2.000 Zeilen). Das hält den Speicher stabil und gibt sichere Checkpoints.

-

Validiere pro Zeile, protokolliere Fehler, und fahre fort. Normalisiere Werte (Trim, Datumsparsing, Enum-Mapping) und führe dann zeilenweise Regeln aus. Statt Exceptions zu werfen, schreibe strukturierte Fehler, die an die Importsitzung und die Zeilennummer gebunden sind (Feld, Nachricht, Originalwert).

-

Committe nur gültige Zeilen mit sicheren Upserts. Verschiebe gültige gestagte Zeilen in finale Tabellen innerhalb kontrollierter Transaktionen. Nutze Unique-Keys und Upserts, damit Duplikate keine zusätzlichen Datensätze erzeugen.

-

Erzeuge eine nutzerorientierte Zusammenfassung. Speichere Metriken: verarbeitete Zeilen, importierte Zeilen, fehlgeschlagene Zeilen und Top-Fehlertypen. Erzeuge einen Fehlerbericht, den Nutzer filtern und beheben können.

Beispiel: Importiert ein Nutzer 50.000 Kunden und 312 Zeilen haben ungültige E-Mails, importierst du trotzdem die anderen 49.688 und gibst einen Bericht mit exakten Zeilennummern und Korrekturhinweisen zurück.

Retry ohne erneutes Hochladen

Unterstütze Retry über dieselbe Importsitzung: behalte die Originaldatei, dieselben Validierungsregeln und führe nach Korrektur erneut aus. Damit das verlässlich wirkt, braucht der Retry-Pfad dieselben Idempotency-Regeln wie der erste Lauf.

Performance- und Zuverlässigkeits-Guidelines

Ein CSV-Import ist eine lang laufende Aufgabe. Behandle ihn auch so. Läuft er in einem normalen Web-Request, riskierst du Timeouts, eingefrorene UIs und halb fertige Schreibvorgänge. Lege Importe in einen Hintergrund-Job und lass die UI den Fortschritt abfragen, damit die App reaktionsfähig bleibt.

Fortschrittsanzeigen sollten echt sein, nicht nur „arbeitet noch“. Tracke Stadien (upload, parse, validate, write, finalize) und zähle Dinge wie gelesene Zeilen, akzeptierte Zeilen, abgelehnte Zeilen und vergangene Zeit.

Setze Limits, damit eine schlechte Datei dein System nicht monopolisiert:

- Maximale Laufzeit pro Import (bei Überschreitung klare Meldung und isolierte Teilarbeit behalten)

- Batch-Größen-Limits (kleinere Batches reduzieren Lock-Zeit und Speicherspitzen)

- Maximale Fehlermenge vor Stopp (z. B. nach 200 fehlerhaften Zeilen stoppen)

- Max Dateigröße und Max Spaltenanzahl (früh ablehnen)

- Maximale parallele Importe pro Workspace/Account

Backpressure ist wichtig, wenn die Datenbank langsamer schreibt als der Reader liest. Wenn Writes ins Hintertreffen geraten, verlangsame den Reader oder pausiere das Parsen. Ansonsten wächst der Speicher, bis der Worker crasht und du State verlierst.

Mach alles beobachtbar. Logge Import-ID, wer ihn gestartet hat, Dateimetadaten und Laufzeiten pro Stage. Füge Basismetriken wie Zeilen/sekunde und Datenbank-Schreibzeit hinzu. Wenn jemand sagt „Imorte funktionieren nicht“, willst du schnell Antworten.

Plane für Abbruch. Wenn jemand die falsche Datei hochlädt, soll er sicher stoppen können. Halte Writes in kleinen Transaktionen und stage eingehende Zeilen. Bei Abbruch oder Fehler lösche Staging-Daten und markiere die Importsitzung als canceled, damit ein Retry sauber neu startet.

Häufige Fehler, die Abstürze oder fehlerhafte Importe verursachen

Die meisten Produktionsprobleme bei Importen sind keine „Big Data“-Probleme, sondern kleine Annahmen, die erst bei echten Kundendateien brechen.

Ein häufiger Fehler ist, der Header-Zeile zu vertrauen. Leute benennen Spalten um, fügen Leerzeichen hinzu oder exportieren aus einem anderen System. Wenn du nicht die benötigten Spalten verifizierst und sie explizit mapst, können Werte in die falschen Felder rutschen und du merkst es erst später.

Excel-Exporte fügen eigene Fallen hinzu. Führende Nullen in IDs verschwinden, lange Zahlen werden in wissenschaftliche Notation verwandelt und Daten können als Text, Seriennummern oder gemischte Formate in derselben Spalte kommen. Wenn dein Importer Typen rät, bekommst du stille Korruption statt einer klaren „Zeile 42: ungültiges Datum“-Meldung.

Variationen im Dateiformat sind eine weitere Fehlerquelle: UTF-16-Dateien, Byte-Order-Marks, Semikolon statt Komma oder gequotete Felder mit eingebetteten Newlines. Erwartet dein Parser ein perfektes Format, kann eine einzelne abweichende Datei den Prozess aufhängen oder Zeilen durcheinanderbringen.

Einige Muster, die regelmäßig Abstürze oder fehlerhafte Importe verursachen:

- Eine einzige große Transaktion für Hunderttausende von Zeilen (zu lange Locks, Timeouts, Ressourcenspitzen)

- Jedes leere Feld als invalid behandeln, auch wenn Felder optional sind

- Zeilen direkt schreiben ohne Idempotency-Checks (Retries erzeugen Duplikate)

- Eine generische Rückmeldung wie „Import fehlgeschlagen“ ohne Zeilennummern oder Spaltennamen

- Validierung und Schreiben vermischen, sodass partielle Fehler schwer wiederherstellbar sind

Beispiel: Ein Nutzer lädt 200k Kontakte, 50 Zeilen haben falsche Daten. Rollst du alles zurück und zeigst nur einen vagen Fehler, wird er erneut hochladen, Duplikate erzeugen oder aufgeben.

Kurze Checkliste und nächste Schritte

Wenn du Importe willst, die die App nicht zum Absturz bringen, ziele auf Vorhersehbarkeit und Datenkonsistenz.

Eine einfache Produktions-Checkliste:

- Setze klare Limits (max Zeilen, max Dateigröße, erforderliche Header)

- Parse als Stream, nicht indem du die ganze Datei in den Speicher lädst

- Validere jede Zeile früh (Typen, Pflichtfelder, Bereiche, Beziehungsprüfungen)

- Mach es idempotent (Duplikaterkennung und sichere Retries)

- Stage und committe in kleinen Batches, damit du kontrollierst, was geschrieben wird

Entscheide deine Policy für Teilfehler im Voraus und halte sie konsistent. Viele Teams wählen „gute Zeilen akzeptieren, schlechte Zeilen ablehnen“, aber nur wenn die Zusammenfassung klar ist und die Writes sicher passieren.

Ein kurzer Testplan vor dem Ausrollen von Änderungen:

- Eine kleine saubere Datei

- Eine Datei mit bekannten fehlerhaften Zeilen (fehlende Werte, falsche Daten)

- Eine große Datei nahe deinem Max-Limit

- Ein doppeltes Hochladen derselben Datei

- Ein Retry nach Unterbrechung (mittendrin stoppen, dann fortsetzen)

Wenn du einen AI-generierten Importer geerbt hast, der unter Last crasht oder Duplikate produziert, lässt sich das meist beheben, ohne die ganze App neu zu schreiben. FixMyMess (fixmymess.ai) konzentriert sich auf das Diagnostizieren und Reparieren von AI-generierten Codebasen, einschließlich Import-Flows, die Staging, Idempotency und sicherere Validierung brauchen, um in Produktion zu funktionieren.

Häufige Fragen

Why does my CSV import work with 1,000 rows but fail with 300,000?

Große Importe schlagen meist fehl, weil der Code die gesamte Datei in den Arbeitsspeicher liest, alle Validierungen auf einmal ausführt oder versucht, alles innerhalb einer einzigen Web-Anfrage zu schreiben. Das führt zu Speicherspitzen, Timeouts und halb geschriebenen Daten, wenn der Prozess abgebrochen wird.

What is stream parsing, and why is it safer than loading the whole file?

Stream-Parsing liest die Datei stückweise und verarbeitet Zeilen, sobald sie eintreffen, sodass der Speicherbedarf flach bleibt. Es ermöglicht auch Fortschrittsanzeigen, das Behandeln einzelner fehlerhafter Zeilen ohne Absturz und hält die Anwendung während langer Importe reaktionsfähig.

What should I validate before I process any rows?

Führe zuerst Datei-Level-Prüfungen durch: ist die Datei leer, existiert eine Header-Zeile, sind erforderliche Spalten vorhanden und lassen sich Encoding und Delimiter parsen. Wenn die Struktur falsch ist, stoppe früh mit einer klaren Meldung, damit du nicht Zeit mit Müll verbringst.

How do I stop one bad row from crashing the entire import?

Validiere jede Zeile unabhängig und zeichne Fehler auf, anstatt Ausnahmen zu werfen, die den gesamten Import stoppen. Halte Meldungen handhabbar, indem du Zeilennummer, Spalte, das Problem und das erwartete Format angibst.

Should my import be all-or-nothing or allow partial success?

Wähle eine Richtlinie und mache sie deutlich: All-or-nothing, Partial success oder eine Schwelle (z. B. abbrechen, wenn mehr als 2% ungültig sind). Partial success ist oft benutzerfreundlicher, erfordert aber Staging und sorgfältige Schreibvorgänge, damit keine gebrochenen Beziehungen entstehen.

How do I prevent duplicates when users re-upload or retry an import?

Behandle Retries als normalen Fall: Nutzer klicken doppelt, Browser wiederholen und Kollegen laden dieselbe Datei hoch. Vergib eine Importsitzung und einen Idempotency-Key (z. B. basierend auf stabilen Schlüsseln oder einem Zeilen-Fingerprint) und erzwinge Einzigartigkeit in der Datenbank, damit erneute Verarbeitung keine Duplikate anlegt.

How do I avoid partial writes that leave my database inconsistent?

Stage die Daten zuerst, dann committe gültige Zeilen in kleinen, kontrollierten Transaktionen. Vermeide eine riesige Transaktion für die gesamte Datei und schreibe nicht direkt in die finalen Tabellen, während du noch Fehler entdeckst—das führt zu halb fertigen Importen, die schwer zu erklären oder zurückzusetzen sind.

Why should CSV imports run as background jobs instead of inside the web request?

Große Importe sollten nicht in einem normalen Request laufen. Lege den Import als Hintergrundjob an, speichere den Fortschritt in einer Importsitzung und lasse die UI den Status abfragen, damit die Seite nicht einfriert und die Arbeit nicht durch Request- oder Serverless-Limits beendet wird.

What should a user-friendly error report include?

Gib zuerst eine Zusammenfassung (insgesamt, importiert, fehlgeschlagen, übersprungen/aktualisiert), dann zeige zeilenweise Details, die genau mit der CSV übereinstimmen: Zeilennummer, empfangener Wert, erwartete Regel und eine kurze, handlungsfähige Nachricht. Vermeide Stacktraces oder SQL-Fehler, damit keine sensiblen Details offengelegt werden.

Can FixMyMess help if my AI-built CSV importer keeps failing in production?

FixMyMess spezialisiert sich auf die Reparatur von AI-generierten Apps, die in Produktion versagen, einschließlich CSV-Import-Flows, die abstürzen, Zeitüberschreitungen verursachen oder Duplikate erzeugen. Wenn dein aktueller Import unzuverlässig ist, können wir den Code auditieren, Streaming, Staging, Idempotency und klare Berichte hinzufügen und ihn ohne Rätselraten sicher machen.