Warum kleine Änderungen bei KI‑Code länger dauern als neue Funktionen

Erfahre, warum kleine Fehlerbehebungen bei KI‑Code länger dauern als neue Funktionen — mit klaren Beispielen zu versteckter Kopplung, fehlenden Absicherungen und wie man den Arbeitsumfang realistisch einschätzt.

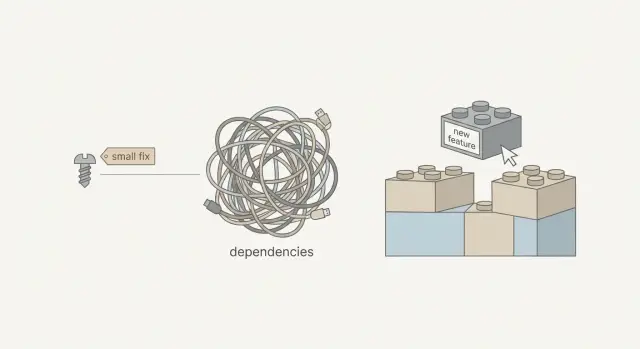

Warum eine „kleine Änderung" zu einem großen Job werden kann

Teams erleben oft dieselbe Überraschung bei KI‑gebauten Prototypen: Jemand zeigt auf den Bildschirm und sagt: „Das ist nur eine kleine Änderung. Zehn Minuten.“ Dann dauert die Reparatur einen halben Tag (oder ein paar Tage) und der Zeitplan wirkt zufällig.

Wenn Leute „kleine Änderung" sagen, meinen sie meist: eine Sache an einer Stelle ändern, mit geringem Risiko und schneller Prüfung.

In echtem Code verbirgt „klein" oft Mehrarbeit:

- Die „eine Sache" wird in mehreren Dateien, Bildschirmen oder Services verwendet.

- Die Änderung berührt Daten, die gespeichert, geladen, validiert und angezeigt werden müssen.

- Es gibt keine Tests, also muss alles manuell geprüft werden.

- Die sicherste Lösung umfasst das Bereinigen benachbarter Probleme, die du nicht geplant hattest.

Diese Diskrepanz erklärt, warum Bugfixes länger dauern können als neue Features. Neue Features lassen sich oft am Rand der App hinzufügen. Fixes müssen in die Pfade, auf die sich Nutzer verlassen, und verlangen daher mehr Sorgfalt und Prüfung.

Zwei Ursachen tauchen immer wieder auf: versteckte Kopplung und fehlende Absicherungen.

Versteckte Kopplung heißt, Teile der App hängen auf eine Weise voneinander ab, die man nicht aus der UI sieht. Ein „Rename" kann stillschweigend von einer Datenbankspalte, einem Validator, einer Login‑Regel und einer Dashboard‑Abfrage abhängen, zusammengehalten durch kopierten Code.

Fehlende Absicherungen bedeuten, dass das Prototyp auf Schutzmaßnahmen verzichtet hat, die Änderungen sicher machen: klare Fehlerbehandlung, sinnvolle Defaults, Eingabeprüfungen und einfache automatisierte Tests. Ohne sie kann eine kleine Änderung irgendwo anders einen Fehler erzeugen.

Der Punkt ist nicht, Fixes gruselig klingen zu lassen. Sondern den Umfang und die Zeitpläne nachvollziehbar zu machen. Wenn du auf Kopplung und fehlende Absicherungen hinweisen kannst, wirkt die Arbeit weniger willkürlich und mehr wie Untersuchung, Aufräumen und sorgfältiges Testen.

Versteckte Kopplung, ohne Fachjargon erklärt

Kopplung ist simpel: Zwei Teile der App hängen voneinander ab. Wenn du einen Teil änderst, kann der andere brechen. Etwas Kopplung ist normal. Problematisch wird es, wenn die Verbindungen eng, undurchsichtig und verstreut sind.

Versteckte Kopplung liegt vor, wenn diese Verbindungen nicht offensichtlich aus der Oberfläche hervorgehen. Ein Button wirkt wie „nur UI“, beeinflusst aber Login, Abrechnung, E‑Mails oder Datenbankregeln, weil hinter den Kulissen alles verknüpft ist.

Stell dir eine Mauer aus Ziegeln vor, bei der ein Ziegel gleichzeitig ein Regal, eine Lampe und ein Rohr stützt. Von außen sieht es nach einem einzelnen Ziegel aus. Ziehst du ihn heraus, verschieben sich drei andere Dinge. Die Reparatur ist nicht unmöglich; sie braucht nur Zeit, weil du herausfinden musst, was der Ziegel noch trägt.

KI‑generierte Prototypen haben oft mehr versteckte Kopplung, weil Code schnell erstellt und durch Kopieren wiederverwendet wird. Anstatt einen klaren Ort für „Signup‑Regeln" zu haben, gibt es mehrere leicht unterschiedliche Versionen. Einen Bug an einer Stelle zu beheben kann zwei weitere Stellen unberührt lassen oder einen Widerspruch zwischen Flows erzeugen.

Ein paar Anzeichen für versteckte Kopplung:

- Dieselbe Logik taucht in mehreren Dateien mit kleinen Abweichungen auf.

- Eine geteilte Variable (globaler Zustand) wird überall verwendet, sodass Änderungen wellen schlagen.

- Grenzen sind unklar (UI‑Code ändert direkt Datenbankdaten).

- Ein Fix funktioniert in einem Flow, bricht aber einen anderen, der „nicht verwandt“ sein sollte.

- Der Code ist voller Schnelllösungen, z. B. extra if‑Statements für Randfälle.

Ist das die Realität, ist eine „kleine Änderung" nicht nur ein Edit. Es heißt: die versteckten Verbindungen finden, sie sicher ändern und dann die Flows erneut prüfen, die stillschweigend vom alten Verhalten abhängig waren.

Fehlende Absicherungen: die Leitplanken, die Prototypen überspringen

Absicherungen sind die Leitplanken der Software. Sie fügen keine neuen Buttons oder auffälligen Features hinzu, verhindern aber, dass kleine Änderungen in überraschende Ausfälle münden.

Prototypen überspringen sie oft aus Geschwindigkeit: Demo zum Laufen bringen. Die Kosten zeigen sich später, wenn die App auf echte Nutzer, echte Daten und echte Randfälle trifft.

Gängige fehlende Absicherungen sind:

- Automatisierte Prüfungen für Schlüssel‑Flows (Signup, Zahlungen, Speichern von Daten)

- Klare Datentypen/-formen (damit der Code nicht stillschweigend den falschen Wert durchreicht)

- Eingabevalidierung (damit unsaubere Daten die App nicht abstürzen lassen)

- Berechtigungsprüfungen (damit Nutzer nicht auf Dinge zugreifen, die sie nicht sollten)

- Sicherer Umgang mit Fehlern (Timeouts, fehlende Datensätze, leere Zustände)

Ohne diese wird jede Änderung zu einem Ratespiel. Du kannst beheben, was sichtbar ist, aber keine Gewissheit darüber haben, was nicht sichtbar ist.

Beispiel: Du machst das Feld „Telefon" optional, um die Anmeldung zu vereinfachen. Das Backend geht aber weiterhin davon aus, dass das Telefon immer vorhanden ist. Nun versagt die App nur bei einigen Nutzern, und erst später im Prozess. Die „kleine Änderung" wird zur Suche nach der Annahme, zum Hinzufügen von Prüfungen und zum Nachweis, dass das Problem wirklich behoben ist.

Absicherungen kosten vorne Zeit, deshalb fügen Teams sie später hinzu. Sie wirken „extra“, bis der erste reale Bug in Produktion auftaucht. Bei Reparaturen an KI‑generiertem Code ist eine praktikable Vorgehensweise oft: Zuerst das unmittelbare Problem beheben, dann die kleinste Absicherung rundherum ergänzen, damit dieselbe Fehlerklasse nicht nächste Woche zurückkommt.

Warum KI‑generierter Code „kleine" Fixes riskanter macht

KI‑Tools bringen dich schnell zu einem Demo. Der Nachteil ist, dass der Code oft nur den Happy‑Path abdeckt: die eine Klickfolge, die das Tool beim Generieren „erwartet" hat. Eine kleine Änderung kann Nutzer auf Pfade bringen, die nie getestet wurden.

KI‑generierter Code kann auch fertiger wirken, als er ist. Die Bildschirme sehen poliert aus, es gibt viele Dateien, und es fühlt sich „echt" an. Darunter können fragile Annahmen liegen wie „dieser Wert ist immer vorhanden" oder „diese API liefert immer dieselbe Struktur." Wenn deine Änderung diese Annahme bricht, fällt die App anderswo aus und du jagst einer Kettenreaktion hinterher.

Copy‑Paste‑Logik ist ein weiteres häufiges Problem. „Ändere die Validierungsregel" ist kein einzelnes Edit, wenn diese Logik fünfmal existiert. Wenn du eine Kopie übersiehst, bekommen Nutzer inkonsistentes Verhalten, das Tage braucht, um bemerkt zu werden.

Du siehst außerdem unklare Datenflüsse: Dasselbe Datum wird mehrfach auf unterschiedliche Weise transformiert, bevor es in die Datenbank oder die UI gelangt. Das macht die Abgrenzung schwer, weil du nicht weißt, wo die eigentliche Quelle der Wahrheit liegt, bis du sie zurückverfolgt hast.

Typische „kleine Änderungs"‑Anfragen, die zu größeren Reparaturen aufweiten:

- Ein neues Feld speichern wollen, aber die App hat zwei verschiedene Modelle für dasselbe Objekt.

- Eine UI‑Anpassung ändert das Timing und legt eine Race‑Condition offen.

- Ein Aufräumen offenbart exponierte Secrets oder fehlende Berechtigungsprüfungen.

- Ein Randfall tritt auf (leerer Zustand, langsames Netzwerk) und Fehler werden nicht behandelt.

- Eine Änderung berührt Auth und Anmeldungen brechen über Sessions, Redirects und Callbacks.

Ein konkretes Beispiel: „Require phone number on signup.“ Das kann bedeuten, das Formular, die Validierung, das Datenbankschema, E‑Mails oder Onboarding‑Schritte zu aktualisieren und sicherzustellen, dass bestehende Nutzer nicht ausgesperrt werden. Ohne Tests und klare Fehlerbehandlung muss jeder Schritt manuell verifiziert werden.

Wenn du mit Code von Tools wie Lovable, Bolt, v0, Cursor oder Replit arbeitest, ist der schnellste Weg oft: zuerst Annahmen finden, die Ursache einmalig beheben und vermeiden, dass man dasselbe Symptom an mehreren Stellen patcht.

Wie man eine „kleine Änderung" Schritt für Schritt scope't

Wenn jemand „das ist ein kleiner Fix" sagt, stellt er sich eine Codezeile vor. In unordentlichen Projekten kann eine einzelne Anfrage UI, API, Datenbank und Auth berühren.

Ein praktischer Scoping‑Flow

Mach das Problem reproduzierbar. Wenn du es nicht auf Abruf auslösen kannst, kannst du es nicht schätzen. Schreibe die genauen Klicks, Eingaben und das erwartete Ergebnis auf – plus das, was tatsächlich passiert.

Dann mache einen schnellen „Wo lebt das?“‑Check. Viele Bugs sehen nach UI‑Problemen aus, sind aber Backend‑Regeln, Datenbankdaten oder Auth‑Randfälle.

Eine einfache Checkliste, die meist ausreicht:

- Reproduziere es zweimal und halte die genauen Schritte (und Fehlermeldungen) fest.

- Entscheide, welche Schicht das Verhalten besitzt: Frontend, Backend, Datenbank, Auth oder Drittanbieter.

- Verfolge die Daten Ende‑zu‑Ende: wo sie starten, wie sie sich ändern und wo sie enden.

Wenn du den Datenfluss siehst, liste die Touchpoints: geteilte Komponenten, wiederverwendete Endpunkte, Datenbank‑Constraints, Login‑Status, Caching und Webhook‑Handler.

Bevor du das Verhalten änderst, füge eine kleine Absicherung hinzu. Das kann ein winziger Test, eine Assertion oder sogar ein Log sein, das beweist, dass du die richtige Stelle änderst. Dieser Schritt verhindert oft, dass ein „Quick Patch" später zur zweiten Notfallreparatur wird.

Dann mache die Änderung und überprüfe angrenzende Flows, die häufig brechen: Signup, Login, Zahlungen, E‑Mails und Admin‑Aktionen. Schreibe zuletzt auf, was sich geändert hat und was du geprüft hast, damit der nächste Fix schneller geht.

Wie ein „fairer Umfang" aussieht

Ein verteidigungsfähiger Umfang ist nicht nur „fix den Bug." Er beinhaltet:

- Schritte zur Reproduktion

- die verantwortliche Schicht

- betroffene Touchpoints

- die Absicherung, die du hinzufügen wirst

- Regressionsprüfungen, die du durchführst

- eine kurze Notiz, was bestätigt wurde

Das gibt dir einen Zeitplan, den du erklären und verteidigen kannst.

Ein realistisches Beispiel: eine UI‑Änderung, die Signup bricht

Ein Gründer bittet um eine winzige Änderung: „Im Signup‑Formular ändere das Feldlabel von ‚Company‘ zu ‚Business name‘." Sieht nach fünf Minuten UI‑Arbeit aus. Dann bricht die Anmeldung.

Der Kniff: Das Frontend hat nicht nur das Label geändert, sondern auch den Feldnamen von company zu businessName. Das Backend erwartet noch company. Wenn das Formular abschickt, sieht der Server ein fehlendes Pflichtfeld und lehnt die Anfrage ab.

Der Bruch hört oft nicht dort auf. Fehlt dieser eine Wert, können Kaskadeneffekte auftreten: Validierung schlägt mit einer generischen „Something went wrong"‑Meldung fehl, Onboarding‑Schritte stürzen ab, Willkommens‑E‑Mails rendern Leerstellen wie „Hi ," und Analytics gruppieren Nutzer falsch.

Das ist versteckte Kopplung: Ein kleines Stück wird stillschweigend von vielen anderen Teilen gebraucht. Bei KI‑generierten Prototypen findet man häufig denselben Feldnamen an mehreren Stellen: Formkomponente, Schema‑Validator, API‑Handler, Datenbank‑Insert und Analytics‑Tracker. Keine dieser Stellen „kündigt" die Abhängigkeit an.

Fehlende Absicherungen verschlimmern es. Gibt es keine Signup‑Tests, bemerkt es niemand vor dem Deploy, wenn reale Nutzer den fehlerhaften Pfad treffen. Die „kleine Änderung" umfasst dann Debugging in Produktion, Log‑Analyse und Bestätigung, welche Daten in die DB geschrieben wurden (oder nicht).

Ein Plan, der das sicher hält, sieht meist so aus:

- Verfolge das Feld Ende‑zu‑Ende (UI, Validierung, API, DB, Tracking).

- Patch mit einem stabilen Contract (behalte

companybei oder mappebusinessNamedarauf). - Füge eine einfache Absicherung hinzu (mindestens ein Test oder eine serverseitige Prüfung mit klarer Fehlermeldung).

- Verifiziere den gesamten Flow in einer sauberen Umgebung (neuer Nutzer, Onboarding, E‑Mail, Analytics).

- Shippe und überwache kurz auf Überraschungen.

Fehler, die Fixes in die Länge ziehen

Die größte Zeitfalle ist, einen Fix so zu behandeln, als lebte er nur an einer Stelle. In KI‑gebauten Prototypen ist das sichtbare Problem oft nur der letzte Dominostein.

Eine häufige Falle ist, das Symptom im UI zu beheben, während die echte Ursache in der Datenverarbeitung oder Auth liegt. Ein Button wirkt „kaputt", weil der API‑Call fehlschlägt, aber die wirkliche Ursache ist eine fehlende Rolle, eine abgelaufene Session oder ein Datensatz, der nie korrekt gespeichert wurde.

Quick Patches häufen Technical Debt schnell an. Ein zusätzlicher Sonderfall funktioniert heute, aber macht morgen Änderungen schwerer. Du sitzt auf Code voller Ausnahmen, dem niemand vertraut.

Muster, die Arbeit länger ziehen als erwartet:

- Nur den einen berührten Screen testen, nicht verwandte Flows wie Onboarding, Passwort‑Reset, Billing oder Admin‑Rollen.

- Datenformat ändern (Feldnamen, Typen, Pflichtfelder) ohne Validierung und DB‑Migrationen anzupassen.

- Sicherheitsprüfungen überspringen, weil es „lokal funktioniert", und später exponierte Secrets oder schwache Auth entdecken.

- Einen Endpunkt oder Query fixen, ohne zu prüfen, wo sonst noch darauf zugegriffen wird.

- „Temporäre" Logik hinzufügen, die nie wieder entfernt wird.

Eine Checkliste, bevor du eine Frist versprichst

Ein Fix bleibt nur klein, wenn alle zustimmen, was kaputt ist, wo es kaputt ist und was „done" bedeutet.

Bestätige zuerst, dass das Problem reproduzierbar ist. Wenn es nur „manchmal" auftritt oder nur auf einem Laptop, bist du nicht bereit, ein Datum zu versprechen. Ziele auf 2–3 klare Schritte, die es konsistent auslösen.

Sei als Nächstes explizit zur verantwortlichen Schicht. Dasselbe Symptom kann unterschiedliche Ursachen haben: UI, API, DB oder Auth. „Login geht nicht" kann ein Cookie‑Problem, eine fehlende Session‑Prüfung oder ein nie gespeicherter Nutzer sein.

Bevor jemand den Code anfasst, vereinbare eine Prüfung, die den Fix beweist und ihn erkennt, falls er zurückkehrt. Das kann ein kleiner automatisierter Test, ein reproduzierbares manuelles Script oder ein Log‑Check sein, der bestätigt, dass der richtige Pfad läuft.

Nenne außerdem wahrscheinlich auftretende Nebenwirkungen. Drei sind meist genug, um den Umfang ehrlich zu halten:

- Wenn wir diese Validierung ändern, könnte das Signups blockieren?

- Wenn wir diese Query anpassen, könnte das Dashboard langsamer werden?

- Wenn wir Auth‑Regeln ändern, könnten bestehende Nutzer ausgeloggt werden?

Schließlich definiere, was ein Rollback bedeutet, falls in Produktion etwas schiefgeht. Es muss nichts Kompliziertes sein, aber real: schnelles Revert, Feature‑Flag oder eine sichere Methode, vorheriges Verhalten wiederherzustellen.

Wenn du KI‑generierten Code übernimmst und diese Antworten schwer zu bekommen sind, nimm Discovery‑Zeit in die Schätzung auf. Das ist kein Puffer, sondern die Arbeit, um Vermutungen durch Beweise zu ersetzen.

Wie du den Umfang so erklärst, dass er fair wirkt

Wenn jemand nach einer „kleinen Änderung" fragt, stellt er sich einen schnellen Edit vor. Ein fairer Umfang trennt die sichtbare Änderung von der Arbeit, die nötig ist, sie sicher zu machen.

Erkläre Unbekannte als konkrete Prüfungen, nicht als Ausreden. Zum Beispiel: „Bevor wir das Button‑Verhalten ändern, müssen wir bestätigen, wo das Verhalten definiert ist, wer es sonst noch nutzt und was einen Ausfall erkennen würde." Das ist Untersuchung, kein Verzögern.

Timeboxes helfen, weil sie einen klaren Entscheidungspunkt schaffen:

- Discovery: verfolge, wo die Änderung liegt, mappe Abhängigkeiten, entdecke Sicherheitsfragen

- Implementation: mach die Änderung mit minimalem Blast‑Radius

- Verification: teste Schlüssel‑Flows und riskante Randfälle

Setze Akzeptanzkriterien in Benutzersprache, nicht in Codebegriffen. „Fix“ sollte etwas beobachtbares bedeuten:

- Der Nutzer kann sich anmelden, die Aktion abschließen und das richtige Ergebnis sehen.

- Schlüsselflows werfen keine neuen Fehler (Signup, Checkout, Admin‑Seiten).

- Berechtigungen funktionieren weiterhin (Nutzer sehen keine fremden Daten).

- Keine Secrets werden offengelegt und offensichtliche Sicherheitslücken werden nicht eingeführt.

Wenn du die Wahl hast, präsentiere sie klar: ein minimaler Fix jetzt (schneller, höhere Rückfallchance) oder ein sicherer Fix mit Absicherungen wie Validierung, Berechtigungsprüfungen und grundlegenden Tests.

Nächste Schritte, wenn dein KI‑Prototyp dich ständig ärgert

Wenn jede „kleine Änderung" einen neuen Bruch auslöst, halte an, bevor du weitere Features hinzufügst. Dieses Muster bedeutet meist: Der Code ist verwoben; ziehst du an einem Faden, zieht sich irgendwo anders alles zusammen.

Entscheide: Quick Fix, Refactor oder Rebuild

Aus einem „Fix" wird ein Refactor, wenn der Code aufgeräumt werden muss, damit Änderungen sicher möglich sind. Achte auf Zeichen wie wiederkehrende Bugs, dass eine Änderung unzusammenhängende Bereiche bricht (Login, Checkout, Admin), Angst, den Code anzufassen, unklare Grenzen und fehlende Sicherheitsgrundlagen (Secrets im Code, schwache Auth, unsichere Datenbankaufrufe).

Manchmal ist ein Rebuild billiger als endlose Flickarbeit. Wenn jede Woche eine neue Überraschung bringt oder ständig Sicherheitsprobleme auftauchen, kann das Neuaufbauen der Kernflüsse weniger kosten als Monate von Whack‑a‑Mole.

Sammle die richtigen Infos, bevor du um Hilfe bittest

Du kannst Stunden sparen, wenn du ein klares „Bug‑Paket" statt einer vagen Anfrage schickst:

- Repo‑Zugriff (oder ein Zip) und Umgebungs‑Hinweise (Keys, Services, wo es läuft)

- Exakte Schritte zur Reproduktion, aus einer frischen Sitzung gestartet

- Screenshots oder eine kurze Bildschirmaufnahme

- Erwartetes Ergebnis vs. tatsächliches Verhalten

- Jeglicher Fehlertext (kopiere/einfüge ihn)

Füge einen Satz hinzu, was sich zuletzt verändert hat. Bei KI‑generierten Projekten weist das oft direkt auf die versteckte Kopplung hin.

Wenn du ein externes Team hinzuziehen willst, beginnt FixMyMess (fixmymess.ai) mit einer Codebasis‑Diagnose und bietet ein kostenloses Code‑Audit für KI‑generierte Apps an. Das ist ein direkter Weg, um herauszufinden, was tatsächlich mit deiner „kleinen Änderung" verbunden ist, bevor du einen Zeitplan festlegst.

Häufige Fragen

Warum wurde aus meiner „10‑Minuten‑Änderung“ ein halbtägiger Fix?

Eine „kleine“ UI‑Anforderung ändert häufig heimlich Daten‑Schlüssel, Validierungsregeln oder API‑Payloads. Wenn dieser Wert an mehreren Stellen verwendet wird, musst du alle aktualisieren und anschließend die darauf angewiesenen Flows erneut prüfen.

Was bedeutet „versteckte Kopplung“ eigentlich?

Hidden coupling bedeutet, dass Teile deiner App auf eine Weise voneinander abhängen, die nicht offensichtlich aus der Oberfläche hervorgeht. Du änderst eine Sache und etwas „Unrelatedes“ bricht, weil dieselbe Logik oder Daten an anderer Stelle stillschweigend geteilt werden.

Warum hat KI‑generierter Code eher versteckte Kopplungen?

KI‑generierte Prototypen kopieren oft ähnliche Logik in mehrere Dateien statt eine eindeutige Quelle der Wahrheit zu schaffen. Das macht das Verhalten inkonsistent und zwingt dich, jede Kopie zu finden, bevor der Fix wirklich fertig ist.

Was sind „Absicherungen“ und warum sind sie für kleine Änderungen wichtig?

Absicherungen sind grundlegende Schutzmaßnahmen wie Eingabevalidierung, Berechtigungsprüfungen, klare Fehlermeldungen und ein paar automatisierte Tests für wichtige Flows. Ohne sie wird jede Änderung zu manueller Untersuchung plus zusätzlicher Verifikation, um unerwartete Ausfälle zu vermeiden.

Was ist der schnellste Weg, einen Bug vor dem Coden „scopable“ zu machen?

Fordere exakte Schritte an, um den Fehler aus einer frischen Sitzung zu reproduzieren, die erwartete Ausgabe und das tatsächliche Ergebnis (inkl. vollständigem Fehlertest). Wenn sich der Fehler nicht zuverlässig auslösen lässt, ist jede Schätzung nur eine Vermutung.

Warum kann das Umbenennen eines Formularfelds die Anmeldung kaputtmachen?

Eine Umbenennung kann den Feldschlüssel ändern (z. B. von company zu businessName), nicht nur das Label. Wenn das Backend noch den alten Schlüssel erwartet, schlägt die Anfrage fehl und nachgelagerte Schritte wie Onboarding‑Mails oder Analytics können ebenfalls Fehler zeigen.

Warum können Bugfixes länger dauern als das Entwickeln eines neuen Features?

Neue Features lassen sich oft an den Rändern der App hinzufügen. Bugfixes greifen in die Pfade ein, auf die sich Nutzer verlassen, und erfordern daher mehr Nachverfolgung, Vorsicht und Regressionsprüfungen.

Wie finde ich heraus, ob ein Bug im Frontend, Backend, der Datenbank oder bei der Auth liegt?

Fange an, indem du die verantwortliche Schicht identifizierst: Frontend, Backend, Datenbank, Auth oder ein Drittanbieter. Verfolge dann die Daten Ende‑zu‑Ende, damit du weißt, wo der Wert herkommt, wie er sich ändert und wo er gebraucht wird.

Was ist die kleinste „Absicherung“, die sich während eines Fixes lohnt hinzuzufügen?

Die kleinstmögliche sinnvolle Absicherung ist eine fokussierte Ergänzung: ein kleiner automatisierter Test für den betroffenen Flow, eine serverseitige Prüfung mit klarem Fehler oder ein Log‑Statement, das bestätigt, dass der richtige Pfad ausgeführt wurde. Ziel ist, dieselbe Fehlerklasse künftig zu verhindern.

Wann sollten wir ein KI‑generiertes Prototyp refaktorisieren statt nur zu reparieren oder gleich neu bauen?

Wenn Änderungen immer wieder unerwartet andere Bereiche brechen, die Sicherheitsbasis fehlt und niemand das System ohne Angst anfassen kann, ist ein Rebuild oft günstiger als endlose Flickarbeit. FixMyMess (fixmymess.ai) bietet beispielsweise eine Codebasis‑Diagnose und ein kostenloses Audit für KI‑generierte Apps, um zu entscheiden, ob reparieren, refactoren oder neu aufbauen sinnvoll ist.