Controle de custos de logging para protótipos: retenção, amostragem, redação

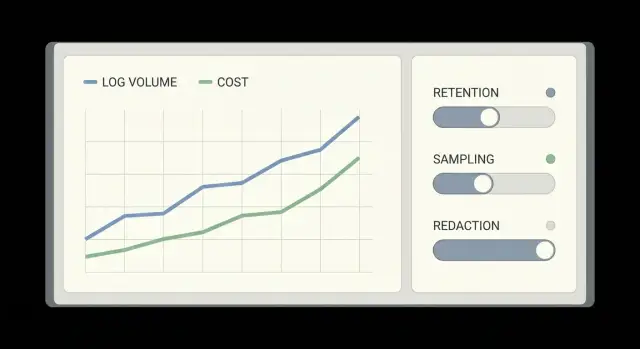

Controle de custos de logging: defina tiers de retenção, regras de amostragem e redação para que protótipos em rápido crescimento mantenham logs úteis sem contas surpresa.

Por que protótipos recebem contas surpresa de logging

Protótipos frequentemente começam com “logar tudo” porque parece mais seguro do que perder algo importante. Aí chegam usuários reais, o tráfego salta, e cada clique gera várias linhas de log no frontend, backend, auth, banco de dados e serviços terceiros. O que era um gotejar vira uma mangueira de incêndio, às vezes num único fim de semana.

Contas surpresa acontecem quando os custos escalam em mais de uma direção ao mesmo tempo. Você paga para ingerir volume de logs, armazená-los por mais tempo do que precisa e torná-los pesquisáveis. Logs também podem ser duplicados entre regiões, encaminhados para várias ferramentas ou extraídos para análise, o que acrescenta custos de egress e de query.

Os gatilhos mais comuns são simples:

- Logging de debug deixado ligado em produção

- Uma requisição criando muitos logs (retries, loops, clientes falantes)

- Campos de alta cardinalidade (IDs de usuário, URLs completas, tokens aleatórios) sendo indexados

- Retenção longa por padrão que ninguém revisita

- Payloads grandes despejados nos logs (corpos de requisição inteiros, stack traces repetidos)

“Logs úteis” para um time pequeno é mais simples do que parece. Você precisa basicamente responder: O que quebrou? Quem foi afetado? Quando começou? Dá para reproduzir? Isso normalmente significa um erro claro, um request ou trace ID, alguns campos de contexto chave e uma boa stack trace quando algo falha — não um diário de cada requisição bem-sucedida.

O objetivo é debugar rápido sem pagar para armazenar ruído.

De onde vêm de verdade os custos de logging

A maior parte das contas de logging reduz-se a alguns multiplicadores previsíveis que aparecem quando um protótipo ganha tráfego real.

Ingest é o primeiro fator. Cada evento de log precisa ser enviado e aceito por um serviço de logging. Se seu código loga a cada requisição, a cada retry e a cada tick de job em background, o volume sobe com usuários e com bugs.

Armazenamento e retenção vem a seguir. Manter logs brutos por 30 a 90 dias pode parecer seguro, mas é caro quando a maioria desses logs nunca é lida. Isso piora quando dev, staging e production mantêm a mesma retenção.

Busca e indexação é outra surpresa comum. Tornar “tudo pesquisável” muitas vezes significa indexar muito mais campos do que você realmente filtra no dia a dia.

Cardinalidade é o multiplicador oculto. Campos com muitos valores únicos (user IDs, tokens de sessão, URLs completas com query strings, texto de erro dinâmico) podem explodir o número de combinações únicas que sua ferramenta de logging tem que rastrear.

Um conjunto rápido de multiplicadores de custo a observar:

- Logs de “info” de alto volume a cada requisição

- Retenção longa em ambientes barulhentos (dev e staging)

- Indexar muitos campos por padrão

- Campos de alta cardinalidade usados como tags ou labels

- Pipelines duplicados que encaminham os mesmos logs duas vezes

Decida o que você realmente precisa dos logs

O controle de custos de logging começa com uma decisão: que perguntas você precisa que os logs respondam quando algo quebrar.

Para a maioria dos protótipos, os logs servem principalmente para:

- Erros e crashes (o que falhou, onde e por quê)

- Problemas de autenticação (falhas de login, erros de token, checagens de permissão)

- Pagamentos e faturamento (cobranças falhas, erros de webhook, eventos duplicados)

- Latência e timeouts (endpoints lentos, queries lentas, atrasos de terceiros)

Depois, decida quando você precisa de contexto completo e quando um resumo basta. Contexto completo ajuda em bugs novos ou incidentes de segurança, mas é caro. Para muitos eventos, um registro curto é suficiente: nome do evento, request ID, user ID (ou um hash seguro), código de status e duração. Deixe logging de “payload completo” para casos raros, protegido por uma flag, ou somente em erros.

Também ajuda traçar uma linha clara entre logs, métricas e traces:

- Logs dizem o que aconteceu para uma requisição específica.

- Métricas dizem com que frequência e quão ruim (taxa de erro, p95 de latência) sem grande volume.

- Traces mostram onde o tempo foi gasto entre serviços.

Se você empurrar tudo para logs, a conta cresce rápido e o debug continua confuso.

Por fim, classifique os dados em três categorias:

- Manter: erros, decisões de auth, mudanças de estado de pagamento, versão do deploy, request IDs

- Bom ter: detalhes de debug que você usa ocasionalmente

- Nunca logar: segredos, senhas, tokens de acesso, dados completos de cartão de crédito, mensagens pessoais brutas

Um exemplo simples: se um cadastro falha, logue o código de erro e o nome do campo que falhou na validação, não o corpo da requisição inteiro.

Defina tiers de retenção que batem com o uso real

Um bom plano de retenção assume uma verdade: você precisa de tipos diferentes de logs por prazos distintos. Se você guarda tudo pelo mesmo número de dias, ou perde detalhes que precisa, ou paga para armazenar ruído.

Uma configuração prática de retenção em 3 níveis

- Hot (curto): Logs de app e debug de alto volume usados para troubleshooting ativo. Mantenha 1–3 dias.

- Warm (médio): Logs de requisição padrão e eventos de negócio chave para follow-up de incidentes. Mantenha 7–14 dias.

- Cold (longo): Eventos de segurança e auditoria de baixo volume e alto valor (mudanças de auth, updates de permissão, ações administrativas). Mantenha 30–180 dias dependendo do risco e dos requisitos.

Hot deve ser pequeno, porém detalhado. Cold deve ser estável e pesquisável, não cheio de cada linha de debug.

Ambientes diferentes devem ter regras diferentes:

- Em dev, mantenha retenção curta (horas até 1 dia).

- Em staging, mantenha o suficiente para comparar releases (2–7 dias).

- Em production, mantenha warm e cold por mais tempo, mas seja rígido sobre o que se qualifica.

Como escolher números sem chutar

Comece pelo comportamento real:

-

Quanto tempo depois de um problema você normalmente o nota (no mesmo dia, no dia seguinte, na semana seguinte)?

-

Quanto tempo leva para reproduzir e confirmar uma correção?

-

Quais eventos você precisa manter por segurança ou suporte ao cliente?

Use amostragem para reduzir volume sem ficar no escuro

A amostragem mantém o sinal enquanto você para de pagar por cada mensagem de “tudo está OK”.

Comece com uma regra “errors first”: capture falhas a 100%. Isso inclui logs de erro, exceções, timeouts e qualquer requisição que retorne 4xx ou 5xx. Quando algo quebra, você quer a trilha completa.

Depois, mire nos caminhos de sucesso mais barulhentos. São frequentemente health checks, polling em background, retries barulhentos e endpoints atingidos a cada carregamento de página.

Regras práticas de amostragem que ainda permitem debugar

- Mantenha 100% de erros e warnings, além de qualquer requisição acima de um limiar de latência.

- Amostre respostas 200 de alto volume (por exemplo, mantenha 1 em 50).

- Adicione limites por endpoint (por exemplo, máximo de 20 logs de sucesso por minuto por rota).

- Mantenha eventos raros a 100% (reset de senha, cobrança, ações de admin).

- Elimine repetições: se a mesma mensagem ocorrer 1.000 vezes, mantenha as N primeiras e depois resuma.

Rate limits são a rede de segurança. Eles impedem que um bug (como um loop de retry) exploda seu volume de logs durante a noite.

Documente as regras em linguagem simples e mantenha-as estáveis. Amostragem previsível deixa o debug mais tranquilo porque você sabe o que está totalmente capturado e o que é amostrado intencionalmente.

Noções básicas de redação: proteja segredos e dados de usuários

A redação reduz risco e frequentemente reduz volume. O objetivo é simples: manter logs úteis para debugging sem capturar segredos ou dados pessoais que você não deveria armazenar.

Redacte na origem (no seu app), não depois na ferramenta de logs. Se um segredo for logado uma vez, ele pode ser copiado para backups, exportações e alertas.

Foque nos lugares que derramam dados:

- Request headers

- Cookies

- Payloads de autenticação

- Parâmetros de query

Campos comuns a tratar como arriscados incluem Authorization, Cookie, session IDs, campos de senha, links de reset, chaves de API e qualquer valor chamado “token”. Muitos frameworks também logam objetos de erro completos que incluem contexto de requisição, então verifique defaults.

Quando você precisa conectar eventos entre requisições, masque em vez de deletar. Por exemplo, mantenha apenas os 4 últimos caracteres de um token, ou registre um hash unidirecional de um e‑mail em vez do e‑mail em texto claro.

Uma regra rápida para PII: evite logar nomes, e‑mails, telefones, endereços e IPs, salvo quando tiver uma razão clara e uma política de retenção.

Verificações automatizadas ajudam a prevenir regressões:

- Adicione um middleware de redaction baseado em denylist (headers, cookies, campos conhecidos)

- Crie testes que falhem se logs contiverem padrões como

Bearer,sk-oupassword= - Adicione uma varredura pré‑deploy que busque segredos em logs recentes

- Mantenha uma allowlist pequena de campos “seguros para logar”

Passo a passo: implementar retenção, amostragem e redação

Comece listando todo lugar onde logs são produzidos. Não chute. Inclua seu web app, workers/queues em background, edge functions, logs do banco de dados e qualquer coisa que toque sign‑in (auth, callbacks do provedor de identidade). Uma fonte faltando pode manter os custos altos e tornar incidentes mais difíceis de depurar.

Em seguida, padronize uma forma pequena de log para filtrar rápido e evitar formatos barulhentos avulsos. Mantenha simples: timestamp, level, nome do serviço e um request ID (ou trace ID). Adicione um curto “event” name e um pequeno contexto JSON.

Depois defina padrões por ambiente:

- Production: info/warn/error apenas

- Staging: permitir debug por curtos períodos

- Dev local: qualquer coisa vale

Aqui está uma ordem de implementação que costuma funcionar:

- Faça inventário das fontes e atribua um responsável para cada uma

- Adote um esquema pequeno e aplique-o em código novo

- Defina níveis de log por ambiente com um padrão seguro em produção

- Adicione amostragem ou limites de taxa para eventos repetitivos (health checks, polling, retries)

- Adicione filtros de redação para segredos e PII, mais testes automatizados

Implemente mudanças gradualmente. Compare antes vs depois em volume, custo e utilidade para incidentes por uma semana.

Monitoramento de custo de observabilidade: pegue picos cedo

Se você não fizer nada, contas de logging tendem a pular silenciosamente e aparecer só depois do estrago. Controle de custos de logging é, em grande parte, sobre olhar alguns números diariamente e saber onde checar quando mudam.

Monitore três tendências:

- Volume diário de ingest (quanto você envia)

- Crescimento de armazenamento (quanto você guarda)

- “Top talkers” (serviços ou rotas que produzem mais logs)

Top talkers frequentemente são um endpoint barulhento, um job em retry infinito ou um erro que loga payloads completos a cada requisição.

Alertas de orçamento importam mais que dashboards perfeitos. Configure alertas em alguns estágios (por exemplo 50%, 75%, 90% do orçamento mensal) para ter tempo de agir.

Picos costumam seguir releases, migrações, mudanças de configuração e aumentos de tráfego. Após cada mudança, cheque ingest e volume de erros na primeira hora. Uma flag de debug deixada ligada pode multiplicar custos durante a noite.

Construa uma vista de triagem de custos

Quando os custos sobem, você quer respostas em minutos:

- Qual serviço aumentou mais desde ontem

- Qual endpoint ou job gerou a alta

- Qual nível de log mudou (info vs error vs debug)

- Qual campo foi adicionado (dumps de payload, headers, stack traces)

- Qual release correlaciona com o pico

Quando achar a fonte, o conserto costuma ser: reduzir nível de log, adicionar amostragem, remover um campo barulhento ou limitar um erro repetido.

Mantenha leve: uma revisão semanal de 15 minutos é suficiente enquanto você cresce rápido.

Exemplo: um protótipo em rápido crescimento que ultrapassou seu logging

Um time pequeno lançou um protótipo e foi de 50 para 5.000 usuários em duas semanas. Logo depois de adicionar login por e‑mail, a autenticação começou a falhar para um segmento de usuários. Eles aumentaram o nível de log para debug para entender, e o volume de logs explodiu durante a noite.

O problema não era só “mais usuários”. Eles estavam logando corpos de requisição inteiros, headers completos e respostas de auth inteiras. Isso incluía JWTs longos, refresh tokens e ocasionalmente cookies de sessão. Durante a resposta ao incidente, pessoas copiaram logs para o chat, o que multiplicou o risco de vazamento.

Eles migraram para “logs suficientes”. Em vez de despejar tudo, cada evento de auth logava: um request ID, user ID (ou ID anonimizado), endpoint, código de status, código de erro, latência e uma string curta de motivo. Para debug, registravam qual etapa falhou (parse de token, lookup no banco, verificação de senha), não o payload bruto.

A amostragem fez a maior parte do trabalho. Mantiveram 100% dos erros e timeouts, mas apenas 5% dos logins bem‑sucedidos. Isso ainda mostrava tendências sem pagar por cada OK.

A redação fechou a lacuna de segurança. Tokens e segredos foram mascarados no logger, então buscas durante o incidente não expuseram credenciais.

O plano de retenção deles ficou simples:

- 7 dias: logs completos de erro (não amostrados)

- 14 dias: logs de requisição amostrados (sucessos)

- 30 dias: eventos de segurança e auditoria (campos mínimos)

- 90 dias: agregados diários apenas (contagens, p95 de latência)

Erros comuns que aumentam custos (e risco)

A maioria dos problemas de controle de custos de logging vem de um hábito: ligar “tudo” durante um sprint de protótipo e nunca reduzir quando chegam usuários reais.

Uma armadilha comum é logar corpos de requisição e resposta por padrão. Parece útil, mas multiplica o volume rapidamente e frequentemente captura senhas, tokens, dados de pagamento ou mensagens privadas. Se precisar de payloads, logue apenas uma allowlist pequena de campos seguros e por tempo limitado.

Outro gerador silencioso de custo é tornar todo campo pesquisável. Campos de alta cardinalidade como user_id, session_id, trace_id, e‑mail e URLs completas com query strings podem explodir o tamanho do índice. Mantenha a maioria dos campos como texto simples e indexe apenas alguns campos estáveis que você realmente filtra.

Três erros que costumam aparecer logo antes de uma conta surpresa:

- Deixar logs debug/verbose habilitados em produção depois de um incidente

- Usar logs para analytics (funis, cohorts) em vez de métricas ou eventos

- Adicionar redaction só depois que os logs já foram enviados ao fornecedor

A redação precisa ocorrer antes de qualquer coisa sair do app. “Vamos limpar no pipeline” falha na primeira vez que um endpoint novo loga algo inesperado.

Checklist rápido antes do próximo pico de crescimento

Um pico de crescimento transforma logging “ok por enquanto” em conta e risco durante a noite.

- Escreva seus tiers de retenção e por que eles existem. Retenção curta para logs de debug de alto volume, retenção mais longa apenas para logs que você realmente usa.

- Adicione regras de amostragem para os caminhos mais barulhentos. Amostre logs de sucesso rotineiros, mantenha logs completos para erros e casos raros.

- Redacte segredos e dados pessoais antes de os logs saírem do app. Se você não colaria em um chat público, não deve estar em um log.

- Habilite orçamentos e alertas, e teste-os. Confirme que os alertas disparam e alguém realmente os vê.

- Revise as principais fontes de logs semanalmente, com um único responsável. Torne uma pessoa responsável por aprovar mudanças de logging para que “debug temporário” não vire permanente.

Próximos passos: estabilizar logging à medida que você vai para produção

Quando as contas surpresa pararem, o objetivo é manter os logs úteis conforme o uso cresce. Isso é menos uma mudança grande e mais hábitos que evitam que o volume volte a subir.

Comece com uma auditoria rápida no seu explorador de logs e ordene pelo que produz mais dados: o serviço mais barulhento, o endpoint mais ocupado e as linhas de log mais volumosas. Para cada um, pergunte: isso ajuda a resolver um problema real ou é só “bom ter”?

Conserte os maiores infratores primeiro:

- Ruído de debug que acidentalmente ficou ligado em ambientes parecidos com produção

- Campos de alta cardinalidade (URLs completas com query strings, valores fornecidos pelo usuário)

- Payloads brutos (corpos de requisição/resposta completos, blobs JSON grandes, stack traces repetidos)

Depois, torne as proteções difíceis de reverter por acidente. Adicione testes de redação que falhem o build se logs conterem padrões como chaves de API, JWTs, senhas ou prefixos comuns de segredo. Adicione um “contrato de log” simples para eventos chave (falhas de auth, erros de pagamento, falhas de jobs em background) para que você saiba o que é obrigatório logar e o que nunca deve aparecer.

Se você herdou um protótipo gerado por IA, planeje tempo extra para limpeza. Esses projetos frequentemente chegam com logging barulhento por padrão, trechos copiados que imprimem headers ou tokens e fluxos de auth frágeis que disparam erros repetidos (e logs repetidos).

Se quiser ajuda externa, FixMyMess (fixmymess.ai) se especializa em diagnosticar e reparar codebases geradas por IA, incluindo logging barulhento, exposição de segredos e endurecimento para produção. Uma auditoria rápida pode identificar os hotspots de volume de logs e as mudanças mais seguras a fazer primeiro.

Perguntas Frequentes

Qual a forma mais rápida de parar uma conta surpresa de logging?

Comece desligando logs debug/verbose em produção e removendo dumps de corpo de requisição/resposta. Depois reduza a retenção para logs de alto volume para alguns dias e adicione amostragem para requisições 200 OK rotineiras, mantendo 100% dos erros. Essas três mudanças geralmente reduzem o volume rapidamente sem atrapalhar a investigação de incidentes.

O que devo logar em um protótipo para manter útil, mas barato?

Registre por padrão falhas e mudanças de estado importantes, não toda requisição bem-sucedida. Um bom baseline é: timestamp, nível, nome do serviço, endpoint, código de status, duração e um request ou trace ID, além de um código de erro curto quando algo falha. Adicione apenas o contexto mínimo necessário para reproduzir problemas.

Como escolher retenção de logs sem adivinhar?

Os custos de retenção crescem com o volume, então logs de alto volume precisam de janelas curtas. Mantenha logs detalhados de “hot” para troubleshooting por 1–3 dias, logs gerais de requisição por cerca de 7–14 dias, e eventos de segurança/auditoria de baixo volume por mais tempo apenas se realmente precisar. Se estiver em dúvida, escolha retenção mais curta e estenda só depois de confirmar que usa logs antigos.

Como usar amostragem sem ficar cego durante incidentes?

Capture 100% dos erros, exceções, timeouts e requisições incomumente lentas para não perder evidências em incidentes. Para caminhos de sucesso de alto volume, amostre uma pequena porcentagem para ver tendências sem armazenar todos os eventos. Adicione um limite rígido para que um loop de retry não multiplique seu volume de logs durante a noite.

O que significa “alta cardinalidade” e por que isso aumenta custos?

Campos de alta cardinalidade são valores quase sempre únicos, como URLs completas com query strings, tokens de sessão, IDs aleatórios e texto de erro dinâmico. Quando indexados como tags/labels, a ferramenta de logging precisa rastrear muitas combinações únicas, o que eleva custos rapidamente. Mantenha dados de alta cardinalidade fora de campos indexados e armazene apenas campos estáveis que você realmente filtra.

Como decidir quais campos indexar para busca?

Indexe apenas um pequeno conjunto de campos estáveis que você filtra rotineiramente, como nome do serviço, ambiente, nível do log, endpoint e um conjunto reduzido de códigos de erro. Deixe todo o resto como JSON/texto não indexado para que esteja disponível quando necessário, mas não infle o índice. Se as buscas ficarem lentas, adicione um campo por vez em vez de indexar tudo por padrão.

Qual a forma mais segura de evitar que tokens e segredos vazem nos logs?

Redacte antes de os logs saírem do seu app, porque uma vez que um segredo é enviado ele pode se espalhar por alertas, exports e backups. Masque ou remova headers e campos sensíveis como Authorization, cookies, senhas, chaves de API, links de reset e tokens. Se precisar de correlação, logue um hash unidirecional ou um valor parcial em vez do segredo bruto.

Por que meu volume de logs explodiu logo após um release?

Geralmente é uma flag de configuração deixada ligada após troubleshooting, ou um caminho de código que loga em cada retry ou loop. Outra causa comum é a adição de um novo campo muito grande, como corpos de requisição ou stack traces repetidos. Ao aparecer um pico, encontre primeiro o “top talker” (serviço/rota) e reverta a mudança ruidosa imediatamente, depois adicione amostragem ou limites de taxa.

Como monitorar custos de logging para que picos não me surpreendam novamente?

Monitore volume diário de ingest (quanto você envia), crescimento de armazenamento (quanto você guarda) e “top talkers” por serviço e endpoint, e configure alertas de orçamento que disparem cedo no mês. Quando um alerta ocorrer, verifique o que mudou: novo deploy, mudança de configuração ou um endpoint que começou a retryar. Trate mudanças de logging como mudanças de produção, com um responsável e revisão rápida após releases.

Meu protótipo foi construído com uma ferramenta de IA e os logs estão uma bagunça — o que devo fazer?

Protótipos gerados por IA costumam vir com logging barulhento por padrão, trechos copiados que imprimem headers ou tokens e fluxos de auth frágeis que disparam erros e retries repetidos. Se você não sabe de onde vem o ruído, FixMyMess pode rodar uma auditoria de código gratuita para encontrar os maiores geradores de volume de logs, riscos de exposição de segredos e as correções mais seguras. Podemos então limpar e endurecer o código rapidamente, mesmo que o protótipo esteja bagunçado.