Escolher hospedagem após um protótipo: serverless vs containers

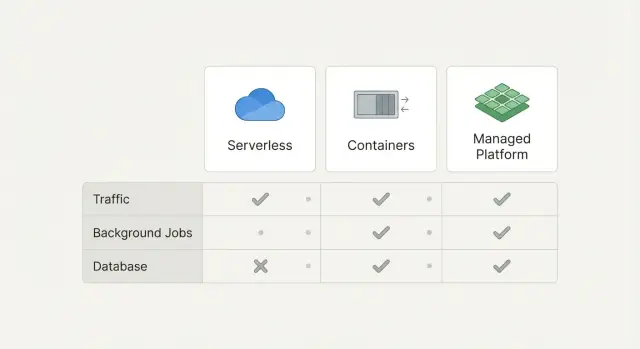

Escolha hospedagem após um protótipo com uma tabela de decisão simples para tráfego, jobs em segundo plano e banco de dados entre serverless, containers e plataformas gerenciadas.

Por que a hospedagem complica logo depois do protótipo

Um protótipo parece rápido porque precisa funcionar só para um grupo pequeno, por pouco tempo e num ambiente controlado. Você pode estar testando com dados seed, um usuário admin e algumas páginas. Quando usuários reais aparecem, a mesma app se comporta diferente: mais logins, mais uploads, mais refreshes e mais casos de borda.

As decisões de hospedagem ficam mais difíceis porque protótipos costumam pular as partes chatas que determinam se uma app sobrevive em produção: uptime, retries, limites de taxa, segredos e como o banco se comporta sob carga. Quando você finalmente precisa dessas coisas básicas, acaba escolhendo entre opções que soam parecidas mas se comportam de forma bem diferente.

Sinais comuns de que você superou o setup atual:

- Páginas ficam lentas quando algumas pessoas usam a app ao mesmo tempo

- Tarefas em segundo plano falham às vezes, sem motivo claro

- Conexões ao banco estouram ou aparece “too many connections”

- Deploys dão medo porque uma mudança pode quebrar tudo

- Você encontra chaves de API ou senhas em texto puro

Você não precisa de conhecimento profundo de DevOps para fazer uma escolha sólida de hospedagem. Precisa de uma maneira clara de casar as necessidades da sua app com o tipo certo de hospedagem, para não refazer tudo depois.

Quando as pessoas dizem “tráfego, jobs e banco”, geralmente querem dizer:

- Tráfego: usuários carregando páginas e chamando APIs. A questão chave é se o uso é estável (previsível) ou em picos (quieto na maior parte do dia e de repente ocupado).

- Jobs: trabalho que roda em segundo plano, como enviar emails, gerar relatórios, processar uploads ou sincronizar dados. A pergunta é se precisa rodar de forma confiável mesmo quando ninguém está usando ativamente a app.

- Banco: onde sua app armazena dados e estado. A pergunta é se precisa de conexões de longa duração, migrações, backups e desempenho consistente.

Este post compara serverless, containers e plataformas gerenciadas usando tabelas de decisão simples.

O que anotar antes de comparar opções

Antes de escolher serverless, containers ou uma plataforma gerenciada, anote o que sua app realmente faz no dia a dia. Isso evita escolher por sensações e depois refazer tudo.

Comece com um mapa simples das suas páginas e fluxos. Liste as telas principais (landing, dashboard, configurações, admin, checkout) e marque quais precisam ser rápidas sempre. “Rápido sempre” geralmente significa login, a primeira tela após o login e qualquer coisa ligada a dinheiro.

Depois estime o tráfego de maneira de baixo esforço. Você não precisa de números exatos ainda. Use um rótulo como baixo, médio, em picos ou desconhecido. “Em picos” pode significar “temos 10 usuários a maioria dos dias, mas 5.000 chegam no dia do lançamento” ou “um parceiro via webhook pode enviar um estouro repentino.” Se o tráfego é desconhecido, anote isso também, porque muda o que você otimiza.

Separe o trabalho em segundo plano dos carregamentos de página. Muitas apps parecem ok na demo, mas quebram em produção porque tarefas em background não têm onde rodar com segurança. Exemplos comuns:

- Enviar emails ou SMS (cadastro, recibos, reset de senha)

- Imports e exports (uploads CSV, sincronização de dados)

- Tarefas longas de IA (gerar relatórios, resumir docs, processamento em lote)

- Processamento de mídia (redimensionar imagens, transcodificar vídeo)

- Webhooks (lógica de retry quando serviços externos falham)

Agora descreva suas necessidades de dados em palavras simples. Você não precisa escolher fornecedores ainda. Apenas descreva que tipo de estado você tem e o que acontece se ele se perder:

- Dados SQL (usuários, pagamentos, permissões)

- Arquivos (uploads, faturas, avatares)

- Busca (full-text, filtros, relevância)

- Cache (acelerar páginas quentes, limites de taxa)

Por fim, escreva as restrições que importam mais que qualquer detalhe técnico: tempo para entregar, orçamento e quem vai manter. Se você é founder solo sem time on-call, diga isso. Se precisa de algo rodando em 48 horas, diga também.

Um exemplo rápido: se você tem um protótipo com um dashboard rápido, tráfego em picos, um job de import diário e um banco SQL, já tem informação suficiente para comparar opções sem adivinhar.

Serverless, containers e plataformas gerenciadas em termos simples

Escolher hospedagem depois de um protótipo é, na maior parte, decidir quanto do trabalho de “rodar a app” você quer assumir.

Serverless: o código roda só quando precisa

Serverless significa que seu código desperta sob demanda e volta a dormir quando não há nada a fazer. Você não gerencia um servidor de longa duração. Envia pequenos pedaços de código (funções) ou um serviço web serverless, e a plataforma cuida do escalonamento.

Os trade-offs são reais: requisições podem começar mais lentas após tempo ocioso, e você costuma precisar projetar em torno de limites (timeouts, execução sem estado e padrões específicos para conexões com o banco). Serverless pode ser ótimo para tráfego em picos ou APIs simples.

Containers: você controla mais e carrega mais responsabilidade

Um container é sua app empacotada com o runtime, para rodar do mesmo jeito em qualquer lugar. Você escolhe como inicia, o que roda junto e como usa CPU e memória.

O lado positivo é o controle: workers em background previsíveis, runtimes estáveis e menos “regras da plataforma”. O lado negativo é o trabalho de operação: manter serviços saudáveis, definir regras de escala, lidar com logs, segredos, patches e resposta a incidentes.

Plataformas gerenciadas: o meio-termo

Plataformas gerenciadas ficam entre os dois. Você faz o deploy e a plataforma roda para você na infraestrutura deles. “Gerenciado” costuma incluir passos de build, HTTPS, autoscaling e health checks básicos.

O que continua sendo sua responsabilidade: bugs da app, design do banco, comportamento de jobs em segundo plano e manter segredos fora do repositório.

Um modelo mental simples de preços:

- Serverless: paga por requisição e tempo de computação. Barato em tráfego baixo ou esporádico, mas custo sobe com uso pesado e constante.

- Containers: paga por capacidade reservada (máquinas que ficam ligadas), mesmo quando o tráfego está baixo. Mais previsível com carga consistente.

- Plataformas gerenciadas: normalmente um custo base mensal mais complementos (banco, logs, banda). Muitas vezes é o mais fácil de orçar no início.

Deploys e rollbacks também funcionam diferente:

- Serverless: deploys rápidos, mas com mais partes móveis se houver muitas funções. Rollbacks geralmente são fáceis, mas debugar entre funções pode ser mais difícil.

- Containers: releases versionadas limpas e rollbacks rápidos, mas você precisa configurar o processo.

- Plataformas gerenciadas: “push to deploy” é simples. Rollbacks costumam ser um clique, mas a customização pode ser limitada.

Se seu protótipo é uma API pequena com tráfego ocasional e alguns agendamentos, serverless pode ser um começo de baixo esforço. Se já precisa de uma fila de workers, jobs de longa duração ou controle estrito do runtime, containers (ou uma plataforma gerenciada que suporte workers) costuma ser mais tranquilo.

Tabela de decisão parte 1: padrões de tráfego

O tráfego é a primeira coisa a resolver porque afeta custo, confiabilidade e o quanto você precisa trabalhar para manter tudo estável.

| Seu padrão de tráfego | Como geralmente parece | Ajuste típico | Atenções |

|---|---|---|---|

| Constante (carga semelhante a cada hora) | Uso previsível, como uma ferramenta interna ou app B2B | Containers ou uma plataforma gerenciada rodando serviços de longa duração | Você ainda precisa de regras de escala e health checks. Custos “sempre ligados” existem mesmo em iddle. |

| Em picos (explosões grandes, quieto entre picos) | Lançamentos, anúncios, demos, picos diários | Serverless para a camada web, às vezes misturado com serviços gerenciados | Cold starts podem ficar visíveis. Limites de concorrência e timeouts podem surpreender. |

| Desconhecido (você realmente não sabe) | Protótipo público, esperando ver a demanda | Comece com plataformas gerenciadas ou serverless, depois meça | Não se prenda a infra complexa cedo. Logs e métricas importam mais que “escala perfeita”. |

Cold starts importam quando usuários os percebem. Se seu fluxo é checkout, login ou qualquer coisa em que a pessoa clica e espera, uma pausa de 1–3 segundos pode prejudicar. Se for uma ferramenta interna pequena, cold starts geralmente não importam.

Necessidades em tempo real mudam a resposta. Se você precisa de WebSockets, streaming longo ou colaboração ao vivo, serviços de longa duração são mais simples. Containers ou plataformas gerenciadas tendem a ser menos penosos. Alguns setups serverless conseguem tempo real também, mas adicionam peças extras e mais formas de falhar.

Expectativa de autoscaling costuma ser otimista demais. “Serverless significa escala infinita” não é como costuma ser na prática. Ainda existem limites: teto de requisições concorrentes, limites de conexões ao banco e limites de APIs de terceiros. Containers também escalam, mas podem reagir mais devagar se você não deixar alguma capacidade aquecida.

Regra prática:

- Tráfego constante: containers ou plataforma gerenciada, mantenha simples.

- Tráfego em picos: serverless funciona bem para requisições bursty, mas planeje cold starts e limites.

- Tráfego desconhecido: comece simples, instrumente cedo e ajuste após ver uso real.

Tabela de decisão parte 2: jobs em segundo plano e filas

Jobs em segundo plano são tudo que sua app precisa fazer fora da requisição principal: enviar emails, redimensionar uploads, sincronizar dados, cobrar cartões ou chamar um modelo de IA. Para muitos protótipos, isso decide a hospedagem porque jobs mostram o que quebra quando usuários reais chegam.

A maioria dos problemas com jobs é menos sobre “onde roda” e mais sobre o básico: timeouts, retries, idempotência (para que retries não dupliquem trabalho) e concorrência segura.

Serverless pode ser ótimo quando cada tarefa é pequena e independente. Você ganha escalonamento automático e paga só quando o trabalho roda. Fica ruim quando tarefas frequentemente batem em limites de tempo, precisam de CPU constante por muito tempo ou dependências pesadas que deixam cold starts lentos.

Containers costumam ser mais simples para jobs longos e workers dedicados. Um container worker pode puxar da fila, ficar aquecido e lidar com mais memória/CPU sem lutar contra limites de função. O trade-off é que você precisa pensar em escala, reinícios e garantir que apenas um worker processe cada job.

Plataformas gerenciadas ajudam quando incluem as partes chatas: filas hospedadas, agendamento, autoscaling de workers, dashboards de falhas e dead-letter handling.

| Duração do job | Necessidade de retry | Concorrência | Padrão bom | Atenções |

|---|---|---|---|---|

| Até 30s | Baixa a média | Esporádica ou imprevisível | Serverless + fila gerenciada | Timeouts, cold starts, execuções duplicadas |

| 30s a 15m | Média a alta | Moderada | Workers gerenciados ou containers | Precisa de idempotência e backoff |

| Mais de 15m ou CPU pesado | Alta | Controlada | Containers com fila | Regras de escala, jobs travados, custos |

Exemplo concreto: um SaaS que gera faturas em PDF pode fazer isso em serverless se terminar rápido. Se clientes começarem a enviar PDFs enormes e a geração levar minutos, um worker em container puxando de uma fila costuma ser mais tranquilo de operar e mais fácil de debugar.

Tabela de decisão parte 3: banco de dados e serviços stateful

Comece pela parte mais “grudenta” da sua app: o banco e tudo que mantém estado. Você pode trocar hosting web depois. Mover dados e estado é onde times perdem semanas.

Se seu protótipo usa Postgres ou MySQL, mantenha. Postgres/MySQL gerenciados são geralmente o padrão mais seguro porque upgrades, problemas de disco e backups são onde bancos self-hosted falham com mais frequência.

Se seu protótipo usa SQLite, trate como um sinal de alerta. Serve para demo, mas falha rápido com usuários concorrentes, múltiplas instâncias da app ou jobs em background.

Banco gerenciado vs banco self-hosted: o que costuma quebrar

Self-hosting um banco dentro de um container pode funcionar, mas os modos de falha são chatos e caros: storage cheio, backups que não são reais, uma atualização menor quebrando uma extensão ou um restart corrompendo dados porque volumes foram configurados errado. Um banco gerenciado reduz esses riscos, especialmente quando você ainda está mudando o esquema com frequência.

Além do banco, liste outras necessidades stateful:

- Uploads de arquivos geralmente precisam de object storage (não o disco local da app).

- Busca pode precisar de um serviço separado para manter filtros rápidos em escala.

- Cache pode precisar de algo como Redis gerenciado se você depende de sessões, limites ou queries caras.

Limites de conexão importam mais do que se espera. Cada conexão aberta ao banco consome memória no servidor. Apps serverless podem criar muitas conexões curtas, o que dispara “too many connections”. A solução comum é pooling: sua app fala com um pool, e o pool reaproveita um número menor de conexões.

| Pergunta | Se “baixo/inicial” | Se “crescendo/alto” | O que escolher |

|---|---|---|---|

| Carga leitura/escrita, migrações, backups | Leituras leves, poucas escritas, migrações semanais, backups básicos ok | Leituras/escritas pesadas, migrações frequentes, precisa de point-in-time recovery | Postgres/MySQL gerenciados + backups automáticos; adicione pooling ao escalar |

Como escolher: um caminho passo a passo

Tentar comparar cada recurso de cada plataforma é uma forma rápida de travar. Uma abordagem melhor: comece pelo que tem mais chance de quebrar primeiro e escolha a opção mais simples que previne isso.

Passo 1: Identifique seu gargalo atual

Seja honesto sobre o que dói hoje, não sobre o que pode importar daqui a um ano:

- Tráfego: páginas lentas, timeouts ou rate limits.

- Jobs em segundo plano: emails, imports, chamadas de IA ou trabalho agendado falham ou rodam duas vezes.

- Banco/estado: dados inconsistentes, migrações assustadoras ou arquivos/sessions no lugar errado.

Quando escolher um gargalo, você pode ignorar a maior parte do ruído.

Passo 2: Escolha a hospedagem mais simples que resolve esse gargalo

Prefira o menor número de peças que ainda atende à necessidade.

Se tráfego é o problema, serverless ou plataforma gerenciada costuma bastar porque escala sem você mexer em servidores. Se requests de longa duração ou WebSockets são centrais, containers podem ser mais simples que lutar contra limites.

Se jobs são o problema, priorize uma fila real e um worker com retries seguros. Isso pode ser serverless, mas só se der para controlar timeouts e retries; caso contrário, um worker container pequeno é mais fácil de raciocinar.

Se o banco é o problema, consiga um banco gerenciado estável primeiro. A escolha da hospedagem da app importa menos do que ter backups, migrações e limites de conexão claros.

Passo 3: Rode um pequeno teste de carga e um teste de falha

Deixe pequeno. Você procura pontos óbvios de quebra.

Teste de carga: simule um pico modesto (por exemplo, 5–10x seu tráfego normal por 10 minutos) e observe erros e latência.

Teste de falha: force algo a cair e confirme que ele recupera limpo. O teste mais simples é um restart. Para jobs, teste retries: faça um job falhar de propósito e confirme que ele é reexecutado uma vez e não cria duplicatas.

Passo 4: Defina um fluxo básico de deploy

Você precisa de um caminho mínimo seguro do código até a produção:

- Staging e produção (mesmo que o staging seja pequeno)

- Um processo de deploy que não dependa de cliques manuais

- Um plano de rollback (idealmente um comando ou um ajuste)

Se você não consegue explicar o rollback em uma frase, sua hospedagem ainda não é “simples”.

Passo 5: Planeje o que vai monitorar

Escolha alguns sinais que você realmente vai checar semanalmente: taxa de erros, latência e falhas de jobs já costumam ser suficientes. Adicione um sinal do banco (queries lentas ou contagem de conexões) se sua app for banco-intensiva.

Armadilhas comuns que causam retrabalho

A maneira mais rápida de perder um mês é escolher hospedagem por aparência em vez do que sua app realmente faz. A escolha certa costuma ser a que seu time consegue operar calmamente toda semana, não a com o diagrama mais bonito.

Uma armadilha é escolher containers porque parece profissional e depois perceber que ninguém quer assumir o trabalho operacional. Containers são ok, mas geralmente significam que você vai cuidar de updates, monitoramento, regras de escala e incidentes. Em times pequenos, isso aparece no pior momento.

Serverless tem a armadilha oposta: fácil para começar, mas morde quando o trabalho é longo. Se você tem processamento de vídeo, imports grandes, chamadas de IA encadeadas ou geração de relatórios que leva minutos, pode atingir limites de tempo ou picos de custo. Times então acrescentam filas e workers e acabam redesenhando sob pressão.

Triggers de retrabalho para observar:

- Tratar segredos como detalhe (chaves no código, .env compartilhado, sem rotação)

- Enviar mudanças de esquema de banco e código no mesmo passo, sem rollback seguro

- Escolher plataforma que complica fluxos de auth (callbacks, armazenamento de sessão, domínios customizados)

- Não planejar uploads de arquivos cedo (onde os arquivos ficam, como permissões funcionam)

- Assumir que recursos em tempo real vão “simplesmente funcionar” (WebSockets, conexões longas, consumidores em background)

Um exemplo concreto: um protótipo pode usar uma biblioteca simples de login, armazenar arquivos no disco local e rodar um job noturno dentro do servidor web. Isso parece ok na demo, mas em produção costuma falhar assim que você adiciona múltiplas instâncias ou faz um novo deploy.

Exemplo: levar um protótipo gerado por IA para produção

Um founder lança um protótipo gerado por IA feito em Replit ou Cursor. Funciona no laptop. Após o lançamento, começa a falhar: logouts aleatórios, emails enviados duas vezes e o banco dá timeout em picos.

Isso acontece porque protótipos tendem a misturar tudo: requisições web, jobs em background e acesso ao banco no mesmo processo. Quando o tráfego sobe, tudo compete pelos mesmos recursos.

Percorrendo a tabela de decisão

Tráfego: o lançamento traz tráfego em picos. Isso aponta para uma camada web/API que escala rápido. Funções serverless podem servir bem a web/API se as requisições forem curtas e sem estado. Se as requisições forem longas ou precisar de controle fino do runtime, um serviço containerizado pequeno costuma ser mais seguro.

Jobs em background: enviar emails e rodar imports CSV não deve acontecer dentro da requisição web. Picos deixam os servidores web lentos, e retries podem causar duplicações. Jobs precisam de uma fila e de um worker capaz de rodar mais tempo que um timeout normal de requisição.

Banco e auth: timeouts vêm de muitas conexões e queries lentas. Auth quebrando sob carga costuma ser mistura de cookies mal configurados, armazenamento de sessão ausente ou limites/timeouts ao chamar o banco.

Uma combinação realista para esse caso:

- Serverless ou um serviço web gerenciado para a API (escala rápida para tráfego em picos)

- Uma fila gerenciada + um worker (container ou job runner gerenciado) para emails/imports

- Um banco gerenciado com pooling de conexões (e monitoramento básico)

- Armazenamento de segredos gerenciado para que chaves não fiquem hardcoded no repositório

Não se trata da stack mais chique; trata-se de separar responsabilidades para que um problema (imports) não derrube tudo.

Plano simples para a primeira semana: estabilizar, depois otimizar

A primeira semana deve focar em confiabilidade antes de otimizar custos:

- Dia 1: Adicione logging de requisições, tracking de erros e health checks para enxergar falhas.

- Dia 2: Mova emails e imports para uma fila + worker, adicione idempotência (sem envios duplicados).

- Dia 3: Corrija timeouts do banco com pooling, índices em queries lentas e timeouts sensatos.

- Dia 4: Estabilize auth (sessions, cookies, redirects) e adicione rate limiting básico.

- Dia 5: Teste carga dos fluxos principais e defina limites de escala para evitar conta surpresa.

Checklist rápido e próximos passos

Para escolher hospedagem após um protótipo sem cair em comparações infinitas, mantenha a decisão pequena e prática. Você não está escolhendo “a plataforma para sempre”. Está escolhendo o próximo passo mais seguro para usuários reais.

Comece com essas checagens:

- Formato do tráfego: principalmente constante ou em picos? Note se os usuários estão concentrados numa região.

- Duração dos jobs: tarefas curtas (segundos) ou longas (minutos)? Precisam de retries, agendamentos ou entrega garantida?

- Crescimento do banco: quão rápido os dados crescem e você precisa de migrações ou backups robustos logo?

- Estado e arquivos: armazena uploads, sessões ou arquivos gerados que precisam sobreviver a restarts?

- Quem mantém: quem está de plantão quando quebra e quão confortáveis estão com deploys e debugging?

Antes de lançar qualquer coisa publicamente, coloque o “mínimo de produção” no lugar:

- Backups testados: não apenas ativados, mas restaurados uma vez.

- Logs pesquisáveis: requests, jobs e erros do banco em um lugar só.

- Alertas de erro: avisam um humano rápido, com detalhe suficiente para agir.

- Rollbacks: uma forma de desfazer um deploy ruim sem heroísmo.

Mantenha uma coisa simples de propósito. Para muitos times, isso significa usar um banco gerenciado e evitar operações de banco customizadas cedo, mesmo que a escolha do runtime ainda evolua. Anote também o que você adiará (multi-região, autoscaling perfeito, filas complexas) para que não vire surpresa depois.

Próximos passos que funcionam bem para a maioria dos times:

- Documente escolhas em uma página: runtime, jobs/fila, banco, armazenamento e quem é responsável por cada parte.

- Faça um teste pequeno em produção: lançamento limitado com monitoramento real, corrija os principais problemas.

- Teste de carga um fluxo central: signup, checkout ou seu endpoint principal, suficiente para achar limites óbvios.

- Pratique uma falha: reinicie a app, quebre um valor de config ou simule um backlog de fila e veja o que acontece.

- Marque uma revisão: duas semanas após o lançamento, decida se fica ou atualiza um componente.

Se você está herdando código gerado por IA que já é frágil, vale a pena consertar fundamentos (auth, segredos, retries de jobs e padrões de acesso ao banco) antes de trocar hospedagem. FixMyMess (fixmymess.ai) foca em diagnosticar e reparar protótipos gerados por IA para deixá-los prontos para produção, incluindo hardening de segurança e preparação para deploy; eles oferecem uma auditoria de código gratuita para mostrar os problemas que normalmente atrapalham migrações de hospedagem.

Perguntas Frequentes

What should I write down before picking hosting?

Anote três coisas: seu padrão de tráfego (constante, em picos ou desconhecido), quais jobs em segundo plano você executa (emails, imports, tarefas de IA, uploads) e que dados você armazena (dados SQL, arquivos, sessões). Esses três detalhes geralmente apontam para a opção mais simples e segura sem ficar preso em comparações de plataforma.

If I don’t know my traffic yet, what’s the safest default?

Comece com uma plataforma gerenciada ou um setup serverless simples e adicione monitoramento básico para ver o uso real. O objetivo é aprender rápido sem construir uma infraestrutura complexa que você vai descartar.

Will serverless cold starts actually hurt my app?

Pode, e costuma ser mais visível em fluxos como login, checkout e a primeira tela após entrar. Se essas telas precisam ser instantâneas toda vez, prefira um serviço de longa duração (containers ou uma plataforma gerenciada) ou mantenha alguma capacidade aquecida.

When should I avoid serverless and use containers instead?

Opte por containers ou por uma plataforma gerenciada que suporte serviços de longa duração e workers. Funcionalidades em tempo real ficam mais simples quando seu app pode manter conexões abertas sem lutar contra timeouts ou limites da plataforma.

Do I really need a queue for background jobs?

Não necessariamente, mas jobs em segundo plano são frequentemente os primeiros a falhar em produção porque precisam de retries, timeouts e proteção contra execuções duplicadas. Uma fila mais um worker (serverless ou container) costuma ser a diferença entre “funciona na demo” e “funciona toda semana”.

Should I self-host my database inside a container?

Use um banco gerenciado como padrão, especialmente no início. A maioria das falhas dolorosas vem de backups, armazenamento e upgrades, não do SQL em si; bancos gerenciados reduzem esses riscos.

My prototype uses SQLite—do I need to change it before launch?

SQLite serve para demos, mas falha com usuários concorrentes, múltiplas instâncias da app ou workers em segundo plano. Se for público, migrar para Postgres ou MySQL gerenciado costuma ser o passo mais limpo para evitar travamentos e problemas aleatórios.

What causes “too many database connections,” and how do I fix it?

Normalmente é um problema de limite de conexões, não “o banco caiu”. Adicione pooling de conexões e garanta que sua app reutilize conexões de forma sensata, especialmente em serverless onde muitas instâncias curtas podem estourar a contagem de conexões.

What’s the minimum testing I should do before switching hosting?

Faça um pequeno teste de carga (um pico curto) e um teste de falha (reinicie algo de propósito) antes do lançamento. Você busca pontos óbvios de quebra: timeouts, jobs duplicados e páginas lentas sob carga modesta.

If my app was generated by an AI tool, should I fix the code before changing hosting?

Sim. Protótipos gerados por IA costumam vir com autenticação frágil, segredos expostos e comportamento confuso de jobs que falharão independentemente de onde você hospedar. Se quiser um caminho rápido e sem surpresas para produção, FixMyMess pode fazer uma auditoria de código gratuita e depois reparar a base (autenticação, segredos, retries de jobs, acesso ao banco, preparo para deploy) em 48–72 horas, ou reconstruir do zero quando isso for mais rápido.