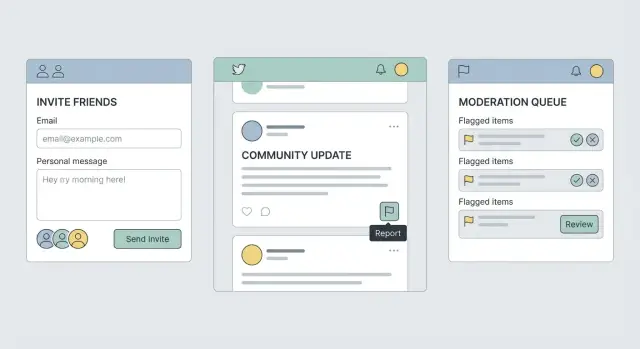

Fluxo de moderação para apps de comunidade construídos com IA

Um plano prático para um fluxo de moderação em apps comunitários: convites, ações por papel, denúncias e etapas de revisão para manter seu espaço seguro.

Por que fluxos de segurança fazem ou quebram um app comunitário

Um app comunitário pode parecer amigável no primeiro dia e virar bagunça na segunda semana. Essa mudança geralmente não é sobre recursos. Acontece quando não há um fluxo de segurança claro: as pessoas não sabem como reportar problemas, os moderadores não sabem o que fazer em seguida, e atores mal-intencionados entendem que podem ultrapassar limites sem consequências.

Sem um plano, os mesmos problemas se repetem: contas de spam postando links, assédio em respostas e mensagens diretas, personificação de membros confiáveis e golpes direcionados a novos usuários. Mesmo alguns incidentes podem definir o tom. Membros regulares param de postar, e as pessoas que você mais quer manter saem primeiro.

Recursos sofisticados raramente resolvem isso. Convites e denúncias importam mais porque controlam quem entra e o que acontece quando algo dá errado. Se convites forem fáceis de abusar, você verá ondas de contas com baixo esforço. Se denunciar for confuso ou parecer inútil, membros brigam em público, saem silenciosamente ou levam problemas para outro lugar.

Um fluxo de moderação sólido não é sobre ser rigoroso. É sobre ser consistente. O mesmo tipo de comportamento deve levar ao mesmo próximo passo, e os membros devem entender o que esperar.

Para uma equipe pequena, "seguro o suficiente para lançar" geralmente significa que vocês conseguem fazer quatro coisas de forma confiável:

- Reduzir abuso na porta com verificações básicas de convite e limites de taxa.

- Permitir que qualquer pessoa denuncie em poucos toques, com motivos claros e detalhes opcionais.

- Dar aos moderadores um conjunto pequeno de ações (advertir, remover conteúdo, silenciar, banir) com escalonamento claro.

- Manter um registro leve do que aconteceu (quem fez o quê, quando e por quê).

Se seu app foi construído rapidamente com ferramentas de IA, teste esses fluxos cedo. Equipes frequentemente descobrem que autenticação, permissões ou telas de denúncia parecem funcionar, mas falham no uso real.

Defina regras claras que você realmente consegue aplicar

Regras só funcionam se você puder aplicá-las da mesma forma toda vez. Comece definindo em uma frase para quem a comunidade é, e adicione uma frase sobre o que ela não é. Exemplo: "Um grupo de colegas para novos product managers. Não é um espaço para vender serviços ou recrutar para vagas não relacionadas." Essa linha guiará decisões depois.

Em seguida, transforme suas regras em algumas categorias simples que você possa marcar e agir rapidamente. Se uma regra não pode ser mapeada para uma categoria, é difícil de aplicar.

- Spam e golpes (postagens em massa, links de indicação, sorteios falsos)

- Assédio e ódio (insultos, ameaças, direcionamento a alguém)

- Conteúdo perigoso (incentivo a autoagressão, conteúdo sexual envolvendo menores)

- Desinformação (afirmações médicas prejudiciais, personificação)

- Violações de privacidade (doxxing, compartilhamento de capturas privadas)

Depois decida o que é automático versus o que precisa de humano. Mantenha a lista "automática" curta e óbvia. Falsos positivos parecem injustos e treinam as pessoas a desconfiar das denúncias.

Uma divisão prática fica assim: bloqueie automaticamente padrões claros de spam, golpes óbvios, doxxing e conteúdo sexual infantil; oculte automaticamente conteúdo pendente de revisão quando houver denúncias repetidas, insultos ou alegações de personificação; e envie casos com contexto (disputas, sarcasmo, piadas limite) para revisão humana.

Escreva mensagens curtas direcionadas ao usuário antes de precisar delas. Elas devem dizer o que aconteceu, por quê e o que fazer em seguida.

Exemplo de mensagem de remoção: "Removemos sua publicação porque incluía um link de venda. Este espaço é para discussão, não promoção. Você pode publicar novamente sem links."

Exemplo de advertência: "Por favor, pare de comentar sobre traços pessoais. Critique ideias, não pessoas. Na próxima vez, pode haver uma suspensão temporária."

Projete um fluxo de convite e onboarding que reduza abuso

Um bom fluxo de convite e onboarding faz duas coisas ao mesmo tempo: ajuda pessoas reais a entrarem rapidamente e torna incômodo para atores mal-intencionados aparecerem em massa. Quando isso funciona, a moderação fica mais calma porque menos problemas entram no espaço.

Escolha a "porta" certa para sua comunidade

Escolha o método de entrada mais simples que combine com seu risco:

- Entrada aberta: melhor para espaços de baixo risco, mas espere mais spam e trolls de passagem.

- Só por convite: melhor no início e para grupos pagos; crescimento mais lento, tom mais seguro.

- Lista de espera: útil quando você precisa de tempo para revisar perfis ou controlar crescimento.

- Referências: forte quando membros recomendam novos participantes e você consegue rastrear abusos até a fonte.

Você pode começar rígido e relaxar depois. Apertar regras depois que a comunidade já está bagunçada é muito mais difícil.

Adicione fricção leve que bloqueie abuso em massa

A maior parte do abuso não é "uma pessoa tendo um dia ruim". São tentativas repetidas, cadastros automatizados e compartilhamento de links. Algumas barreiras ajudam bastante:

- Faça links de convite expirarem (por exemplo, 24 a 72 horas) e ofereça códigos de uso único.

- Aplique limites de taxa na criação de convites e cadastros (por conta, por IP e por dispositivo quando possível).

- Exija e-mail verificado antes de postar ou enviar DMs; considere verificação por telefone opcional para grupos de maior risco.

- Limite quantas contas podem ser criadas a partir de um mesmo dispositivo dentro de um intervalo de tempo.

Vincule fricção ao poder. Contas novas podem ler e reagir, enquanto postar, inserir links e enviar DMs são liberados após verificação ou um curto período de "bom comportamento".

Onboarding que define normas antes dos problemas começarem

Onboarding não é só uma tela de boas-vindas. É sua primeira chance de estabelecer expectativas em linguagem simples. Um curto "compromisso da comunidade" com checkbox mais algumas perguntas pode reduzir mau comportamento e dar aos moderadores algo concreto para apontar depois.

Exemplo: um grupo local de founders pode perguntar: "O que você está construindo?" e "O que você busca aqui: feedback, contratação ou networking?" Em seguida, mostrar três regras: sem assédio, sem spam e mantenha pitches no canal certo.

Registre o suficiente para investigar, sem invadir a privacidade

Para convites, registre o que ajuda a rastrear abuso sem coletar dados pessoais extras:

- ID do convidante, tipo de convite e quando foi criado e usado

- status do convite (expirado, usado, revogado) e quantas vezes foi tentado

- sinais básicos como região de IP ou hash de fingerprint do dispositivo (se usado), não detalhes brutos do dispositivo

- as primeiras ações de uma conta nova (entrou, postou, enviou DM), com timestamps

Construa um sistema de denúncias fácil de usar e difícil de manipular

Um bom sistema de denúncias no app deve levar segundos para usar, proteger quem denuncia e dar aos moderadores contexto suficiente para agir.

Coloque "Denunciar" onde o dano realmente acontece: em posts e comentários, dentro de DMs e threads de mensagens, em perfis de usuário (para personificação ou assédio repetido) e no nível do grupo/canal (para redes de spam).

Mantenha o formulário de denúncia curto. Pergunte a categoria primeiro (assédio, spam, ódio, personificação, preocupação com autoagressão, ameaça de violência, doxxing, outro). Depois ofereça notas opcionais e uma maneira simples de anexar evidências, como uma captura de tela ou um ID de mensagem que seu app capture automaticamente.

Permita que as pessoas se protejam enquanto denunciam. Uma opção "Bloquear" ou "Silenciar" dentro da tela de denúncia reduz dano imediatamente. Se bloquear também altera o acesso a um grupo compartilhado, diga isso antes de confirmar.

Defina expectativas na tela final. Diga o que acontece em seguida, o que vocês podem e não podem compartilhar e um prazo típico de resposta. Se não puder prometer um prazo, dê uma faixa e explique o que a altera (gravidade, reincidência, falta de detalhes).

Torne o fluxo mais difícil de abusar. Aplique limites de taxa em denúncias de contas novas, fique atento a denúncias repetidas falsas e exija um motivo curto quando alguém denunciar a mesma pessoa de novo. Evite expor detalhes que possam identificar quem denunciou.

Casos de emergência precisam de um caminho mais rápido. Adicione uma opção "urgente" apenas para categorias de alto risco e dispare alertas imediatos para:

- ameaças críveis de violência

- ameaças de autoagressão ou intenção suicida

- doxxing (endereço residencial, local de trabalho, telefone privado)

- preocupações com segurança de menores

Exemplo: alguém recebe uma DM com seu endereço. Eles denunciam a DM, escolhem "Doxxing", o app anexa a mensagem automaticamente e eles bloqueiam o remetente. A confirmação explica que a mensagem foi bloqueada para revisão, e um moderador vê esse caso no topo da fila com uma tag de urgência.

Ações de moderação e regras de escalonamento

Um fluxo de moderação precisa de duas coisas: um menu claro de ações e regras claras para quando usar cada uma. Sem isso, os resultados parecem aleatórios e os maus atores aprendem onde estão as brechas.

Ações que apoiam, não só punem

Comece com um conjunto pequeno de ações que cobrem a maioria dos casos:

- Remover conteúdo (ocultar ou apagar um post/comentário)

- Advertir (citar a regra e o que precisa mudar)

- Timeout (período temporário apenas leitura ou sem postar)

- Suspensão (conta pausada por um número de dias, exige revisão para retornar)

- Ban (remoção permanente, com salvaguardas de dispositivo/IP se aplicável)

Ações suaves também importam, especialmente quando alguém está no limite ou quando uma thread está esquentando. Recursos como modo lento, restrição temporária de links ou exigir aprovação para contas muito novas podem parar danos sem ir direto para banimentos.

Escalonamento e apelos

Defina quem pode fazer o quê. Um caminho simples funciona: moderador responde inicialmente, admin lida com reincidência e casos limite, e o dono toma decisões sobre bans permanentes ou questões de alto risco (assédio, doxxing, ameaças). Para ações difíceis de reverter (como ban), exija uma segunda pessoa para confirmar.

Apelos devem existir, mas não para tudo. Permita apelos para timeouts longos, suspensões e bans. Não permita apelos para spam óbvio ou violações claras de segurança. Idealmente, atribua um revisor de apelo que não tenha participado da decisão original e defina um prazo (por exemplo, dentro de 7 dias) para que os casos não fiquem pendentes.

Consistência fica mais fácil com três ferramentas pequenas: motivos prontos que mapeiam suas regras, notas internas ocultas dos membros e um contador simples de advertências para que reincidências escalem previsivelmente.

Passo a passo: configure o fluxo completo do convite até a resolução

Trate o fluxo como uma linha de montagem: quem pode fazer o quê, para onde vão as denúncias e como as decisões são tomadas. Configure uma vez e siga.

Passo 1: Defina papéis de moderação e permissões

Comece com papéis que você consegue explicar em uma frase cada: membro, confiável, moderador, admin. "Confiável" ajuda porque dá mais liberdade a membros provados (postar links, convidar outros) sem entregar poder total de moderação.

Escreva o que cada papel pode ver e fazer. Mantenha chato e específico.

Um checklist rápido:

- Quem pode convidar novos usuários

- Quem pode ver identidades de denunciantes

- Quem pode ocultar conteúdo versus deletá-lo

- Quem pode aplicar timeouts versus bans

- Quem pode ver o log de moderação

Passo 2: Crie estados da fila de denúncias

Dê a cada denúncia um status para que nada se perca. Um conjunto simples: Novo, Triagem, Resolvido, Apelado.

Novo significa que acabou de chegar. Triagem significa que um moderador está verificando contexto (histórico de mensagens, capturas, denúncias passadas). Resolvido significa que uma ação foi tomada ou a denúncia foi encerrada com uma razão. Apelado significa que o usuário contestou a decisão e precisa de uma segunda avaliação.

Passo 3: Adicione notificações que mantenham as pessoas informadas

Notifique moderadores quando uma denúncia entrar como Novo, e novamente se ficar parada tempo demais. Avise o denunciante quando a denúncia for Resolvida, mesmo que você não possa compartilhar detalhes. Uma mensagem curta como "Obrigado, revisamos e tomamos medidas" evita denúncias repetidas e frustração.

Evite alertas barulhentos. Agrupe itens de baixa prioridade, mas envie alertas imediatos para denúncias de alto risco (ameaças, doxxing, segurança infantil, golpes).

Passo 4: Adicione limites de taxa e checagens de abuso

O abuso frequentemente aparece via convites e denúncias. Adicione limites simples cedo:

- limitar convites por conta por dia (mais restrito para contas novas)

- desacelerar denúncias repetidas de um mesmo usuário em uma janela curta

- detectar rajadas de denúncias e encaminhá-las para revisão

- exigir uma nota curta para categorias de denúncia severas

- sinalizar contas com muitas denúncias rejeitadas para revisão mais próxima

Passo 5: Use um template de decisão para consistência

Toda ação de moderação deve registrar os mesmos campos mínimos: razão, ação e follow-up.

- Razão: qual regra foi violada (em linguagem simples)

- Ação: o que aconteceu (ocultar post, advertir, silenciar 24h, ban)

- Follow-up: o que o usuário pode fazer a seguir (editar e republicar, apelar, recursos de apoio)

Se seu app foi gerado por IA, planeje tempo extra para testar casos de borda, por exemplo se "silenciar" realmente bloqueia notificações ou se conteúdo oculto ainda aparece em busca.

Logs, trilhas de auditoria e noções básicas de privacidade

Uma comunidade pode parecer "moderada" mesmo quando não é justa. Bons logs corrigem isso. Eles permitem revisar decisões, identificar padrões e explicar o que aconteceu sem depender da memória.

Decida o que você precisa registrar para tornar decisões rastreáveis, e nada mais. Armazene os fatos necessários para entender um caso, não uma cópia completa da vida privada de ninguém.

Um conjunto mínimo que costuma funcionar:

- Detalhes da denúncia: categoria, texto livre, IDs de mensagem/post relevantes

- Ação tomada: nenhuma, advertência, remoção de conteúdo, silenciar, ban (mais duração)

- Timestamps: quando foi denunciado, quando revisado, quando foi agido

- Atores: quem denunciou, qual moderador lidou, quem aprovou o escalonamento

- Ponteiros de evidência: IDs de anexos ou snapshots de mensagens (apenas o necessário)

Problemas de privacidade geralmente vêm de dados armazenados "só por precaução". Evite registrar histórico completo de mensagens, endereços IP brutos ou copiar perfis inteiros de usuários em cada registro. Se precisar guardar conteúdo sensível (capturas, trechos de mensagens), limite quem pode ver. Separar permissões de "ver conteúdo" das permissões de "agir" ajuda moderadores juniores a processar filas sem navegar em material privado.

Noções básicas da trilha de auditoria

Toda ação de moderação deve escrever um evento claro: quem fez o quê, a quem, quando e por quê. Torne o campo "por quê" obrigatório para ações sérias (silenciamentos longos, bans). Se permitir edições em denúncias, mantenha histórico de versões para que alterações sejam visíveis.

Dashboards simples que realmente ajudam

Você não precisa de analytics sofisticado. Um pequeno painel atualizado diariamente é suficiente:

- tamanho da fila e denúncia mais antiga em aberto

- reincidentes (usuários com múltiplas ações confirmadas)

- principais categorias de denúncia

- carga de trabalho por moderador (casos por moderador)

- ações revertidas (apelos que reverteram decisão)

Defina regras de retenção antes do lançamento. Mantenha logs de ação por mais tempo que evidências brutas. Por exemplo, mantenha eventos de auditoria por 12 a 24 meses, mas exclua anexos e snapshots de mensagens mais cedo (30 a 90 dias) a menos que o caso seja escalado.

Erros comuns que criam resultados inseguros ou injustos

A maioria dos apps comunitários falha em segurança por uma razão simples: as regras são escritas, mas os fluxos não são.

Poder demais em uma conta de moderador

Um erro comum é dar a moderadores acesso total a perfis de usuário, e-mails, dados de IP, mensagens privadas ou informações de cobrança só para que possam lidar com denúncias básicas. Isso é arriscado para a privacidade e pode causar dano real se alguém agir de má fé ou tomar uma decisão emocional.

Mantenha permissões estreitas e baseadas em tarefas. Um moderador que pode ocultar um post não deveria automaticamente poder ver o histórico completo de um usuário ou exportar listas de membros.

Sem proteções contra spam e brigadas

Se convites e denúncias puderem ser usados sem limites, atores maliciosos vão usar isso. Você verá spam via convite, contas falsas e campanhas coordenadas de denúncia para calar alguém.

Adicione fricção que não puna usuários normais: limite convites para membros novos, desacelere denúncias repetidas, detecte rajadas e exija uma razão curta para certos tipos de denúncia.

Casos extremos que quebram confiança

Moderação fica complicada nas bordas: um post é deletado antes de revisão, dois usuários se bloqueiam mutuamente, um membro é banido de um grupo mas não do app inteiro, ou uma mensagem denunciada está em uma thread privada. Se a UI diz "Denúncia enviada" mas os moderadores não conseguem ver o conteúdo, usuários se sentem ignorados.

Garanta que toda denúncia possa ser resolvida mesmo quando o conteúdo está ausente. Armazene um snapshot mínimo (o que aconteceu, quando e por quê) para que revisores possam agir sem expor mais dados do que o necessário.

Mensagens confusas e sem apelos

Notificações genéricas como "Você violou as diretrizes" sem contexto fazem as pessoas se sentirem punidas aleatoriamente. Silêncio após uma denúncia causa o mesmo efeito.

Toda ação deve incluir uma razão em linguagem simples, o que acontece a seguir e como apelar (quando aplicável). Mesmo uma opção simples de "solicitar revisão" reduz churn e brigas públicas.

Checklist rápido pré-lançamento

Você pode lançar rápido e com segurança se checar os detalhes chatos antes de receber usuários reais.

Rode este checklist em uma build staging (ou beta privada) e anote o que vê. Se algo está confuso para você, ficará confuso para moderadores e usuários também.

- Convites se comportam como esperado: convites expiram, podem ser revogados e não podem ser reutilizados por acidente. Teste o que acontece se alguém encaminhar um convite.

- Denunciar é realmente rápido: de posts, comentários, DMs e perfis, um usuário consegue denunciar em cerca de dois toques, adicionar uma nota curta e enviar.

- Moderadores têm uma fila única clara: denúncias novas chegam numa caixa de entrada única com filtros básicos (novo, em revisão, resolvido).

- Cada ação deixa uma trilha de auditoria: bans, silenciamentos, exclusões, advertências, mudanças de papel e resultados de denúncias gravam uma entrada com quem fez, quando e por quê.

- Bloqueios são aplicados: usuários bloqueados não conseguem contatar quem os bloqueou (DMs, respostas, menções, convites). Verifique se o bloqueio não vaza informações de presença como status online.

Após o checklist, faça cinco simulações rápidas com um colega: um surto de spam, uma tentativa de personificação, uma thread de assédio (respostas e DMs), uma tentativa de evasão (conta nova após ban) e uma tentativa de denúncia falsa (tentar usar denúncias como arma).

Cenário exemplo e próximos passos para lançar com segurança

Um teste realista é simples: um membro novo entra por convite e começa a enviar DMs de spam em minutos.

Para o membro alvo, o fluxo deve ser rápido e protetor. Ele abre a DM, toca em Bloquear e então em Denunciar. O formulário é curto: escolher um motivo (Spam), adicionar uma nota opcional e enviar. A confirmação deve ser clara: "Obrigado, recebemos sua denúncia. Você não receberá mensagens desta conta."

Para moderadores, a denúncia deve chegar com contexto suficiente para agir sem expor dados privados desnecessários: idade da conta, fonte do convite (quem a convidou), contagem de mensagens recentes, conteúdo denunciado e se outros usuários denunciaram a mesma conta.

O ponto de decisão costuma ser timeout vs ban. Se for leve, primeira vez e baixo volume, um timeout curto mais advertência pode bastar. Se a conta é nova, envia muitas DMs rápido e tem várias denúncias, banir é a opção mais segura. O importante é consistência: comportamento similar deve levar a resultados similares.

Uma regra de decisão simples:

- Timeout para casos leves, de primeira vez e baixo volume.

- Ban para spam em alto volume, comportamento repetido ou múltiplas denúncias.

- Revogar privilégios de convite (ou sinalizar o convidante) se o mesmo convidante continua trazendo atores ruins.

- Escalonar para um admin em casos de ameaças, menores ou doxxing.

Denunciantes devem receber uma atualização de status que não revele detalhes privados da ação: "Revisamos sua denúncia e tomamos medidas conforme nossas regras." Se você oferecer apelos, mantenha simples. O usuário banido pode solicitar revisão, mas não deve conseguir mandar mensagens aos moderadores a partir da mesma conta bloqueada.

Se você herdou um protótipo gerado por IA onde papéis, logs de auditoria ou fluxos de denúncia não aguentam esses testes, FixMyMess (fixmymess.ai) pode diagnosticar o que está quebrado e ajudar a colocar o básico de segurança funcionando antes do lançamento, incluindo uma auditoria de código gratuita.