Importações seguras de CSVs grandes em produção sem travar a aplicação

Aprenda a importar CSVs grandes com segurança em produção: parsing em streaming, validar cada linha, permitir falhas parciais e gerar relatórios de erro claros sem travar a aplicação.

Por que grandes importações CSV falham em produção

Uma importação CSV pode parecer OK com um arquivo pequeno de teste e desabar na primeira vez que um cliente real envia 300.000 linhas. Em produção há redes mais lentas, limites de tempo mais rígidos e dados bagunçados. Se a importação foi construída como um recurso rápido, costuma presumir que tudo está limpo e pequeno.

A falha mais comum é memória. Muitas importações leem o arquivo inteiro para a RAM, depois o transformam em objetos, validam e mantêm tudo em arrays até o fim. Um arquivo que parece "não tão grande" pode explodir a memória quando expandido em estruturas da aplicação. Acrescente alguns uploads concorrentes e o servidor começa a trocar memória, travar ou reiniciar.

A segunda grande falha é tempo. Requests web e jobs serverless costumam ter limites rígidos de execução. Mesmo que uma importação terminasse em 10 minutos, ela pode ser encerrada aos 60 segundos e deixar dados pela metade.

Outros pontos comuns de falha:

- Picos de memória por carregar o arquivo inteiro ou bufferizar demais

- Timeouts por validar e gravar no banco dentro da request

- Uma linha ruim que derruba toda a importação

- Duplicatas por retries, cliques duplos ou re-envio do mesmo arquivo

- Escritas parciais que deixam os dados inconsistentes

O que os usuários vivenciam é simples: a página congela, o carregamento nunca termina ou aparece uma mensagem vaga de "Import failed" sem pista do que corrigir. Pior: eles podem só perceber linhas faltantes dias depois.

O que sua equipe precisa é o oposto: resultados previsíveis e provas. Você quer saber quantas linhas foram aceitas, rejeitadas e ignoradas, e os motivos exatos. Essa clareza transforma uma operação assustadora em algo rotineiro.

Um exemplo pequeno: um cliente envia uma lista de vendas com a coluna de e-mail vazia na linha 18.237. Se seu importador lançar uma exceção e parar, você perde horas e confiança. Se ele registrar o erro da linha e seguir, você termina o trabalho e retorna um relatório acionável.

O que “seguro” significa para sua importação CSV

Uma importação CSV é segura quando termina sem derrubar sua app e o resultado é previsível. A maioria das falhas em produção acontece porque a importação tenta fazer demais ao mesmo tempo ou tem regras pouco claras.

Comece decidindo o que “sucesso” significa para seus usuários:

- Tudo-ou-nada: se qualquer linha estiver errada, nada é salvo.

- Sucesso parcial: linhas boas são importadas, linhas ruins são rejeitadas com motivos claros.

Sucesso parcial costuma ser mais gentil com os usuários, mas exige design cuidadoso para não terminar com dados meio-criados que quebram outras partes da aplicação.

Defina expectativas desde o início. Uma boa função de importação não é ilimitada. Coloque limites claros de tamanho do arquivo e número de linhas, e seja rígido quanto a colunas obrigatórias. Se uma coluna é requerida (como email, SKU ou user_id), falhe rápido antes de fazer trabalho pesado. Se um campo é opcional, trate valores ausentes como normais e documente o padrão aplicado.

Regras estritas vs flexíveis

Seja rígido sobre estrutura, flexível sobre conteúdo.

- Estrutura: cabeçalhos obrigatórios, tipos de dados necessários, relacionamentos dos quais sua app depende.

- Conteúdo: colunas extras que você ignora, campos opcionais, pequenas diferenças de formatação que você pode normalizar (ex.: remover espaços).

Uma forma simples de definir segurança é responder:

- Quais limites você aplicará (linhas, tamanho, cabeçalhos obrigatórios)?

- Quais erros interrompem toda a importação e quais apenas rejeitam uma linha?

- O que você registrará para suporte e o que mostrará ao usuário?

- Como evitar que o mesmo arquivo seja importado duas vezes?

Esse último ponto é idempotência. Dê a cada importação uma chave estável (como checksum do arquivo mais usuário e janela de tempo) e torne submissões repetidas seguras.

Parsing em streaming em vez de carregar o arquivo inteiro

Carregar um CSV inteiro na memória funciona em demos e depois desaba em produção. Um arquivo de cliente pode ter centenas de MB. Se sua app o lê de uma vez, há picos de memória, timeouts e até reinício do servidor.

O streaming mantém a memória estável. Em vez de construir uma string ou array gigante, você lê um pedaço, parseia algumas linhas, processa e segue. Bem feito, streaming é a base para importações confiáveis porque limita o dano que um arquivo ruim pode causar.

Como o streaming funciona na prática

Um parser em streaming lê bytes do upload em pequenos pedaços e emite linhas completas assim que possível. Seu código de importação processa linha a linha ou em pequenos lotes, então o progresso continua mesmo com arquivos enormes.

É também onde aparecem as esquisitices reais de CSV:

- Codificação: exija UTF-8 (ou detecte) e falhe rápido se não puder decodificar.

- Delimitadores: suporte vírgulas vs ponto-e-vírgula quando relevante, mas não tente adivinhar infinitamente.

- Campos entre aspas: use um parser CSV real para que vírgulas dentro de aspas não dividam colunas.

- Quebras de linha: aceite finais Windows e Unix sem contar linhas errado.

Antes de processar milhares de linhas, capture problemas fatais a nível de arquivo cedo. Se faltam cabeçalhos ou colunas não batem com o esperado, continuar só gera ruído.

Uma checagem inicial simples valida:

- O arquivo não está vazio e tem linha de cabeçalho

- Colunas obrigatórias existem

- Delimitador e regras de aspas parseiam bem as primeiras N linhas

- A quantidade de colunas está dentro de um máximo razoável (protege contra cotações quebradas)

Validação por linha que detecta problemas cedo

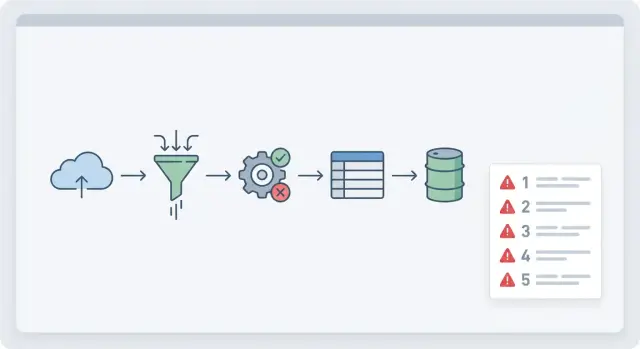

Trate a validação como um funil: cheque o arquivo uma vez e depois valide cada linha enquanto ela entra pelo streaming.

Checagens a nível de arquivo respondem “é o arquivo certo?” antes de tocar no banco. Confirme nomes de cabeçalho, codificação, delimitador e limites aproximados de tamanho. Se o cabeçalho estiver errado, pare cedo com uma mensagem clara.

Checagens por linha respondem “essa linha é utilizável?” e devem rodar de forma independente para cada registro. Uma linha ruim não deve travar a importação nem contaminar o lote.

Um validador por linha prático cobre:

- Campos obrigatórios (email ausente, SKU vazio)

- Tipos e intervalos (quantidades não negativas, preços em faixas sensatas)

- Datas e formatos (datas inválidas como 2025-02-30)

- Valores permitidos (status deve ser active, paused ou archived)

- Regras de negócio (chaves únicas, relacionamentos válidos como customer_id existente)

Normalize entradas antes de validar para não rejeitar dados que estão basicamente corretos. Remova espaços, padronize maiúsculas quando ajuda (como emails) e trate nulos comuns ("N/A", "null", "-") como vazios. Aplique a mesma normalização em todos os lugares para que duplicatas não entrem como "ACME" vs "acme ".

Mantenha mensagens de validação curtas e acionáveis. Um bom padrão é: número da linha, coluna, problema e uma dica.

Exemplo: “Linha 128, start_date: data inválida. Use YYYY-MM-DD.”

Idempotência e proteção contra duplicatas

Uma importação CSV parece simples até alguém clicar “Import” duas vezes, o navegador reencaminhar ou dois colegas subirem o mesmo arquivo ao mesmo tempo. Sem idempotência, você não só obtém duplicatas, mas também atualizações conflitantes e totais incorretos.

Comece decidindo como o sistema reconhecerá “essa linha de novo”. Números de linha não são estáveis se o usuário reordenar ou editar o arquivo, então associe-os a campos chave que descrevem o registro.

Abordagens comuns:

- Chaves naturais (email para um usuário, SKU para um produto)

- IDs externos (um ID do sistema de origem)

- Chave composta (organization_id + invoice_number)

- Uma chave de importação por arquivo mais uma impressão por linha (hash dos campos-chave)

Retries devem ser seguros por design. Crie um registro de “sessão de importação” quando o upload começar e registre o resultado de cada linha nessa sessão. Adicione uma chave de idempotência por linha e aplique uma restrição única no banco. Se a mesma linha chegar de novo, ignore-a ou transforme em atualização, conforme suas regras.

Condições de corrida aparecem quando duas importações tocam os mesmos registros ao mesmo tempo. Use restrições de banco como guarda final e controle a concorrência. Por exemplo, processe importações para o mesmo tenant uma de cada vez ou bloqueie pela chave natural durante gravações.

Falhas parciais sem corromper os dados

Falhas parciais são normais com arquivos de clientes. O risco não é que algumas linhas estejam erradas — é terminar com dados meio-gravados que quebram o resto da app.

Seu objetivo deve ser simples: a importação termina em um estado conhecido-bom, ou deixa o banco inalterado.

Escolha uma política de falha clara

Escolha uma política e torne-a visível na UI:

- Tudo-ou-nada: qualquer linha inválida rejeita toda a importação

- Aceitação parcial: linhas válidas são salvas, linhas inválidas são reportadas

- Limite: aceite apenas se falhas ficarem abaixo de um limite (por exemplo, 2%)

Qualquer que seja a escolha, adicione uma etapa de staging. Parseie e valide em uma tabela de staging (ou armazenamento temporário) primeiro. Só grave os registros finais depois que o lote passar nas checagens. Se permitir aceitação parcial, ainda assim faça o stage primeiro e depois confirme apenas as linhas boas em transações controladas por lote.

Rastreie o resultado por linha para poder explicar o que aconteceu sem suposições. Um pequeno conjunto de status funciona bem: success, failed, skipped (duplicate/empty), updated (casou com um registro existente).

Trate linhas dependentes com cuidado

Dependências são onde importações parciais ficam perigosas.

Exemplo: um CSV tem Clientes e Pedidos. Salvar um Pedido sem seu Cliente cria dados quebrados.

Escolha uma regra e mantenha-a:

- Exigir pais primeiro (falhar linhas-filhas se o pai estiver faltando)

- Importação em duas passagens (carregar pais, depois filhos)

- Quarentena de dependentes (segurar linhas-filhas até o pai ser criado)

Ao reportar “sucesso parcial”, use linguagem simples: quantas linhas foram salvas, quantas não foram e se algo foi ignorado ou atualizado.

Relatórios de erro amigáveis que as pessoas realmente conseguem consertar

Um importador pode estar tecnicamente correto e ainda parecer quebrado se o relatório de erro for confuso. O objetivo é dizer às pessoas o que ocorreu, o que consertar e como tentar de novo sem adivinhar.

Comece com um resumo claro no topo: total de linhas, importadas, puladas, falhadas. Se suportar sucesso parcial, diga claramente que algumas linhas foram salvas.

Depois mostre detalhes por linha que apontem o problema exato:

- Número da linha (como o usuário vê no CSV)

- Nome da coluna

- O valor que vocês receberam

- O que esperavam (formato ou regra)

- Uma mensagem curta e acionável

Faça mensagens específicas. “Valor inválido” é frustrante. “Data deve ser YYYY-MM-DD, recebeu 3/7/24” é corrigível. Se um campo deve ser um de poucos valores, liste-os.

Evite vazar detalhes sensíveis. Não mostre stack traces, erros SQL, IDs internos ou qualquer coisa que indique sua configuração interna. Mapeie falhas internas para mensagens seguras como: “Não foi possível salvar esta linha. Tente novamente ou contate o suporte se o problema persistir.”

Torne o re-envio simples. Mantenha o mesmo mapeamento de colunas escolhido na primeira vez e ofereça um arquivo de erro que o usuário possa editar e re-submeter (geralmente as linhas originais mais uma coluna extra “erro”).

Passo a passo: um fluxo de importação pronto para produção

Um fluxo que sobrevive a dados reais começa assumindo que algo vai dar errado: uma data ruim, um campo obrigatório ausente, uma chave duplicada ou um arquivo maior que o esperado.

O fluxo

-

Crie uma sessão de importação primeiro. Quando o usuário envia o arquivo, crie um registro de sessão com quem enviou, quando, o schema/versão esperado e um status (queued/running/complete). Armazene o arquivo bruto em storage durável e salve seu checksum para provar o que foi processado.

-

Parseie em streaming e faça stage em lotes. Parseie o CSV em streaming e grave linhas em uma tabela de staging (ou armazenamento temporário) em pequenos lotes (por exemplo, 500–2.000 linhas). Isso mantém a memória estável e dá checkpoints seguros.

-

Valide por linha, registre erros e continue. Para cada linha normalize valores (remover espaços, parsear datas, mapear enums) e execute regras por linha. Em vez de lançar exceções, grave um registro de erro estruturado ligado à sessão de importação e ao número da linha (campo, mensagem, valor original).

-

Confirme apenas linhas válidas com upserts seguros. Mova linhas válidas da staging para as tabelas finais dentro de transações controladas. Use chaves únicas e upserts para que duplicatas não criem registros extras.

-

Gere um resumo voltado ao usuário. Armazene totais: linhas processadas, importadas, falhadas e os tipos de erro mais comuns. Produza um relatório de erros que as pessoas possam filtrar e corrigir.

Exemplo: se um usuário importa 50.000 clientes e 312 linhas têm emails inválidos, você ainda importa as outras 49.688 e retorna um relatório com os números de linha exatos e as correções necessárias.

Retry sem re-upload

Suporte retry usando a mesma sessão de importação: mantenha o arquivo original, as mesmas regras de validação e reexecute depois que o usuário corrigir os dados. Se quiser que isso seja confiável, o caminho de retry precisa das mesmas regras de idempotência da primeira execução.

Guardrails de performance e confiabilidade

Uma importação CSV é uma tarefa de longa execução. Trate-a como tal. Se ela rodar dentro de uma request web normal, você corre risco de timeouts, telas congeladas e gravações incompletas. Coloque importações em jobs de background e deixe a UI consultar o progresso para manter a app responsiva.

As atualizações de progresso devem ser reais, não “ainda trabalhando”. Rastreie estágios (upload, parse, validação, escrita, finalização) e inclua contagens como linhas lidas, aceitas, rejeitadas e tempo gasto.

Defina limites para que um arquivo ruim não monopolize seu sistema:

- Tempo máximo por importação (falhe com mensagem clara e mantenha trabalho parcial isolado)

- Limites de tamanho de lote (lotes menores reduzem tempo de lock e picos de memória)

- Contagem máxima de erros antes de parar (por exemplo, pare após 200 linhas ruins)

- Tamanho máximo de arquivo e colunas máximas (rejeite cedo)

- Imports concorrentes máximos por workspace/conta

Backpressure importa quando o banco é mais lento que a leitura do arquivo. Se as gravações começarem a atrasar, reduza a leitura ou pause o parsing. Caso contrário a memória sobe até o worker travar e você perde estado.

Torne isso observável. Logue um ID de importação, quem iniciou, metadados do arquivo e tempos por estágio. Adicione métricas básicas como linhas por segundo e tempo de escrita no banco. Quando alguém disser “as importações estão quebradas”, você quer respostas rápidas.

Planeje cancelamento. Se alguém enviou o arquivo errado, deve poder parar com segurança. Mantenha gravações em transações pequenas e faça stage das linhas recebidas. Ao cancelar ou falhar, delete dados de staging e marque a importação como cancelada para que um retry comece limpo.

Erros comuns que causam crashes ou importações ruins

A maioria das falhas em produção não são problemas de “big data”. São suposições pequenas que só quebram quando clientes reais enviam arquivos reais.

Um erro comum é confiar na linha de cabeçalho. Pessoas renomeiam colunas, adicionam espaços ou exportam de outro sistema. Se você não verificar as colunas necessárias e mapeá-las explicitamente, valores podem se deslocar para campos errados e você só percebe mais tarde.

Exportações do Excel têm armadilhas próprias. Zeros à esquerda em IDs somem, números longos viram notação científica e datas podem vir como texto, números seriais ou formatos mistos na mesma coluna. Se seu importador tenta adivinhar tipos, você tem corrupção silenciosa em vez de uma mensagem clara “Linha 42: data inválida”.

Variações no formato do arquivo são outra fonte frequente de falhas: arquivos UTF-16, byte order marks, ponto-e-vírgula em vez de vírgula ou campos com quebras de linha embutidas. Se seu parser espera um formato perfeito, um arquivo estranho pode travar o processo ou embaralhar linhas.

Alguns padrões que consistentemente causam crashes ou importações ruins:

- Uma transação gigante para centenas de milhares de linhas (locks longos, timeouts, picos de recurso)

- Tratar todo campo em branco como inválido mesmo quando opcional

- Gravar linhas direto sem checagens de idempotência (retries criam duplicatas)

- Retornar um erro genérico como “Import failed” sem números de linha ou nomes de campo

- Misturar validação e gravação de forma que falhas parciais sejam difíceis de recuperar

Exemplo: um usuário envia 200k contatos e 50 linhas têm datas ruins. Se seu código faz rollback de tudo e mostra um erro vago, eles vão tentar de novo, criar duplicatas ou desistir.

Checklist rápido e próximos passos

Se você quer importações que não derrubem a app, busque algo previsível que nunca deixe seu banco meio-errado.

Um checklist simples para produção:

- Defina limites claros (máx. de linhas, tamanho do arquivo, cabeçalhos obrigatórios)

- Parseie em streaming, não carregando o arquivo inteiro na memória

- Valide cada linha cedo (tipos, campos obrigatórios, intervalos, checagens de relacionamento)

- Torne idempotente (detecção de duplicatas e retries seguros)

- Faça stage e commit em pequenos lotes para controlar o que é gravado

Decida sua política de falhas parciais desde o início e mantenha-a consistente. Muitas equipes escolhem “aceitar linhas válidas, rejeitar inválidas”, mas só se o resumo for claro e as gravações forem feitas com segurança.

Um plano de testes curto antes de liberar mudanças:

- Um arquivo pequeno e limpo

- Um arquivo com linhas intencionalmente ruins (valores faltantes, datas erradas)

- Um arquivo grande perto dos seus limites máximos

- Um upload duplicado (mesmo arquivo duas vezes)

- Um retry após interrupção (parar no meio e depois retomar)

Se você herdou um importador gerado por IA que trava sob carga ou produz duplicatas, geralmente é possível consertar sem reescrever toda a app. FixMyMess (fixmymess.ai) foca em diagnosticar e reparar codebases gerados por IA, incluindo fluxos de importação que precisam de stage, idempotência e validação mais segura para funcionar em produção.

Perguntas Frequentes

Por que minha importação CSV funciona com 1.000 linhas mas falha com 300.000?

Grandes importações geralmente falham porque o código lê o arquivo inteiro na memória, faz toda a validação de uma vez ou tenta gravar tudo dentro de uma única request web. Isso causa picos de memória, timeouts e dados parcialmente gravados quando o processo é interrompido.

O que é parsing em streaming e por que é mais seguro do que carregar o arquivo inteiro?

O parsing em streaming lê o arquivo aos poucos e processa as linhas conforme chegam, mantendo o uso de memória constante. Também permite relatar progresso, tratar linhas ruins sem travar e manter a aplicação responsiva durante importações longas.

O que devo validar antes de processar qualquer linha?

Faça checagens a nível de arquivo primeiro: confirme que o arquivo não está vazio, que há uma linha de cabeçalho, que as colunas obrigatórias existem e que a codificação e o delimitador podem ser parseados. Se a estrutura estiver errada, pare cedo com uma mensagem clara para não perder tempo processando lixo.

Como faço para uma linha ruim não travar toda a importação?

Execute validação por linha de forma independente e registre os erros em vez de lançar exceções que parem toda a importação. Mantena as mensagens acionáveis incluindo número da linha, coluna, o que está errado e o formato esperado.

Minha importação deve ser tudo-ou-nada ou permitir sucesso parcial?

Escolha uma política clara e deixe explícito: tudo-ou-nada, sucesso parcial ou um limite (por exemplo, falhar se mais de 2% estiverem inválidos). O sucesso parcial costuma ser mais amigável, mas exige stage e gravações cuidadosas para não criar relacionamentos quebrados ou estado inconsistente.

Como evito duplicatas quando usuários reenviam ou repetem a importação?

Trate retries como normais: usuários clicam duas vezes, navegadores reencaminham e colegas podem subir o mesmo arquivo. Crie uma sessão de importação e uma chave de idempotência (baseada em uma chave estável do registro e/ou uma impressão digital da linha) e imponha unicidade no banco para que reprocessamentos não criem duplicatas.

Como evito gravações parciais que deixam o banco inconsistente?

Faça stage dos dados primeiro e então commit apenas das linhas válidas em transações pequenas e controladas. Evite uma única transação gigante para todo o arquivo e evite gravar direto nas tabelas finais enquanto ainda estiver descobrindo erros — é assim que você acaba com importações parcialmente concluídas difíceis de reverter.

Por que as importações CSV devem rodar como jobs em background em vez de na request web?

Não execute grandes importações dentro do ciclo de uma request normal. Coloque a importação em um job de background, armazene progresso por sessão de importação e faça a interface consultar o status para que a página não trave e o trabalho não seja morto por limites de request ou serverless.

O que um relatório de erro amigável ao usuário deve incluir?

Dê um resumo primeiro (total, importados, falhados, ignorados/atualizados) e depois detalhes por linha que correspondam ao que o usuário vê no CSV. Inclua o valor recebido e a regra esperada, mas evite stack traces, erros SQL ou IDs internos para não vazar detalhes sensíveis de implementação.

A FixMyMess pode ajudar se meu importador gerado por IA continuar falhando em produção?

FixMyMess se especializa em consertar apps gerados por IA que quebram em produção, incluindo fluxos de importação CSV que travam, excedem tempo ou criam duplicatas. Se seu importador atual é instável, podemos auditar o código, adicionar streaming, stage, idempotência e relatórios claros, e fazê-lo funcionar com segurança sem adivinhações.