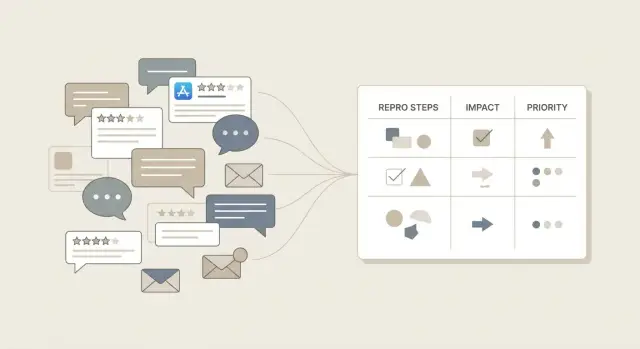

Transforme o feedback de usuários em uma lista de correções que a equipe pode entregar

Aprenda a transformar feedback de usuários em uma lista de correções: extraia passos reprodutíveis, marque impacto e escolha o que consertar primeiro sem suposições.

Por que reclamações vagas travam as correções

"Não funciona" sinaliza dor, mas não é um relatório de bug. Uma equipe não consegue consertar o que não consegue reproduzir, e não pode confirmar uma correção sem um antes-e-depois claro.

Feedback vago normalmente elimina os detalhes que importam: o que a pessoa tentou, o que esperava, o que realmente aconteceu e o que mudou recentemente. Também embaralha os limites. É um botão, um tipo de conta, um dispositivo ou o produto todo?

Relatórios pouco claros desaceleram tudo e tornam as correções arriscadas. Engenheiros chutam, consertam a coisa errada e publicam mudanças que quebram outra parte. Times de produto não conseguem comparar problemas de forma consistente, então a reclamação mais alta vence em vez da mais importante.

Uma boa lista de correções é o oposto de vago. Ela é feita de itens pequenos e testáveis que qualquer pessoa na equipe pode seguir e confirmar. Cada item deve ler como um pequeno experimento com resultado de sucesso/fracasso claro.

"Pronto para enviar" geralmente significa:

- Um problema por item (sem pacotes como "o checkout está quebrado")

- Um título curto que nomeie a tela e a ação

- Passos de reprodução que um colega pode seguir em menos de 2 minutos

- Resultado esperado vs resultado real

- Uma verificação simples de sucesso que prove que foi consertado

Se você está lidando com um app gerado por IA, reclamações vagas custam ainda mais. Lógicas frágeis, segredos expostos e fluxos emaranhados podem se esconder atrás de sintomas. Ser específico cedo mantém a correção pequena, mais segura para enviar e mais rápida de verificar.

Capture feedback em um só lugar (sem perder contexto)

Se o feedback vive em cinco lugares, as correções ficam lentas e bagunçadas. Escolha um lar para cada relato (uma planilha, um documento compartilhado ou um tracker) e trate-o como a fonte da verdade. O objetivo é preservar o que o usuário quis dizer enquanto torna útil para a equipe.

Comece coletando a mensagem bruta de onde ela chegar: e-mails de suporte, DMs (fundador, vendas, comunidade), avaliações na app store, transcrições de chat in-app e notas de chamadas de demos ou onboarding.

Não reescreva a reclamação como primeiro passo. Copie a redação original para o registro, incluindo screenshots, timestamps e qualquer detalhe que tenham compartilhado (plano, dispositivo, tipo de conta). Depois adicione estrutura em campos separados (como área, severidade e causa suspeita). Essa separação mantém você honesto: as palavras do usuário continuam intactas, mas sua equipe ganha dados organizados.

Dê a cada relato um único ID (mesmo que seja só FDBK-00123). O ID acompanha o problema através de duplicatas, comentários e correções, assim você pode mesclar relatos em vez de gerar cinco tarefas para o mesmo bug.

Antes de escrever tarefas, agrupe reclamações semelhantes. "Login fica em loop", "não consigo ficar logado" e "autenticação falha aleatoriamente" podem ser um único cluster com múltiplos exemplos. Quando um protótipo está quebrando em produção, times frequentemente começam exatamente aqui: reúna os relatos brutos primeiro, depois diagnostique padrões. (É também assim que FixMyMess normalmente começa com apps gerados por IA: coleta tudo, então investiga os pontos comuns de falha.)

Mantenha também um pequeno balde de "desconhecido". Quando uma mensagem é vaga demais, registre-a mesmo assim e anote o que falta (dispositivo, passos, tipo de conta). Não se perderá, e você pode fazer follow-up quando tiver tempo.

Traduza reclamações em fatos úteis

Uma reclamação como "está quebrado" geralmente aponta para um problema real, mas ainda assim não diz o que consertar. Seu trabalho é transformar a emoção em um conjunto curto de fatos que um colega possa agir.

Comece por quem é o usuário. Um usuário novo pode estar preso no onboarding; um usuário recorrente pode estar bloqueado por uma mudança recente. Papel e plano também importam: um admin pode ver telas que um usuário básico nunca verá. O dispositivo é frequentemente a pista escondida, especialmente quando um fluxo funciona no desktop mas falha no mobile.

Em seguida, defina o objetivo. O que estavam tentando fazer imediatamente antes de falhar? Então reescreva o problema central como esperado vs atual em uma frase. Exemplo: "Esperado: checkout confirmar pagamento, mas fica girando para sempre ao clicar em Pagar." Essa linha única vira a âncora do ticket.

Padrões de tempo são um atalho para a causa raiz. "Sempre" sugere bug determinístico. "Às vezes" aponta para temporização, rede, condições de corrida ou casos de borda. "Só na primeira vez" frequentemente envolve cache, permissões ou estado de conta.

Capture detalhes do ambiente, mas só os que ajudam a reproduzir:

- Tipo e papel do usuário (novo ou recorrente, admin ou membro, plano)

- Objetivo do usuário (o resultado que queriam)

- Esperado vs atual (uma frase)

- Frequência (sempre, às vezes, só na primeira tentativa)

- Ambiente (navegador, SO, versão do app e estado da conta como trial, convidado, ou 2FA ativado)

Se você trabalha com um app construído por IA que muda rápido, adicione mais um fato: em qual build ou deployment estavam. A mesma reclamação pode referir-se a bugs diferentes em dias diferentes.

Passo a passo: transforme uma mensagem em passos reprodutíveis

Quando alguém diz "Seu app está quebrado", trate como matéria-prima. Seu trabalho é transformá-la em algo que um colega possa seguir sem chutes.

1) Dê um título com o resultado

Escreva um título de uma linha que nomeie o que falhou para o usuário, não sua teoria sobre o porquê.

Bom: "Botão de checkout não faz nada após inserir código promocional."

Ruim: "Bug de cupom."

2) Capture o caminho mais curto (3-7 passos)

Os passos de reprodução devem ser a rota mínima de um começo limpo até o problema. Se um detalhe de configuração importa (como estar desconectado), declare no topo.

Uma estrutura simples:

- Estado inicial: dispositivo/navegador, tipo de conta, logado ou não

- Passos 1-7: os cliques mínimos para atingir o problema

- Pare no momento em que o bug aparece

3) Adicione entradas exatas

Substitua "preenchi o formulário" por campos, botões e valores exatos.

Exemplo: "Email: [email protected]", "Senha: 8+ chars", "Cliquei: Criar conta".

É aqui que a maioria das reclamações vagas vira acionável.

4) Escreva esperado vs atual

Duas linhas curtas:

Esperado: o que deveria acontecer.

Atual: o que aconteceu em vez disso (inclua o texto exato da mensagem de erro, se houver).

5) Defina "pronto" como pass/fail

Torne a conclusão inquestionável. "Pronto quando um novo usuário conseguir enviar o formulário 5 vezes seguidas sem erro no Chrome e no Safari." Se não dá para testar, não dá para fechar.

6) Adicione evidência se tiver

Screenshots, gravações de tela, logs de console e timestamps ajudam. Se o app é gerado por IA e bagunçado, a evidência importa ainda mais. Times como FixMyMess costumam usar esse material durante uma auditoria de código gratuita para diagnosticar fluxos quebrados rapidamente.

Perguntas simples que esclarecem rápido

Quando um usuário diz "está quebrado", geralmente descreve um momento, não um relatório completo. Pergunte só o que precisa para reproduzir uma vez.

Leve-o de volta ao ponto exato da falha. Um pequeno detalhe (o último clique, um valor colado, o texto de erro) pode poupar horas de chutes, especialmente em apps gerados por IA onde pequenas falhas lógicas se escondem atrás de "ontem funcionou".

Cinco perguntas que esclarecem a maioria dos relatos em menos de dois minutos:

- Qual foi a última coisa que você fez antes de falhar?

- O que exatamente você clicou e o que digitou? Se puder, copie/cole o que inseriu.

- O que você esperava que acontecesse e o que aconteceu em vez disso?

- Você viu alguma mensagem de erro? Compartilhe o texto exato.

- Funciona em outro navegador ou dispositivo (teste rápido)?

Depois do básico, faça uma pergunta de negócio para triagem correta: "Qual a urgência disso e qual era seu objetivo?" Alguém tentando submeter um pagamento é diferente de alguém mudando foto de perfil.

Exemplo:

"Login está quebrado" vira: "No iPhone Safari, após inserir e‑mail e senha e tocar em Log in, volta para a tela de login. Sem texto de erro. Funciona no Chrome desktop. Urgente porque não consigo acessar minha conta."

Isso é suficiente para passar de frustração a uma lista de correções que a equipe pode enviar.

Marque cada item para comparar maçãs com maçãs

Quando o feedback se acumula, tudo parece urgente. Tags transformam mensagens bagunçadas em dados consistentes para você ordenar, agrupar e decidir o que consertar primeiro sem discutir.

Dê a cada item alguns rótulos simples. Mantenha as opções limitadas para que as pessoas realmente usem:

- Tipo (bug, funcionalidade faltando, UX confusa, performance, dados)

- Severidade (bloqueia a tarefa, precisa de workaround, incômodo mas possível)

- Frequência (um usuário, alguns usuários, a maioria dos usuários)

- Área afetada (uma tela, um fluxo, muitos fluxos)

- Dono (web, backend, mobile, infra, conteúdo)

Depois de taggear uma semana de feedback, padrões aparecem rápido. Dez itens "UX confusa + maioria dos usuários + muitos fluxos" muitas vezes importam mais que uma reclamação dramática.

Adicione "flags de risco" como um conjunto separado de etiquetas. Mantenha curto, mas faça barulho:

- Problemas de auth ou sessão

- Pagamentos ou checkout

- Perda de dados ou corrupção de dados

- Exposição de segurança (segredos, injeção, permissões)

- Risco de conformidade ou privacidade

Exemplo: "Login falha constantemente" pode ser taggeado como bug + bloqueia tarefa + alguns usuários + muitos fluxos + risco de auth. Essa linha única diz que não é só um problema de UI. Se você lida com um protótipo gerado por IA, flags de risco também ajudam a identificar cedo o que é perigoso (auth quebrada, segredos expostos) antes de gastar tempo polindo problemas de baixo impacto.

Priorize pelo impacto de negócio, não pelo barulho

O usuário que grita mais alto nem sempre aponta para o problema mais importante. Uma lista de correções útil começa pelo impacto: o que acontece ao negócio se isso ficar quebrado por uma semana?

Escolha 2-3 métricas de impacto que se ajustem ao seu produto e use-as consistentemente. Opções comuns incluem receita (checkout bloqueado, upgrades falhando), retenção (usuários churnam após bater no bug), confiança (segurança, perda de dados, login quebrado) e carga de suporte (quantos tickets isso gera).

Agora pontue cada problema em linguagem simples: Alto, Médio ou Baixo. Adicione uma frase explicando por que: "Alto: impede novos usuários de se cadastrarem, afeta cerca de 30% das tentativas."

Faça o mesmo para esforço, mas mantenha grosseiro se ainda não souber. Pequeno, Médio, Grande, ou um intervalo como P-M basta. Isso é ainda mais importante em codebases geradas por IA, onde dimensionar é difícil até inspecionar o código.

Uma regra simples mantém você honesto:

- Alto impacto + Pequeno esforço: fazer primeiro

- Alto impacto + Grande esforço: agendar e quebrar em etapas

- Baixo impacto + Pequeno esforço: fazer quando precisar de ganhos rápidos

- Baixo impacto + Grande esforço: arquivar ou abandonar

Separe itens de risco "deve consertar" de pedidos "bom ter". Qualquer coisa envolvendo segurança, segredos expostos, auth quebrada ou corrupção de dados é prioridade mesmo que poucos usuários notem. Se precisar de segunda opinião rápida num app gerado por IA, FixMyMess pode auditar e marcar os itens de risco antes de você gastar uma semana chutando.

Transforme a lista de correções em trabalho entregável

Uma lista só ajuda se alguém puder pegar, construir e dizer com confiança "pronto". É aqui que notas viram trabalho real.

Mantenha o lote pequeno. Um bom começo é 6–10 itens de correção para a semana (ou sprint). Com 30, você vai trocar de contexto demais e não entregar nada. Com 2, provavelmente está evitando o trabalho difícil.

Para cada item, adicione os detalhes que o tornam construível:

- Critérios de aceitação: o que um usuário pode fazer depois da correção, em palavras simples ("Usuário pode resetar a senha e receber um e-mail em até 2 minutos.")

- Dono e prazo aproximado: uma pessoa responsável e um prazo ("até quarta", "esta semana")

- Dependências: o que toca (auth, banco, provedor de pagamento, serviço de e-mail)

- Como confirmar: reexecutar passos de reprodução, observar queda numa métrica ou obter retorno do usuário que reportou

- Nota de escopo: o que você NÃO fará nesta passagem, para que a correção não aumente demais

Exemplo: "Login falha" vira: "Consertar loop de redirect de auth no Safari móvel. Pronto quando um novo usuário conseguir se cadastrar, verificar e-mail e chegar ao dashboard no iPhone. Dono: Sam. Prazo: sexta. Depende de configurações do provedor de auth e cookies de sessão. Confirmar: rodar passos de reprodução e monitorar taxa de erro de login por 24 horas."

Se a base de código for gerada por IA e frágil (auth emaranhada, segredos expostos, acesso estranho ao BD), os times frequentemente gastam mais tempo chutando do que consertando. Um diagnóstico externo rápido como a auditoria gratuita da FixMyMess pode transformar um backlog nebuloso em tarefas que você consegue enviar em 48–72 horas.

Exemplo: de uma mensagem irritada a um plano claro de correção

Mensagem do usuário: "Login está quebrado e fui cobrado. Consertem isso." Parece urgente, mas ainda não é acionável. Extraia os fatos sem discutir e então escreva um teste que qualquer pessoa da equipe possa executar.

Extraia o que já tem:

- Quem: cliente existente vs novo usuário, qual plano, qual dispositivo/navegador

- Objetivo: entrar para gerenciar a conta (e evitar cobrança dupla)

- Esperado: login bem-sucedido, cobrança condizente com o plano, uma cobrança por período

- Atual: login falha, uma cobrança aconteceu (ou aconteceu duas vezes)

Transforme em passos reprodutíveis com teste de pass/fail:

- Use uma conta de teste no mesmo plano (ou crie uma).

- Abra o app no navegador/dispositivo reportado.

- Tente logar com credenciais corretas.

- Observe o resultado: mensagem de erro, loop de redirect, página em branco.

- Verifique status de cobrança: foi criada uma cobrança? Há fatura duplicada?

Pass: usuário chega ao dashboard e não há cobrança inesperada.

Fail: login bloqueia acesso ou cobrança está incorreta.

Agora tagueie para comparar com outros relatos: risco de pagamentos (alto), impacto na confiança (alto), risco de churn (alto). A lista de correções deve refletir impacto de negócio, não apenas o quão irritada a mensagem parecia.

Uma lista priorizada do mesmo thread pode ser:

- Parar cobranças incorretas imediatamente (desativar o caminho de cobrança problemático ou adicionar uma trava)

- Consertar a falha de login (causa raiz e um teste para o estado exato do erro)

- Adicionar alertas para criação de cobrança sem signup/login bem-sucedido

- Melhorar a mensagem de erro e o caminho de suporte para recuperação do usuário

Se isso vem de uma base de código gerada por IA com auth enlaçada ou lógica de cobrança exposta, times costumam chamar FixMyMess para uma auditoria rápida antes de aplicar mudanças.

Erros comuns que desperdiçam dias

A forma mais rápida de perder tempo é transformar feedback em trabalho que ninguém consegue verificar. Você "conserta" algo, usuários continuam insatisfeitos e a equipe discute o que mudou.

Uma armadilha é escrever tickets que descrevem sentimentos em vez de comportamento. "O app é inutilizável" é feedback real, mas não é tarefa. Capture o momento da quebra: o que o usuário fez, o que viu e o que aconteceu em seguida.

Outro desperdício é o mega-ticket: um relato que mistura login, cobrança e uma tela lenta num mesmo bloco. Parece eficiente, mas bloqueia progresso porque cada parte precisa de donos, testes e urgência diferentes. Separe problemas quando tiverem causas ou critérios de "pronto" diferentes.

Pular o resultado esperado é como times publicarem o conserto errado. Se você só escreve o que deu errado, alguém pode "corrigir" mascarando um erro, mudando texto de UI ou alterando comportamento que os usuários não queriam. Um bom ticket clareia o alvo: o que deveria acontecer.

Duplicatas não são perda, são sinal. Trate-as como dados de frequência. Feche a cópia, vincule à original e note quantas pessoas reportaram. A contagem costuma ser mais útil que outra descrição longa.

Priorizar pelo mais barulhento também gasta dias. Volume, impacto em receita e fluxos bloqueados importam mais que o tom.

Não ignore relatos "raros" que insinuam segurança ou perda de dados. Um segredo exposto, risco de injeção SQL ou caminho de takeover de conta pode valer mais que dez reclamações menores de UI. Se você herdou código gerado por IA, esses problemas são comuns e fáceis de perder até ser tarde demais. FixMyMess muitas vezes começa com uma auditoria rápida para trazer à tona problemas de alto risco antes de você gastar tempo em bugs de menor impacto.

Checklist rápido antes de comprometer com a correção

Antes de alguém começar a programar, faça uma checagem de qualidade no próprio relato. Um relatório bagunçado vira um conserto bagunçado. Um relatório limpo é fácil de estimar, atribuir e verificar.

Use isto para decidir se o problema está pronto para ser trabalhado ou precisa de mais uma rodada de perguntas:

- Alguém consegue reproduzir usando só os passos escritos (com conta nova, em um navegador normal)?

- Está claro o esperado vs atual, em palavras simples, com a tela ou ação exata onde dá errado?

- Você sabe quem é afetado e com que frequência (um cliente, um segmento ou a maioria; sempre ou só às vezes)?

- O impacto de negócio está capturado em uma linha ("novos usuários não conseguem se cadastrar" ou "checkout falha no mobile")?

- A checagem de sucesso é clara: o que prova exatamente que está consertado?

Por fim, verifique itens que devem pular a fila. Se houver qualquer chance de envolver segurança, autenticação ou pagamentos, escale. Exemplos: segredos expostos, bypass de login, risco de takeover de conta, cobranças duplicadas, recibos faltando.

Se você herdou um protótipo gerado por IA e relatórios continuam falhando nesse checklist (fluxos pouco claros, comportamento inconsistente, bugs estranhos de auth), pode ser mais rápido fazer uma auditoria de código primeiro. Times como FixMyMess fazem isso de forma focada para você saber o que realmente está quebrado antes de comprometer tempo com correções.

Próximos passos (e quando chamar ajuda)

Uma vez que você consiga transformar feedback de usuários em uma lista clara de correções, proteja esse progresso mantendo o escopo pequeno. Comece com os cinco principais problemas por impacto de negócio (cadastros perdidos, pagamentos falhando, logins bloqueados, perda de dados, fluxos centrais quebrados). Para cada um, escreva passos de reprodução limpos para que qualquer pessoa da equipe verifique o bug da mesma forma.

Um ritmo simples evita que o backlog apodreça: uma triagem curta semanal. Mantenha 20–30 minutos, decida o que avança e arquive ou ponha no congelador o resto.

Um plano prático para os próximos 7 dias:

- Escolha os 5 principais problemas por impacto e reescreva cada um em passos de reprodução claros e esperado vs atual.

- Confirme cada problema uma vez e pare de re-litigá‑lo em chat.

- Atribua um dono e um prazo, mesmo que curto.

- Envie correções em pequenos lotes para identificar regressões rápido.

- Depois de cada lote, reexecute os passos originais e marque como pronto só quando passarem.

Traga ajuda quando as mesmas correções continuarem quebrando ou quando você ficar descobrindo problemas “surpresa” por baixo da superfície. Isso é comum em apps gerados por ferramentas como Lovable, Bolt, v0, Cursor e Replit, onde lógica oculta, segredos expostos e falhas de segurança podem estar atrás do que parece um bug simples de UI.

Se você fica apenas tapando sintomas toda semana, pare e faça um diagnóstico e refatoração mais profundos antes de adicionar mais features. FixMyMess (fixmymess.ai) pode começar com uma auditoria de código gratuita e ajudar a transformar um protótipo gerado por IA em software pronto para produção com reparos verificados por especialistas.

Perguntas Frequentes

What should I include so a report is actually fixable?

Escreva um título de uma frase que nomeie a tela e o que falhou, depois adicione o caminho de reprodução mais curto que um colega possa seguir. Inclua estado inicial, entradas exatas, esperado vs. atual e uma verificação clara de sucesso/fracasso para que a equipe possa confirmar a correção.

What’s the fastest way to clarify “it doesn’t work”?

Pergunte pela última ação que fizeram, o que esperavam, o que aconteceu em vez disso e se viram alguma mensagem de erro exata. Depois confirme o dispositivo/navegador e se acontece sempre ou apenas às vezes.

Should I rewrite user complaints into my own words?

Mantenha a mensagem original do usuário no registro e adicione campos estruturados separadamente. Isso preserva o contexto e evita que o significado seja alterado enquanto você resume.

How do I keep feedback from getting scattered across chats and emails?

Escolha uma fonte de verdade, como um tracker, documento compartilhado ou planilha, e registre todo relato ali. Dê a cada relatório um ID simples para que duplicatas, comentários e correções fiquem conectados.

How do I handle duplicate bug reports without wasting time?

Agrupe reclamações semelhantes em um único problema com múltiplos exemplos, em vez de criar tarefas separadas para cada mensagem. Registre quantas pessoas reportaram para tornar a frequência visível.

What tags help most when the backlog is messy?

Use um pequeno conjunto de rótulos consistentes como tipo, severidade, frequência e área afetada para ordenar rapidamente. Adicione flags de risco explícitos para autenticação, pagamentos, perda de dados e exposição de segurança para que possam saltar na fila.

How do I prioritize fixes without chasing the loudest complaint?

Priorize pelo impacto no negócio: bloqueia pagamentos, cadastros, login ou confiança? Depois estime o esforço de forma aproximada e trate primeiro o impacto alto com esforço pequeno, quebrando trabalhos grandes em partes entregáveis.

What evidence is worth attaching to a bug report?

Anexe o mínimo de evidência que acelere a reprodução, como screenshot, gravação de tela, timestamp e erros de console ou rede capturados. A evidência é mais útil quando vinculada a uma tentativa específica de reprodução.

How do I write acceptance criteria that prevent “fixed but not really”?

Defina “feito” como um teste que outra pessoa consiga executar e obter o mesmo resultado, por exemplo completar o fluxo várias vezes nos dispositivos afetados. Se não pode ser testado claramente, é fácil enviar uma mudança que parece consertar mas ainda falha para usuários.

Why are AI-generated apps harder to debug from vague feedback?

Seja rígido com detalhes de ambiente e versão, porque pequenas mudanças podem gerar bugs diferentes com o mesmo sintoma. Se o código parecer frágil ou arriscado, um diagnóstico externo focado como a auditoria gratuita da FixMyMess pode transformar relatos vagos em correções seguras e testáveis rapidamente.