Versionamento de prompts: uma maneira simples de rastrear mudanças e reverter

Versionamento de prompts simplificado: registre o que pediu, o que mudou e por quê, para comparar saídas, reverter rápido e reduzir regressões.

Por que os resultados regridem depois de você “melhorar” um prompt

Regressão de saída acontece quando um prompt que antes dava bons resultados passa a dar resultados piores depois de uma mudança que parecia inofensiva. Às vezes é sutil (alguns erros a mais). Às vezes é óbvio (o modelo ignora sua regra principal).

A regressão costuma aparecer como:

- Desvio de tom (muito formal, muito comercial, muito informal).

- Quebra de estrutura (faltam cabeçalhos, formato errado, seções extras).

- Menor precisão (mais palpites, contradições, menos ressalvas).

- Restrições esquecidas (contagem de palavras, frases proibidas, itens obrigatórios).

- Menos consistência (duas execuções dão respostas bem diferentes).

Pequenas alterações no prompt podem causar grandes mudanças porque um prompt não é uma lista de verificação que o modelo segue palavra por palavra. É um conjunto de sinais que competem por atenção. Adicione uma frase, remova um exemplo ou reordene instruções e você muda o que o modelo considera “mais importante”.

Gatilhos comuns incluem regras conflitantes, enterrar uma restrição chave mais abaixo no prompt, trocar um exemplo concreto por um vago, aumentar tanto o comprimento do prompt que detalhes perdem atenção, ou mudar uma única palavra que altera o sentido (por exemplo, “breve” vs “mínimo”).

A parte cara normalmente não é a saída ruim. É perder o contexto do que mudou e por quê. Uma semana depois você lembra “a Versão B era melhor”, mas não consegue explicar o que “melhor” significava, qual input de teste usou, ou o que foi alterado.

Por isso o versionamento de prompts importa. O objetivo não é perfeição. É resultados repetíveis e reversões fáceis. Se você consegue dizer “v1.3 adicionou uma regra de formato mais rígida e matou o tom amigável”, você pode reverter em minutos em vez de tentar dez edições aleatórias.

Isso importa ainda mais quando prompts afetam trabalho real: e-mails de onboarding, respostas de suporte, documentos internos ou trechos de código. Uma mudança mínima de redação pode silenciosamente gerar código que remove validação de entrada ou expõe segredos, e você pode não notar até depois.

Trate prompts como mudanças de produto: registre cada edição, mantenha uma versão conhecida como boa e faça cada mudança fácil de desfazer.

O que você precisa rastrear (e o que pode ignorar)

Um bom versionamento de prompts captura alguns detalhes que explicam a maior parte das regressões. O objetivo é simples: você (ou um colega) deve poder refazer a mesma requisição e entender por que os resultados estão diferentes.

Rastreie isto (causa regressões reais)

Para cada versão, mantenha um registro curto que inclua:

- O texto exato do prompt, copiado como está (incluindo qualquer mensagem de sistema ou instruções “ocultas”).

- O nome do modelo e configurações-chave (especialmente temperatura). Se ferramentas ou chamadas de função estiverem habilitadas, anote também.

- O input que você forneceu (texto de referência, trechos de exemplo, arquivos, restrições, regras de formatação).

- Uma saída “dourada” que você considerou boa, mais 1–2 frases sobre o que a tornou boa.

- O caso de teste que você usou para avaliá‑la (a mesma solicitação do usuário ou os mesmos dados de amostra).

Isso geralmente são só algumas linhas. O maior ganho de tempo é escrever os critérios de sucesso. As pessoas lembram do prompt, mas esquecem o que estavam tentando preservar.

Você pode ignorar isto (raramente ajuda)

Alguns detalhes parecem úteis, mas raramente explicam regressões:

- Pequenas edições de formatação que não mudam o significado.

- Ensaios longos sobre a intenção (além de uma nota curta “por que isso mudou”).

- Metadados cosméticos, a menos que afetem roteamento ou comportamento.

- Dezenas de amostras de saída. Uma saída dourada representativa vale mais do que dez aleatórias.

Um padrão comum: você reduz a temperatura para obter respostas mais consistentes. Uma semana depois as saídas parecem rígidas e perdem detalhes. Se você registrou a mudança de temperatura e salvou uma saída dourada anterior, pode reverter com confiança em vez de adivinhar.

Um esquema simples de versionamento que você realmente usará

O versionamento de prompts só funciona se for leve. Se virar um ritual pesado, você vai parar de fazer quando mais precisar.

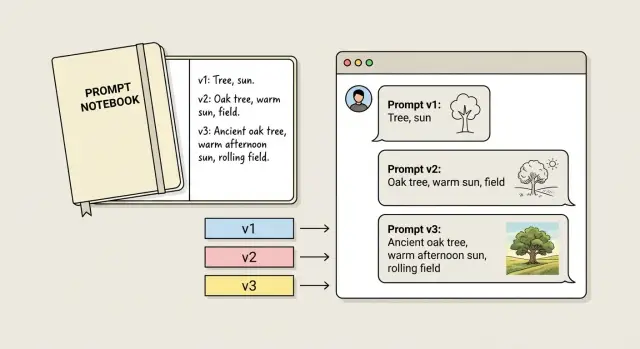

Use IDs curtas que você possa referenciar em qualquer lugar: v1, v1.1, v2.

- Major (v1, v2, v3): o objetivo mudou (novo público, novo formato, novas restrições, novas regras de avaliação). Espere saídas diferentes.

- Minor (v1.1, v1.2): o objetivo é o mesmo, mas você ajustou a redação, a ordem, um exemplo ou uma regra.

- Hotfix (v1.1a): um patch rápido ou reversão para restaurar o comportamento.

Mantenha uma frase de objetivo por versão. Se você não consegue descrever a função do prompt em uma linha, a mudança provavelmente é maior do que pensa.

Tente fazer uma mudança significativa por versão. Se você muda o tom, adiciona restrições e reescreve exemplos de uma vez, não saberá o que causou a melhoria (ou a quebra).

A configuração de menor esforço: um arquivo, mesma estrutura sempre

Se você fizer só uma coisa, armazene as versões do prompt num único lugar. Um documento, uma nota ou um arquivo no seu repo já basta. O ponto é responder, em 30 segundos: “O que mudou, e quando a saída piorou?”

Escolha um nome de arquivo que você lembre (por exemplo: prompts.md ou prompt_versions.md). Depois use a mesma estrutura para cada versão.

Um template simples que você pode copiar

Use os mesmos blocos sempre: o prompt, o changelog daquela versão, um exemplo de saída dourada e uma linha curta de “problemas conhecidos”.

# Prompt: Support Reply Writer

## v1.3 (2026-01-21)

### Prompt

[Paste the full prompt here. No snippets.]

### Change log

- Why: Reduce overly formal tone.

- What changed: Added "Write like a helpful human" and removed "Use professional language".

### Golden output

[Paste the exact best output you want to preserve.]

### Known issues

Sometimes forgets to ask one follow-up question.

Algumas regras fazem isso durar no tempo:

- Cole o prompt completo toda vez. Prompts parciais são onde a confusão começa.

- Escreva o “porquê” em palavras simples. “Melhorar qualidade” não é um porquê. “Para parar de usar bullets em e-mails curtos” é.

- Mantenha uma saída dourada por versão. Escolha o exemplo que você odiaria perder.

Como deve ser a “saída dourada”

Saída dourada não é “a melhor saída de todas”. É um instantâneo que você pode comparar depois.

Use um input real e cole a saída exata que você aprovou, incluindo formatação, tom e seções obrigatórias. Se uma nova versão começar a adicionar claims exagerados ou pular detalhes-chave, você vai notar imediatamente.

Adicione uma linha de “problemas conhecidos” mesmo se parecer menor. Isso evita que você (ou um colega) tente “consertar” a mesma coisa duas vezes e quebre outra.

Passo a passo: como mudar um prompt sem perder a boa saída

O objetivo é simples: mantenha uma saída conhecida que você possa sempre retornar. Comece com uma tarefa base que importe e seja fácil de repetir, como: “Resuma este e-mail de cliente em 3 bullets e uma resposta educada.” Execute seu prompt atual uma vez, salve o texto do prompt como v1 e salve o input e a saída exatos.

Então escreva um checagem em linguagem simples do que “bom” significa. Evite objetivos vagos como “melhor” ou “mais útil”. Faça algo que você julgue rápido.

Um fluxo prático:

- Congele uma baseline: salve o prompt v1 + input baseline + output.

- Escreva uma regra passar/falhar: 2–4 linhas (por exemplo: “Sem fatos inventados. Usa o nome do cliente. Inclui um próximo passo claro. Menos de 120 palavras.”).

- Mude uma coisa: edite uma instrução, restrição ou exemplo e salve como v1.1.

- Rerun com a mesma baseline: mesmo input, mesmas configurações.

- Decida rápido: se passar, mantenha v1.1. Se falhar, reverta e tente outra única mudança.

Se você acrescenta “seja mais criativo” e o modelo começa a inventar detalhes, isso é uma regressão contra “sem fatos inventados”. Mantenha v1 como sua cópia segura. Tente uma mudança mais precisa como “use um tom mais caloroso” sem convidar novas informações.

Só depois que v1.1 passar você deve expandir o objetivo (novo formato de saída, mais casos de borda). Aí faz sentido pular para v2.

Como testar uma mudança de prompt rapidamente (sem overthinking)

Testes rápidos são principalmente sobre consistência. Se você muda o prompt e os inputs ao mesmo tempo, não saberá o que causou a mudança.

Escolha um pequeno conjunto de exemplos reais que você realmente execute toda semana. Inclua um input levemente bagunçado.

Uma rotina repetível:

- Escolha 3–5 inputs de teste.

- Congele todo o resto (modelo, temperatura, ferramentas, mensagem de sistema).

- Execute Versão A e Versão B com os mesmos inputs.

- Compare lado a lado e escreva uma nota de uma linha por teste.

- Se B for melhor no geral, promova e registre a mudança.

Mantenha a pontuação simples:

- Correto: fez a tarefa sem pular detalhes chave?

- Seguro: evitou vazar segredos, claims arriscados ou seguir instruções ruins?

- No formato: bateu a estrutura necessária (cabeçalhos, JSON, tom, comprimento)?

Exemplo: você adiciona “seja conciso” a um prompt de resposta de suporte. Dois testes ficam melhores. No terceiro (um pedido de reembolso raivoso), ele para de pedir o número do pedido e dá um pedido de desculpas vago. Isso é uma regressão na correção, mesmo que a leitura esteja melhor.

Cenário exemplo: um pequeno ajuste que silenciosamente quebra resultados

Um fundador usa um prompt para redigir e-mails de suporte. O trabalho é simples: responder rápido, manter a calma e nunca prometer algo que o produto não faz.

A Versão 1 funciona bem. Diz ao modelo para citar apenas o que o cliente disse, oferecer dois próximos passos e fazer uma pergunta de esclarecimento.

Depois de algumas semanas, o fundador quer um tom mais caloroso e e‑mails um pouco mais curtos. Eles criam a v2. Os e‑mails soam melhores, mas aparece um novo problema: o modelo começa a inventar detalhes como “Chequei sua conta” ou “Posso ver que seu último pagamento falhou”. Isso é arriscado se o suporte não consegue realmente ver essas informações.

O changelog mostra uma linha nova em v2:

v2 change: “Be helpful by filling in missing context when it seems obvious.”

Essa única instrução incentiva a extrapolação. Como o changelog é específico, o fundador consegue apontar o gatilho e consertar rápido.

Eles regridem para v1.1 (a última versão conhecida como boa) e reaplicam só as partes seguras da v2: saudação mais calorosa, fechamento mais curto e a estrutura de “dois próximos passos”. Removem qualquer coisa que permita chutes e adicionam uma regra rígida: “Se não tiver certeza, faça uma pergunta em vez de assumir.”

Erros comuns que tornam regressões difíceis de depurar

As regressões de prompt geralmente são autoinduzidas, não porque a ideia era ruim, mas porque a mudança escondeu a causa.

O maior erro é mudar muita coisa de uma vez. Se você editar o objetivo, tom, regras de formato e exemplos num só commit, não dá para saber o que quebrou. A correção vira tentativa e erro, e as pessoas costumam empilhar mais instruções para compensar.

Outro erro é não salvar uma saída conhecida como boa. Sem um antes/depois, você acaba discutindo a partir da memória.

As falhas que mais fazem perder tempo:

- Múltiplas edições de uma vez, sem causa clara.

- Nenhuma saída “boa” salva e nenhum input salvo que a produziu.

- Mudança nos dados de teste e culparam o prompt.

- Configurações diferentes entre execuções (versão do modelo, temperatura, mensagem de sistema, configuração de ferramentas).

- Rastrear só o texto final do prompt, não o porquê da mudança ou o que você esperava.

Disciplina vence esperteza: mude uma coisa, mantenha os inputs de teste fixos e escreva o motivo de cada edição em uma frase.

Checklist rápido antes de lançar uma nova versão de prompt

Antes de lançar um novo prompt, faça uma verificação rápida para reproduzir o último resultado bom e garantir que você pode reverter se a qualidade cair.

A checagem de 5 minutos antes do deploy

- Você consegue reproduzir a última boa saída? Use inputs salvos e confirme que ainda obtém o resultado baseline.

- Mudou só uma variável? Uma edição significativa por versão mantém causa e efeito claros.

- Tem um teste passar/falhar? Escolha 2–3 checagens que você julgue rápido (campos obrigatórios, formato exato, sem fatos inventados).

- Que tipo de falha é? Categorize: formato, fatos, segurança ou tom.

- É mais rápido reverter do que corrigir? Se você está empilhando correções sobre uma mudança instável, reverta e refaça a edição limpidamente.

Se seus prompts geram código ou mudam comportamento do app, leve isso ainda mais a sério. Reproduza, isole uma mudança, teste passar/falhar e reverta cedo.

Próximos passos: torne isso um hábito (e quando pedir ajuda)

A forma mais fácil de manter o versionamento é parar de tratar seu melhor prompt como um caso isolado. Transforme-o num template reutilizável com placeholders claros (objetivo, público, restrições, exemplos). Quando você parte sempre da mesma estrutura, percebe o que mudou e as reversões continuam fáceis.

Torne o hábito tão pequeno que não dê para pular:

- Use um ID curto mais a data (por exemplo:

support_reply_v07_2026-01-21). - Adicione uma linha simples descrevendo a mudança.

- Salve a saída conhecida como boa com a versão, não no histórico de chat.

- Registre o que você esperava melhorar e o que piorou (se acontecer).

Às vezes o problema não é o prompt. Se você vê comportamento inconsistente entre usuários, dados faltando, autenticação quebrada ou falhas que só ocorrem em produção, pode ser um problema do app.

Se você herdou um app gerado por IA de ferramentas como Lovable, Bolt, v0, Cursor ou Replit e ajustes no prompt não bastarem, uma equipe de remediação como a FixMyMess (fixmymess.ai) pode rodar uma auditoria gratuita de código para identificar problemas como autenticação quebrada, segredos expostos e falhas de segurança antes de decidir reparar ou reconstruir.

Perguntas Frequentes

O que significa “regressão de saída” em prompts?

É quando um prompt que antes produzia bons resultados começa a entregar resultados piores depois que você o altera. A saída pode variar no tom, perder a estrutura exigida, ignorar restrições ou ficar menos consistente entre execuções.

Por que uma pequena edição no prompt pode causar uma grande mudança na saída?

Porque o modelo reage ao conjunto de sinais do prompt, não seguindo instruções como uma lista de verificação estrita. Uma pequena mudança de palavra, reordenação ou um prompt mais longo pode alterar o que o modelo considera mais importante.

Qual a maneira mais rápida de depurar uma regressão?

Comece executando exatamente o mesmo input com a versão antiga e a nova, usando as mesmas configurações. Se você não consegue reproduzir o resultado “bom” de antes, está depurando no escuro — trave o texto do prompt, o modelo e as configurações primeiro.

O que devo rastrear para cada versão de prompt?

Salve o texto completo do prompt, o nome do modelo e configurações-chave como temperatura. Também salve o input exato que você testou, mais uma “saída dourada” que você aprovou e uma nota curta descrevendo o que a tornou boa.

Quando devo usar versão major vs minor (e hotfix)?

Versões principais são para quando o objetivo muda (novo público, novo formato, novas regras de avaliação). Versões menores são para pequenas edições mantendo o mesmo objetivo, e hotfixes são correções rápidas ou reversões para restaurar o comportamento.

Por que “uma mudança significativa por versão” é tão importante?

Porque isso deixa clara a relação de causa e efeito. Se você mudar tom, regras de formato e exemplos ao mesmo tempo, não saberá qual mudança ajudou ou prejudicou, então não conseguirá manter a parte boa e reverter a ruim com confiança.

O que uma “saída dourada” deve incluir?

Deve ser uma saída real produzida a partir de um input real que você valoriza, colada exatamente como foi gerada, incluindo formatação e tom. Não precisa ser perfeita; é um ponto de referência para perceber rápido quando uma nova versão começa a pular requisitos ou inventar detalhes.

Como testar mudanças no prompt sem complicar demais?

Use um pequeno conjunto repetível de inputs reais e execute ambas as versões com o mesmo modelo e configurações. Julgue com um teste simples de passar/falhar, como “sem fatos inventados”, “mantém o formato” e “inclui o próximo passo necessário”, para decidir rápido.

Por que os prompts começam a inventar detalhes quando tento torná-los mais amigáveis ou curtos?

Instruções como “seja mais criativo” ou “preencha contexto faltante” podem empurrar o modelo a chutar, o que costuma aumentar imprecisões. Se a precisão for importante, prefira regras como “Se não tiver certeza, faça uma pergunta em vez de assumir” e mantenha “sem inventar fatos” como restrição rígida.

Quando não é um problema de prompt, e o que devo fazer então?

Reverter o prompt não vai consertar problemas que vêm do próprio aplicativo, como autenticação quebrada, segredos expostos ou caminhos inseguros que aparecem só em produção. Se você herdou um app gerado por IA de ferramentas como Lovable, Bolt, v0, Cursor ou Replit, a FixMyMess (fixmymess.ai) pode rodar uma auditoria gratuita de código e então reparar ou reconstruir quando ajustes no prompt não forem suficientes.