Безопасный импорт больших CSV в продакшене без сбоев приложения

Научитесь безопасно импортировать большие CSV в продакшен: стрим-парсинг, построчная валидация, частичные ошибки и понятные отчёты без падения приложения.

Почему большие импорты CSV падают в продакшене

Импорт CSV может выглядеть нормально на маленьком тестовом файле, а затем развалиться, когда реальный клиент загрузит 300 000 строк. В продакшене сети медленнее, лимиты времени строже, а данные — грязнее. Если импорт был реализован как быстрая фича, он обычно предполагает, что всё чисто и мало.

Самая частая причина — память. Многие импортеры читают весь файл в оперативную память, затем парсят его в объекты, валидируют и держат в массивах до конца. Файл, который кажется "не таким уж большим", может взорвать память, когда разворачивается в структуру приложения. Добавьте несколько одновременных загрузок — и сервер начнёт свапить, тормозить или перезапускаться.

Вторая большая проблема — время. Веб-запросы и serverless-задачи часто имеют жёсткие ограничения по исполнению. Даже если импорт завершится за 10 минут, его могут убить через 60 секунд, оставив вас с частично записанными данными.

Другие типичные точки отказа:

- Всплески памяти из-за загрузки всего файла или буферизации слишком большого объёма

- Тайм-ауты из-за валидации и записей в базу внутри запроса

- Одна плохая строка, которая рушит весь импорт

- Дубликаты из-за повторных запросов, двойных кликов или повторной загрузки того же файла

- Частичные записи, оставляющие данные неконсистентными

Пользователь видит простое поведение: страница зависает, индикатор загрузки крутится бесконечно или появляется туманное «Импорт не удался» без подсказки, что исправить. Ещё хуже — пропавшие строки могут остаться незамеченными днями.

Вам нужна противоположность: предсказуемые результаты и доказательства. Вы должны знать, сколько строк принято, отклонено и пропущено, и почему. Такая ясность превращает страшную операцию в рутинную.

Небольшой пример: клиент загружает список продаж с пустым столбцом email в строке 18 237. Если импортёр бросает исключение и останавливается, вы теряете часы и доверие. Если он фиксирует ошибку строки и идёт дальше, вы завершаете задачу и возвращаете отчёт, по которому можно действовать.

Что значит «безопасный» импорт CSV

Импорт CSV безопасен, когда он завершает работу, не выводя приложение из строя, а результат предсказуем. Большинство продакшен-отказов происходят потому, что импорт пытается сделать слишком многое одновременно или правила неочевидны.

Начните с определения, что значит «успех» для ваших пользователей:

- Всё или ничего: если хоть одна строка неверна, ничего не сохраняется.

- Частичный успех: верные строки импортируются, плохие отклоняются с понятными причинами.

Чаще частичный успех удобнее для пользователей, но требует аккуратного проектирования, чтобы вы не получили наполовину созданные данные, ломающие другие части приложения.

Установите ожидания заранее. Хорошая функция импорта не безлимитна. Установите явные ограничения на размер файла и количество строк, и строго требуйте обязательные столбцы. Если столбец обязателен (например, email, SKU или user_id), быстро провалитесь до тяжёлой работы. Если поле опционально, относитесь к отсутствию значений как к норме и документируйте применяемое значение по умолчанию.

Жёсткие vs гибкие правила

Будьте жёсткими в структуре и гибкими в содержимом.

- Структура: обязательные заголовки, типы данных, от которых зависит приложение, отношения между сущностями.

- Содержимое: дополнительные столбцы, которые вы игнорируете, опциональные поля, небольшие различия в форматировании, которые можно нормализовать (например, обрезать пробелы).

Простой способ определить безопасность — ответить на вопросы:

- Какие ограничения вы будете применять (строки, размер, обязательные заголовки)?

- Какие ошибки останавливают весь импорт, а какие отклоняют только строку?

- Что вы будете логировать для поддержки, а что показывать пользователю?

- Как вы предотвратите повторный импорт того же файла?

Последний пункт — это идемпотентность. Дайте каждому импорту стабильный ключ (например, контрольную сумму файла плюс пользователь и временное окно) и сделайте повторные отправки безопасными.

Стрим-парсинг вместо чтения всего файла

Чтение всего CSV в память работает в демо, но рушится в продакшене. Один клиентский файл может занимать сотни мегабайт. Если приложение читает его целиком, будут всплески памяти, тайм-ауты и возможные перезапуски сервера.

Стриминг держит память постоянной. Вместо построения одной огромной строки или массива вы читаете небольшой кусок, парсите несколько строк, обрабатываете их и переходите дальше. При правильной реализации стриминг — основа надёжных импортов, потому что ограничивает вред от любого плохого файла.

Как стриминг выглядит на практике

Стрим-парсер читает байты из загрузки маленькими кусками и эмиттирует полные строки, как только может. Ваш код обработки импортирует строки по одной или малыми батчами, так что прогресс продолжается даже при огромном файле.

Здесь проявляются и реальные CSV-капризы:

- Кодировка: требуйте UTF-8 (или определяйте её) и быстро проваливайтесь, если декодировать нельзя.

- Разделители: поддерживайте запятые или точки с запятой там, где это релевантно, но не пытайтесь гадать бесконечно.

- Кавычки: используйте настоящий CSV-парсер, чтобы запятые внутри кавычек не разбивали столбцы.

- Переносы строк: корректно принимайте Windows- и Unix-окончания строк, чтобы не ошибаться в подсчёте строк.

Прежде чем обрабатывать тысячи строк, поймайте фатальные проблемы на уровне файла как можно раньше. Если отсутствуют заголовки или столбцы не соответствуют ожиданиям, продолжение только создаст шум.

Простая ранняя проверка включает:

- Файл не пуст и содержит строку заголовка

- Присутствуют обязательные столбцы

- Разделитель и правила кавычек парсят первые N строк корректно

- Количество столбцов в разумных пределах (защита от поломанного экранирования)

Построчная валидация, которая ловит проблемы рано

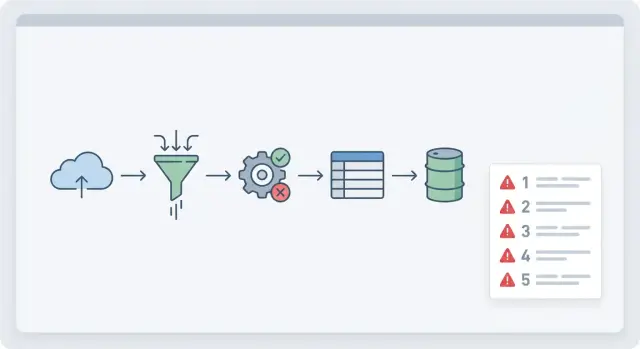

Относитесь к валидации как к воронке: проверьте файл один раз, затем валидируйте каждую строку по мере потока.

Проверки на уровне файла отвечают на вопрос «это нужный файл?» перед тем, как трогать базу. Подтвердите имена заголовков, кодировку файла, разделитель и приближённые лимиты размера. Если заголовок неверный — остановитесь рано с одним понятным сообщением.

Построчные проверки отвечают на вопрос «годится ли эта строка?» и должны выполняться независимо для каждой строки. Одна плохая строка не должна ломать импорт или отравлять весь пакет.

Практический валидатор строк покрывает:

- Обязательные поля (отсутствует email, пустой SKU)

- Типы и диапазоны (количество не может быть отрицательным, цены в здравых пределах)

- Даты и форматы (некорректные даты вроде 2025-02-30)

- Допустимые значения (status должен быть active, paused или archived)

- Бизнес-правила (уникальные ключи, существование связей вроде customer_id)

Нормализуйте ввод перед валидацией, чтобы не отклонять данные, которые по сути корректны. Обрезайте пробелы, приводите к единому регистру там, где это помогает (например, email), и трактуйте распространённые обозначения пустого значения ("N/A", "null", "-") как отсутствие. Применяйте одинаковую нормализацию везде, чтобы дубликаты не проскальзывали как "ACME" vs "acme ".

Держите сообщения валидации короткими и практичными. Хороший шаблон: номер строки, столбец, проблема и подсказка.

Пример: “Строка 128, start_date: неверная дата. Используйте YYYY-MM-DD.”

Идемпотентность и защита от дубликатов

Импорт CSV кажется простым, пока кто-то не нажмёт «Импорт» дважды, браузер не попытается снова или два коллеги не загрузят один и тот же файл одновременно. Без идемпотентности вы получаете не только дубликаты — возможны конфликтующие обновления и сломанные итоги.

Решите, как система будет распознавать «ту же самую строку». Номер строки ненадёжен, если пользователь сортирует или редактирует файл, поэтому связывайте его с ключевыми полями записи.

Распространённые подходы:

- Натуральные ключи (email для пользователя, SKU для товара)

- Внешние идентификаторы (ID из внешней системы)

- Составной ключ (organization_id + invoice_number)

- Ключ импорта на уровне файла плюс отпечаток строки (хеш ключевых полей)

Повторы должны быть безопасными по дизайну. Создайте запись «сессия импорта» при старте загрузки, затем записывайте результат каждой строки в контексте этой сессии. Добавьте идемпотентный ключ для каждой строки и обеспечьте его уникальность на уровне базы. Если та же строка приходит снова, пропускайте её или превращайте в обновление, в зависимости от правил.

Гонки проявляются, когда два импорта одновременно трогают одни и те же записи. Используйте ограничения БД как последний рубеж и контролируйте конкурентность. Например, обрабатывайте импорты для одного и того же арендатора по очереди или блокируйте по натуральному ключу при записи.

Частичные отказы без порчи данных

Частичные ошибки нормальны для файлов клиентов. Риск не в том, что несколько строк неверны. Риск — в том, что вы получите наполовину записанные данные, ломающие остальные части приложения.

Ваша цель проста: импорт либо завершается в известном корректном состоянии, либо база остаётся неизменной.

Выберите понятную политику отказа

Выберите одну политику и покажите её в UI:

- Всё или ничего: любая неверная строка отвергает весь импорт

- Частичный приём: валидные строки сохраняются, неверные строки возвращаются в отчёте

- Порог: принимайте только если количество ошибок ниже заданного порога (например, 2%)

Что бы вы ни выбрали, добавьте шаг стадирования. Парсьте и валидируйте в staging-таблицу (или временное хранилище) сначала. Записывайте финальные записи только после прохождения проверок. Если вы разрешаете частичный приём, всё равно стадиируйте, затем коммитьте только хорошие строки партиями в контролируемых транзакциях.

Отслеживайте результат по строкам, чтобы можно было объяснить, что произошло, без домыслов. Набор статусов небольшой и информативный: success, failed, skipped (duplicate/empty), updated (соответствовало существующей записи).

Работа с зависимостями

Зависимости — это место, где частичные импорты становятся опасными.

Пример: CSV содержит Customers и Orders. Сохранение Order без его Customer ломает данные.

Выберите правило и придерживайтесь его:

- Требовать сначала родителей (отклонять дочерние строки, если родителя нет)

- Двухпроходный импорт (сначала загрузить родителей, потом детей)

- Карантин для зависимых (держать дочерние строки до создания родителя)

Когда вы отчётываете «частичный успех», используйте понятный язык: сколько строк сохранено, сколько — нет, были ли пропуски или обновления.

Понятные пользователю отчёты об ошибках, которые они действительно исправят

Импорт CSV может быть технически корректным и при этом выглядеть сломанным, если отчёт об ошибках запутан. Цель — сказать людям, что произошло, что нужно исправить и как попробовать снова без догадок.

Начните с простой сводки вверху: всего строк, импортировано, пропущено, неудачно. Если вы поддерживаете частичный успех, чётко укажите, что некоторые строки были сохранены.

Затем покажите построчные детали, указывающие точную проблему:

- Номер строки (как пользователь видит в CSV)

- Имя столбца

- Полученное значение

- Что ожидалось (формат или правило)

- Короткое сообщение с действием

Делайте сообщения конкретными. «Недопустимое значение» раздражает. «Дата должна быть в формате YYYY-MM-DD, получили 3/7/24» — это исправимо. Если поле должно быть одним из нескольких значений, перечислите их.

Избегайте утечки чувствительных деталей. Не показывайте стектрейсы, SQL-ошибки, внутренние ID или что-то, что раскрывает настройки безопасности. Преобразуйте внутренние ошибки в безопасные сообщения вроде: «Мы не смогли сохранить эту строку. Попробуйте ещё раз или свяжитесь с поддержкой, если ошибка повторится.»

Упростите повторную загрузку. Сохраните ту же маппировку столбцов, которую пользователь выбрал в первый раз, и предложите файл с ошибками для правки и повторной загрузки (часто это оригинальные строки плюс дополнительный колонка «error").

Пошаговый рабочий процесс для продакшен-готового импорта

Рабочий процесс, который выдержит реальные данные, исходит из предположения, что что-то пойдёт не так: плохая дата, отсутствующее обязательное поле, конфликт ключей или файл больше ожидаемого.

Рабочий процесс

-

Сначала создайте сессию импорта. Когда пользователь загружает файл, создайте запись сессии импорта с информацией о загрузившем пользователе, времени, ожидаемой схеме/версии и статусом (queued/running/complete). Сохраните сырой файл в надёжном хранилище и его контрольную сумму, чтобы можно было доказать, что обработано.

-

Стрим-парсинг и стадирование батчами. Парсите CSV как поток и записывайте строки в staging-таблицу (или временное хранилище) малыми батчами (например, 500–2000 строк). Это держит память стабильной и даёт безопасные контрольные точки.

-

Валидируйте построчно, записывайте ошибки, продолжайте. Для каждой строки нормализуйте значения (обрезка, парсинг дат, маппинг enum'ов), затем выполняйте правила валидации. Вместо генерации исключения записывайте структурированную запись об ошибке, привязанную к сессии импорта и номеру строки (поле, сообщение, исходное значение).

-

Коммитьте только валидные строки безопасными upsert’ами. Переносите валидные staged-строки в итоговые таблицы внутри контролируемых транзакций. Используйте уникальные ключи и upsert’ы, чтобы дубликаты не создавали дополнительных записей.

-

Генерируйте удобную для пользователя сводку. Сохраните метрики: обработано строк, импортировано, неудачно, и основные типы ошибок. Подготовьте отчёт об ошибках, который пользователь сможет фильтровать и править.

Пример: пользователь импортирует 50 000 клиентов, и 312 строк имеют неверные email — вы всё равно импортируете остальные 49 688 и возвращаете отчёт с точными номерами строк и подсказками для исправления.

Повтор без повторной загрузки

Поддерживайте повтор через ту же сессию импорта: храните оригинальный файл, используйте те же правила валидации и перезапускайте после исправления данных пользователем. Чтобы это было надёжно, путь повторной обработки должен иметь те же идемпотентные правила, что и первый запуск.

Ограждения по производительности и надёжности

Импорт CSV — это длительная задача. Обращайтесь с ней соответственно. Если она выполняется внутри обычного веб-запроса, вы рискуете тайм-аутами, зависшими экранами и частичными записями. Перенесите импорт в фоновую задачу, а UI пусть опрашивает прогресс — так приложение остаётся отзывчивым.

Обновления прогресса должны быть реальными, а не «всё ещё работает». Отслеживайте стадии (upload, parse, validate, write, finalize) и показывайте счётчики: прочитано строк, принято, отклонено и затраченное время.

Установите лимиты, чтобы один плохой файл не занял всю систему:

- Максимальное время работы импорта (при неудаче — понятное сообщение, частичная работа изолирована)

- Ограничение размера батча (мелкие батчи снижают время блокировок и всплески памяти)

- Максимум ошибок до остановки (например, остановить после 200 плохих строк)

- Максимальный размер файла и число столбцов (отклонять заранее)

- Максимум параллельных импортов на рабочее пространство/аккаунт

Backpressure важен, когда база медленнее чтения файла. Если запись начинает отставать, замедлите ридер или приостановите парсинг. Иначе память вырастет, воркер упадёт и вы потеряете состояние.

Сделайте процесс наблюдаемым. Логируйте ID импорта, кто его запустил, метаданные файла и временные метрики по стадиям. Добавьте базовые метрики: строки в секунду и время записи в БД. Когда кто-то скажет «импорты сломаны», вы хотите быстро получить ответы.

Планируйте отмену. Если пользователь загрузил не тот файл, он должен иметь возможность безопасно остановить процесс. Делайте записи маленькими транзакциями и стадиируйте входящие строки. При отмене или неудаче удаляйте staging-данные и помечайте сессию как canceled, чтобы повторный старт был чистым.

Частые ошибки, которые приводят к падениям или плохим импортам

Большинство продакшен-отказов при импортах — не про «большие данные», а про мелкие допущения, которые ломаются при реальных файлах.

Одна распространённая ошибка — доверять строке заголовка. Люди переименовывают столбцы, добавляют пробелы или экспортируют из другой системы. Если вы не проверяете нужные столбцы и не мапите их явно, значения могут сместиться в неверные поля, и вы заметите это лишь позже.

Экспорт из Excel приносит свои ловушки. Ведущие нули в идентификаторах могут быть отброшены, длинные числа преобразуются в научную нотацию, а даты приходят как текст, серийные номера или смешанные форматы в одном столбце. Если ваш импортёр догадывается с типами, вы получите тихую порчу данных вместо явной «Строка 42: неверная дата».

Вариации формата файла — ещё одна частая причина: UTF-16, BOM, точки с запятой вместо запятых или кавычки с вложенными переносами строк. Если парсер ожидает один идеальный формат, один странный файл может повесить процесс или перемешать строки.

Паттерны, которые неизменно вызывают падения или плохие импорты:

- Одна гигантская транзакция для сотен тысяч строк (слишком долго блокирует, тайм-ауты, всплески ресурсов)

- Трактовать каждое пустое значение как ошибку, хотя поля опциональны

- Писать строки напрямую без идемпотентных проверок (повторы создают дубликаты)

- Возвращать одно общее «Импорт не удался» без номеров строк и имён полей

- Смешивать валидацию и запись так, что частичные ошибки трудно восстановить

Пример: пользователь загружает 200k контактов, но 50 строк имеют неверные даты. Если ваш код откатывает всё и показывает одну расплывчатую ошибку, пользователь повторит попытку, создаст дубликаты или сдастся.

Быстрый чек-лист и следующие шаги

Если вы хотите импорты, которые не крашат приложение, стремитесь к предсказуемости и тому, чтобы база никогда не оставалась наполовину неверной.

Простой продакшен-чек-лист:

- Установите ясные лимиты (макс. строк, макс. размер файла, обязательные заголовки)

- Парсьте как поток, а не загружайте весь файл в память

- Валидируйте каждую строку рано (типы, обязательные поля, диапазоны, проверки связей)

- Сделайте процесс идемпотентным (обнаружение дубликатов и безопасные повторные попытки)

- Стадируйте и коммитьте малыми батчами, чтобы контролировать записи

Решите политику частичных ошибок заранее и применяйте её последовательно. Многие команды выбирают «принимать валидные строки, отклонять неверные», но только если сводка понятна и записи выполняются безопасно.

Короткий план тестов перед релизом изменений:

- Маленький чистый файл

- Файл с заранее подготовленными ошибочными строками (отсутствующие значения, неверные даты)

- Огромный файл, близкий к вашим лимитам

- Повторная загрузка одного и того же файла

- Повтор после прерывания (остановить середине, затем возобновить)

Если вы унаследовали импорт, сгенерированный ИИ, который падает под нагрузкой или создаёт дубликаты, обычно это исправимо без полной переписки приложения. FixMyMess (fixmymess.ai) фокусируется на диагностике и починке кодовых баз, сгенерированных ИИ, включая потоки импорта, которым нужны стадирование, идемпотентность и более безопасная валидация, чтобы работать в продакшене.

Часто задаваемые вопросы

Почему мой импорт CSV работает с 1 000 строк, но падает с 300 000?

Крупные импорты обычно падают потому, что код читает весь файл в память, выполняет всю валидацию за один проход или пытается записать всё в рамках одного веб-запроса. Это вызывает всплески памяти, тайм-ауты и частичные записи, когда процесс убивается.

Что такое стрим-парсинг и почему он безопаснее, чем чтение всего файла?

Стрим-парсинг читает файл частями и обрабатывает строки по мере их поступления, поэтому использование памяти остаётся стабильным. Это позволяет показывать прогресс, обработать плохие строки без падения и держать приложение отзывчивым при долгих импортах.

Что мне нужно валидировать перед обработкой строк?

Сначала выполните проверки на уровне файла: убедитесь, что файл не пустой, есть строка заголовка, присутствуют обязательные столбцы, а кодировка и разделитель распознаются. Если структура неверна, остановитесь рано и покажите одно понятное сообщение, чтобы не тратить время на мусор.

Как не допустить, чтобы одна плохая строка ломала весь импорт?

Выполняйте построчную валидацию независимо для каждой строки и записывайте ошибки вместо генерации исключений, которые останавливают весь импорт. Делайте сообщения полезными: номер строки, столбец, что не так и ожидаемый формат.

Должен ли импорт быть «всё или ничего» или разрешать частичный успех?

Выберите политику и сделайте её явной: всё или ничего, частичный приём или порог (например, отклонять, если более 2% строк неверны). Частичный приём обычно удобнее пользователям, но требует стадирования и аккуратных записей, чтобы не создавать несогласованных связей.

Как предотвратить дубликаты при повторной загрузке или повторной попытке импорта?

Сделайте повторы безопасными по умолчанию: пользователи могут нажать дважды, браузеры повторяют запросы, коллеги загружают тот же файл. Добавьте сессию импорта и идемпотентный ключ (на основе стабильного ключа записи или отпечатка строки) и обеспечьте уникальность в базе, чтобы повторная обработка не создавала дубликатов.

Как избежать частичных записей, которые оставляют базу в неконсистентном состоянии?

Сначала сохраняйте данные в staging, затем коммитьте валидные строки в небольших, контролируемых транзакциях. Избегайте одной гигантской транзакции для всего файла и не пишите напрямую в итоговые таблицы, пока не будете уверены в корректности — иначе вы получите частичные импорты, которые сложно объяснить или откатить.

Почему импорты CSV должны выполняться как фоновые задания, а не внутри веб-запроса?

Не выполняйте большие импорты в рамках обычного HTTP-запроса. Поместите импорт в фоновую задачу, храните статус в сессии импорта и дайте UI опрашивать прогресс, чтобы страница не зависала и работа не убивалась лимитами запроса или serverless-таймаутами.

Что должен включать удобный для пользователя отчёт об ошибках?

Дайте сначала сводку (всего, импортировано, неудач, пропущено/обновлено), а затем построчные детали, соответствующие CSV пользователя: номер строки, имя столбца, полученное значение, ожидаемое правило и короткое сообщение. Избегайте стектрейсов и внутренних ошибок БД, чтобы не раскрывать чувствительные данные.

Может ли FixMyMess помочь, если мой импорт, построенный ИИ, постоянно ломается в продакшене?

FixMyMess специализируется на починке приложений, сгенерированных ИИ, которые ломаются в продакшене, включая потоки импорта CSV, которые падают, тайм-аутятся или создают дубликаты. Если ваш текущий импортер ненадёжен, мы можем провести аудит кода, добавить стриминг, стадирование, идемпотентность и понятные отчёты, и сделать его безопасным без догадок.