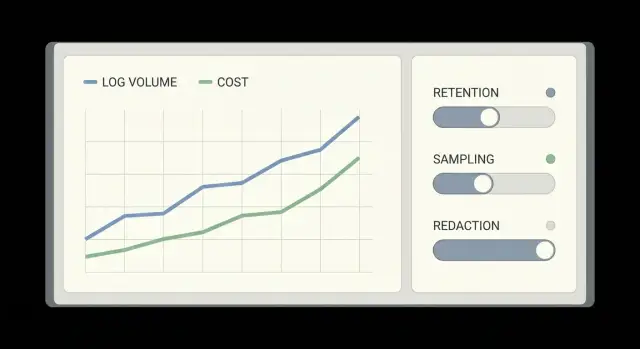

Контроль затрат на логирование для прототипов: ретеншн, семплирование, редактирование

Контроль затрат на логирование: настройте уровни хранения, правила семплирования и редактирование, чтобы быстрорастущие прототипы сохраняли полезные логи без неожиданно больших счетов.

Почему прототипы получают неожиданные счета за логи

Прототипы часто стартуют с принципа «логируй всё», потому что так кажется безопаснее — вдруг что-то пропустишь. Потом приходят реальные пользователи, трафик растёт, и каждый клик порождает десятки логов во frontend, backend, auth, базе данных и у сторонних сервисов. То, что было ручейком, превращается в пожарный шланг — порой за одни выходные.

Неожиданные счета возникают, когда расходы масштабируются в нескольких направлениях одновременно. Вы платите за приём логов, хранение их дольше, чем нужно, и за то, чтобы они были доступными для поиска. Логи также могут дублироваться по регионам, форвардиться в несколько инструментов или выгружаться для анализа — это добавляет расходы на исходящий трафик и запросы.

Обычно триггеры просты:

- debug-логирование оставлено в production

- один запрос создаёт много логов (ретраи, циклы, шумные клиенты)

- индексируются поля с высокой кардинальностью (user ID, полные URL, случайные токены)

- длительная стандартная ретеншн, которой никто не пользуется

- большие полезные нагрузки в логах (тела запросов, повторяющиеся стектрейсы)

«Полезные логи» для небольшой команды проще, чем кажется. В основном нужно ответить: Что сломалось? Кого это затронуло? Когда началось? Можно ли воспроизвести? Обычно хватает: явной ошибки, request/trace ID, нескольких ключевых полей контекста и одного хорошего стектрейса при сбое — а не дневника всех успешных запросов.

Цель — быстро дебажить, не платя за шум.

Откуда на самом деле берутся расходы на логирование

Большинство счетов можно свести к нескольким предсказуемым множителям, которые проявляются, когда прототип получает реальный трафик.

Ingest — первое, что увеличивает счёт. Каждый лог нужно отправить и принять сервисом логирования. Если код логирует при каждом запросе, каждом ретрае и на каждом тике фоновой задачи, объём растёт пропорционально пользователям и ошибкам.

Хранение и ретеншн — следующее. Хранить сырые логи 30–90 дней кажется безопасным, но дорого, если большинство логов никто не читает. Это усугубляется, когда dev, staging и production используют одинаковую ретеншн.

Поиск и индексирование — ещё один частый неприятный сюрприз. Желание «сделать всё searchable» часто означает индексирование гораздо большего числа полей, чем вы реально используете ежедневно.

Кардинальность — скрытый множитель. Поля с массой уникальных значений (user IDs, session tokens, полные URL с query, динамический текст ошибок) взрывают количество уникальных комбинаций, которые инструмент логирования должен отслеживать.

Быстрый список мультипликаторов для проверки:

- Высокообъёмные info-логи на каждый запрос

- Длинная ретеншн в шумных окружениях (dev и staging)

- Индексирование слишком многих полей по умолчанию

- Поля с высокой кардинальностью, добавленные как тэги/лейблы

- Дублирующие пайплайны, которые отправляют те же логи несколько раз

Решите, что вам действительно нужно от логов

Контроль затрат логирования начинается с одного решения: на какие вопросы должны отвечать логи при сбое.

Для большинства прототипов логи нужны в основном для:

- Ошибок и падений (что сломалось, где и почему)

- Проблем с аутентификацией (сбои входа, ошибки токенов, проверки разрешений)

- Платежей и биллинга (срыв списаний, ошибки webhook, дублированные события)

- Задержек и таймаутов (медленные endpoint’ы, медленные запросы, задержки третьих сторон)

Далее решите, когда нужен полный контекст, а когда хватит сводки. Полный контекст помогает при новых багах или инцидентах безопасности, но дорого стоит. Во многих случаях достаточно короткой записи: имя события, request ID, user ID (или безопасный хеш), статус-код и длительность. Полные полезные нагрузки оставляйте для редких случаев, за флагом или только при ошибках.

Также полезно разделять логи, метрики и трассы:

- Logs показывают, что случилось в конкретном запросе.

- Metrics показывают, как часто и насколько плохо (error rate, p95) без огромного объёма.

- Traces показывают, куда ушло время между сервисами.

Если пихнуть всё в логи, счёт растёт быстро, а дебаг остаётся хаотичным.

Наконец, классифицируйте данные в три корзины:

- Must keep: ошибки, решения авторизации, изменения состояния платежей, версия релиза, request IDs

- Nice to have: отладочные детали, которые используются редко

- Never log: секреты, пароли, access tokens, полные данные кредитных карт, личные сообщения в сыром виде

Простой пример: если регистрация не проходит, логируйте код ошибки и имя поля валидации, а не полное тело запроса.

Настройте уровни хранения, соответствующие реальному использованию

Хороший план ретеншн предполагает одну истину: разные типы логов нужны для разных временных интервалов. Если хранить всё одинаково, вы либо теряете нужные детали, либо платите за шум.

Практичная трёхуровневая схема ретеншн

- Hot (краткосрочно): высокообъёмные app и debug-логи для активного расследования. Хранить 1–3 дня.

- Warm (средний): стандартные request-логи и ключевые бизнес-события для последующего анализа инцидентов. Хранить 7–14 дней.

- Cold (долгосрочно): низкообъёмные, но ценные события безопасности и аудита (изменения прав, админ-действия). Хранить 30–180 дней в зависимости от риска и требований.

Hot должен быть компактным, но подробным. Cold — стабильным и удобным для поиска, но не переполненным отладочными строками.

Разные окружения — разные правила:

- В dev держите короткую ретеншн (часы–1 день).

- В staging — достаточно для сравнения релизов (2–7 дней).

- В production — держите warm и cold дольше, но строго контролируйте, что туда попадает.

Как выбирать числа без гаданий

Исходите из реального поведения:

-

Через какое время вы обычно замечаете проблему (в тот же день, на следующий, на следующей неделе)?

-

Сколько времени занимает воспроизведение и подтверждение фикса?

-

Какие события нужно хранить для безопасности или поддержки клиентов?

Используйте семплирование, чтобы сократить объём, не потеряв сигнал

Семплирование сохраняет сигнал и перестаёт платить за каждое «всё ок».

Начните с правила «ошибка в приоритете»: захватывайте 100% сбоев. Это включает error-логи, исключения, таймауты и любые запросы с кодами 4xx/5xx. Когда что-то ломается, вам нужен полный след.

Далее таргетируйте самые громкие успешные пути. Это часто health checks, фоновые опросы, навязчивые ретраи и endpoint’ы, попадающие при каждой загрузке страницы.

Практичные правила семплирования, которые всё ещё позволяют дебажить

- Храните 100% ошибок и предупреждений, плюс любые запросы выше порога латентности.

- Семплируйте высокообъёмные 200-ответы (например, 1 из 50).

- Добавляйте капы по endpoint’ам (например, макс 20 успешных логов в минуту на маршрут).

- Держите 100% редких событий (сброс пароля, биллинг, админ-действия).

- Отбрасывайте повторения: если одно и то же сообщение случилось 1000 раз, сохраняйте первые N и затем давайте сводку.

Rate limits — это предохранитель. Они останавливают баг (например, цикл ретраев) от взрыва объёма логов за ночь.

Документируйте правила простым языком и держите их стабильными. Предсказуемое семплирование делает расследование спокойнее, потому что вы знаете, что полностью захвачено, а что — семплировано.

Основы редактирования (redaction): защищайте секреты и данные пользователей

Редакция уменьшает риск и часто сокращает объём. Цель проста: сохранить полезность логов для дебага, не сохраняя секреты или личные данные, которые нельзя хранить.

Редактируйте на источнике (в приложении), а не позже в инструменте логирования. Если секрет залогирован хоть раз, он может скопироваться в бэкапы, экспорты и оповещения.

Сфокусируйтесь на местах, где данные чаще всего утекают:

- Заголовки запросов

- Cookies

- Пейлоуны авторизации

- Параметры query

Типичные рискованные поля: Authorization, Cookie, session ID, password-поля, reset links, API-ключи и любые значения, содержащие «token». Многие фреймворки также логируют полные объекты ошибок вместе с контекстом запроса — проверьте дефолтные настройки.

Если нужно связать события между запросами, маскируйте данные вместо полного удаления. Например, сохраняйте только последние 4 символа токена или логируйте односторонний хеш email вместо самого email.

Правило для PII: избегайте логирования имён, email’ов, телефонов, адресов и IP без чёткой причины и соответствующей политики хранения.

Автоматические проверки помогают не дать регрессиям:

- Добавьте middleware с denylist для редактирования (заголовки, cookies, известные поля)

- Добавьте тесты, которые падают, если логи содержат паттерны вроде

Bearer,sk-илиpassword= - Добавьте преддеплойный скан, который ищет секреты в недавних логах

- Держите маленький allowlist для «безопасных для логирования» полей

Пошагово: внедрение ретеншна, семплирования и редактирования

Начните с инвентаризации всех мест, где генерируются логи. Не догадывайтесь. Включите веб-приложение, фоновые воркеры/очереди, edge-функции, логи баз данных и всё, что связано с входом (auth, колбеки провайдера идентификации). Один пропущенный источник может держать расходы высокими и усложнить расследование инцидентов.

Далее стандартизируйте небольшой формат логов, чтобы быстро фильтровать и избегать шумных одноразовых форматов. Держите его простым: timestamp, level, имя сервиса и request ID (или trace ID). Добавьте короткое "event"-имя и небольшой JSON-контекст.

Затем установите дефолты по окружениям:

- Production: только info/warn/error

- Staging: разрешён debug на короткие периоды

- Local dev: можно логировать всё

Порядок внедрения, который обычно работает:

- Инвентаризуйте источники и назначьте владельца для каждого

- Примите небольшой шаблон и применяйте его в новом коде

- Установите уровни логов по окружениям с безопасным дефолтом для production

- Добавьте семплирование или rate limits для повторяющихся событий (health checks, polling, retries)

- Добавьте фильтры редактирования для секретов и PII и автоматические тесты

Внедряйте изменения постепенно. Сравните до и после по объёму, стоимости и полезности логов в расследованиях в течение недели.

Мониторинг затрат на наблюдаемость: ловите всплески рано

Если ничего не делать, счета за логирование имеют привычку расти молча и проявляться уже после случившегося. Контроль затрат логирования — это в основном ежедневный просмотр нескольких чисел и понимание, куда смотреть при их изменении.

Отслеживайте три тренда:

- Ежедневный ingest (сколько вы отправляете)

- Рост хранилища (сколько храните)

- «Top talkers» (сервисы или маршруты, генерирующие больше всего логов)

Top talkers часто — один шумный endpoint, одна фоновая задача в цикле ретраев или одна ошибка, которая логирует большой payload на каждый запрос.

Бюджетные оповещения важнее, чем идеальные дашборды. Настройте оповещения на несколько порогов (например, 50%, 75%, 90% месячного бюджета), чтобы было время среагировать.

Всплески обычно следуют за релизами, миграциями, изменениями конфигурации и резким ростом трафика. После каждого релиза проверяйте ingest и объём ошибок в первый час. Один оставленный debug-флаг может умножить затраты за ночь.

Постройте простой view для реагирования на стоимость

Когда растут расходы, вам нужны ответы за минуты:

- Какой сервис увеличил объём больше всего по сравнению со вчера

- Какой endpoint или задача вызвали всплеск

- Какой уровень логов изменился (info vs error vs debug)

- Какое поле добавилось (дампы payload, заголовки, стектрейсы)

- Какой релиз коррелирует со всплеском

Когда источник найден, обычно помогает одна из мер: понизить уровень логирования, добавить семплирование, убрать шумное поле или ограничить повторяющуюся ошибку.

Держите процесс лёгким: еженедельный 15-минутный обзор достаточен, пока вы быстро растёте.

Пример: быстрорастущий прототип, который перерастил своё логирование

Малая команда запустила прототип и выросла с 50 до 5000 пользователей за две недели. Сразу после добавления входа по email у части пользователей начались проблемы с аутентификацией. Они включили debug, чтобы отследить причину, и объём логов взорвался за ночь.

Проблема была не только в росте пользователей. Они логировали полные тела запросов, все заголовки и целые ответы авторизации. Там были длинные JWT, refresh-токены и иногда cookies сессий. Во время реакции люди копировали логи в чат — это умножало риск утечки.

Они перешли на «достаточно» логов. Вместо дампа всего, каждое событие аутентификации логировало: request ID, user ID (или анонимный ID), endpoint, статус-код, код ошибки, латентность и короткую причину. Для дебага они логировали, на каком шаге произошёл сбой (парсинг токена, поиск в БД, проверка пароля), а не сырой пейлоад.

Семплирование сделало основную работу. Они держали 100% ошибок и таймаутов, но только 5% успешных запросов аутентификации. Это показало тренды без хранения каждого OK.

Редакция закрыла пробел безопасности. Токены и секреты маскировались в логгере, так что поиск по логам во время инцидента не раскрывал креденшалы.

Их план ретеншн был прост:

- 7 дней: полные логи ошибок (без семплинга)

- 14 дней: семплированные логи запросов (успехи)

- 30 дней: события безопасности и аудита (минимум полей)

- 90 дней: только агрегаты по дням (счётчики, p95 латентности)

Частые ошибки, которые увеличивают расходы (и риск)

Большинство проблем с контролем затрат логирования происходят из одной привычки: включить «всё» во время прототипирования, а затем не выключить, когда приходят реальные пользователи.

Обычная ловушка — логировать полные тела запросов и ответов по умолчанию. Это кажется полезным, но мгновенно умножает объём и часто содержит пароли, токены, платёжные данные или приватные сообщения. Если нужны payload’ы, логируйте только небольшой allowlist безопасных полей и только на короткое время.

Ещё тихий драйвер расходов — индексировать каждое поле. Поля с высокой кардинальностью, такие как user_id, session_id, trace_id, email и полные URL с query, могут взорвать размер индекса. Оставляйте большинство полей как plain text и индексируйте только несколько стабильных полей, по которым вы реально фильтруете.

Три ошибки, которые обычно возникают прямо перед неожиданным счётом:

- Оставленный debug или verbose в production после инцидента

- Использование логов для аналитики (воронки, когорты) вместо метрик или событий

- Добавление редактирования только после того, как логи уже ушли к вендору

Редакция должна происходить до отправки из приложения. «Мы подчистим в пайплайне» даёт сбой при первом же неожиданном логировании нового эндпоинта.

Быстрый чек-лист перед очередным ростом

Рост превращает «пока нормально» логирование в счёт и риск за ночь.

- Запишите ваши уровни ретеншн и почему они существуют. Короткая ретеншн для отладочных логов, более длинная — только для тех логов, которыми вы реально пользуетесь.

- Добавьте правила семплирования для самых шумных путей. Семплируйте рутинные успешные логи, держите полные логи для ошибок и редких кейсов.

- Маскируйте секреты и персональные данные до того, как логи покинут приложение. Если вы не стали бы вставлять это в публичный чат, это не должно быть в логе.

- Включите бюджеты и оповещения и протестируйте их. Убедитесь, что оповещения срабатывают и кто-то их видит.

- Еженедельно просматривайте основные источники логов под владельцем. Назначьте одного человека ответственным за одобрение изменений логирования, чтобы "временная отладка" не стала постоянной.

Следующие шаги: стабилизируйте логирование по мере перехода в продакшен

Когда неожиданные счета прекратятся, цель — сохранить полезность логов по мере роста. Это меньше про одну большую правку и больше про привычки, которые не дадут объёму вернуться.

Начните с быстрого аудита в вашем лог-эксплорере: отсортируйте по тому, что даёт наибольший объём данных — самый шумный сервис, самый загруженный endpoint и самые большие строки логов. Для каждого спросите: это помогает решать реальные проблемы или это просто «приятно иметь»?

Исправляйте самые большие источники сначала:

- Шумный debug, случайно оставшийся в production-подобных окружениях

- Поля с высокой кардинальностью (полные URL с уникальными query, значения от пользователей)

- Сырые payload’ы (полные тела запросов/ответов, большие JSON-объекты, повторяющиеся стектрейсы)

Затем сделайте защиты тяжёлыми для случайного отката. Добавьте тесты редактирования, которые проваливают сборку, если логи содержат паттерны вроде API-ключей, JWT, паролей или распространённых префиксов секретов. Заведите простой "лог-контракт" для ключевых событий (ошибки аутентификации, ошибки платежей, сбои фоновых задач), чтобы знать, что обязательно логируется, а что никогда не должно попадать в логи.

Если вы унаследовали AI-сгенерированный прототип, запланируйте дополнительное время на очистку. Такие проекты часто идут с громким логированием по умолчанию, фрагментами, которые печатают заголовки или токены, и ненадёжными потоками авторизации, которые вызывают повторные ошибки (и повторяющиеся логи).

Если хотите внешнюю помощь, FixMyMess (fixmymess.ai) специализируется на диагностике и исправлении AI-сгенерированных кодовых баз, включая шумное логирование, утечки секретов и подготовку к продакшену. Быстрый аудит может выявить горячие точки объёма логов и самые безопасные первые изменения.

Часто задаваемые вопросы

What’s the fastest way to stop a surprise logging bill?

Начните с отключения debug/verbose логирования в production и удаления дампов полных тел запросов/ответов. Затем сократите хранение для высокообъёмных логов до нескольких дней и добавьте семплирование для рутинных 200 OK запросов, при этом сохраняя 100% ошибок. Эти три шага обычно быстро сокращают объём без ущерба для расследования инцидентов.

What should I log in a prototype to keep it useful but cheap?

Логируйте по умолчанию ошибки и важные изменения состояния, а не каждый успешный запрос. Базовый набор: timestamp, уровень (level), имя сервиса, endpoint, статус-код, длительность и request/trace ID, а при ошибке — короткий код ошибки. Добавляйте только минимальный контекст, который реально помогает воспроизвести проблему.

How do I choose log retention without guessing?

Ориентируйтесь на практику: горячие, высокообъёмные логи — коротко (1–3 дня), стандартные запросы — 7–14 дней, и низкообъёмные события безопасности — дольше только если они действительно нужны. Если не уверены — начните с короткой ретеншн и продлевайте лишь при подтверждённой необходимости.

How can I use sampling without going blind during incidents?

Ловите 100% ошибок, исключений, таймаутов и аномально медленных запросов, чтобы не терять доказательства при инциденте. Для высокообъёмных успешных путей семплируйте небольшой процент, чтобы видеть тренды. Добавьте жёсткий rate limit, чтобы цикл повторов не умножил объём логов за ночь.

What does “high cardinality” mean, and why does it raise costs?

Это поля с почти уникальными значениями: полные URL c query, сессионные токены, случайные ID и динамический текст ошибок. Если такие поля индексировать как тэги/лейблы, система должна отслеживать огромное количество уникальных комбинаций — это быстро увеличит расходы. Держите такие данные вне индексированных полей и храните лишь стабильные поля, по которым вы реально фильтруете.

How do I decide which fields to index for search?

Индексируйте только небольшое множество стабильных полей, по которым вы часто фильтруете: имя сервиса, окружение, уровень логов, endpoint и несколько кодов ошибок. Всё остальное оставляйте как неиндексированный JSON/text — оно доступно при необходимости, но не раздувает индекс. Если поиск медленный, добавляйте поля по одному, а не индексируйте всё подряд.

What’s the safest way to prevent tokens and secrets from leaking into logs?

Редактируйте до отправки из приложения — как только секрет ушёл, он может попасть в бэкапы, оповещения и экспорты. Маскируйте или удаляйте чувствительные заголовки и поля: Authorization, cookies, пароли, API-ключи, reset links и токены. Для корреляции логов лучше сохранять односторонний хеш или частичное значение, а не сырой секрет.

Why did my logging volume explode right after a release?

Чаще всего это оставшийся флаг конфигурации после отладки, или код, который логирует на каждом повторе/в цикле. Ещё частая причина — новое поле, в которое начали писать большие данные (тела запросов, стектрейсы). При всплеске сначала найдите «top talker» — сервис/маршрут, который увеличил объём, — и откатите шумное изменение, затем добавьте семплирование или rate limits.

How do I monitor logging costs so spikes don’t surprise me again?

Отслеживайте дневной ingest, рост хранилища и «top talkers» по сервисам и endpoint’ам, и настройте бюджетные оповещения, которые срабатывают раньше в месяце. При срабатывании оповещения проверьте: новый деплой, изменение конфигурации или endpoint, который начал ретраить. Рассматривайте изменения в логировании как продакшен-изменения: с владельцем и быстрым ревью после релизов.

My prototype was built with an AI tool and the logs are a mess—what should I do?

AI-сгенерированные прототипы часто идут с шумным логированием по умолчанию, фрагментами кода, которые печатают заголовки или токены, и ненадёжными потоками аутентификации, которые приводят к повторным ошибкам и логам. Если не знаете, где шум, FixMyMess может провести бесплатный аудит кода (fixmymess.ai), найти основные драйверы объёма логов, риски утечки секретов и самые безопасные исправления. Затем можно оперативно почистить и укрепить код для продакшена.