Предотвращение дубликатов пользователей с помощью уникальных ограничений и безопасного бэкфила

Узнайте, как предотвратить дубли пользователей с помощью уникальных ограничений, нормализации вводимых данных и безопасного плана бэкфила без простоев и потери данных.

Настоящая проблема: почему дубликаты пользователей продолжают появляться

Дубликаты пользователей редко выглядят как один и тот же email, введённый дважды. Чаще они появляются как крошечные различия, которые человек воспринимает как одного и того же человека, а база данных — как разные значения.

Типичные примеры:

- Тот же email, разный регистр:

[email protected]vs[email protected] - Скрытые пробелы:

[email protected]vs[email protected] - Несколько методов входа: один аккаунт создан с паролем, другой позже через Google или GitHub с тем же email

- Разные места создания: запись пользователя создана при оформлении заказа, затем ещё одна при онбординге

- Причуды провайдера:

[email protected]использовался однажды,[email protected]другой раз (некоторые приложения хотят видеть их как одного пользователя, другие — нет)

Результат выглядит как случайность для клиентов. Кто‑то входит через «другой» метод и попадает в «другой» аккаунт. Платёж может разделиться, и оплаченный пользователь выглядит неоплаченным. Тикеты поддержки превращаются в детективную работу: «я не вижу свои проекты» на деле означает «у вас два аккаунта и данные в другом». Аналитика тоже шумит, поэтому удержание и конверсия становятся недостоверными.

Команды часто пытаются предотвратить дубликаты на уровне UI: блокировать кнопку, показывать «email уже существует» или проверять перед созданием пользователя. Это помогает, но не достаточно. Базу данных пишут мобильные приложения, backend API, админ-панели, импорты, фоновые задачи, вебхуки и повторы после тайм-аутов. Два запроса также могут гоняться: оба проверяют «существует ли email?» одновременно, оба видят «нет» и оба вставляют запись.

Защита на уровне базы данных работает иначе. База данных применяет правило каждый раз, независимо от источника записи. Вы определяете, что должно быть уникальным (часто нормализованный email или комбинация вроде provider + provider_user_id), и база отклоняет вставки или обновления, которые создадут вторую запись с тем же идентификатором. Этот ограничитель превращает «мы стараемся не создавать дубликаты» в «дубликаты больше не могут появиться».

Как обычно появляются дубликаты

Дубликаты возникают, когда приложение предполагает, что база «как‑то справится». Если база не обеспечивает уникальность, пограничные случаи превращаются во множество строк для одного человека, и вы пытаетесь предотвращать дубли только кодом приложения.

Частая причина — гонка при регистрации. Два запроса могут попасть на сервер почти одновременно (двойной клик, нестабильное соединение, две вкладки). Если оба сначала выполняют «проверить, есть ли пользователь», и ни один ещё не вставил запись, оба решают, что пользователь новый.

Ещё источник — множественные точки входа, создающие пользователей: веб, мобильное приложение, админка, CSV‑импорт, приглашения, инструменты поддержки. Каждая ветка со временем растит свои правила. Одна обрезает пробелы, другая — нет. Одна проверяет существующих пользователей, другая пропускает проверку «просто для этой функции».

OAuth тоже может раздвоить идентичности. Пользователь регистрируется с email и паролем, затем нажимает «Продолжить с Google» с тем же email. Если callback OAuth создаёт новую строку вместо связывания с существующей, вы получаете два валидных аккаунта.

Различия в форматировании вводимых данных создают хитрые дубликаты:

- Регистр и пробелы в email ("[email protected]" vs "[email protected] ")

- Форматирование телефонов ("+1 555 123 4567" vs "5551234567")

- Опциональные поля, которые приходят позже (пользователь сначала с телефоном, потом добавляет email)

- Международные вариации (коды стран, ведущие нули)

- Юникодные похожие символы (редко, но встречается)

Повторы и тайм‑ауты тоже виноваты. Если клиент не получил ответ (сбой сети, тайм‑аут шлюза), он может автоматически повторить запрос. Если сервер считает каждый повтор новой регистрацией, вы получите дубликаты. Это особенно часто в прототипах, где логика регистрации копируется по разным роутам без идемпотентности и ограничений базы.

Определите, что значит «уникальный пользователь» для вашего продукта

Прежде чем добавлять ограничения, решите, что означает «уникальный пользователь» в вашей системе. Большинство дубликатов появляются потому, что в продукте есть несколько представлений идентичности.

Начните с идентификаторов, которым вы доверяете: email, номер телефона и внешние идентификаторы провайдеров (Google subject, GitHub id, enterprise SSO subject). Если вы поддерживаете несколько методов входа, решите, все ли они указывают на одну строку пользователя, или каждый метод может создать свою строку, которая позже связывается.

Затем явно обработайте грязные случаи:

- Что если email пустой, непроверенный или скрыт (Apple private relay)?

- Разрешаете ли гостевых пользователей без регистрации?

- Если email может быть

NULL, разрешены ли несколькоNULL(обычно да), и как гость становится реальным аккаунтом?

Область действия по тенанту или рабочему пространству важна. Уникальность глобальная или внутри тенанта? Во многих B2B‑приложениях один и тот же email может существовать в разных рабочих пространствах, но должен быть уникален внутри одного. В потребительском приложении обычно нужна глобальная уникальность.

Конкретный сценарий, который стоит решить заранее: пользователь регистрируется через Google в понедельник, затем через email и пароль во вторник с тем же email. Если ваше определение — «один человек = одна строка», вам нужна политика слияния, и она должна быть задокументирована.

Простая политика слияния:

- Выберите «первичную» запись (верифицированный email выигрывает; иначе последнее активное вхождение).

- Сохраните из первичной записи чувствительные поля безопасности (хэш пароля, настройки MFA).

- Объединяйте поля профиля (имя, аватар) только если в первичной записи они отсутствуют.

- Перенаправьте связанные данные (заказы, членства, API‑ключи) на первичную запись.

- Оставьте запись об аудите, чтобы позже объяснить, что произошло.

Напишите эти правила простым языком прежде, чем менять базу. Это согласует инженеров, поддержку и продукт, когда появятся реальные пограничные случаи.

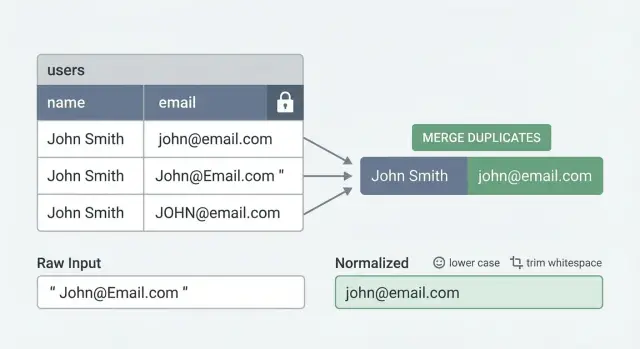

Нормализуйте ввод, чтобы база могла обеспечивать уникальность

Уникальные ограничения работают только если значения, которые вы храните, согласованы. Если один человек может зарегистрироваться как [email protected], [email protected] и [email protected], база видит три разные строки.

Нормализация означает выбор единого формата хранения для «одной и той же» идентичности и всегда запись этого формата в базу. Это тихий шаг, который делает уникальное ограничение действительно работающим.

Что нормализовать (и чего остерегаться)

Для email начните просто: обрезайте пробелы и приводите к нижнему регистру перед сохранением. Решите, как обращаться с плюс‑адресацией ([email protected]). Некоторые команды удаляют часть +..., чтобы уменьшить дубликаты, но это специфично для провайдера и не всегда безопасно. Более спокойный дефолт — lowercase + trim, а обработку плюсов добавляйте лишь если уверены, что это соответствует правилам продукта.

Для телефонов храните единый формат, желательно с кодом страны и только цифрами. Иначе +1 (415) 555-0123 и 4155550123 могут пройти проверку уникальности.

Для имён пользователей приводите поведение бэкенда в соответствие с UI. Если в интерфейсе Jane и jane считаются одним, бэкенд должен нормализовать одинаково перед вставкой.

Практичный паттерн — хранить оба значения:

- Оригинальный ввод (что ввёл пользователь, полезно для отображения и поддержки)

- Нормализованное значение (на чём вы обеспечиваете уникальность)

Бэкенд‑проверки важнее фронтенда

Нормализуйте на бэкенде при каждом создании или обновлении пользователя. Фронтенд‑проверки улучшают UX, но их легко обойти (старые клиенты, разные приложения, прямые API‑вызовы).

Распространённый провал: основатель импортирует пользователей из CSV, пока идут регистрации. Импорт сохраняет оригинальную капитализацию, форма регистрации её приводит к нижнему регистру, и теперь два аккаунта для одного email. Бэкенд‑нормализация плюс нормализованное уникальное ограничение предотвращают такой раскол.

Выберите правильное уникальное ограничение для вашей схемы

Уникальное ограничение — это правило, которое база выполняет: ни две строки не могут иметь одно и то же «уникальное» значение. Уникальный индекс — механизм, который делает проверку быстрой. Во многих СУБД при добавлении уникального ограничения создаётся уникальный индекс, поэтому практическая разница в основном в намерении и инструментарии.

Сложная часть — выбрать правильные столбцы. «Email должен быть уникален» звучит просто, но быстро ломается, когда появляются команды, несколько методов входа, опциональные email или мягкие удаления.

Когда использовать составную уникальность

Если пользователи принадлежат рабочему пространству или тенанту, часто нужно уникальность внутри этого тенанта, а не глобально. Это даёт составное правило, например:

tenant_id + normalized_email(один и тот же email можно иметь в разных тенантах)provider + provider_user_id(истинная уникальная идентичность для OAuth‑логинов)tenant_id + provider + provider_user_id(обычно когда одна и та же провайдерная идентичность может присоединяться к разным тенантам)

Составная уникальность также полезна, когда вы поддерживаете и парольный вход, и OAuth. Можно обеспечить отдельное строгое правило для каждого типа идентичности, не заставляя одно поле (например, email) делать всю работу.

Частичная уникальность и мягкие удаления

Реальные данные грязные. У некоторых пользователей может не быть email, или вы разрешаете аккаунты только по телефону. В этом случае обеспечивайте уникальность только когда значение присутствует (частичное правило). Частый пример: «email уникален, но только для строк, где email присутствует».

Мягкие удаления добавляют ещё одно решение. Если вы помечаете пользователей как удалённых вместо физического удаления, выберите и зафиксируйте правило:

- Уникально среди активных пользователей (позволяет повторную регистрацию с тем же email)

- Уникально среди всех пользователей, включая удалённых (предотвращает повторное использование и упрощает аудит)

Планируйте существующие дубликаты до включения ограничения

Включение уникальности, когда дубликаты уже есть, приведёт к ошибкам или заблокирует регистрации в самый неподходящий момент. Прежде чем применять правило, проинвентаризируйте дубликаты, решите, какая запись «выигрывает», и убедитесь, что связанные записи (сессии, заказы, членства) можно безопасно перенаправить.

Пошагово: вводим уникальность без простоев

Цель — предотвратить дубликаты пользователей, не замораживая регистрацию и не блокируя вход. Самый безопасный подход — сначала добавить элементы, потом постепенно заполнить их, исправить грязные случаи и только после этого попросить базу применять уникальность.

Безопасная последовательность развёртывания

Начните с добавления нормализованного ключа, с которым база сможет надёжно сравнивать. Для email это обычно нижний регистр и обрезка пробелов (плюс любые дополнительные правила продукта).

Практический план:

- Добавьте новую колонку для нормализованного значения (например,

email_normalized) и измените приложение так, чтобы при каждой новой регистрации записывались иemail, иemail_normalized. - Бэкап/бэкфил

email_normalizedдля существующих пользователей малыми партиями (по диапазонам ID или временным окнам), чтобы каждая партия быстро завершалась. - Выполните обнаружение дубликатов, используя нормализованный ключ, и сгруппируйте коллизии (например, все строки где

email_normalized = "[email protected]"). - Решите каждую группу до включения уникальности: выберите победителя, объедините нужные данные и пометьте остальные как объединённые/отключённые.

- Добавьте уникальный индекс/ограничение только после того, как дубликатов не останется, используя опцию онлайн, если ваша СУБД это поддерживает.

Конкретный пример: прототип мог хранить [email protected], [email protected] и [email protected] как трёх разных пользователей. После бэкфила email_normalized = "[email protected]" они станут коллизией и превратятся в одну группу для слияния.

Минимизация блокировок и сюрпризов

Большинство простоев происходит, когда изменение вызывает длительные блокировки таблицы. Держите каждую операцию быстрой и предсказуемой.

Несколько правил, которые помогают:

- Бэкап/бэкфил с жёстким размером партии и таймаутом. Если партия не успевает, уменьшите размер.

- Пусть приложение пишет нормализованные значения ещё до старта бэкфила. Иначе новые строки будут приходить с null и вы никогда не догоните ситуацию.

- Следите за «новыми дубликатами в час» во время развёртывания. Если он растёт, что‑то всё ещё пишет неконсистентные ключи.

- Создавайте уникальный индекс так, чтобы не блокировать записи (например, «concurrent/online» создание, в зависимости от СУБД).

План бэкфила: находите и безопасно объединяйте дубликаты

Бэкфил — это не про хитрый SQL, а про аккуратную работу с идентичностью. Цель проста: выбрать одну запись для сохранения, перенаправить на неё всё, и оставить понятный след.

Начните с перечисления дубликатов, используя тот же нормализованный ключ, который вы планируете применять (например, lowercased и trimmed email). Сначала делайте это в режиме только для чтения, затем экспортируйте группы для ревью.

-- Example: find duplicate emails by normalized value

SELECT

LOWER(TRIM(email)) AS email_norm,

COUNT(*) AS user_count,

ARRAY_AGG(id ORDER BY created_at) AS user_ids

FROM users

WHERE email IS NOT NULL

GROUP BY LOWER(TRIM(email))

HAVING COUNT(*) > 1

ORDER BY user_count DESC;

Для каждой группы дубликатов выберите «первичного» пользователя. Практичное правило — сохранять аккаунт, который выглядит реальным и активным. Полезные критерии: верифицированный email, недавняя активность и наличие платного тарифа.

Затем выполняйте слияние в предсказуемом порядке, чтобы не потерять данные:

- Заблокируйте группу дубликатов (или выполните слияние в транзакции), чтобы остановить новые записи на время переноса.

- Перенаправьте связанные записи (заказы, проекты, членства, API‑ключи, тикеты) с

duplicate_user_idнаprimary_user_id. - Разрешайте конфликты поле за полем (сохраняйте верифицированный email, берите самые свежие данные профиля, сохраняйте роль с наивысшими привилегиями).

- Запишите строку аудита:

duplicate_user_id -> primary_user_id, когда это произошло, кто/что выполнял операцию. - Отключите не‑первичные аккаунты (мягкое удаление), а окончательно удаляйте только когда уверены, что ничего не зависит от них.

Пароли и email требуют особой обработки. Если первичный аккаунт сохраняет email, удалите или занулите email на не‑первичных записях, чтобы они не могли использоваться для входа. Пароли, сессии и OAuth‑идентичности переносите только если уверены, что они принадлежат одному и тому же человеку; иначе отзывайте сессии на не‑первичных аккаунтах и требуйте повторного входа.

Не ломайте вход: обработка аутентификации и сессий при слияниях

Слияние — это не просто перенос профиля. Вход часто зависит от ID пользователя, привязанного к сессиям, refresh‑токенам, ссылкам сброса пароля и внешним вебхукам. Объединили два аккаунта и проигнорировали эти ссылки — люди столкнутся с циклами входа или «account not found».

Безопасный паттерн — держать один первичный аккаунт и рассматривать каждый дубликат как псевдоним, указывающий на него. Когда кто‑то входит через аккаунт, который был объединён, вы разрешаете его в первичный и продолжаете без изменения того, что ввёл пользователь.

Перенаправляйте дубликаты на первичный аккаунт

Держите небольшое соответствие (даже простую таблицу) merged_user_id -> primary_user_id. При каждом чтении аутентификации проверяйте это отображение и переписывайте user ID на первичный до создания новой сессии. Это предотвращает циклы, потому что система никогда не создаёт сессии для аккаунтов, которые больше «не существуют».

Такой подход даёт время плавно мигрировать старые клиенты без простоев.

Токены, сбросы и интеграции: что нужно обновить

Прежде чем включить ограничение, решите, что вы будете инвалидировать, а что переносить:

- Сессии и refresh‑токены: либо перепривязать их к первичному user ID, либо отозвать и потребовать новый вход.

- Токены «запомнить меня»: вращайте их при следующем входе, чтобы избежать тихих ошибок.

- Ссылки сброса пароля и подтверждения: генерируйте новые ссылки, привязанные к первичному аккаунту; не оставляйте старые ссылки, указывающие на объединённый ID.

- Внешние интеграции: если партнёрская система хранит старый ID, поддерживайте разрешение псевдонимов, чтобы входящие события цеплялись за первичный аккаунт.

- Логи аудита: сохраняйте исторические user ID, но в админке показывайте каноническую идентичность, чтобы уменьшить путаницу.

Пример: если Анна случайно создала два аккаунта с одним email (один через Google, другой с паролем), слияние должно оставить её текущую сессию рабочей, а будущие сбросы пароля — нацеливать только на первичный аккаунт.

Частые ошибки, приводящие к простоям или потере данных

Большинство простоев происходит, когда база пытается применить правило к данным, которые ещё ему не соответствуют. Уникальное ограничение без пощады: если хоть один дубликат существует, записи начинают падать, очереди накапливаются, а регистрации могут перестать работать.

Распространённый пример: команда добавляет уникальный индекс на users.email в пятницу, предполагая «у нас нет дубликатов». Ночью старый импорт запускается заново и вставляет тот же email с другой капитализацией. В понедельник регистрации начинают отдавать 500, и служба поддержки тонет в тикетах.

Ошибки, которые приводят к проблемам:

- Включение уникального ограничения до очистки существующих дубликатов.

- Нормализация в одном пути кода, но не в других (веб‑форма приводит к нижнему регистру, импорт — нет).

- Предположение, что email всегда присутствует или верифицирован (есть аккаунты только по телефону и соцвходы; пользователи меняют email).

- Слияние пользователей без обновления всех внешних ключей (заказы, членства, логи аудита, API‑ключи, сессии, поля

created_by). - Молчаливое удаление данных при слияниях без плана отката.

Относитесь к дедуплику как к обратимой миграции данных, а не к одноразовому скрипту очистки. Сохраняйте обе записи, фиксируйте изменения и удаляйте только когда уверены, что от старой строки ничего не зависит.

Простой безопасный подход, который хорошо работает:

- Логируйте каждое решение о слиянии (id победителя, id проигравшего, выбранные поля, метка времени).

- Перенаправляйте ссылки партиями и проверяйте счётчики до и после.

- Добавьте каноническое отображение пользователей, чтобы старые id продолжали разрешаться во время перехода.

- Протестируйте все пути записи (app, admin, импорты, воркеры) с одной и той же функцией нормализации.

Быстрый чеклист и следующие шаги

Начните с согласованности. Ваша база может защитить вас только если каждый путь записи производит одинаковый «уникальный ключ».

Чеклист:

- Подтвердите, что правила нормализации применяются на всех путях записи (регистрация, приглашение, создание админом, OAuth, импорты, фоновые задачи).

- Запустите сканирование дубликатов по нормализованному ключу и обсудите результаты с командой.

- Протестируйте логику слияния на небольшом реальном сете и подтвердите, что происходит с профилями, членствами, подписками и логами аудита.

- Полностью очистите дубликаты, затем включайте защиту базы (уникальный индекс/ограничение) только после проверки безопасности данных.

- Добавьте мониторинг новых конфликтов (ошибки ограничений), чтобы узнавать о проблемах по логам, а не от пользователей.

Назначьте одного владельца и сроки. «Дедуп» застревает, когда он расплывчат. Сформулируйте чётко: определите каноническую запись, как перенаправлять внешние ключи и что делать при расхождении данных (имя, телефон, платёжная информация, последний вход).

Простой сухой прогон помогает: возьмите 50 кластеров дубликатов из продакшена, выполните слияние в копии staging и проверьте, что пользователи по‑прежнему могут войти, видеть нужные рабочие пространства и успешно сбрасывать пароли.

Если вы унаследовали приложение, сгенерированное ИИ, и дубликаты продолжают появляться из‑за отсутствия сквозных ограничений и нормализации, FixMyMess (fixmymess.ai) может помочь: диагностировать все пути создания пользователей, починить авторизацию и логику слияния и довести систему до состояния, когда база гарантирует уникальность без разрывов входа.

Часто задаваемые вопросы

Почему продолжают появляться дублирующиеся аккаунты, если мы проверяем в UI?

Потому что дубликаты обычно создаются множеством путей записи и проблемами синхронизации, а не просто «тот же email введён дважды». Два запроса могут сойтись во времени, импорты могут пропускать проверки, OAuth-колбэки могут создавать новые строки, а повторная попытка после тайм-аута может снова запустить логику регистрации. Только правило на уровне базы данных блокирует дубликаты независимо от того, откуда приходит запись.

Как проще всего остановить дубликаты email, вызванные регистром или пробелами?

Нормализуйте значение, по которому вы будете обеспечивать уникальность. Для email надёжный дефолт — trim + lowercase в бэкенде при каждом создании или обновлении пользователя, а уникальность применять к нормализованной колонке. Оригинальный email можно сохранить для отображения того, что ввёл пользователь.

Нужно ли обеспечивать уникальность по email или по OAuth provider user ID?

Обычно для OAuth следует обеспечивать уникальность по идентичности провайдера, а не только по email. Храните и проверяйте что-то вроде provider + provider_user_id, чтобы одна Google-учётная запись не создавала несколько строк, и связывайте эту идентичность с существующей записью пользователя, если email совпадает в соответствии с вашими правилами слияния.

Стоит ли считать Gmail плюс-адресацию той же учетной записью?

По умолчанию не удаляйте часть после +, пока вы не уверены, что это соответствует правилам вашего продукта. Некоторые команды хотят, чтобы [email protected] и [email protected] считались одним человеком, но это поведение зависит от провайдера и может удивить пользователей на доменах, отличных от Gmail. Начните с lowercase+trim, и добавляйте провайдер-специфичную обработку только при необходимости.

Как учитывать уникальность в многотентантном приложении?

Если в вашем продукте есть рабочие пространства/тенанты, обычно уникальность должна быть в пределах тенанта. Это означает правило типа tenant_id + email_normalized, чтобы один и тот же email мог существовать в разных рабочих пространствах, но не дважды внутри одного. В потребительских приложениях обычно применяют глобальную уникальность.

Что делать с мягко удалёнными пользователями — можно ли повторно использовать тот же email?

Определите политику заранее и зашифруйте её в ограничении. Частый подход: «уникально среди активных пользователей», что позволяет человеку зарегистрироваться заново после удаления — для этого используют частичное ограничение по полю active или deleted_at. Если вам важна строгая аудиторная история и нельзя допускать повторного использования, обеспечьте уникальность среди всех записей, включая удалённые.

Как развернуть уникальное ограничение без простоя?

Добавьте нормализованную колонку и начните записывать её для всех новых регистраций, затем бэкап/бэкфил в небольших партиях для существующих пользователей. После этого найдите коллизии по нормализованному ключу, объедините или отключите дубликаты и только затем добавляйте уникальный индекс/ограничение, используя онлайн/конкурентный способ, если СУБД это поддерживает. Такая последовательность избегает ситуации «включили ограничение и регистрации начали падать».

Как объединять дублирующие аккаунты, не сломав вход и подписки?

Выберите основной аккаунт, перенаправьте все связанные записи на него и заведите явную таблицу с отображением merged_user_id -> primary_user_id, чтобы старые ID продолжали разрешаться. Сессии, refresh-токены, сбросы пароля и ссылки подтверждения требуют особого внимания: безопаснее перепривязать или переиздать их для основного аккаунта, чтобы пользователи не застревали в циклах входа.

Как остановить дубликаты, возникающие из-за ретраев, тайм-аутов или двойного клика?

Используйте идемпотентный ключ для намерения регистрации и обрабатывайте повторные запросы как одно и то же действие, а не как новое создание аккаунта. Даже с идемпотентностью держите уникальность в базе: гонки и параллельные запросы всё ещё возможны. Комбинация идемпотентности и ограничения на уровне БД предотвращает и случайные повторы, и конкуренцию.

Унаследовали приложение, сгенерированное ИИ, и дубликаты повсюду — как быстро это исправить?

Это решается быстрее, если рассматривать проблему и как данные, и как модель авторизации. FixMyMess (fixmymess.ai) может просканировать все пути создания пользователей, внедрить бэкенд-нормализацию, добавить правильные уникальные ограничения и безопасно выполнить бэкфил/слияние, чтобы дубликаты перестали появляться без сбоев входа. Если у вас код, сгенерированный ИИ, быстрее доверить восстановление потоков и привязок специалистам, чем латать по одному маршруту за раз.