Alertes de panne : 3 vérifications simples pour détecter rapidement les premières défaillances

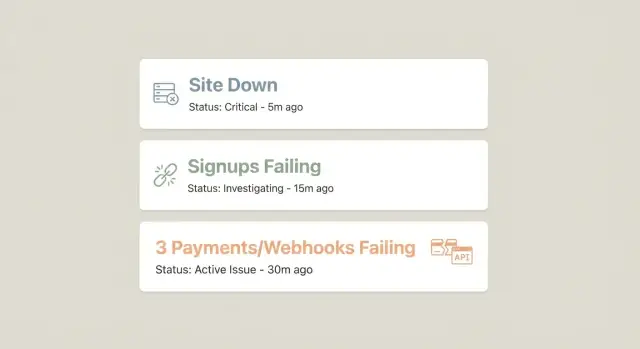

Configurez trois alertes de panne qui détectent la plupart des défaillances précoces : site indisponible, inscriptions en échec, et paiements/webhooks en échec. Vérifications simples, routage clair.

Pourquoi ces trois alertes détectent la plupart des pannes précoces

La plupart des pannes sont d’abord découvertes par les clients, pas par votre équipe. Quelqu’un essaie de charger votre site, ne peut pas s’inscrire, ou paie sans jamais obtenir l’accès. Quand les emails de support arrivent ou que quelqu’un remarque une baisse de revenus, vous êtes déjà en plein incident.

« Précoce » désigne généralement les 5 à 30 premières minutes. C’est le moment où un petit problème est encore facile à inverser : rollback d’un déploiement, redémarrage d’un worker bloqué, renouvellement d’un secret expiré, ou correction d’une mauvaise config avant que des centaines d’utilisateurs ne soient impactés.

C’est pourquoi moins d’alertes bruyantes valent souvent mieux qu’une longue liste. Si vous avez dix moniteurs qui se déclenchent tout le temps, les gens cessent de leur faire confiance. Un petit ensemble de signaux presque toujours pertinents attire l’attention rapidement, même à 2 h du matin.

Ces trois contrôles couvrent les façons les plus courantes dont un produit casse dans le monde réel :

- Est-ce que quelqu’un peut atteindre le site ?

- Est-ce qu’un nouvel utilisateur peut terminer l’inscription ?

- Est-ce que l’argent et les événements de fulfillment circulent (paiements et webhooks) ?

Ensemble, ils forment un filet de sécurité simple « porte d’entrée, croissance, revenu ». Si l’un d’eux casse, vous avez probablement une panne perceptible par les utilisateurs.

Ce qu’ils ne couvrent pas : la lenteur des performances, les bugs partiels après connexion, les problèmes de cohérence des données, ou « ça marche aux États-Unis mais pas en Europe ». Ils ne détecteront pas non plus les échecs silencieux comme un job en arrière-plan qui accumule un retard avant d’affecter les inscriptions.

Un exemple concret : un déploiement casse accidentellement une variable d’environnement. Votre page d’accueil peut toujours se charger, mais les requêtes d’inscription échouent et les webhooks de paiement ne sont plus traités. Avec seulement ces alertes, vous le trouvez en quelques minutes au lieu d’attendre une réclamation.

Alerte 1 : Site indisponible (contrôle d’uptime simple)

Si vous ne configurez qu’une seule alerte, faites-en un contrôle d’uptime qui répond à une question : une vraie personne peut-elle charger votre produit maintenant ?

Un réglage pratique utilise trois cibles. Vérifiez la page d’accueil pour attraper les échecs DNS, CDN et d’hébergement basique. Vérifiez une page « app shell » (une route publique qui charge JavaScript et CSS) pour détecter les builds cassés et les problèmes d’assets. Puis vérifiez un endpoint de santé API léger qui renvoie vite un 200 avec une petite charge utile, ce qui détecte les crashes backend même si la page d’accueil se charge encore.

Les contrôles d’uptime peuvent mentir si vous dépendez d’un seul emplacement. Utilisez au moins deux régions (ou deux vérifications indépendantes) et ne considérez le site comme « down » que si les deux échouent dans la même courte fenêtre. Cela évite de pager quelqu’un parce qu’un centre de données ou un FAI a eu un hoquet.

Quand une alerte se déclenche, elle doit être immédiatement exploitable. Incluez l’URL exacte qui a échoué, l’heure de la première et de la dernière défaillance, où ça a échoué (région/emplacement), quel type d’échec c’était (code d’état, timeout, DNS, TLS), et la dernière réussite connue.

Pour le paging vs notifications chat, gardez une règle simple. Pagez quand l’app shell ou le health check API échoue deux fois de suite (par exemple sur 2–3 minutes). Envoyez seulement en chat pour un échec unique, ou pour une panne de la page d’accueil quand l’app shell fonctionne toujours.

Alerte 2 : Échecs d’inscription (votre croissance s’arrête en silence)

Si votre site est en ligne mais que les gens ne peuvent pas créer de comptes, vous pouvez perdre une journée entière de croissance sans le remarquer. La surveillance des inscriptions est une des alertes les plus rentables que vous puissiez ajouter.

Choisissez un chemin critique et testez-le de bout en bout : ouvrez la page d’inscription, soumettez le formulaire, vérifiez que l’utilisateur est créé, et confirmez que l’application peut se connecter (ou atteint l’étape « vérifiez votre email » si vous utilisez la vérification par email). L’objectif est de détecter une vraie rupture, pas seulement « la page a renvoyé 200 OK ».

Que surveiller (restez focalisé sur le résultat)

Visez quelques signaux qui correspondent au fonctionnement réel du parcours. Surveillez le taux de succès du parcours d’inscription complet, plus les taux d’erreur et la latence des endpoints d’inscription et de connexion. Ajoutez un filet métier : alertez si le nombre de nouveaux utilisateurs tombe à zéro (ou proche de zéro) pendant une fenêtre adaptée à votre trafic.

Ce filet compte parce que certains défauts échappent aux contrôles synthétiques. Un endpoint peut encore renvoyer « succès », mais la livraison d’email échoue, ou un pays est bloqué, et les inscriptions réelles s’arrêtent en silence.

Déclenchez l’alerte sur des échecs soutenus, pas sur un seul clignotement. Pour beaucoup de produits, « 3 tests d’inscription échoués en 5 minutes » est un déclencheur plus fiable qu’un seul échec.

Alerte 3 : Paiements ou webhooks en échec (argent et fulfilment)

Les paiements sont l’endroit où de petits bugs deviennent vite dommageables. Cette alerte vise moins « le site est-il up ? » que « avons-nous encaissé l’argent et livré ce que nous avons promis ? »

Deux points de rupture apparaissent le plus souvent. Le premier : la création du paiement/checkout échoue (mauvaise configuration, redirects cassés, problème du fournisseur). Le second : le traitement des webhooks échoue : le paiement réussit, mais votre application ne traite jamais l’événement qui accorde l’accès, crédite le compte, lance le fulfilment ou envoie la confirmation.

Un signal solide est simple : surveillez le taux de succès du traitement des webhooks et l’âge du backlog. Si les événements s’empilent, quelque chose est bloqué même si les clients peuvent encore payer. Si le taux de succès baisse, le handler plante, la vérification de signature est cassée, ou un déploiement a changé le parsing des payloads.

Gardez la surveillance alignée sur les résultats. Les événements de paiement réussis et la création des droits d’accès doivent coller étroitement. Surveillez les retries répétés, la hausse des réponses 4xx/5xx, et l’âge de l’événement non traité le plus ancien. Si vous disposez d’un canal support, les rapports « payé mais sans accès » sont aussi un signal secondaire utile.

Si votre fournisseur le permet, ajoutez un canari planifié dans un environnement sûr pour confirmer tout le chemin : créer un paiement, recevoir le webhook, accorder le droit, envoyer la confirmation.

Comment configurer ces alertes étape par étape

Pensez comme un premier utilisateur. Le but n’est pas de tout surveiller. C’est de détecter les ruptures précoces avec trois contrôles petits et répétables.

1) Définissez les actions exactes que vous allez simuler

Notez les actions les plus petites qui prouvent que votre produit fonctionne encore : charger la page d’accueil, créer un compte, et compléter la boucle de paiement ou de webhook. Soyez précis (par exemple « soumettre le formulaire d’inscription avec un nouvel email »), car des contrôles vagues sont difficiles à automatiser et faciles à mal interpréter pendant un incident.

2) Gardez chaque alerte minimale : 1–2 endpoints

Pour chaque alerte, choisissez un endpoint principal et un signal de secours si nécessaire. « Site indisponible » peut être l’app shell plus un endpoint de santé léger. « Échecs d’inscription » peut être le POST d’inscription plus une vérification rapide que l’enregistrement utilisateur existe. « Paiements/webhooks » peut être un endpoint de réception de webhook plus une vérification que le fulfilment a démarré.

3) Réglez la fréquence et les retries pour réduire les fausses alertes

Exécutez les vérifications assez souvent pour remarquer rapidement un problème (toutes les 1–5 minutes est courant), mais retentez avant de pager. Un schéma simple : 2–3 tentatives sur 1–2 minutes, puis alerter seulement si toutes échouent. Réglez les timeouts pour que les services lents génèrent des avertissements avant de devenir des pannes totales.

4) Décidez qui est notifié et comment

Choisissez un propriétaire par alerte pour éviter le « quelqu’un gèrera ça ». Notifiez la personne on-call en premier, et envoyez aussi une copie à un canal partagé pour que d’autres puissent aider si l’incident dure.

5) Ajoutez un runbook en une ligne à chaque alerte

Mettez la première action directement dans le message d’alerte :

- Site indisponible : vérifiez le statut d’hébergement et le dernier déploiement, puis rollback si nécessaire.

- Échecs d’inscription : essayez une inscription manuelle, puis vérifiez les logs du fournisseur d’auth et les écritures en base.

- Paiements/webhooks : confirmez le statut du fournisseur, puis inspectez les logs de webhook et la queue/backlog.

Seuils, timing et qui est pagé

De bonnes alertes sont rapides, mais pas nerveuses. Vous voulez détecter de vraies pannes tôt sans réveiller quelqu’un pour un clignotement d’une minute.

Seuils de départ simples (valeurs sûres)

Commencez ici, puis ajustez après une semaine de données réelles :

- Site indisponible (uptime) : vérifiez chaque minute, pagez après 2 vérifications échouées consécutives, idéalement depuis 2 emplacements.

- Échecs d’inscription : exécutez un test synthétique d’inscription toutes les 5 minutes, avertissez après 2 échecs consécutifs, pagez après 3 échecs (environ 15 minutes).

- Paiements/webhooks : avertissez si le taux d’échec > 2 % pendant 10 minutes (ou 10 échecs en 5 minutes) ; pagez si le taux d’échec > 5 % pendant 10 minutes ou toute série soutenue d’échecs graves.

Ces chiffres ne sont pas magiques. Ce sont des points de départ solides pour que vos alertes soient utiles dès le premier jour.

Utilisez une règle « deux coups » pour réduire le bruit

La plupart des équipes sont noyées parce qu’elles alertent au premier erreur. Une solution simple : exigez une confirmation.

Exemple : si votre vérification d’uptime échoue une fois, envoyez un avertissement. Si elle échoue deux fois d’affilée, pagez l’on-call.

Orientez les alertes vers le bon propriétaire

Qui est pagé doit correspondre à qui peut réparer le plus vite :

- Site indisponible : on-call ingénierie (backend ou infra).

- Échecs d’inscription : on-call backend, plus produit en avertissement.

- Paiements/webhooks : on-call backend, plus responsable paiements en avertissement.

Si ces alertes se déclenchent constamment, ne les mettez pas en sourdine. Considérez cela comme un signe qu’un chemin critique est fragile et doit être renforcé.

Rendre les alertes exploitables (ce que le message doit contenir)

Une alerte n’est utile que si quelqu’un peut effectuer une première action en moins d’une minute. La plupart des mauvaises alertes disent ce qui a cassé, mais pas quoi faire ensuite ni qui en est propriétaire.

Gardez la charge utile cohérente entre les trois vérifications pour que chaque alerte ressemble à un mini-ticket d’incident. Au minimum, incluez : ce qui a échoué (et l’impact utilisateur en termes simples), où ça a échoué (environnement/région et URL exacte), quand ça a commencé et depuis combien de temps ça dure, des preuves (code d’état, extrait d’erreur, ID de requête ou de trace), et le propriétaire (service/équipe et rotation on-call).

Ajoutez un peu de contexte qui explique souvent l’incident rapidement : version et heure du déploiement courant, état des feature flags pertinents, et changements récents de configuration comme rotation de secrets, mises à jour d’URL de webhook, ou clés du fournisseur de paiement.

Pour les instructions, soyez concis : une étape de vérification, un correctif probable (rollback ou désactiver un flag), et un chemin d’escalade clair.

Vérifications rapides : checklist de panne en 60 secondes

Quand quelque chose semble anormal, vous n’avez pas besoin d’une enquête complète pour confirmer. Il faut une séquence rapide qui réponde : le site est-il accessible, un nouvel utilisateur peut-il s’inscrire, et les événements monétaires/fulfillment fonctionnent-ils encore ?

Exécutez ces étapes dans l’ordre :

- Confirmez l’uptime depuis deux emplacements (un local, un distant). Si l’un échoue et l’autre passe, suspectez le DNS ou un problème régional.

- Créez un utilisateur test et complétez l’inscription, y compris la vérification email si vous l’utilisez.

- Déclenchez un événement webhook (ou un achat de test) et confirmez que le traitement suit. Cherchez un backlog qui ne cesse de croître.

- Effectuez un petit paiement réel de bout en bout et confirmez que l’accès est accordé ou que la commande est marquée comme fulfillée. Si le paiement réussit mais que l’accès n’est pas accordé, les utilisateurs le remarqueront vite.

- Analysez les signaux d’erreur clés : pics de 401/403, 500, ou timeouts pointent souvent vers un mauvais déploiement, un secret expiré, ou une auth mal configurée.

Si une étape échoue, stoppez les déploiements et faites un rollback du changement le plus récent si possible. Capturez ce que vous avez vu (horodatage, endpoint, texte d’erreur, ID utilisateur ou commande) pour que la personne qui répare n’ait pas à deviner.

Exemple : un mauvais déploiement et comment les trois alertes aident

Un petit SaaS déploie un changement « rapide » le vendredi soir : un nouveau middleware qui vérifie des headers avant que les requêtes n’atteignent l’app. Il passe les tests locaux, est déployé, et l’équipe ferme ses laptops.

Dix minutes plus tard, les premiers signaux arrivent. Pas une pluie de logs, juste trois contrôles utilisateurs.

Le contrôle de site échoue en premier : la page d’accueil se charge encore, mais des routes clés de l’app renvoient des 500, donc le check d’uptime le détecte. Le test d’inscription échoue ensuite : les comptes ne sont plus créés, ce qui confirme que ce n’est pas juste une baisse de trafic. Puis la surveillance paiements/webhooks montre des retries et une croissance du backlog, révélant que les événements monétaires ne sont pas traités.

En 15 minutes, l’équipe restreint le problème en comparant ce qui marche (pages statiques) et ce qui échoue (tout ce qui est derrière le nouveau middleware). Ils repèrent une exigence de header qui bloque les callbacks d’auth et les requêtes du fournisseur de paiement.

Ils effectuent un rollback pour restaurer les inscriptions et paiements, puis publient un hotfix : autoriser les routes webhook connues et les callbacks d’auth, et logger les requêtes bloquées avec une raison claire. Ensuite, ils changent les contrôles d’inscription et de webhook pour utiliser des comptes canary dédiés et des événements de test afin de confirmer les pannes sans impacter de vrais clients.

Erreurs courantes qui rendent ces alertes inutiles

La façon la plus rapide de perdre la confiance dans les alertes est de les rendre bruyantes, vagues, ou aveugles à la douleur réelle des utilisateurs. La plupart des équipes n’ont pas besoin de plus d’alertes. Elles ont besoin de moins d’alertes qui pointent vers une défaillance spécifique et une action claire.

Modes d’échec courants :

- Vérifier seulement « le serveur est up ». Un

200 OKsur la page d’accueil peut cacher un login cassé, une inscription cassée, ou un checkout bloqué. - Pager à chaque erreur sans seuil. Un timeout ponctuel est normal. Pagez sur des taux soutenus sur une courte fenêtre.

- Supposer que la livraison du webhook signifie succès. Les fournisseurs peuvent dire « delivered » même si votre endpoint renvoie 500, timeout, ou perd des données après parsing. Testez la réception, la validation, le stockage, et le déclenchement de l’étape suivante.

- Ignorer la fréquence des changements d’auth et de secrets. Clés rotatives, apps OAuth expirées, et vars d’environnement mal réglées peuvent casser les inscriptions en silence.

- Pas de propriétaire et pas de runbook. Si l’alerte ne dit pas qui s’en occupe et comment vérifier la restauration, vous perdez les 15 premières minutes.

Gardez le texte d’alerte pragmatique : ce qui a échoué, où (endpoint ou flux), combien d’utilisateurs sont affectés si vous pouvez l’estimer, et une étape de vérification.

Étapes suivantes : gardez-le simple et fiable

Si vous ne faites rien d’autre, conservez ces trois contrôles : site indisponible, échecs d’inscription, et paiements ou webhooks en échec. Ils vous informent généralement d’un problème avant que les utilisateurs n’inondent votre boîte mail.

Après cela, ajoutez une alerte à la fois, et uniquement si vous pouvez répondre à deux questions : quelle action prendre quand elle se déclenche, et à quelle fréquence devrait-elle se déclencher en une semaine normale ? Si vous ne pouvez pas répondre aux deux, c’est probablement du bruit.

Un moyen simple de maintenir la confiance dans les alertes : un test mensuel de 10 minutes. Choisissez un moment calme et forcez chaque alerte à se déclencher une fois pour vérifier qu’elle fonctionne toujours.

Si vous avez hérité d’une base de code générée par l’IA et que ces alertes pointent sans cesse vers les mêmes points fragiles (auth, secrets, handlers de webhook), il est souvent plus rapide de réparer le flux sous-jacent que d’ajuster les seuils. FixMyMess (fixmymess.ai) se concentre sur le diagnostic et la réparation de ces chemins de production pour que votre monitoring se calme pour la bonne raison : l’application tient réellement la charge.

Questions Fréquentes

Pourquoi seulement trois alertes — ne vais-je pas manquer des problèmes ?

Commencez avec trois alertes parce qu'elles couvrent les façons les plus courantes dont les utilisateurs ressentent une panne : le site est injoignable, les nouveaux utilisateurs ne peuvent pas s'inscrire, ou les paiements/fulfillments s'arrêtent. Plus de moniteurs ajoutent souvent du bruit et ralentissent la réponse, car les gens finissent par ne plus faire confiance aux alertes.

Quelle est la différence entre vérifier la page d'accueil, l’« app shell » et la santé API ?

Un simple contrôle de la page d'accueil peut renvoyer 200 alors que l'application est cassée derrière. Ajoutez une route « app shell » (une vraie page public qui charge les assets) et un endpoint de santé API léger pour détecter plus vite les builds cassés, les crashes backend et les mauvaises configurations.

Comment éviter les fausses alertes dues à une région ou un FAI défaillant ?

Exécutez des vérifications depuis au moins deux régions ou emplacements indépendants, et ne marquez pas « en panne » que si les deux échouent dans la même courte fenêtre. Utilisez aussi une règle « deux coups » : un seul échec = alerte, deux échecs consécutifs = page.

Quand dois-je alerter par page plutôt que poster en chat ?

Pagez en cas d’échecs répétés sur une courte fenêtre, pas au premier incident. Un réglage pratique : « page après 2 échecs consécutifs » pour l’uptime et « page après 3 échecs » pour les tests d’inscription, afin d’éviter de réveiller quelqu’un pour un simple clignotement.

Que doit réellement faire un moniteur d’inscription ?

Testez un chemin critique de bout en bout : chargez la page d’inscription, soumettez le formulaire, confirmez que l’utilisateur est créé et vérifiez que vous atteignez l’étape post-inscription (connexion ou « vérifiez votre email »). Le but est de détecter une vraie rupture, pas seulement un 200 OK.

Pourquoi suivre le nombre réel d’inscriptions si j’ai déjà des tests synthétiques ?

Les tests synthétiques peuvent réussir alors que les inscriptions réelles échouent (livraison d’email, blocage géographique, fournisseurs). Ajoutez un filet métier : par exemple, alerte si le nombre de nouveaux utilisateurs tombe à zéro (ou près de zéro) pendant une fenêtre adaptée à votre trafic.

Quelle est la façon la plus simple de surveiller paiements et webhooks sans compliquer ?

Deux échecs communs : le paiement échoue à la création (mauvaise config, redirects cassés, problème fournisseur) ; ou le paiement réussit mais votre handler de webhook échoue et l’utilisateur ne reçoit pas l’accès. Surveillez le taux de succès du traitement des webhooks et l’âge du backlog d’événements. Si les événements s’accumulent, quelque chose est bloqué.

Quelles informations chaque message d’alerte doit-il contenir ?

Une alerte forte indique en clair ce qui a échoué, l’URL ou le flux exact, les premières et dernières fois d’échec, où ça a échoué (région/environnement), et une preuve comme un code d’état ou un extrait d’erreur. Ajoutez le propriétaire et une action d’entrée en une ligne pour que quelqu’un puisse agir en moins d’une minute.

Quelles sont de bonnes valeurs par défaut pour commencer ?

Utilisez des points de départ sûrs puis ajustez après une semaine de données réelles. Par exemple : vérifiez l’uptime chaque minute et pagez après deux échecs consécutifs ; lancez un test synthétique d’inscription toutes les 5 minutes et pagez après trois échecs ; pour les webhooks, avertissez sur de faibles taux d’échec soutenus et pagez sur des taux plus élevés soutenus ou un backlog croissant.

Si mon appli a été générée par des outils tels que Lovable/Bolt/v0 et se casse sans cesse, que faire ?

Si ces alertes sonnent sans cesse à cause de chemins critiques fragiles (auth, secrets exposés, handlers de webhook cassés), il vaut souvent mieux réparer le flux sous-jacent que d’ajuster sans fin les seuils. FixMyMess (fixmymess.ai) aide à diagnostiquer et réparer les bases de code générées par l’IA pour que ces chemins deviennent stables et que les alertes se calment pour de bonnes raisons.