Contrôle des coûts de logs pour prototypes : rétention, échantillonnage, redaction

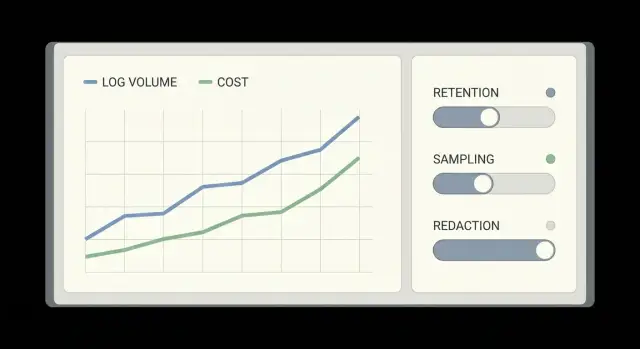

Contrôlez le coût des logs : définissez des paliers de rétention, des règles d’échantillonnage et de redaction pour que des prototypes en forte croissance conservent des logs utiles sans factures surprises.

Pourquoi les prototypes reçoivent des factures surprises pour les logs

Les prototypes commencent souvent par « tout logger » parce que c’est plus sûr que de manquer quelque chose d’important. Puis les vrais utilisateurs arrivent, le trafic augmente, et chaque clic produit plusieurs lignes de logs côté frontend, backend, auth, base de données et services tiers. Ce qui était un filet devient un tuyau d’incendie, parfois en un seul week-end.

Les factures surprises surviennent quand les coûts augmentent dans plusieurs directions à la fois. Vous payez pour ingérer le volume de logs, le stocker plus longtemps que nécessaire et le rendre consultable. Les logs peuvent aussi être dupliqués entre régions, envoyés à plusieurs outils ou extraits pour analyse, ce qui ajoute des coûts d’egress et de requête.

Les déclencheurs habituels sont simples :

- Logs de debug laissés activés en production

- Une requête qui crée beaucoup de logs (retries, boucles, clients bavards)

- Champs à haute cardinalité (IDs utilisateur, URL complètes, tokens aléatoires) indexés

- Rétention longue par défaut que personne ne consulte

- Gros payloads mis dans les logs (corps de requête complets, stack traces répétées)

« Logs utiles » pour une petite équipe est plus simple qu’il n’y paraît. Il faut surtout pouvoir répondre : Qu’est-ce qui a cassé ? Qui est affecté ? Quand ça a commencé ? Peut-on le reproduire ? Cela signifie généralement une erreur claire, un ID de requête ou de trace, quelques champs de contexte clés et une bonne stack trace quand quelque chose échoue, pas le journal de chaque requête réussie.

L’objectif est de déboguer rapidement sans payer pour stocker du bruit.

D’où viennent vraiment les coûts de logging

La plupart des factures de logging se résument à quelques multiplicateurs prévisibles qui apparaissent quand un prototype reçoit du vrai trafic.

Ingest est le premier facteur. Chaque événement de log doit être envoyé et accepté par le service de logging. Si votre code logge à chaque requête, chaque retry et chaque tick de job en arrière-plan, le volume augmente avec les utilisateurs et les bugs.

Stockage et rétention viennent ensuite. Conserver les logs bruts 30 à 90 jours peut sembler sûr, mais c’est cher quand la plupart ne sont jamais lus. Cela s’aggrave quand dev, staging et prod gardent la même rétention.

Recherche et indexation est une autre surprise fréquente. Rendre « tout consultable » signifie souvent indexer bien plus de champs que ceux que vous filtrez réellement au quotidien.

Cardinalité est le multiplicateur caché. Les champs avec beaucoup de valeurs uniques (user IDs, tokens de session, URL complètes avec query strings, texte d’erreur dynamique) peuvent faire exploser le nombre de combinaisons uniques que votre outil doit suivre.

Quelques multiplicateurs de coût à surveiller :

- Logs

infoà fort volume sur chaque requête - Rétention longue sur des environnements bavards (dev et staging)

- Indexer trop de champs par défaut

- Champs à haute cardinalité ajoutés comme tags ou labels

- Pipelines dupliqués qui transmettent les mêmes logs deux fois

Décidez de ce dont vous avez réellement besoin dans les logs

Le contrôle des coûts de logging commence par une décision : quelles questions doivent pouvoir répondre les logs quand quelque chose casse.

Pour la plupart des prototypes, les logs servent principalement à :

- Erreurs et crashs (quoi a échoué, où et pourquoi)

- Problèmes d’authentification (échecs de connexion, erreurs de token, vérifications de permission)

- Paiements et facturation (paiements échoués, erreurs de webhooks, événements dupliqués)

- Latence et timeouts (endpoints lents, requêtes lentes, tiers en retard)

Ensuite, décidez quand vous avez besoin du contexte complet et quand un résumé suffit. Le contexte complet aide pour des bugs tout neufs ou des incidents de sécurité, mais c’est coûteux. Pour beaucoup d’événements, un enregistrement court suffit : nom d’événement, ID de requête, ID utilisateur (ou hash sûr), code de statut et durée. Réservez les logs « payload complet » pour les cas rares, derrière un flag ou uniquement sur les erreurs.

Il aide aussi de tracer la ligne entre logs, métriques et traces :

- Logs disent ce qui s’est passé pour une requête spécifique.

- Métriques indiquent à quelle fréquence et avec quelle gravité (taux d’erreur, p95) sans gros volume.

- Traces montrent où le temps a été passé à travers les services.

Si vous poussez tout dans les logs, les factures augmentent vite et le débogage reste confus.

Enfin, classez les données en trois catégories :

- À conserver absolument : erreurs, décisions d’auth, changements d’état de paiement, version de déploiement, IDs de requête

- Bien d’avoir : détails de debug utilisés occasionnellement

- Ne jamais logger : secrets, mots de passe, tokens d’accès, données complètes de carte bancaire, messages personnels bruts

Un exemple simple : si l’inscription échoue, loggez le code d’erreur et le nom du champ qui a échoué la validation, pas le corps de requête complet.

Définir des paliers de rétention adaptés à l’usage réel

Un bon plan de rétention part d’une vérité : vous avez besoin de différents types de logs pour des timelines différentes. Si tout est conservé le même nombre de jours, soit vous perdez les détails utiles, soit vous payez pour du bruit.

Une configuration pratique en 3 paliers

- Hot (court) : logs applicatifs et debug très volumineux utilisés pour le dépannage actif. Garder 1–3 jours.

- Warm (moyen) : logs de requêtes standard et événements métier clés pour le suivi d’incidents. Garder 7–14 jours.

- Cold (long) : événements sécurité/audit à faible volume mais haute valeur (changements d’auth, modifications de permissions, actions admin). Garder 30–180 jours selon votre risque et vos obligations.

Le hot doit être petit mais détaillé. Le cold doit être stable et consultable, pas bourré de chaque ligne de debug.

Les environnements doivent avoir des règles différentes :

- En dev, garder une rétention courte (quelques heures à 1 jour).

- En staging, garder assez pour comparer les releases (2–7 jours).

- En production, garder warm et cold plus longtemps, mais être strict sur ce qui y a droit.

Choisir des chiffres sans deviner

Commencez par le comportement réel :

-

Combien de temps après un incident le remarquez-vous généralement (le jour même, le lendemain, la semaine suivante) ?

-

Combien de temps faut-il pour reproduire et confirmer un correctif ?

-

Quels événements devez-vous conserver pour la sécurité ou le support client ?

Utiliser l’échantillonnage pour réduire le volume sans devenir aveugle

L’échantillonnage conserve le signal tout en arrêtant le paiement pour chaque message « tout va bien ».

Commencez par une règle « erreurs d’abord » : capturez les échecs à 100 %. Cela inclut les logs d’erreur, les exceptions, les timeouts et toute requête retournant un 4xx ou 5xx. Quand quelque chose casse, vous voulez la piste complète.

Ensuite, ciblez les chemins de succès les plus bruyants. Ce sont souvent les health checks, le polling en arrière-plan, les retries bavards et les endpoints touchés sur chaque chargement de page.

Règles d’échantillonnage pratiques qui permettent toujours de déboguer

- Conserver 100 % des erreurs et warnings, plus toute requête au-delà d’un seuil de latence.

- Échantillonner les réponses 200 à fort volume (par exemple garder 1 requête sur 50).

- Ajouter des plafonds par endpoint (par exemple max 20 logs de succès par minute par route).

- Conserver les événements rares à 100 % (réinitialisation de mot de passe, facturation, actions admin).

- Supprimer les répétitions : si le même message arrive 1 000 fois, conservez les N premiers puis résumez.

Les limites de débit sont le filet de sécurité. Elles empêchent un bug (comme une boucle de retry) d’exploser votre volume de logs du jour au lendemain.

Documentez les règles en langage clair et maintenez-les stables. Un échantillonnage prévisible rend le débogage plus serein parce que vous savez ce qui est capturé intégralement et ce qui est volontairement échantillonné.

Principes de redaction : protéger les secrets et les données utilisateur

La redaction réduit le risque et souvent le volume. L’objectif est simple : garder les logs utiles pour le débogage sans capturer de secrets ou de données personnelles qu’il ne faut pas stocker.

Rédigez à la source (dans votre appli), pas après dans l’outil de logs. Si un secret est loggé une fois, il peut être copié dans des backups, des exports et des alertes.

Concentrez-vous sur les endroits qui répandent des données :

- En-têtes de requête

- Cookies

- Payloads d’auth

- Paramètres de query

Les champs risqués courants incluent Authorization, Cookie, IDs de session, champs de mot de passe, liens de réinitialisation, clés API et toute valeur contenant « token ». Beaucoup de frameworks loggent aussi des objets d’erreur complets qui incluent le contexte de la requête, donc vérifiez les paramètres par défaut.

Quand il faut relier des événements entre requêtes, masquez plutôt que supprimer. Par exemple, ne gardez que les 4 derniers caractères d’un token, ou enregistrez un hash à sens unique d’un email au lieu de l’email lui-même.

Règle simple pour les PII : évitez de logger les noms, emails, téléphones, adresses et IPs sauf motif clair et politique de rétention.

Des contrôles automatisés aident à prévenir les régressions :

- Ajouter un middleware de redaction basé sur une denylist (en-têtes, cookies, champs connus)

- Ajouter des tests qui échouent si les logs contiennent des motifs comme

Bearer,sk-oupassword= - Ajouter un scan pré-déploiement qui recherche des secrets dans les logs récents

- Maintenir une petite allowlist pour les champs « sûrs à logger »

Étape par étape : implémenter rétention, échantillonnage et redaction

Commencez par lister chaque endroit où des logs sont produits. Ne devinez pas. Incluez votre application web, les workers/jobs en arrière-plan, fonctions edge, logs de base de données et tout ce qui touche la connexion (auth, callbacks d’identity provider). Une source manquante peut maintenir des coûts élevés et compliquer les incidents.

Ensuite, standardisez une petite forme de log pour pouvoir filtrer rapidement et éviter des formats noisy ad hoc. Restez sobre : timestamp, level, nom du service et un request ID (ou trace ID). Ajoutez un court « event » name et un petit contexte JSON.

Puis définissez des valeurs par défaut par environnement :

- Production : info/warn/error seulement

- Staging : autoriser debug pour de courtes périodes

- Dev local : tout est permis

Voici un ordre d’implémentation qui marche souvent :

- Inventoriez les sources et assignez un propriétaire pour chacune

- Adoptez un petit schéma et appliquez-le dans le nouveau code

- Définissez les niveaux de logs par environnement avec un défaut sûr en prod

- Ajoutez de l’échantillonnage ou des limites pour les événements répétitifs (health checks, polling, retries)

- Ajoutez des filtres de redaction pour secrets et PII, plus des tests automatisés

Déployez les changements progressivement. Comparez avant/après le volume, le coût et l’utilité lors d’incidents pendant une semaine.

Surveillance des coûts d’observabilité : détecter les pics tôt

Si vous ne faites rien, les factures de logging ont tendance à augmenter silencieusement et à apparaître après coup. Le contrôle des coûts de logging consiste surtout à regarder quelques chiffres chaque jour et à savoir où chercher quand ils changent.

Suivez trois tendances :

- Volume d’ingest quotidien (combien vous envoyez)

- Croissance du stockage (ce que vous conservez)

- « Top talkers » (services ou routes produisant le plus de logs)

Les top talkers sont souvent un endpoint bruyant, un job en retry infini ou une erreur qui logge un payload complet à chaque requête.

Les alertes budgétaires importent plus que des dashboards parfaits. Définissez des alertes à quelques paliers (par exemple 50 %, 75 %, 90 % de votre budget mensuel) pour avoir le temps d’agir.

Les pics suivent souvent des releases, migrations, changements de config et sauts de trafic. Après chacun, vérifiez l’ingest et le volume d’erreurs dans la première heure. Un drapeau debug oublié peut multiplier les coûts du jour au lendemain.

Construire une vue de triage des coûts

Quand les coûts augmentent, vous voulez des réponses en minutes :

- Quel service a le plus augmenté depuis hier

- Quel endpoint ou job a produit la hausse

- Quel niveau de log a changé (info vs error vs debug)

- Quel champ a été ajouté (dumps de payload, en-têtes, stack traces)

- Quelle release corrèle avec le pic

Une fois la source trouvée, la correction est généralement : baisser le niveau de log, ajouter de l’échantillonnage, supprimer un champ bruyant ou plafonner une erreur répétée.

Gardez-le léger : une revue hebdomadaire de 15 minutes suffit pendant une croissance rapide.

Exemple : un prototype en forte croissance qui a dépassé son logging

Une petite équipe a lancé un prototype et est passée de 50 à 5 000 utilisateurs en deux semaines. Juste après l’ajout de la connexion par email, l’auth a commencé à échouer pour une partie des utilisateurs. Ils ont monté le niveau de log sur debug pour diagnostiquer, et le volume de logs a explosé du jour au lendemain.

Le problème n’était pas seulement « plus d’utilisateurs ». Ils loggaient les corps de requêtes complets, les en-têtes complets et des réponses d’auth enti`ères. Cela incluait de longs JWT, des refresh tokens et parfois des cookies de session. Pendant l’intervention, des gens ont copié des logs dans le chat, ce qui a multiplié le risque d’exposition.

Ils sont passés à des logs « juste suffisants ». Au lieu de tout dumper, chaque événement d’auth loggait : un request ID, un user ID (ou un ID anonymisé), l’endpoint, le code de statut, le code d’erreur, la latence et une courte raison. Pour le debug, ils notaient l’étape qui avait échoué (parse token, lookup DB, vérif mot de passe), pas le payload brut.

L’échantillonnage a fait la majeure partie du travail. Ils ont gardé 100 % des erreurs et timeouts, mais seulement 5 % des authentifications réussies. Cela montrait les tendances sans payer pour chaque OK.

La redaction a comblé la faille de sécurité. Tokens et secrets ont été masqués au niveau du logger, donc les recherches pendant l’incident n’exposaient pas de credentials.

Leur plan de rétention était simple :

- 7 jours : logs d’erreur complets (non échantillonnés)

- 14 jours : logs de requêtes échantillonnés (succès)

- 30 jours : événements sécurité/audit (champs minimaux)

- 90 jours : agrégats quotidiens seulement (comptes, p95 latence)

Erreurs courantes qui augmentent les coûts (et les risques)

La plupart des problèmes de contrôle des coûts de logging viennent d’une habitude : activer « tout » pendant un sprint prototype, puis ne jamais revenir en arrière quand les vrais utilisateurs arrivent.

Un piège courant est de logger par défaut les corps de requête et de réponse complets. Ça paraît utile, mais ça multiplie le volume et capture souvent mots de passe, tokens, détails de paiement ou messages privés. Si vous avez besoin des payloads, loggez seulement une allowlist réduite de champs sûrs et seulement pour une courte durée.

Un autre facteur silencieux est de rendre chaque champ consultable. Les champs à haute cardinalité comme user_id, session_id, trace_id, email et les URL complètes avec query strings peuvent faire exploser la taille de l’index. Gardez la plupart des champs en texte brut et n’indexez que quelques champs stables que vous filtrez réellement.

Trois erreurs qui apparaissent souvent juste avant une facture surprise :

- Laisser debug/verbose activé en production après un incident

- Utiliser les logs pour de l’analytics (funnels, cohortes) au lieu de métriques ou d’événements

- Ajouter la redaction seulement après que les logs aient été envoyés au fournisseur

La redaction doit se faire avant que quoi que ce soit ne quitte l’application. « On le nettoiera dans le pipeline » échoue la première fois qu’un nouvel endpoint logge quelque chose d’inattendu.

Checklist rapide avant votre prochain pic de croissance

Un pic de croissance transforme un logging « ça ira » en facture et en risque du jour au lendemain.

- Écrivez vos paliers de rétention et pourquoi ils existent. Rétention courte pour les logs debug à fort volume, rétention plus longue uniquement pour les logs que vous utilisez vraiment.

- Ajoutez des règles d’échantillonnage pour vos chemins les plus bruyants. Échantillonnez les succès de routine, conservez intégralement les erreurs et les cas rares.

- Redigez secrets et données personnelles avant que les logs quittent l’app. Si vous ne le colleriez pas dans un chat public, ça ne doit pas être dans un log.

- Activez budgets et alertes, puis testez-les. Vérifiez que les alertes se déclenchent et que quelqu’un les voit.

- Revoyez les principales sources de logs chaque semaine, avec un propriétaire unique. Nommez une personne responsable des changements de logging pour que le « debug temporaire » ne devienne pas permanent.

Étapes suivantes : stabiliser le logging en allant vers la production

Une fois les factures surprises stoppées, l’objectif est de garder les logs utiles à mesure que l’usage croît. Ce n’est pas une grosse modification unique mais des habitudes qui empêchent le volume de revenir par glissement.

Commencez par un audit rapide dans votre explorateur de logs et triez par ce qui produit le plus de données : le service le plus bavard, l’endpoint le plus occupé et les plus grosses lignes. Pour chacun, demandez : est-ce que ça aide à résoudre un vrai problème, ou c’est juste du « bien d’avoir » ?

Corrigez d’abord les plus gros coupables :

- Bruit debug oublié activé en environnements proches de la production

- Champs à haute cardinalité (URL complètes avec query strings, valeurs fournies par l’utilisateur)

- Payloads bruts (corps de requête/réponse complets, gros JSON blobs, stack traces répétées)

Rendez ensuite les protections difficiles à annuler par accident. Ajoutez des tests de redaction qui échouent la build si les logs contiennent des motifs comme des clés API, JWTs, mots de passe ou préfixes communs de secrets. Ajoutez un simple « contrat de logs » pour les événements clés (échecs d’auth, erreurs de paiement, échecs de jobs) afin de savoir ce qui doit être enregistré et ce qui ne doit jamais l’être.

Si vous avez hérité d’un prototype généré par IA, prévoyez du temps supplémentaire pour le nettoyage. Ces projets arrivent souvent avec un logging bavard par défaut, des extraits qui affichent en-têtes ou tokens, et des flows d’auth fragiles qui déclenchent des erreurs répétées (et donc des logs répétés).

Si vous voulez de l’aide extérieure, FixMyMess (fixmymess.ai) se spécialise dans le diagnostic et la réparation de codebases générés par IA, y compris le logging bruyant, l’exposition de secrets et le durcissement pour la production. Un audit rapide peut identifier les hotspots de volume de logs et les changements les plus sûrs à faire en priorité.

Questions Fréquentes

What’s the fastest way to stop a surprise logging bill?

Commencez par désactiver les logs debug/verbose en production et supprimer tout dump des corps de requête/réponse. Réduisez ensuite la rétention des logs à fort volume à quelques jours et ajoutez de l’échantillonnage pour les requêtes 200 OK de routine tout en conservant 100 % des erreurs. Ces trois changements réduisent généralement rapidement le volume sans nuire au débogage.

What should I log in a prototype to keep it useful but cheap?

Par défaut, consignez les échecs et les changements d’état importants, pas chaque requête réussie. Une bonne base : horodatage, niveau, nom du service, endpoint, code de statut, durée, et un ID de requête ou de trace, plus un court code d’erreur en cas d’échec. Ajoutez uniquement le contexte minimum nécessaire pour reproduire les incidents.

How do I choose log retention without guessing?

Les coûts de rétention augmentent avec le volume, donc les logs à fort flux nécessitent des fenêtres courtes. Conservez les logs détaillés « chauds » pour 1–3 jours, les logs de requêtes généraux pour 7–14 jours, et les événements sécurité/audit peu fréquents plus longtemps si vous en avez vraiment besoin. Si vous hésitez, commencez par une rétention plus courte et étendez-la seulement si vous constatez que vous utilisez les logs plus anciens.

How can I use sampling without going blind during incidents?

Capturez 100 % des erreurs, exceptions, timeouts et requêtes anormalement lentes pour ne pas perdre les éléments nécessaires lors d’un incident. Pour les chemins de réussite à fort volume, échantillonnez un petit pourcentage afin de conserver les tendances sans stocker chaque événement. Ajoutez une limite de débit stricte pour qu’une boucle de retry ne multiplie pas le volume du jour au lendemain.

What does “high cardinality” mean, and why does it raise costs?

Les champs à haute cardinalité sont des valeurs presque toujours uniques, comme les URL complètes avec query strings, les tokens de session, les IDs aléatoires et les textes d’erreur dynamiques. Lorsqu’ils sont indexés comme tags/labels, l’outil de logs doit suivre un très grand nombre de combinaisons uniques, ce qui augmente rapidement les coûts. Évitez d’indexer ces données et conservez seulement des champs stables que vous filtrez vraiment.

How do I decide which fields to index for search?

Indexez seulement un petit ensemble de champs stables que vous filtrez régulièrement, par exemple : nom du service, environnement, niveau de log, endpoint et un petit ensemble de codes d’erreur. Laissez le reste en JSON/texte non indexé pour qu’il soit disponible si besoin sans gonfler l’index. Si les recherches sont lentes, ajoutez un champ à la fois plutôt que d’indexer tout par défaut.

What’s the safest way to prevent tokens and secrets from leaking into logs?

Redigez avant que les logs ne quittent votre appli, car une fois un secret expédié, il peut se propager dans les alertes, les exports et les backups. Masquez ou supprimez les en-têtes et champs sensibles comme Authorization, cookies, mots de passe, clés API, liens de réinitialisation et tokens. Pour la corrélation, enregistrez un hachage à sens unique ou une valeur partielle plutôt que le secret brut.

Why did my logging volume explode right after a release?

C’est souvent un drapeau de configuration laissé activé après le dépannage, ou un chemin de code qui journalise à chaque retry ou boucle. Une autre cause fréquente est l’ajout d’un champ volumineux aux logs, comme les corps de requête ou des stack traces répétées. En cas de pic, identifiez d’abord le service/endpoint qui parle le plus et annulez immédiatement le changement bruyant, puis ajoutez échantillonnage ou limites de débit.

How do I monitor logging costs so spikes don’t surprise me again?

Suivez le volume d’ingest quotidien, la croissance du stockage et les « top talkers » par service et endpoint, et définissez des alertes budgétaires qui se déclenchent tôt dans le mois. Quand une alerte sonne, vérifiez ce qui a changé : un déploiement, une config ou un endpoint qui a commencé à faire des retries. Traitez les modifications de logging comme des changements de production, avec un propriétaire et une revue rapide après les releases.

My prototype was built with an AI tool and the logs are a mess—what should I do?

Les prototypes générés par IA ont souvent des logs verbeux par défaut, des extraits copiés qui affichent en-têtes ou tokens, et des flux d’authentification fragiles qui provoquent des erreurs et des retries répétés. Si vous ne savez pas d’où vient le bruit, FixMyMess peut réaliser un audit de code gratuit pour repérer les principaux générateurs de volume de logs, les risques d’exposition de secrets et les corrections les plus sûres. Nous pouvons ensuite nettoyer et durcir le code pour la production rapidement, même si le prototype est en désordre.