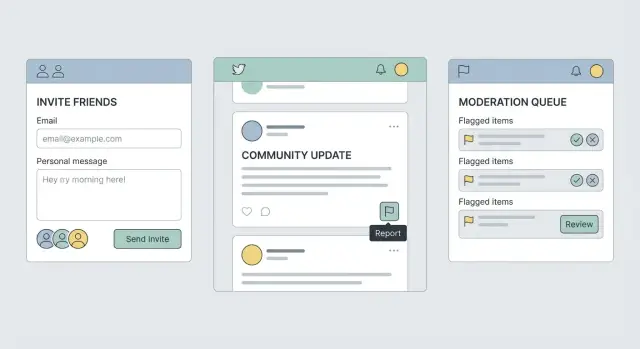

Flux de modération pour une application communautaire créée par IA

Un plan pratique pour un flux de modération d'application communautaire : invitations, actions par rôle, signalements et étapes de revue pour garder votre espace sûr.

Pourquoi les workflows de sécurité font ou défont une application communautaire

Une application communautaire peut sembler accueillante le premier jour et chaotique dès la deuxième semaine. Ce changement ne vient généralement pas des fonctionnalités. Il survient quand il n'y a pas de workflow de sécurité clair : les gens ne savent pas comment signaler un problème, les modérateurs ne savent pas quoi faire ensuite, et les acteurs malveillants apprennent qu'ils peuvent pousser les limites sans conséquence.

Sans plan, les mêmes problèmes se répètent : comptes spam postant des liens, harcèlement dans les réponses et les messages, usurpation d'identité de membres de confiance, et arnaques visant les nouveaux utilisateurs. Même quelques incidents peuvent donner le ton. Les membres réguliers arrêtent de publier, et les personnes que vous souhaitez le plus garder partent en premier.

Les fonctionnalités flashy ne résolvent rarement cela. Les invitations et le signalement comptent plus parce qu'ils contrôlent qui entre et ce qui se passe quand quelque chose tourne mal. Si les invitations sont faciles à abuser, vous verrez des vagues de comptes de faible qualité. Si le signalement est confus ou inutile, les membres se disputeront en public, partiront discrètement ou déplaceront les problèmes ailleurs.

Un bon flux de modération pour une application communautaire n'est pas synonyme de sévérité. Il s'agit de cohérence. Le même type de comportement doit mener à la même étape suivante, et les membres doivent savoir à quoi s'attendre.

Pour une petite équipe, « assez sûr pour lancer » signifie généralement que vous pouvez faire quatre choses de façon fiable :

- Réduire les abus à la porte avec des vérifications d'invitation basiques et des limites de taux.

- Permettre à n'importe qui de signaler en quelques taps, avec des raisons claires et des détails optionnels.

- Donner aux modérateurs un petit ensemble d'actions (avertir, supprimer du contenu, couper la parole temporairement, bannir) avec une escalade claire.

- Conserver un enregistrement léger de ce qui s'est passé (qui a fait quoi, quand et pourquoi).

Si votre appli a été construite rapidement avec des outils IA, testez ces flux tôt. Les équipes découvrent souvent que l'auth, les permissions ou les écrans de signalement semblent corrects mais échouent en usage réel.

Définir des règles claires que vous pouvez réellement appliquer

Les règles ne fonctionnent que si vous pouvez les appliquer de la même façon à chaque fois. Commencez par définir en une phrase pour qui est la communauté, et ajoutez une phrase sur ce qu'elle n'est pas. Exemple : « Un groupe de pairs pour nouveaux product managers. Ce n'est pas un endroit pour vendre des services ou recruter pour des emplois non liés. » Cette ligne guidera les décisions plus tard.

Ensuite, transformez vos règles en quelques catégories simples que vous pouvez taguer et traiter rapidement. Si une règle ne peut pas être mappée à une catégorie, elle est difficile à appliquer.

- Spam et arnaques (postings massifs, liens d'affiliation, faux cadeaux)

- Harcèlement et haine (insultes, menaces, ciblage d'une personne)

- Contenu dangereux (encouragement à l'automutilation, contenu sexuel impliquant des mineurs)

- Désinformation (affirmations médicales dangereuses, usurpation d'identité)

- Violations de la vie privée (doxxing, partage de captures d'écran privées)

Puis décidez ce qui est automatique et ce qui nécessite un humain. Gardez la liste « automatique » courte et évidente. Les faux positifs semblent injustes et apprennent aux gens à ne pas faire confiance au signalement.

Une séparation pratique ressemble à ceci : bloquer automatiquement les schémas de spam clairs, les arnaques évidentes, le doxxing et le contenu sexuel impliquant des enfants ; masquer automatiquement le contenu en attente de revue lorsqu'il y a des signalements répétés, des insultes ou des réclamations d'usurpation ; et envoyer les cas nécessitant du contexte (litiges, sarcasme, blagues limites) à une revue humaine.

Rédigez de courts messages destinés aux utilisateurs avant d'en avoir besoin. Ils doivent expliquer ce qui s'est passé, pourquoi, et quoi faire ensuite.

Exemple de message de suppression : « Nous avons supprimé votre publication car elle contenait un lien commercial. Cet espace est réservé à la discussion, pas à la promotion. Vous pouvez republier sans lien. »

Exemple d'avertissement : « Veuillez cesser de commenter des traits personnels. Critiquez les idées, pas les personnes. Une récidive peut entraîner une coupure temporaire de l'accès. »

Concevoir un flux d'invitation et d'intégration qui réduit les abus

Un bon flux d'invitation et d'intégration fait deux choses à la fois : il aide les vraies personnes à rejoindre rapidement et il rend la vie difficile aux acteurs malveillants qui veulent arriver en masse. Quand vous y parvenez, la modération reste plus calme parce que moins de problèmes entrent dans l'espace.

Choisir la bonne « porte » pour votre communauté

Choisissez la méthode d'entrée la plus simple qui correspond à votre niveau de risque :

- Entrée ouverte : meilleure pour les espaces à faible risque, mais attendez-vous à plus de spam et trolls de passage.

- Sur invitation uniquement : idéal au début et pour les groupes payants ; croissance plus lente, ton plus sûr.

- Liste d'attente : utile quand vous avez besoin de temps pour vérifier les profils ou contrôler la croissance.

- Références : efficace quand les membres cautionnent les nouveaux et que vous pouvez tracer les abus jusqu'à la source.

Vous pouvez commencer strict et assouplir plus tard. Renforcer les règles après que la communauté est devenue chaotique est beaucoup plus difficile.

Ajouter une friction légère qui bloque l'abus de masse

La plupart des abus ne sont pas « une personne ayant une mauvaise journée ». Ce sont des tentatives répétées, inscriptions automatisées et partages de liens. Quelques garde-fous font beaucoup :

- Faire expirer les liens d'invitation (par exemple, 24 à 72 heures) et proposer des codes à usage unique.

- Limiter le taux de création d'invitations et d'inscriptions (par compte, par IP et par appareil quand possible).

- Exiger un email vérifié avant de poster ou d'envoyer des DM ; considérer la vérification téléphonique optionnelle pour les groupes à risque élevé.

- Limiter le nombre de comptes pouvant être créés depuis un même appareil dans une fenêtre temporelle.

Reliez la friction au pouvoir. Les nouveaux comptes peuvent lire et réagir, tandis que publier, insérer des liens et envoyer des DM se débloquent après vérification ou après une courte période de « bon comportement ».

Onboarding qui définit les normes avant que les problèmes n'apparaissent

L'onboarding n'est pas qu'un écran de bienvenue. C'est votre première chance d'énoncer les attentes en langage clair. Une courte « promesse communautaire » à cocher plus quelques invites peuvent réduire les mauvais comportements et donner aux modérateurs quelque chose de concret à citer plus tard.

Exemple : un groupe local de fondateurs peut demander « Qu'est-ce que vous construisez ? » et « Pourquoi êtes-vous ici : retours, recrutement ou networking ? » Puis afficher trois règles : pas de harcèlement, pas de spam, et garder les pitches dans le bon canal.

Consigner ce qu'il faut pour enquêter, sans être intrusif

Pour les invitations, enregistrez ce qui vous aide à tracer un abus sans collecter de données personnelles superflues :

- ID de l'invitant, type d'invitation, et quand elle a été créée et utilisée

- statut de l'invitation (expirée, utilisée, révoquée) et combien de tentatives

- signaux de base comme la région IP ou un hash d'empreinte appareil (si vous l'utilisez), pas les détails bruts de l'appareil

- les premières actions d'un nouveau compte (rejoindre, poster, envoyer un DM) avec horodatages

Construire un signalement facile à utiliser et difficile à manipuler

Un bon système de signalement intégré doit prendre quelques secondes à utiliser, protéger la personne qui signale et donner aux modérateurs suffisamment de contexte pour agir.

Placez « Signaler » là où le préjudice se produit : sur les posts et commentaires, dans les DM et fils de messages, sur les profils utilisateurs (pour usurpation ou harcèlement répété) et au niveau du groupe ou canal (pour les anneaux de spam).

Gardez le formulaire de signalement court. Demandez d'abord une catégorie (harcèlement, spam, haine, usurpation, risque d'automutilation, menace de violence, doxxing, autre). Puis proposez des notes optionnelles et un moyen simple d'attacher une preuve, comme une capture d'écran ou un ID de message que votre appli capture automatiquement.

Permettez aux gens de se protéger en signalant. Une option « Bloquer » ou « Muet » dans l'écran de signalement réduit le préjudice immédiatement. Si le blocage modifie aussi l'accès à un groupe partagé, informez-en avant la confirmation.

Fixez des attentes sur l'écran final. Dites ce qui se passe ensuite, ce que vous pouvez ou ne pouvez pas partager, et quel est le délai de réponse typique. Si vous ne pouvez pas garantir un délai, donnez une fourchette et expliquez ce qui le modifie (sévérité, récidive, détails manquants).

Rendez le flux plus difficile à abuser. Limitez le taux de signalement depuis de nouveaux comptes, surveillez les signalements répétés et exigez une courte raison quand quelqu'un signale la même personne plusieurs fois. Évitez d'exposer des détails qui pourraient identifier le rapporteur.

Les cas d'urgence nécessitent une voie plus rapide. Ajoutez une option « urgent » seulement pour les catégories à haut risque et déclenchez des alertes immédiates pour :

- menaces crédibles de violence

- menaces d'automutilation ou intention suicidaire

- doxxing (adresse personnelle, lieu de travail, téléphone privé)

- préoccupations liées à la sécurité des enfants

Exemple : quelqu'un reçoit un DM contenant son adresse. Il signale le DM, choisit « Doxxing », l'appli attache automatiquement le message et il bloque l'expéditeur. L'écran de confirmation explique que le message est verrouillé pour revue, et un modérateur le voit en haut de la file avec un tag d'urgence.

Actions de modération et règles d'escalade

Un workflow de modération a besoin de deux choses : un menu clair d'actions et des règles claires pour quand utiliser chaque action. Sans cela, les résultats semblent aléatoires et les acteurs malveillants découvrent les failles.

Actions qui soutiennent, pas seulement punissent

Commencez avec un petit ensemble d'actions couvrant la plupart des cas :

- Supprimer du contenu (masquer ou supprimer un post/commentaire)

- Avertir (citer la règle et ce qui doit changer)

- Mettre en pause (lecture seule temporaire ou impossibilité de poster pendant une période donnée)

- Suspendre (compte en pause pour un nombre de jours défini, nécessite une revue pour revenir)

- Bannir (suppression permanente, avec protections appareil/IP si vous les utilisez)

Les actions douces comptent aussi, surtout quand quelqu'un est à la limite ou qu'un fil chauffe. Des mesures comme le « slow mode », restrictions temporaires de liens, ou exiger une approbation pour les tout nouveaux comptes peuvent stopper les dégâts sans passer directement au bannissement.

Escalade et appels

Définissez qui peut faire quoi. Un chemin simple fonctionne : le modérateur gère la première réponse, l'admin traite les récidives et cas limites, et le propriétaire tranche sur les bannissements permanents ou les problèmes à haut risque (harcèlement, doxxing, menaces). Pour les actions difficiles à annuler (comme un bannissement), exigez la confirmation d'une seconde personne.

Les appels doivent exister, mais pas pour tout. Autorisez les appels pour les longues mises en pause, suspensions et bannissements. N'acceptez pas d'appel pour le spam évident ou les violations claires de sécurité. Idéalement, assignez un réviseur d'appel qui n'a pas été impliqué dans la décision initiale et fixez une limite temporelle (par exemple, dans les 7 jours) pour que les cas ne traînent pas.

La cohérence devient plus simple avec trois petits outils : raisons pré-rédigées mappées à vos règles, notes internes cachées aux membres, et un compteur de strikes simple pour que les récidives escaladent de façon prévisible.

Étape par étape : mettre en place le workflow complet de l'invitation à la résolution

Traitez le workflow comme une chaîne de montage : qui peut faire quoi, où vont les signalements, et comment les décisions sont prises. Configurez-le une fois, puis respectez-le.

Étape 1 : Définir rôles de modération et permissions

Commencez par des rôles que vous pouvez expliquer en une phrase chacun : membre, de confiance, modérateur, admin. « De confiance » est utile car il donne aux membres éprouvés plus de liberté (poster des liens, inviter d'autres) sans leur donner tout le pouvoir de modération.

Écrivez ce que chaque rôle peut voir et faire. Gardez cela ennuyeux et précis.

Une checklist rapide :

- Qui peut inviter de nouveaux utilisateurs

- Qui peut voir l'identité du rapporteur

- Qui peut masquer du contenu vs le supprimer

- Qui peut appliquer des mises en pause vs des bannissements

- Qui peut consulter le journal de modération

Étape 2 : Créer des états de file de signalement

Donnez à chaque signalement un statut pour que rien ne se perde. Un ensemble simple : Nouveau, Triage, Résolu, En appel.

Nouveau signifie qu'il vient d'arriver. Triage signifie qu'un modérateur vérifie le contexte (historique de messages, captures, signalements passés). Résolu signifie qu'une action a été prise ou que le signalement a été clos avec une raison. En appel signifie que l'utilisateur a contesté la décision et qu'il faut un second examen.

Étape 3 : Ajouter des notifications qui tiennent informés

Alertez les modérateurs quand un signalement passe en Nouveau, et de nouveau s'il reste trop longtemps. Alertez le rapporteur lorsque le signalement devient Résolu, même si vous ne pouvez pas partager de détails. Un court message comme « Merci, nous avons examiné et pris des mesures » évite les répétitions et la frustration.

Évitez les alertes bruyantes. Regroupez les items basse priorité, mais envoyez des alertes immédiates pour les signalements à haut risque (menaces, doxxing, sécurité enfant, arnaques).

Étape 4 : Ajouter limites de taux et contrôles d'abus

Les abus apparaissent souvent via les invitations et les signalements. Ajoutez des limites simples tôt :

- limiter les invitations par compte et par jour (plus strict pour les nouveaux comptes)

- ralentir les signalements répétés d'un même utilisateur dans une courte fenêtre

- détecter les rafales de signalements et les rediriger en revue

- exiger une courte note pour les catégories de signalement sévères

- marquer les comptes avec beaucoup de signalements rejetés pour un examen plus poussé

Étape 5 : Utiliser un modèle de décision pour la cohérence

Chaque action de modération doit enregistrer au minimum : raison, action et suite.

- Raison : quelle règle a été enfreinte (en langage simple)

- Action : ce qui s'est passé (masquer post, avertir, muet 24h, bannir)

- Suite : ce que l'utilisateur peut faire ensuite (éditer et republier, faire appel, ressources de sécurité)

Si votre appli est construite par IA, prévoyez du temps supplémentaire pour tester les cas limites, par exemple si « muet » bloque vraiment les notifications ou si le contenu masqué apparaît encore dans la recherche.

Journaux, pistes d'audit et principes de confidentialité

Une communauté peut sembler « modérée » même quand ce n'est pas juste. De bons journaux règlent cela. Ils vous permettent de revoir des décisions, repérer des tendances et expliquer ce qui s'est passé sans compter sur la mémoire.

Décidez ce que vous devez enregistrer pour rendre les décisions traçables, et rien de plus. Stockez les faits nécessaires pour comprendre un cas, pas une copie complète de la vie privée de chacun.

Un jeu minimum qui tient généralement :

- Détails du signalement : catégorie, raison libre, IDs de messages/posts pertinents

- Action prise : aucune, avertissement, suppression de contenu, muet, bannissement (avec durée)

- Horodatages : signalé, revu, actionné

- Acteurs : qui a signalé, quel modérateur l'a traité, qui a approuvé une escalade

- Pointeurs de preuves : IDs de pièces jointes ou captures de message (seulement ce qui est nécessaire)

Les problèmes de confidentialité viennent souvent du « au cas où » : éviter de journaliser l'intégralité de l'historique de messages, les adresses IP brutes ou de copier des profils entiers dans chaque dossier. Si vous devez stocker du contenu sensible (captures, extraits de messages), limitez qui peut y accéder. Séparer les permissions « voir le contenu » des permissions « agir » aide les modérateurs juniors à traiter la file sans parcourir des données privées.

Bases de la piste d'audit

Chaque action de modération doit écrire un événement clair : qui a fait quoi, à qui, quand et pourquoi. Rendre le « pourquoi » obligatoire pour les actions sérieuses (mises en pause longues, bannissements). Si vous autorisez des modifications aux signalements, conservez l'historique des versions pour que les changements soient visibles.

Tableaux de bord simples qui aident vraiment

Vous n'avez pas besoin d'analytique sophistiquée. Un petit tableau de bord mis à jour quotidiennement suffit :

- taille de la file et ancienneté du plus ancien signalement ouvert

- récidivistes (utilisateurs avec plusieurs actions confirmées)

- principales catégories de signalement

- charge de travail des modérateurs (cas par modérateur)

- actions renversées (appels qui ont annulé une décision)

Fixez des règles de rétention avant le lancement. Conservez les événements d'audit plus longtemps que les preuves brutes. Par exemple, conservez les événements d'audit 12 à 24 mois, mais supprimez les pièces jointes et captures plus tôt (30 à 90 jours) sauf si un cas est escaladé.

Erreurs courantes qui créent des résultats dangereux ou injustes

La plupart des applications communautaires échouent en sécurité pour une raison simple : les règles sont écrites, mais les workflows ne le sont pas.

Trop de pouvoir dans un seul compte de modérateur

Une erreur fréquente est de donner aux modérateurs un accès complet aux profils, emails, données IP, messages privés ou informations de facturation juste pour gérer des signalements basiques. C'est risqué pour la vie privée et peut causer de réels dommages si quelqu'un dérape ou prend une décision émotionnelle.

Gardez les permissions étroites et basées sur la tâche. Un modérateur qui peut masquer un post ne devrait pas automatiquement pouvoir consulter tout l'historique d'un utilisateur ou exporter la liste des membres.

Pas de garde-fous contre le spam et le brigading

Si les invitations et signalements peuvent être utilisés sans limites, les acteurs malveillants en profiteront. Vous verrez spam d'invitations, faux comptes et tempêtes de signalements coordonnées visant à faire taire quelqu'un.

Ajoutez de la friction qui ne pénalise pas les utilisateurs normaux : limiter les invitations pour les nouveaux membres, ralentir les signalements répétés, détecter les rafales et exiger une courte raison pour certaines catégories.

Cas limites qui brisent la confiance

La modération devient compliquée dans les coins : un post est supprimé avant revue, deux utilisateurs se bloquent mutuellement, un membre est banni d'un groupe mais pas de l'application entière, ou un message signalé se trouve dans un fil privé. Si votre UI indique « Signalement envoyé » mais que les modérateurs ne peuvent pas voir le contenu, les utilisateurs se sentent ignorés.

Assurez-vous que chaque signalement peut se résoudre proprement même quand le contenu manque. Stockez un instantané minimal (ce qui s'est passé, quand et pourquoi) pour que les réviseurs puissent agir sans exposer plus de données que nécessaire.

Messages confus et absence d'appels

Des notifications génériques comme « Vous avez enfreint les règles » sans contexte font que les gens se sentent punis au hasard. Le silence après un signalement produit le même effet.

Chaque action doit inclure une raison en langage clair, ce qui se passe ensuite et comment faire appel (lorsque l'appel est disponible). Même une option simple « demander une revue » réduit le churn et les explosions publiques.

Checklist rapide pré-lancement

Vous pouvez lancer vite et rester prudent si vous vérifiez les détails ennuyeux avant l'arrivée des vrais utilisateurs.

Exécutez cette checklist sur une build de staging (ou bêta privée) et notez ce que vous observez. Si quelque chose vous semble flou, ce sera confus pour les modérateurs et les utilisateurs aussi.

- Les invitations se comportent de façon prévisible : elles expirent, peuvent être révoquées et ne peuvent pas être réutilisées par accident. Testez ce qui se passe si quelqu'un transfère une invitation.

- Le signalement est réellement rapide : depuis posts, commentaires, DM et profils, un utilisateur peut signaler en environ deux taps, ajouter une courte note et soumettre.

- Les modérateurs ont une file claire : les nouveaux signalements atterrissent dans une seule boîte avec des filtres basiques (nouveau, en revue, résolu).

- Chaque action laisse une trace d'audit : bannissements, mises en pause, suppressions, avertissements, changements de rôle et résultats de signalement écrivent tous une entrée de journal indiquant qui, quand et pourquoi.

- Les blocages sont appliqués : les utilisateurs bloqués ne peuvent pas contacter le bloqueur (DM, réponses, mentions). Vérifiez que le blocage n'expose pas d'informations de présence comme le statut en ligne.

Après la checklist, faites cinq simulations d'abus rapides avec un coéquipier : une rafale de spam, une tentative d'usurpation, un fil de harcèlement (réponses et DM), une tentative d'évasion (nouveau compte après bannissement) et une tentative de faux signalement (pour instrumentaliser le signalement).

Scénario d'exemple et étapes pour expédier en sécurité

Un test réaliste est simple : un tout nouveau membre rejoint via une invitation et commence à envoyer des DM spam en quelques minutes.

Pour la personne ciblée, le flux doit être rapide et protecteur. Elle ouvre le DM, appuie sur Bloquer, puis sur Signaler. Le formulaire de signalement est court : choisir une raison (Spam), ajouter une note optionnelle et soumettre. La confirmation doit être claire : « Merci, nous avons reçu votre signalement. Vous ne recevrez plus de messages de ce compte. »

Pour les modérateurs, le signalement doit arriver avec assez de contexte pour agir sans exposer de données privées inutiles : âge du compte, source de l'invitation (qui l'a invitée), nombre récent de messages, contenu signalé et s'il y a d'autres signalements contre le même compte.

Le point de décision est souvent mise en pause vs bannissement. Si c'est mineur, premier incident et faible volume, une courte mise en pause plus un avertissement peuvent suffire. Si le compte est tout neuf, envoie beaucoup de DM rapidement et reçoit plusieurs signalements, le bannissement est l'option la plus sûre. L'essentiel est la cohérence : des comportements similaires doivent mener à des résultats similaires.

Une règle de décision simple :

- Mise en pause pour les cas mineurs, premiers incidents et faible volume.

- Bannissement pour le spam à grand volume, le comportement récurrent ou les multiples signalements.

- Révoquer les privilèges d'invitation (ou marquer l'invitant) si le même invitant attire régulièrement des acteurs malveillants.

- Escalader à un admin pour les menaces, les mineurs ou le doxxing.

Les signalants doivent recevoir une mise à jour de statut qui ne révèle pas de détails privés : « Nous avons examiné votre signalement et pris une mesure conformément à nos règles. » Si vous proposez des appels, gardez-les simples. L'utilisateur banni peut demander une revue, mais ne devrait pas pouvoir contacter les modérateurs depuis le même compte bloqué.

Si vous avez récupéré un prototype généré par IA où les rôles, les journaux d'audit ou les flux de signalement ne tiennent pas lors de ces exercices, FixMyMess (fixmymess.ai) peut diagnostiquer ce qui est cassé et aider à remettre les bases de sécurité en ordre avant le lancement, y compris un audit de code gratuit.