Schémas d'invalidation de cache efficaces pour les données qui changent rapidement

Modèles pratiques d'invalidation de cache pour données à évolution rapide : clés versionnées, tagging et TTL courts afin que les utilisateurs ne voient plus de résultats périmés.

À quoi ressemble un cache obsolète dans les applications réelles

Un cache obsolète, c’est quand votre application affiche des données qui étaient vraies il y a un instant, mais qui sont fausses maintenant. Les utilisateurs appellent rarement ça un problème de cache. Ils disent « votre site est cassé », parce que ce qu’ils voient ne correspond pas à ce qu’ils viennent de faire.

On le rencontre le plus rapidement là où les données changent constamment :

- Le total du panier est incorrect après l’ajout ou la suppression d’un article.

- Une fiche produit affiche un ancien prix, alors que la validation montre le nouveau.

- L’inventaire indique « en stock », puis la commande échoue parce que l’article est en rupture.

- Un tableau de bord ne reflète pas un paiement, un remboursement ou un changement de statut tout juste terminé.

- Une mise à jour de profil « s’enregistre », mais l’ancien nom ou avatar réapparaît.

Les données qui changent rapidement sont différentes des pages essentiellement statiques parce que le coût d’une erreur est immédiat. Un article de blog périmé est agaçant. Un prix obsolète, un quota, une liste de permissions ou un statut de livraison peuvent entraîner des ventes perdues, des tickets de support et parfois des problèmes de sécurité (par exemple, afficher des données auxquelles quelqu’un ne devrait plus avoir accès).

Il est aussi utile d’être précis sur ce qui est mis en cache. Dans les applications réelles, le cache n’est pas seulement « la page ». Vous pouvez mettre en cache une réponse d’API, le résultat d’une requête DB, une valeur calculée (comme « produits recommandés ») ou une page HTML entièrement rendue. Souvent plusieurs couches sont mises en cache en même temps, ce qui explique pourquoi les utilisateurs peuvent rafraîchir et voir quand même la mauvaise chose.

Un scénario courant : vous déployez un prototype construit avec un outil IA, tout a l’air rapide en test, puis en production ça dérive. Un endpoint met en cache « solde du compte », un autre met en cache « transactions récentes », et l’UI combine les deux. Le résultat est un solde qui semble incorrect même si chaque partie est « correcte » isolément.

Une bonne invalidation vise une chose : après une mise à jour, arrêter de servir l’ancienne réponse.

Décidez de la fraîcheur nécessaire

Avant de choisir une stratégie d’invalidation, définissez ce que « frais » signifie pour chaque type de données. Ne dites pas « le plus frais possible. » Mettez un nombre : « sous 5 secondes », « sous 2 minutes », ou « doit être correct à chaque requête. » Cette décision transforme le caching de l’artisanat en plan.

Demandez-vous ce qui se passe si un utilisateur voit l’ancienne valeur. Parfois l’impact est faible (un graphique de tableau de bord a une minute de retard). Parfois cela cause un vrai dommage (un client est facturé au mauvais montant, ou la validation indique un article en stock alors qu’il ne l’est pas). Les lectures périmées n’apparaissent pas seulement comme agaçantes : elles deviennent remboursements, tickets de support, emails en colère, et des décisions prises sur des rapports erronés.

La plupart des applications ont besoin de règles de fraîcheur différentes selon les données. Les données spécifiques à l’utilisateur (profil, permissions, panier) nécessitent généralement plus de fraîcheur que le contenu global (page d’accueil, articles de blog, FAQ publiques). Séparez aussi le « critique » du « agréable à avoir ». Une bannière marketing périmée est embêtante. Un statut de facturation périmé est une crise.

Une méthode pratique consiste à étiqueter chaque jeu de données avec un budget de fraîcheur et un niveau de conséquences :

- Doit être correct à chaque requête : auth, permissions, facturation, statut de paiement

- Doit être correct en quelques secondes : inventaire, prix, disponibilité des places

- Peut avoir une minute de retard : fils d’activité, résumés analytiques

- Peut avoir des heures de retard : contenu statique, rapports long terme

C’est aussi un bon moment pour repérer la « stale data » cachée. Dans les prototypes générés par IA, le cache est souvent ajouté au mauvais endroit, comme l’état de session ou les rôles utilisateur.

Les principaux modèles d’invalidation de cache en un coup d’œil

Quand les données changent vite, le caching peut sembler être un piège : les lectures sont plus rapides, mais vous risquez d’afficher la mauvaise chose. La plupart des configurations réelles utilisent un petit ensemble de modèles. L’important est de choisir celui qui correspond à la fréquence de changement de vos données et au coût d’être « faux pendant une minute ».

Approches principales :

- Supprimer (invalidation explicite) : retirer les entrées mises en cache quand les données sous-jacentes sont mises à jour.

- Expirer (TTL court) : laisser les entrées mourir rapidement pour éviter qu’elles ne persistent.

- Contourner : ignorer le cache pour certaines requêtes (ou certains utilisateurs) quand la fraîcheur est critique.

- Réevalider : servir depuis le cache, mais vérifier si c’est encore valide et rafraîchir au besoin.

Quand chaque approche convient

Supprimer convient quand les mises à jour sont claires et pas trop fréquentes. Ex. : un administrateur édite un article de blog. Vous pouvez supprimer la page mise en cache (ou les clés liées) juste après l’enregistrement.

Expiration (TTL court) est un bon choix par défaut quand les données changent souvent et que vous tolérez une courte obsolescence. Si une valeur change chaque minute, un TTL de 10 à 30 secondes peut suffire sans logique complexe.

Contourner est le bon choix quand la correction prime sur la vitesse. Ex. : checkout, paramètres de compte, permissions, ou tout ce qui touche à la sécurité. Beaucoup d’apps mettent en cache la plupart des lectures mais contournent les chemins risqués.

Réevalider convient quand vous voulez vitesse et fraîcheur. Vous servez la valeur mise en cache, mais vous avez aussi une règle pour détecter quand elle est périmée (comme un updated_at ou une version). Si elle est obsolète, vous la rafraîchissez en arrière-plan ou sur la prochaine requête.

Le triangle des compromis : vitesse, coût, exactitude

Chaque décision de cache implique un compromis :

- Vitesse : rapidité de la réponse

- Coût : charge de calcul, requêtes DB, churn du cache

- Exactitude : fréquence à laquelle les utilisateurs voient des données périmées

Supprimer et réévaluer améliorent généralement l’exactitude, mais ajoutent du travail d’implémentation. Les TTL courts sont simples, mais augmentent le coût (plus de cache misses) et laissent toujours place à des lectures périmées.

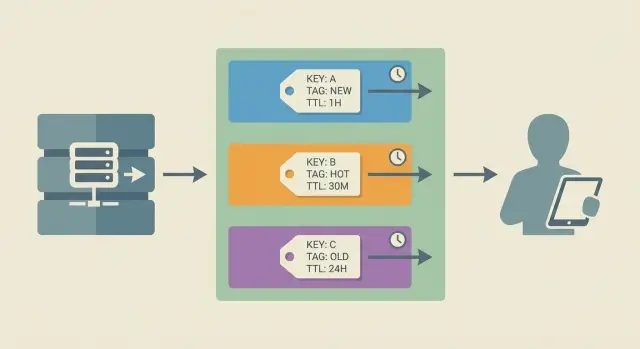

Un modèle utile est clés, groupes et temps :

- Clés : les noms exacts sous lesquels vous stockez et récupérez (par ex.

product:123). - Groupes : moyens d’invalider de nombreuses clés liées (souvent via le tagging).

- Temps : durée de vie (TTL) avant qu’une entrée soit considérée comme vieille.

La plupart des architectures solides combinent ces éléments. Pour des données qui changent rapidement, vous pouvez utiliser des clés versionnées (clés), du tagging (groupes) et des TTL courts (temps) pour rester rapide sans servir la vérité d’hier.

Étapes : choisir une approche d’invalidation pour vos données

Choisir la bonne stratégie commence par comprendre comment les données traversent concrètement votre application. Sans ça, vous finirez par nettoyer les mauvaises choses (ou rien du tout) et les utilisateurs verront encore des résultats anciens.

Étape 1 : Dessinez le chemin de lecture (ce qui est mis en cache, où et par qui)

Notez le parcours complet pour une lecture courante. Commencez par l’action utilisateur et remontez jusqu’à la base de données. Notez chaque cache sur le chemin (navigateur, CDN, couche API, Redis, cache en mémoire). Indiquez à quoi ressemble la clé et ce que contient la réponse.

Beaucoup de bugs de « données périmées » sont en réalité des bugs de « bonne forme de cache », comme mettre en cache une page entière qui inclut des données spécifiques à un utilisateur.

Étape 2 : Listez les écritures qui doivent changer la réponse

Listez les événements qui rendent la réponse mise en cache obsolète. Pensez au-delà de « éditer un enregistrement » : imports, jobs en arrière-plan, remboursements, changements de statut, outils admin et webhooks tiers mettent souvent à jour des données sans passer par le même chemin principal.

Étapes 3–5 : Choisissez le déclencheur, le périmètre et votre filet de sécurité

Checklist pour associer l’approche au risque :

- Choisissez le déclencheur : invalider à l’écriture (immédiat), utiliser l’expiration temps (éventuel), ou combiner les deux.

- Choisissez le périmètre : effacer un seul élément, un groupe, ou tout (rarement recommandé).

- Décidez comment cibler les entrées : clés prévisibles, clés versionnées, ou tagging.

- Ajoutez un filet de sécurité en cas d’échec d’invalidation : un TTL conservateur, une re-vérification contre la source de vérité, ou une vérification de fraîcheur.

- Journalisez : enregistrez quand l’invalidation se produit et combien de clés ont été affectées.

Ex. : si une mise à jour produit modifie la page produit et les listes de catégorie, la suppression d’une seule clé ne suffit pas. Le tagging de groupe ou les clés versionnées conviennent mieux.

Clés versionnées : arrêter de servir d’anciennes données en changeant la clé

Les clés versionnées sont une idée simple et robuste. Plutôt que d’essayer de supprimer l’ancienne valeur mise en cache, on change la clé quand les données changent. Nouvelle clé = nouvelle valeur. L’ancienne entrée peut rester jusqu’à expiration.

Un schéma basique :

user:123:v17 -> JSON mis en cache pour l’utilisateur 123

Quand l’utilisateur est mis à jour, incrémentez la version à v18. Chaque lecture rate maintenant l’ancienne entrée et remplit une nouvelle.

D’où peut venir la version

Choisissez une source de version facile à récupérer en lecture et difficile à fausser :

- Nombre monotone croissant (meilleur pour l’exactitude) : stockez

user_versionen base et incrémentez à l’écriture. - Timestamp

updated_at(simple) : incluez un timestamp normalisé comme20260116T1030Z. - Hash du contenu (précis mais plus lourd) : hashez l’enregistrement sérialisé ou un sous-ensemble de champs.

Les versions monotones sont généralement les plus fiables, car les timestamps peuvent poser des problèmes d’arrondi et d’horloge.

Gérer les clés liées (quand un changement affecte de nombreuses réponses)

La partie délicate n’est pas l’objet seul, mais tout ce qui est construit à partir de lui : user:123:profile_page, user:123:dashboard_summary, team:9:members.

Une approche pratique est d’utiliser une « version d’ancrage » partagée pour l’objet qui se propage. Par exemple, chaque réponse dépendante de l’utilisateur 123 inclut user:123:v{user_version} dans sa clé. Quand l’utilisateur change, toutes ces clés changent ensemble, sans deviner quelles clés existaient.

Avantages : pas de suppressions massives, sûr en concurrence, fonctionne bien pour le caching CDN et les objets majoritairement immuables.

Inconvénients : le cache peut gonfler (anciennes versions persistent), donc il faut des TTL et un nettoyage occasionnel si l’espace est limité.

Tagging : invalider des groupes sans deviner les clés

Le tagging est simple : quand vous écrivez dans le cache, vous attachez un ou plusieurs tags. Plus tard, quand les données sous-jacentes changent, vous purgez par tag (par ex. « supprimer tout ce qui a le tag product:123 ») au lieu d’essayer de retenir chaque clé possible qui pourrait inclure ce produit.

Cela colle bien au comportement des apps. Une mise à jour affecte souvent de nombreuses réponses mises en cache : une page produit, un résultat de recherche, un widget « articles liés », et peut‑être un payload API mobile. Le tagging permet de tout effacer d’un coup.

Un bon design de tags est ennuyeux et prévisible. Commencez par des tags qui reflètent vos objets métiers et la façon dont les utilisateurs les consultent :

- par utilisateur :

user:42 - par compte/équipe :

account:9 - par produit :

product:123 - par collection/liste :

category:shoesoucollection:summer-2026 - par rôle de permission :

role:admin

Faites attention à ne pas sur-taguer. Si chaque entrée reçoit 10 tags « au cas où », l’invalidation devient coûteuse et risquée. Le pire est une purge en éventail où un seul changement efface des milliers de clés et déclenche une horde de recomputations. Une bonne règle : taggez seulement par les données qui changent vraiment la sortie.

L’autre difficulté est la tenue des comptes : il faut un moyen sûr de mapper tags -> clés en cache (ou utiliser un index de tags natif au cache). Des approches courantes : garder un petit index de tags avec son propre TTL, limiter la taille de l’index par tag, et considérer les entrées manquantes comme normales tandis que le TTL s’occupe du nettoyage.

Exemple concret : si le produit 123 est mis à jour, vous purgez product:123 et category:shoes. Cela nettoie les caches de détail produit et la page de catégorie sans connaître si la clé était productPage:123:en ou v2:mobile:product:123.

TTL courts et rafraîchissement contrôlé

Le TTL court est la façon la plus simple de réduire la staleness : laissez les entrées expirer vite pour que l’obsolescence maximale soit limitée. C’est un filet de sécurité, pas un plan complet. Si les données changent à des moments imprévisibles, un TTL seul continue de servir d’anciennes valeurs jusqu’à l’expiration.

Les TTL excellent quand vous tolérez un léger retard et que l’objectif principal est la rapidité sous charge. Ils échouent quand une mise à jour doit être visible immédiatement (prix pendant un checkout, permissions, statut de compte).

Le rafraîchissement contrôlé aide à garder la rapidité sans faire payer l’utilisateur pour les cache misses. Deux approches communes :

- Rafraîchir en arrière-plan : servir la valeur en cache et, si elle approche de l’expiration (ou vient d’expirer), déclencher un rafraîchissement asynchrone.

- Rafraîchir à la prochaine requête : la première requête après l’expiration reconstruit les données, pendant que les autres attendent ou réutilisent brièvement l’ancienne valeur.

Les deux fonctionnent mieux avec du jitter. Si toutes les clés expirent exactement à 60 secondes, on peut avoir une vague d’expirations simultanées qui provoque un pic d’appels DB. Le jitter randomise le TTL (ex. 45 à 75 secondes) : la fraîcheur reste similaire, mais les expirations s’étalent.

Un autre risque majeur est la horde (thundering herd) : de nombreuses requêtes frappent la même clé expirée et toutes essaient de la reconstruire. Évitez cela avec la coalescence des requêtes (single-flight) : n’autorisez qu’un seul rafraîchissement par clé à la fois, et laissez les autres requêtes attendre le résultat ou accepter une donnée légèrement périmée pendant une courte fenêtre.

Un modèle simple :

- Si une clé est fraîche, retournez-la.

- Si elle est périmée, laissez une requête la recomputare.

- Les autres attendent brièvement ou réutilisent la valeur périmée dans une petite fenêtre de grâce.

Le TTL seul peut suffire quand la correction éventuelle est acceptable : tableaux analytiques, fils d’activité, suggestions de recherche et contenu en lecture majoritairement mis à jour par lots.

Exemple : prix et inventaire qui changent chaque minute

Imaginez une boutique en ligne pendant une vente flash. Les prix changent au démarrage et à la fin des promos, et l’inventaire baisse à chaque checkout. Si votre cache est même un peu faux, les clients voient « en stock » alors que ce n’est plus le cas, ou un total de panier qui ne correspond pas à la page de paiement.

Les équipes mettent souvent en cache des réponses coûteuses à construire : fiche produit, pages de catégorie, résultats de recherche et totaux de panier. L’objectif est de combiner quelques patterns d’invalidation pour ne pas avoir à deviner chaque clé.

Un mélange pratique qui fonctionne

- Utilisez des clés de cache versionnées pour l’enregistrement de « vérité » de chaque produit, ex.

product:{id}:v{productVersion}oùproductVersions’incrémente quand le prix ou l’inventaire change. - Utilisez le tagging pour les pages qui incluent plusieurs produits, comme les grilles de catégorie. Taggez la page catégorie avec

category:{categoryId}et aussi avec des tags pour les produits affichés (product:{id}), afin qu’une mise à jour produit invalide toutes les pages qui l’affichaient. - Utilisez des TTL courts pour les résultats de recherche. Les requêtes de recherche sont trop nombreuses pour être bien taggées, et les résultats changent constamment. Un TTL de 10 à 30 secondes avec rafraîchissement contrôlé (reconstruire en arrière-plan à l’expiration) bat souvent la tentative d’invalidation de chaque requête possible.

Scénario : une mise à jour d’inventaire

Un client achète la dernière unité du produit 42. Votre système écrit le nouvel inventaire en base et incrémente productVersion pour le 42.

Ce qui doit se produire ensuite :

- Les requêtes pour le produit 42 utilisent la nouvelle clé versionnée, donc l’ancien payload « en stock » ne peut plus être servi.

- La page de catégorie qui incluait le produit 42 est invalidée via le tag

product:42, même si vous ne connaissez pas sa clé exacte. - Les résultats de recherche peuvent encore afficher le produit 42 quelques secondes, mais le TTL limite la dérive et le prochain rafraîchissement corrige l’affichage.

Mode d’échec sans ce mélange : vous ne purgez que la fiche produit, tandis que catégorie et recherche continuent d’afficher « en stock », et les totaux de panier restent mis en cache trop longtemps.

Erreurs communes et pièges à éviter

La plupart des bugs de cache ne sont pas « le cache est cassé ». Ce sont de petits choix de conception qui rendent les mises à jour difficiles à raisonner.

S’appuyer uniquement sur des TTL courts pour des données critiques est un piège courant. Les TTL conviennent pour un flux d’accueil, mais sont dangereux pour la facturation, les permissions, le statut de compte, ou tout ce qui peut verrouiller quelqu’un ou le facturer. Si la donnée doit être correcte immédiatement, utilisez un signal d’invalidation (clés versionnées ou tags), pas « attendre une minute et ça ira ».

Autre erreur : invalider trop largement. Purger tout à chaque mise à jour semble sûr, mais provoque des embouteillages, des pics de charge DB et des pages plus lentes pour tout le monde. Cela masque aussi le vrai problème : vous ne savez pas quelles clés doivent changer.

Les gens oublient aussi les caches dérivés. Vous pouvez invalider l’élément lui‑même, mais laisser des listes, comptes, agrégats et résultats de recherche qui en dépendent. Exemple : vous mettez à jour un prix produit, vous supprimez product:123, mais vous oubliez category:shoes:page1, top-deals, et search:shoes:sort=price. Les utilisateurs voient toujours l’ancien chiffre.

Faites attention au mélange cache partagé vs spécifique utilisateur. Si une clé n’inclut pas l’utilisateur (ou le tenant) alors qu’elle devrait, vous pouvez divulguer des données privées. Cela arrive souvent sur les pages « mes commandes », les feature flags et les réponses avec vérification de permission.

Enfin, ne négligez pas la journalisation. Sans trace de qui a invalidé quoi, les bugs sont difficiles à reproduire.

Liste de sécurité simple :

- N’utilisez pas uniquement des TTL pour l’argent, l’auth ou les permissions.

- Invalidez de façon ciblée (par tag ou par version), pas par purge globale.

- Cartographiez et nettoyez les vues dérivées (listes, agrégats, recherche).

- Séparez clairement les caches partagés et utilisateurs avec des règles de clés précises.

- Journalisez les événements d’invalidation et surveillez les misses pendant les mises à jour.

Checklist rapide et prochaines étapes

Quand les données changent souvent, l’objectif n’est pas « jamais périmé », mais « périmé uniquement là où c’est acceptable, et jamais là où ça pose problème. » Écrivez des règles de fraîcheur par endpoint, pas une règle vague pour toute l’app.

Vérifications rapides avant déploiement

- Marquez chaque réponse comme doit être correcte vs peut être légèrement périmée (avec une durée max comme 5s, 30s, 2m).

- Pour chaque écriture (create/update/delete), confirmez qu’il existe une invalidation, une purge par tag, ou une incrémentation de version correspondante.

- Passez en revue les clés de cache pour dimensions manquantes : id utilisateur ou compte, rôle/plan, locale/devise, device, filtres/sort/page, et preview vs live.

- Ajoutez des métriques basiques : hit rate, taux de valeurs périmées (à quelle fréquence on sert de l’ancien), et compte d’invalidation.

- Testez un scénario « mauvaise journée » : mises à jour rapides, retries, utilisateurs concurrents. Assurez-vous de ne jamais afficher les données d’un utilisateur à un autre.

Prochaines étapes qui rapportent souvent

Choisissez une zone à fort impact (tarification, inventaire, permissions) et rendez-la ennuyeuse : règles de clés claires, une méthode d’invalidation principale, et un petit test prouvant que les mises à jour apparaissent comme prévu.

Si vous avez hérité d’une app générée par IA, les problèmes de données périmées vont souvent de pair avec des blocages de production comme des vérifications d’auth incohérentes et une logique difficile à suivre. Si vous avez besoin d’aide pour démêler tout ça, FixMyMess (fixmymess.ai) se concentre sur le diagnostic et la réparation de bases de code générées par IA, y compris le caching et les chemins d’invalidation, pour rendre le comportement de production prévisible.

Questions Fréquentes

What does stale cache actually look like to users?

Le cache obsolète, c’est quand votre application renvoie une réponse ancienne alors que les données sous-jacentes ont changé. Les utilisateurs le perçoivent comme des contradictions : un total de panier qui ne correspond pas à la page de paiement, une mise à jour de profil qui « s’enregistre » puis revient en arrière, ou un produit affiché « en stock » juste avant l’échec d’une commande.

How do I decide how fresh my data needs to be?

Commencez par définir un budget de fraîcheur pour chaque jeu de données, par exemple « doit être correct à chaque requête » ou « peut avoir jusqu’à 30 secondes de retard ». Servez-vous des conséquences pour guider la règle : l’argent, l’authentification et les permissions nécessitent généralement une exactitude immédiate, tandis que les récapitulatifs d’analytique peuvent tolérer un délai.

When should I use delete vs TTL vs bypass vs revalidate?

Utilisez l’invalidation explicite (suppression) quand vous pouvez détecter fiablement les écritures et que le périmètre est clair. Choisissez un TTL court quand un léger retard est acceptable et que les mises à jour sont fréquentes ou difficiles à suivre. Bypass (contourner le cache) quand la précision prime sur la vitesse (checkout, permissions). Revalidate quand vous voulez la vitesse la plupart du temps mais avoir une règle pour actualiser la source si besoin.

What are versioned cache keys, and why do they prevent stale reads?

Les clés versionnées fonctionnent en changeant la clé de cache quand les données changent, ainsi les anciennes entrées ne peuvent plus être retournées par erreur. Exemple courant : user:123:v18, où la version s’incrémente à chaque écriture pertinente. Cela réduit les conditions de concurrence et les oublis d’invalidation, tant qu’on conserve aussi un TTL pour éviter l’accumulation d’anciennes versions.

How does cache tagging help when one update affects many pages?

Le tagging vous permet d’invalider des groupes de réponses mises en cache sans connaître chaque nom de clé. On attache des tags comme product:123 ou category:shoes lors de la mise en cache, puis on purge par tag quand un produit ou une catégorie change. Utile quand une modification affecte de nombreuses pages, widgets ou payloads API.

How do I use short TTLs without causing traffic spikes or slow pages?

Employez les TTL courts comme filet de sécurité pour des données tolérant un léger retard, puis ajoutez un rafraîchissement contrôlé pour éviter que les utilisateurs subissent le coût des miss. Ajoutez du jitter pour éviter que beaucoup de clés n’expirent exactement en même seconde, et utilisez le single-flight (coalescence des requêtes) pour qu’une seule requête reconstruise la clé expirée pendant que les autres attendent ou réutilisent une valeur légèrement périmée sur une courte fenêtre.

Why does refreshing the page sometimes still show the wrong data?

Parce que « la page » est souvent une pile de caches : navigateur, CDN, couche API, caches en mémoire. On peut rafraîchir et toujours voir l’ancienne réponse si une des couches sert encore une réponse API obsolète ou un fragment HTML rendu. La solution est de cartographier tout le chemin de lecture et de s’assurer que l’invalidation couvre chaque couche susceptible de servir ces données.

What are “derived caches,” and why do they keep stale data around?

Les caches dérivés incluent listes, comptes, agrégats, résultats de recherche et blocs « recommandés » construits à partir d’autres objets. Un bug courant : purger product:123 mais oublier les grilles de catégorie, les « top deals » ou le total du panier qui contient encore l’ancien prix. Planifiez l’invalidation autour de ce que voit l’utilisateur, pas seulement autour de la ligne de la base de données modifiée.

How do I avoid caching user-specific data the wrong way?

Si votre clé de cache n’inclut pas les bonnes dimensions, des entrées partagées peuvent fuiter ou mélanger les données entre utilisateurs ou tenants. Cela arrive souvent pour « mes commandes », les réponses basées sur rôle, les feature flags, la locale/devise, ou l’accès selon le plan. Par défaut, incluez l’identifiant utilisateur ou compte quand la sortie peut varier, et contournez le cache pour les endpoints sensibles si vous n’êtes pas sûr.

What should I do if an AI-generated app keeps drifting in production due to caching?

Commencez par journaliser les événements d’invalidation et suivre les moments où des valeurs obsolètes sont servies, pas seulement le hit rate. Dans une app prototype générée par IA, les problèmes de données périmées s’accompagnent souvent de failles d’auth, de logique confuse et de chemins d’écriture cachés (webhooks, jobs). Pour une correction rapide et vérifiable, FixMyMess (fixmymess.ai) peut réaliser un audit gratuit puis réparer les chemins d’invalidation pour rendre le comportement de production prévisible.