Pourquoi une « petite correction » prend plus de temps qu'une nouvelle fonctionnalité dans le code IA

Découvrez pourquoi de petites corrections prennent plus de temps que de nouvelles fonctionnalités dans le code généré par l'IA, avec des exemples simples de couplage caché, d'absence de garde-fous et comment cadrer honnêtement la portée.

Pourquoi une « petite correction » peut devenir un gros chantier

Les équipes rencontrent la même surprise avec des prototypes construits par l'IA : quelqu'un montre l'écran et dit « C'est juste un petit ajustement. Dix minutes. » Puis la correction prend une demi-journée (ou quelques jours), et le calendrier commence à sembler aléatoire.

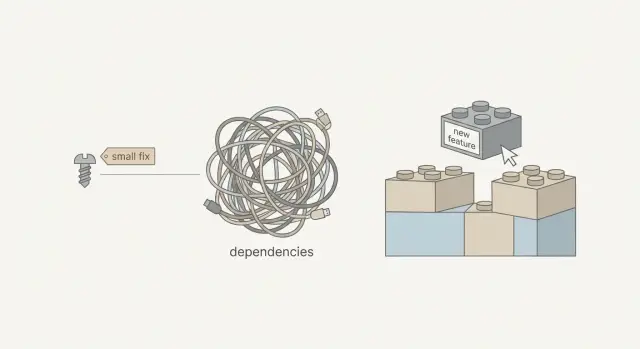

Quand les gens disent « petite correction », ils veulent généralement dire : changer une chose à un endroit, avec peu de risques et des tests rapides.

Dans le code réel, « petit » cache souvent du travail supplémentaire :

- Le « une chose » est utilisée dans plusieurs fichiers, écrans ou services.

- Le changement touche des données qui doivent être enregistrées, chargées, validées et affichées.

- Il n'y a pas de tests, donc il faut tout vérifier manuellement.

- La correction la plus sûre inclut de nettoyer des problèmes voisins que vous n'aviez pas prévu de toucher.

Ce décalage explique pourquoi les corrections de bugs peuvent prendre plus de temps que l'ajout d'une nouvelle fonctionnalité. Les nouvelles fonctionnalités peuvent souvent être ajoutées en bordure de l'application. Les corrections doivent intervenir sur des chemins dont les utilisateurs dépendent déjà, ce qui signifie plus de soin et plus de vérification.

Deux causes reviennent souvent : le couplage caché et l'absence de garde-fous.

Le couplage caché signifie que des parties de l'app dépendent les unes des autres d'une manière que l'on ne voit pas depuis l'interface. Un « rename » peut dépendre en silence d'une colonne de base de données, d'un validateur, d'une règle de connexion et d'une requête de dashboard, maintenus ensemble par du code copié.

L'absence de garde-fous signifie que le prototype a sauté des protections qui rendent les changements sûrs : gestion d'erreurs claire, valeurs par défaut sensées, vérifications des entrées et tests automatisés basiques. Sans eux, une petite modification peut créer un bug ailleurs.

L'idée n'est pas de faire peur aux corrections. C'est de rendre la portée et les délais raisonnables. Quand vous pouvez pointer le couplage et l'absence de garde-fous, le travail cesse d'avoir l'air arbitraire et devient une enquête, un nettoyage et des tests soigneux.

Le couplage caché, expliqué sans jargon

Le couplage est simple : deux parties de l'app dépendent l'une de l'autre. Si vous changez une partie, l'autre peut casser. Un certain couplage est normal. Ça devient un problème quand les connexions sont serrées, obscures et dispersées.

Le couplage caché, c'est quand ces connexions ne sont pas évidentes depuis ce que vous voyez à l'écran. Un bouton a l'air d'être « juste de l'UI », mais il affecte la connexion, la facturation, les emails ou les règles de base de données parce que tout est relié en coulisse.

Imaginez un mur de briques où une brique soutient aussi une étagère, une lampe et un tuyau. De l'extérieur, on voit une seule brique. En la retirant, trois autres choses bougent. La réparation n'est pas impossible ; elle prend juste du temps car il faut trouver ce que la brique soutient aussi.

Les prototypes générés par l'IA ont souvent plus de couplage caché parce que le code est créé rapidement et réutilisé par copie. Au lieu d'un endroit clair qui définit « les règles d'inscription », vous obtenez plusieurs versions légèrement différentes. Corriger un bug à un endroit peut en laisser deux autres encore cassés, ou créer un décalage entre les flux.

Quelques signes que vous avez du couplage caché :

- La même logique apparaît dans plusieurs fichiers avec de petites différences.

- Une variable partagée (état global) est utilisée partout, donc les changements se répercutent.

- Les frontières sont floues (le code UI modifie directement des données de la base).

- Une correction fonctionne dans un flux mais casse un autre flux qui « ne devrait pas être lié ».

- Le code est plein de rustines rapides, comme des if supplémentaires pour couvrir des cas limites.

Quand c'est la réalité, une « petite correction » n'est pas un seul edit. C'est : trouver les connexions cachées, les modifier en sécurité, puis revérifier les flux qui s'appuyaient en silence sur l'ancien comportement.

Absence de garde-fous : ce que les prototypes sautent

Les garde-fous sont les rambardes du logiciel. Ils n'ajoutent pas de boutons ou de fonctionnalités tape-à-l'œil, mais ils empêchent les petites modifications de se transformer en pannes surprenantes.

Les prototypes les sautent souvent parce que l'objectif est la rapidité : obtenir une démo qui marche. Le coût apparaît plus tard, quand l'app rencontre de vrais utilisateurs, de vraies données et des cas limites.

Les garde-fous courants incluent :

- Des vérifications automatisées pour les flux clés (inscription, paiements, enregistrement de données)

- Des formes de données claires (pour que le code ne transmette pas silencieusement une mauvaise valeur)

- La validation des entrées (pour que des données sales ne fassent pas planter l'app)

- Des contrôles de permissions (pour que les utilisateurs n'accèdent pas à ce qu'ils ne devraient pas)

- Une gestion sûre des échecs (timeouts, enregistrements manquants, états vides)

Sans ça, chaque changement devient un jeu de devinettes. Vous pouvez corriger ce que vous voyez, mais vous ne pouvez pas être sûr de ce que vous ne voyez pas.

Exemple : vous rendez le champ « téléphone » optionnel pour réduire la friction à l'inscription. Le backend suppose toujours que le téléphone est présent. Maintenant l'app plante seulement pour certains utilisateurs, et seulement après qu'ils atteignent une étape suivante. La « petite correction » devient la traque de l'hypothèse, l'ajout de vérifications et la preuve que c'est corrigé pour de bon.

Les garde-fous coûtent du temps au départ, donc les équipes les ajoutent plus tard. Ils semblent « superflus » jusqu'au premier bug en production. Avec la réparation de code généré par l'IA, une approche pratique est souvent : corriger le problème immédiat, puis ajouter le plus petit garde-fou autour pour éviter que la même classe de bug ne revienne la semaine suivante.

Pourquoi le code généré par l'IA rend les « petites » corrections plus risquées

Les outils d'IA peuvent vous mener rapidement à une démo. L'inconvénient est que le code gère souvent seulement le chemin heureux : la séquence de clics que l'outil a « imaginée » lors de sa génération. Une petite modification peut pousser les utilisateurs sur des chemins qui n'ont jamais été testés.

Le code généré par l'IA peut aussi sembler plus fini qu'il ne l'est. Les écrans paraissent polis, il y a beaucoup de fichiers, et ça donne l'impression d'être « réel ». En dessous, il peut y avoir des hypothèses fragiles comme « cette valeur est toujours présente » ou « cette API renvoie toujours la même forme ». Quand votre changement casse cette hypothèse, l'app échoue ailleurs et vous partez à la chasse à une réaction en chaîne.

La logique copiée-collée est un autre problème courant. « Changer la règle de validation » n'est pas un seul edit si cette logique existe à cinq endroits. Si vous en manquez une copie, les utilisateurs obtiennent un comportement incohérent qui peut mettre des jours à être remarqué.

Vous voyez aussi souvent un flux de données peu clair : la même donnée est transformée plusieurs fois, de façons différentes, avant d'atteindre la base ou l'UI. Ça rend la délimitation difficile parce qu'on ne sait pas où est la source de vérité tant qu'on ne l'a pas tracée.

Demandes typiques de « petite correction » qui s'élargissent en réparations plus longues :

- Sauvegarder un nouveau champ, alors que l'app a deux modèles différents pour le même objet.

- Un ajustement d'UI change le timing et révèle une condition de concurrence.

- Un nettoyage révèle des secrets exposés ou des contrôles de permissions manquants.

- Un cas limite apparaît (état vide, réseau lent) et les erreurs ne sont pas gérées.

- Un changement touche l'auth et la connexion casse entre sessions, redirections et callbacks.

Un exemple concret : « Exiger le numéro de téléphone à l'inscription. » Ça peut signifier mettre à jour le formulaire, la validation, le schéma de base de données, les emails ou les étapes d'onboarding, et s'assurer que les utilisateurs existants ne sont pas bloqués. Sans tests et sans gestion d'erreurs claire, chaque étape doit être vérifiée à la main.

Si vous traitez du code généré par des outils comme Lovable, Bolt, v0, Cursor ou Replit, le chemin le plus rapide est souvent : trouver d'abord les hypothèses, corriger la cause racine une fois, et éviter de panser le même symptôme à plusieurs endroits.

Comment cadrer une « petite correction » étape par étape

Quand quelqu'un dit « c'est une petite correction », il imagine une ligne de code. Dans des projets en désordre, une seule demande peut toucher l'UI, l'API, la base de données et l'auth.

Un flux de cadrage pratique

Rendez le problème reproductible. Si vous ne pouvez pas le déclencher à la demande, vous ne pouvez pas l'estimer. Notez les clics exacts, les entrées et le résultat attendu, plus ce que vous voyez réellement.

Faites ensuite un rapide passage « où ça vit ». Beaucoup de bugs semblent être un problème d'UI mais sont en réalité des règles backend, des données de base, ou des cas d'auth.

Une checklist simple souvent suffisante :

- Reproduisez-le deux fois et capturez les étapes exactes (et tout message d'erreur).

- Décidez quelle couche possède le comportement : frontend, backend, base de données, auth ou tiers.

- Tracez les données de bout en bout : où elles commencent, comment elles changent et où elles finissent.

Une fois que vous voyez le flux de données, listez les points de contact : composants partagés, endpoints réutilisés, contraintes de base de données, état de connexion, cache et handlers de webhook.

Avant de changer le comportement, ajoutez un petit garde-fou. Ça peut être un tout petit test, une assertion, ou même un log qui prouve que vous corrigez la bonne chose. Cette étape souvent empêche un « patch rapide » de devenir une deuxième urgence.

Puis faites le travail et vérifiez les flux voisins qui cassent souvent : inscription, connexion, paiements, emails et actions admin. Enfin, notez ce qui a changé et ce que vous avez vérifié pour que la prochaine correction soit plus rapide.

À quoi ressemble une « portée équitable »

Une portée défendable n'est pas juste « corriger le bug ». C'est :

- des étapes pour reproduire

- la couche propriétaire

- les points de contact affectés

- le garde-fou que vous allez ajouter

- les vérifications de régression que vous ferez

- une courte note de ce qui a été confirmé

Cela vous donne un délai que vous pouvez expliquer et défendre.

Un exemple réaliste : un ajustement d'UI qui casse l'inscription

Un fondateur demande un petit changement : « Sur le formulaire d'inscription, renommer le libellé Company en Business name. » Ça ressemble à une édition UI de cinq minutes. Puis l'inscription commence à échouer.

Voici le piège : le frontend n'a pas seulement changé le libellé. Il a aussi changé le nom du champ de company à businessName. Le backend attend toujours company. Quand le formulaire est soumis, le serveur voit un champ requis manquant et rejette la requête.

La casse ne s'arrête souvent pas là. Une fois cette valeur manquante, vous pouvez avoir des effets en cascade comme une validation qui renvoie un générique « Something went wrong », des étapes d'onboarding qui plantent, des emails de bienvenue qui affichent des blancs comme « Hi , » et de l'analytics qui regroupe mal les utilisateurs.

C'est du couplage caché : une petite pièce est silencieusement dépendue par beaucoup d'autres. Dans les prototypes générés par l'IA, il est courant de trouver le même nom de champ réutilisé à plusieurs endroits : un composant de formulaire, un validateur de schéma, un handler d'API, une insertion en base, et un tracker analytics. Aucun de ces endroits n'annonce la dépendance.

L'absence de garde-fous aggrave la situation. S'il n'y a pas de tests d'inscription, personne ne remarque avant le déploiement, quand de vrais utilisateurs rencontrent le chemin cassé. Maintenant la « petite modification » inclut le débogage du comportement en production, l'analyse des logs et la confirmation des données écrites (ou non) en base.

Un plan qui garde ça sûr ressemble généralement à :

- Tracer le champ de bout en bout (UI, validation, API, base, tracking).

- Patch avec un contrat stable (conserver

company, ou mapperbusinessNameverscompany). - Ajouter un garde-fou simple (au moins un test ou un contrôle serveur avec une erreur claire).

- Vérifier le flux complet dans un environnement propre (nouvel utilisateur, onboarding, email, analytics).

- Déployer et surveiller brièvement pour détecter les surprises.

Erreurs qui font traîner les corrections

La plus grosse perte de temps est de traiter une correction comme si elle vivait à un seul endroit. Dans les prototypes construits par l'IA, le problème visible est souvent juste la dernière dominos tombée.

Un piège courant est de corriger le symptôme dans l'UI alors que la vraie cause se situe dans la gestion des données ou l'authentification. Un bouton peut sembler « cassé » parce que l'appel API échoue, mais la vraie issue est un rôle manquant, une session expirée, ou un enregistrement qui n'a jamais été sauvegardé correctement.

Les rustines rapides ajoutent aussi rapidement de la dette. Un cas spécial supplémentaire peut fonctionner aujourd'hui, mais il rend le changement de demain plus difficile. Vous vous retrouvez avec du code rempli d'exceptions que personne ne fait plus confiance.

Les patterns qui étendent généralement le travail plus que prévu :

- Tester seulement l'écran modifié, pas les flux liés comme onboarding, réinitialisation de mot de passe, facturation ou rôles admin.

- Changer l'apparence des données (noms de champs, types, champs requis) sans mettre à jour la validation et les migrations de base.

- Sauter les contrôles de sécurité parce que « ça marche en local », puis découvrir des secrets exposés, des contrôles d'auth faibles ou des entrées non sécurisées.

- Corriger un endpoint ou une requête sans vérifier où d'autre il est réutilisé.

- Ajouter une logique « temporaire » qui n'est jamais supprimée.

Une checklist avant de promettre un délai

Une correction reste petite quand tout le monde s'accorde sur ce qui est cassé, où c'est cassé, et ce que signifie « fini ».

Commencez par confirmer que le problème est reproductible. S'il n'apparaît que « parfois » ou seulement sur un poste, vous n'êtes pas prêt à promettre une date. Visez 2–3 étapes claires qui le déclenchent systématiquement.

Ensuite, soyez explicite sur la couche propriétaire. Le même symptôme peut venir de différents endroits : UI, API, base de données ou auth. « La connexion ne fonctionne pas » peut être un réglage de cookie, un check de session manquant, ou un enregistrement utilisateur qui n'a jamais été sauvegardé.

Avant que quiconque touche le code, mettez-vous d'accord sur un contrôle qui prouve la correction et l'attrapera si elle revient. Ça peut être un petit test automatisé, un script manuel reproductible, ou un log qui confirme que le bon chemin s'exécute.

Indiquez aussi les effets secondaires probables. Trois suffisent généralement pour garder la portée honnête :

- Si on change cette validation, cela peut-il bloquer l'inscription ?

- Si on ajuste cette requête, cela peut-il ralentir le dashboard ?

- Si on change les règles d'auth, cela peut-il déconnecter les utilisateurs existants ?

Enfin, décidez ce que signifie un rollback si la production part en vrille. Ça n'a pas besoin d'être sophistiqué, mais ça doit être réel : un revert rapide, un feature flag, ou un moyen sûr de restaurer le comportement précédent.

Si vous héritez de code généré par l'IA et que ces réponses sont difficiles à obtenir, incluez du temps de découverte dans l'estimation. Ce n'est pas du rembourrage ; c'est le travail nécessaire pour remplacer les suppositions par des preuves.

Comment expliquer la portée pour qu'elle paraisse juste

Quand quelqu'un demande une « petite correction », il imagine une modification rapide. Une portée équitable sépare le changement visible du travail nécessaire pour le rendre sûr.

Expliquez les inconnues comme des vérifications concrètes, pas des excuses. Par exemple : « Avant de changer le comportement du bouton, nous devons confirmer où ce comportement est défini, ce qui l'utilise et ce qui détectera une casse. » C'est de l'investigation, pas du retard.

Les timeboxes aident car elles créent un point de décision clair :

- Découverte : tracer où vit le changement, cartographier les dépendances, repérer les risques de sécurité

- Implémentation : faire le changement avec le moins d'impact possible

- Vérification : tester les flux utilisateurs clés et les cas limites risqués

Ensuite, définissez des critères d'acceptation en termes utilisateurs, pas en termes de code. « Corrigé » devrait signifier quelque chose d'observable :

- L'utilisateur peut se connecter, réaliser l'action et voir le bon résultat.

- Les flux clés ne génèrent pas de nouvelles erreurs (inscription, achat, pages admin).

- Les permissions fonctionnent toujours (les utilisateurs ne voient pas les données d'autres utilisateurs).

- Aucun secret n'est exposé et aucune faille de sécurité évidente n'a été introduite.

Quand vous avez le choix, présentez clairement : une correction minimale maintenant (plus rapide, plus de risques de régressions) ou une correction plus sûre qui ajoute des garde-fous comme validation, contrôles de permissions et tests de base.

Prochaines étapes si votre prototype IA vous résiste

Si chaque « petit changement » déclenche une autre casse, stoppez avant d'ajouter plus de fonctionnalités. Ce pattern signifie souvent que le code est emmêlé : tirez sur un fil et quelque chose d'autre se tend.

Décider : correction rapide, refactor ou reconstruction

Une « correction » devient un refactor quand le code a besoin d'être nettoyé juste pour rendre les changements sûrs. Surveillez des signes comme les bugs récurrents, une modification qui casse des écrans sans rapport (connexion, checkout, admin), la peur de toucher le code, des frontières floues et des bases de sécurité manquantes (secrets dans le code, auth faibles, appels base non sécurisés).

Parfois une reconstruction coûte moins cher que des rustines sans fin. Si chaque semaine apporte une nouvelle surprise ou si des problèmes de sécurité réapparaissent, reconstruire le flux central peut coûter moins que des mois de jeu du whack-a-mole.

Rassembler les bonnes informations avant de demander de l'aide

Vous pouvez gagner des heures en envoyant un « packet bug » clair plutôt qu'une demande vague :

- Accès au repo (ou un zip) et notes sur l'environnement (clés, services, où ça tourne)

- Étapes exactes pour reproduire, en partant d'une session fraîche

- Captures d'écran ou une courte vidéo

- Résultat attendu vs ce qui se passe

- Tout texte d'erreur observé (copier/coller)

Ajoutez une phrase sur ce qui a le plus changé récemment. Dans les projets générés par l'IA, cela pointe souvent directement vers le couplage caché.

Si vous voulez qu'une équipe extérieure regarde, FixMyMess (fixmymess.ai) commence par un diagnostic de la base de code et propose un audit gratuit pour les apps générées par l'IA. C'est une manière directe d'identifier ce qui est réellement lié à votre « petite modification » avant de vous engager sur un délai.

Questions Fréquentes

Pourquoi ma « modification de 10 minutes » a-t-elle pris une demi-journée ?

Une demande d'UI « petite » change souvent des noms de données, des règles de validation ou des payloads d'API en coulisses. Si cette valeur est utilisée à plusieurs endroits, il faut tous les mettre à jour puis revérifier les flux qui en dépendent.

Que veut dire « couplage caché » ?

Le couplage caché signifie que des parties de votre application dépendent les unes des autres d'une manière qui n'est pas évidente depuis l'écran. Vous changez une chose et quelque chose « d'inattendu » casse parce que la même logique ou les mêmes données sont partagées ailleurs sans le signaler.

Pourquoi le code généré par l'IA a-t-il plus de couplage caché ?

Les prototypes générés par l'IA ont souvent dupliqué la logique dans plusieurs fichiers au lieu d'avoir une source de vérité claire. Ça rend les comportements incohérents et vous force à retrouver chaque copie avant que la correction soit complète.

Que sont les « garde-fous » et pourquoi comptent-ils pour les petites modifications ?

Les garde-fous sont des protections basiques comme la validation des entrées, les contrôles de permissions, des messages d'erreur clairs et quelques tests automatisés pour les flux clés. Sans eux, chaque changement devient une enquête manuelle plus des vérifications supplémentaires pour éviter les régressions.

Quelle est la manière la plus rapide de rendre un bug « scopable » avant de coder ?

Demandez des étapes exactes pour reproduire depuis une session fraîche, le résultat attendu et ce qui se passe réellement (avec le texte d'erreur complet). Si on ne peut pas déclencher le bug à la demande, toute estimation n'est qu'une supposition.

Pourquoi renommer un champ de formulaire peut-il casser l'inscription ?

Un renommage peut changer la clé envoyée (par exemple company vers businessName), pas seulement l'étiquette. Si le backend ou la base de données attend encore l'ancienne clé, la requête échoue et des étapes en aval comme l'onboarding ou l'analytics peuvent aussi casser.

Pourquoi les corrections peuvent-elles prendre plus de temps que de créer une nouvelle fonctionnalité ?

Les nouvelles fonctionnalités peuvent parfois être ajoutées en bordure de l'application sans toucher au comportement existant. Les corrections de bugs, elles, interviennent sur des chemins déjà utilisés par des utilisateurs, donc elles nécessitent plus de traçage, d'attention et de vérifications de régression.

Comment déterminer si un bug vient du front, du back, de la base de données ou de l'auth ?

Identifiez la couche propriétaire : frontend, backend, base de données, auth ou service tiers. Puis suivez les données de bout en bout pour savoir où la valeur commence, comment elle change et où elle est utilisée.

Quel est le plus petit « garde-fou » à ajouter pendant une correction ?

Ajoutez la plus petite protection utile : un test ciblé pour le flux cassé, un contrôle côté serveur avec un message d'erreur clair, ou un log prouvant que le bon chemin s'exécute. Le but est d'empêcher le même type de bug de réapparaître la semaine suivante.

Quand faut-il refactorer plutôt que reconstruire un prototype généré par l'IA ?

Considérez une reconstruction quand les changements cassent régulièrement des écrans sans rapport, que les bases de sécurité manquent et que personne n'a confiance pour toucher le code. Si vous héritez d'une app générée par l'IA qui ne tient pas en production, FixMyMess peut diagnostiquer rapidement et aider à réparer ou reconstruire les flux critiques sur un calendrier prévisible.