Réduire les démarrages à froid des apps serverless en allégeant les bundles

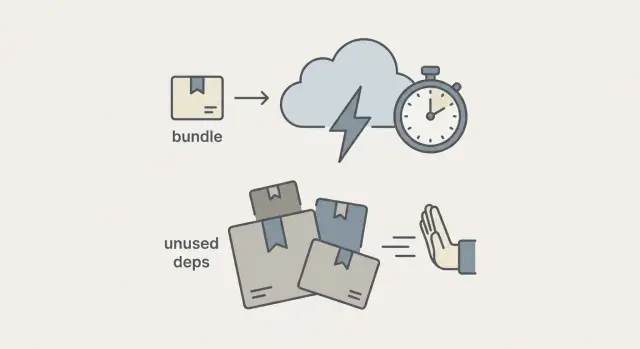

Réduisez les cold starts des apps serverless en identifiant les dépendances trop lourdes, en scindant les routes et en allégeant les builds pour diminuer les temps de réponse et les coûts cloud.

À quoi ressemblent les cold starts et le gonflement des bundles dans la vie réelle

Un cold start, c'est la pause gênante sur la première requête après qu'une fonction serverless est restée inactive. La page commence à charger, puis il ne se passe rien pendant un instant, puis tout s'anime. Ensuite, les requêtes suivantes sont rapides, ce qui rend la première lente encore plus sensible.

Le gonflement du bundle est une cause courante. Avant qu'une fonction puisse répondre, la plateforme doit récupérer votre code, le décompresser, le charger en mémoire et exécuter tout travail d'initialisation. Quand le paquet est volumineux, chacune de ces étapes prend plus de temps. Les utilisateurs perçoivent ce temps comme un lag.

Cela arrive souvent dans les applications serverless générées par IA. Les générateurs ont tendance à importer de grosses bibliothèques « au cas où », à copier des boilerplates pour plusieurs frameworks, ou à mélanger le code serveur et navigateur dans le même build. L'application fonctionne en démonstration, mais en production elle embarque beaucoup de poids inutilisé.

Ce que les gens remarquent habituellement :

- La première requête après quelques minutes d'inactivité est bien plus lente que les autres.

- Des endpoints simples (comme les health checks ou le login) semblent plus lourds qu'ils ne devraient.

- Les logs montrent une longue phase de chargement de modules avant que le vrai travail commence.

- Vous payez plus de temps de calcul alors que l'endpoint fait très peu.

L'angle coût est simple. Si une fonction passe 800 ms à se préparer, vous payez cet overhead à chaque cold start.

La bonne nouvelle : on peut souvent gagner beaucoup sans réécrire toute l'app. Beaucoup d'améliorations viennent d'un nettoyage basique : retirer les dépendances inutilisées, garder les fonctions plus petites et éviter des travaux coûteux au démarrage. Quand FixMyMess audite des prototypes générés par IA, nous trouvons souvent du « poids mort » sûr à supprimer tout en conservant les mêmes fonctionnalités et routes.

Pourquoi les apps serverless générées par IA démarrent souvent lentement

Au cold start, la plateforme lance un runtime neuf, charge votre code et exécute les travaux d'initialisation. Au warm start, ce runtime est déjà en place, donc la fonction répond beaucoup plus vite.

Le code serverless généré par IA aggrave souvent les cold starts parce qu'il embarque plus de code que nécessaire pour chaque requête. Les bundles plus volumineux prennent plus de temps à télécharger, décompresser et charger en mémoire. Les imports lourds ajoutent un second coût : beaucoup de bibliothèques exécutent du code d'initialisation dès leur chargement, même si vous n'utilisez qu'un petit utilitaire.

Quelques motifs reviennent souvent dans les prototypes générés par des outils comme Lovable, Bolt, v0, Cursor ou Replit :

- Un seul fichier « god » qui importe tout pour toutes les routes, même quand une route n'utilise que 10 % de ce code.

- D'immenses modules utilitaires partagés qui tirent de gros SDKs (clients cloud, email, PDF, traitement d'images) pour des endpoints simples.

- Des paquets installés « au cas où » qui ne sont jamais utilisés mais finissent dans le bundle.

- Des chaînes de ré-export (fichiers index) qui chargent accidentellement des dossiers entiers.

Les cold starts ne sont pas seulement une question de taille de code. Le travail d'initialisation à l'intérieur de la fonction peut être tout aussi coûteux. Les coupables classiques incluent l'ouverture de connexions à une base de données à chaque invocation, l'initialisation de bibliothèques d'auth avec des clés lourdes, et la construction de gros objets de config au moment de l'import.

Un exemple typique : un endpoint de login importe le SDK d'admin complet, se connecte à la base et construit une grande map de configuration avant même de vérifier la requête. Ce travail s'exécute au cold start même si la requête échoue rapidement.

C'est le genre de choses que FixMyMess trouve souvent lors d'un diagnostic de code : du code qui marche en démo, mais qui démarre lentement et coûte plus une fois déployé.

Mesurer d'abord pour ne pas chasser le mauvais problème

Avant de tenter de réduire les cold starts de vos apps serverless, clarifiez ce qui est réellement lent. Les projets générés par IA donnent souvent l'impression d'être « lents » pour trois raisons différentes : cold starts, travail lourd à chaque requête, ou appels base de données lents. Les corrections sont différentes, donc mesurer évite des refactors au pif.

Les quelques chiffres qu'il vaut la peine de suivre

Commencez avec des métriques simples à expliquer en une minute :

- Latence P50 et P95 (typique vs temps de réponse « mauvais jour ")

- Durée du cold start/init (temps passé à démarrer le runtime et charger le code)

- Taille du bundle déployé (ou taille du paquet) pour la fonction

- Configuration mémoire et durée (ceci influence le coût)

- Taux d'erreurs/timeouts (lent et qui échoue souvent ressemble aux yeux des utilisateurs)

Vous n'avez pas besoin d'outillage sophistiqué pour repérer les cold starts. La plupart des plateformes serverless loggent quelque chose qui signale une « première exécution », comme une phase d'init ou une première requête beaucoup plus longue suivie de requêtes plus rapides. Si les logs montrent une étape de démarrage, comparez ce temps au temps total de la requête. Quand l'init représente une grosse part du total, le gonflement du bundle et le travail d'init sont probablement en cause.

Construire une baseline simple et répétable

Choisissez un endpoint qui représente le trafic réel (ou créez-en un léger comme un health ou un route « whoami ») et testez-le de la même façon à chaque fois.

Utilisez une seule région et un seul environnement (staging ou prod), envoyez 20–50 requêtes, attendez assez longtemps pour que la fonction redevienne inactive, puis envoyez 5 requêtes supplémentaires et enregistrez la première séparément. Répétez 2–3 fois à différents moments de la journée.

Fixez un objectif pour savoir quand arrêter. Par exemple : « Première réponse sous 800 ms au P95, requêtes chaudes sous 200 ms, sans augmentation de coût. » Quand FixMyMess audite du code serverless généré par IA, cette baseline garde le travail ciblé : on corrige d'abord le chemin le plus lent, pas la supposition la plus bruyante.

Trouver les dépendances surdimensionnées et le code inutilisé

Pour réduire les cold starts dans les apps serverless, commencez par ce que votre fonction doit charger avant de répondre. Dans le code généré par IA, il est courant de voir une longue liste de dépendances, plus des paquets « au cas où » qui ne sont jamais utilisés.

Une manière rapide de repérer les plus gros coupables est de générer un rapport de taille pendant votre build. La plupart des bundlers peuvent faire cela sans changer la logique de l'app.

# Find unused dependencies (often surprisingly accurate)

npx depcheck

# Understand why a heavy package is installed (directly or transitively)

npm ls <package>

npm explain <package>

Après avoir une courte liste de gros paquets, cherchez les recouvrements. Beaucoup de projets expédient par accident plusieurs outils qui font le même travail, comme deux librairies de dates, deux clients HTTP, ou plusieurs librairies de validation. Chacune ajoute du code, et certaines tirent derrière elles de gros paquets utilitaires.

Duplications courantes à vérifier :

- Plusieurs librairies date/heure (plus des add-ons de fuseaux horaires)

- Plus d'un client HTTP (et des polyfills ou libs de retry séparés)

- Plusieurs librairies utilitaires qui se chevauchent (manipulation de chaînes, tableaux, deep clone)

- Deux ou plusieurs SDKs de logging/monitoring chargés dans la même fonction

- Versions « full » et « lite » du même paquet

Surveillez aussi les dépendances transives lourdes. Des paquets de confort peuvent apporter silencieusement beaucoup de code non désiré. Quand vous lancez npm explain <package>, vous pouvez découvrir qu'un petit wrapper importe une pile complète orientée browser, un énorme bundle de localisation, ou une librairie crypto inutile côté serveur.

Décidez quoi faire pour chaque grosse dépendance :

- Supprimez-la si rien ne l'appelle.

- Remplacez-la par une option plus légère si vous n'utilisez qu'une ou deux fonctionnalités.

- Sortez-la du chemin chaud si elle n'est nécessaire que pour des routes rares (par ex. génération de PDF, traitement d'images, exports de données).

- Chargez-la paresseusement à l'intérieur du handler si elle n'est pas nécessaire à chaque requête.

Exemple : une API serverless générée par IA peut importer le SDK admin au début de chaque route « par commodité », alors que seul l'endpoint de facturation en a besoin. Cet import unique peut ralentir le démarrage de toute l'API.

Si vous héritez d'un graphe de dépendances en pagaille et qu'il est difficile de dire ce qui est sûr à enlever, FixMyMess peut auditer le code et pointer quelles bibliothèques causent du bloat, lesquelles sont du poids mort, et lesquelles doivent rester pour la sécurité en production.

Scinder les routes et fonctions pour alléger le démarrage

Une raison fréquente pour laquelle on galère à réduire les cold starts est simple : un gros handler fait tout. Même si un utilisateur ne tape que /health ou /login, la fonction charge quand même des tableaux de bord admin, des générateurs de rapports, des outils PDF et la moitié de la couche DB.

L'objectif est de ne charger que ce dont une route a besoin. Au lieu d'un méga-endpoint qui branche sur le path et la méthode, découpez en modules de routes plus petits ou en fonctions séparées. Chaque point d'entrée devrait importer le strict minimum pour répondre.

Une approche pratique :

- Groupez les routes par usage : auth, lectures publiques, actions d'écriture, outils admin.

- Donnez à chaque groupe son propre handler (ou sa propre fonction serverless) avec ses propres imports.

- Mettez les fonctionnalités rarement utilisées (exports, rapports, écrans admin) derrière des imports paresseux pour qu'elles ne se chargent que lorsqu'on les appelle.

- Poussez le travail CPU lourd (génération de PDF, traitement d'images, exports longs) dans un pattern de jobs en arrière-plan pour que la requête renvoie vite.

- Gardez le code partagé petit et stable : types, petits helpers, constantes et clients fins.

Le lazy loading est particulièrement utile pour des fonctionnalités « une fois par jour ». Si une route d'export admin tire une grosse bibliothèque de charting ou un navigateur headless, gardez ça hors du trafic normal. Importez-la à l'intérieur du handler d'export, pas en tête de fichier.

Surveillez aussi votre dossier « shared ». Les projets générés par IA mettent souvent tout dans utils puis chaque route l'importe. Cela transforme le code partagé en aimant à bundle.

Si vous héritez d'un prototype serverless généré par des outils comme Bolt ou Replit, FixMyMess trouve souvent un fichier qui fait routeur, contrôleur et job runner. Le découpage coupe généralement le temps de démarrage rapidement et facilite ensuite l'allégement des bundles.

Alléger le build sans casser les fonctionnalités

Un paquet de déploiement plus petit signifie généralement des cold starts plus rapides, mais l'objectif n'est pas « supprimer jusqu'à ce que ça marche ». Il s'agit de ne garder que ce que la fonction nécessite au runtime, et de prouver qu'on n'a rien enlevé d'important.

Assurez-vous que le tree-shaking est réel

Beaucoup de projets générés par IA ont l'air « buildés », mais la sortie inclut encore la plupart du code. Le tree-shaking n'aide que lorsque votre code et vos dépendances sont packagés de façon à ce que le bundler puisse réellement élaguer.

Un contrôle pratique : comparez ce que vous importez et ce qui finit dans le bundle final. Si un simple import fait entrer une grosse librairie, passez à des imports plus ciblés ou remplacez la librairie.

Empêchez le code serveur et client de se mêler

Un bug de gonflement courant est de packager du code serveur (secrets, clients DB, gros SDKs) dans des artefacts destinés au client, ou d'inclure des paquets browser-only dans des fonctions serveur. Les outils d'IA brouillent souvent la frontière avec des dossiers "utils" partagés qui importent les deux côtés.

Avant d'envoyer en production, vérifiez :

- Les builds de production excluent les paquets dev (runners de tests, linters, outillage Storybook).

- Les sourcemaps et outils de debug ne sont pas inclus à moins d'en avoir vraiment besoin.

- La cible d'exécution est aussi moderne que possible (pour réduire les polyfills et la sortie de transpilation).

- Chaque fonction bundle uniquement son code de route, pas toute l'app.

- Les modules "partagés" n'importent pas de dépendances réservées au serveur.

Un scénario réaliste : une app serverless générée par IA importe un SDK admin dans un fichier de validation partagé. Ce fichier est utilisé par une API, mais le bundler tire le SDK dans toutes les fonctions. Les cold starts montent, et les coûts suivent.

Si vous voulez de l'aide pour vérifier ce qu'il y a réellement dans vos bundles, FixMyMess peut lancer un audit rapide et indiquer les imports et réglages de build qui causent le bloat, puis vous aider à réduire les cold starts sans casser les fonctionnalités.

Réduire le travail d'initialisation à l'intérieur de la fonction

Même avec un bundle plus petit, les cold starts restent pénibles si la fonction fait beaucoup de travail avant de pouvoir répondre. L'objectif est simple : faire le moins possible au démarrage et reporter tout le reste jusqu'au moment où c'est vraiment nécessaire.

Un ralentissement courant est l'ouverture de connexions DB au moment du chargement du module. Quand le runtime démarre, il exécute le code au niveau supérieur une fois, et tout appel réseau lent là devient une taxe d'initialisation. Préférez créer le client DB paresseusement à l'intérieur du handler, puis le réutiliser sur les invocations chaudes (la plupart des plateformes conservent le processus). Vous conservez la réutilisation des connexions, mais vous ne payez le coût que lorsque la route touche réellement la base.

La même règle s'applique aux setups coûteux comme l'initialisation de SDK, la lecture de gros fichiers locaux ou la construction de larges maps en mémoire. Si une route n'a besoin de ce travail que 10 % du temps, ne faites pas attendre 100 % des requêtes.

Changements à fort impact généralement sûrs :

- Initialiser les clients DB/SDK à la première utilisation dans le handler, pas au moment de l'import.

- Garder les lectures de config légères : parser les variables d'environnement une fois, différer la récupération de secrets jusqu'à ce qu'ils soient nécessaires.

- Rendre les vérifications d'auth minces : vérifier le token d'abord, charger le profil complet seulement si nécessaire.

- Éviter les logs d'initialisation lourds : une ligne courte suffit, les payloads structurés peuvent attendre.

- Ne précomputez pas les caches au boot ; construisez-les progressivement à l'arrivée des requêtes.

Exemple : un endpoint généré par IA valide un JWT, puis charge immédiatement l'utilisateur complet, l'équipe et les permissions depuis la base pour chaque requête, même pour un simple health check. Scindez cette logique pour que les routes légères vérifient seulement le token. FixMyMess voit souvent ce pattern dans les prototypes, et le réduire peut diminuer sensiblement les cold starts tout en réduisant la charge DB.

Erreurs courantes qui gaspillent du temps ou empirent la situation

Les corrections de cold starts échouent souvent parce que la modification semble correcte, mais le bundle contient toujours le même poids. Résultat : des heures de travail, aucun gain réel, et parfois des bugs nouveaux.

Un piège courant est de supprimer un paquet des dépendances mais de laisser des imports (ou ré-exports) dans le code. Beaucoup de bundlers incluront encore le code si quelque chose le référence, même indirectement. Après le nettoyage, faites un build et confirmez que la dépendance a réellement disparu de la sortie, pas seulement du fichier package.

Une autre erreur coûteuse est d'utiliser un ORM complet ou un client admin pour une simple requête. Dans les apps serverless générées par IA, il est normal de voir un client DB lourd chargé à chaque requête juste pour récupérer un enregistrement. Remplacer ce chemin critique par une approche de requête plus légère peut apporter plus de bénéfices que des semaines de micro-optimisations.

Faites attention aux payloads d'initialisation cachés en clair : gros blobs JSON, templates de prompts ou configurations copiées dans du code exécuté au moment de l'import. Exemple : une fonction charge une librairie de prompts de 400 KB au niveau module alors qu'une seule route l'utilise. Déplacez-la derrière une condition ou chargez-la seulement quand c'est nécessaire.

Trop fragmenter peut se retourner contre vous

Scinder les routes est bon, mais trop de fonctions minuscules crée un autre problème : plus de configurations à gérer, du code dupliqué et plus d'endroits où oublier une vérification de sécurité. Séparez en fonction du poids réel (gros dépendances, init lente), pas pour chaque endpoint.

Optimisations qui cassent la sécurité

Le travail de performance peut parfois enlever les garde-fous nécessaires. N'optimisez pas en sautant la validation d'entrée, en affaiblissant les vérifications d'auth ou en codant en dur des secrets pour gagner du temps d'initialisation. FixMyMess voit souvent des projets générés par IA avec des clés exposées et des requêtes dangereuses à côté d'optimisations, et la sécurité devient alors le vrai blocage en production.

Un contrôle rapide avant déploiement :

- Confirmez que le bundle n'inclut plus les paquets supprimés.

- Évitez de charger de grosses données et prompts au moment de l'import.

- Gardez les splits de fonctions significatifs, pas infinis.

- Reverifiez auth, gestion des secrets et validation d'entrée après les refactors.

- Mesurez de nouveau pour confirmer l'amélioration du cold start.

Exemple : nettoyer un prototype serverless généré par IA et gonflé

Imaginez une simple app serverless générée par IA : login par email, un dashboard, un endpoint principal « create report », et une route admin pour exporter des données. Elle a été montée vite avec des outils comme v0 ou Replit et marche en démo.

En production, la première requête après un déploiement est douloureusement lente. Certains utilisateurs atteignent un timeout dès le premier chargement. La facture est aussi plus élevée que prévu, même si le trafic n'est pas énorme. Cette combinaison pointe souvent vers des cold starts plus un bundle gonflé : trop de code embarqué dans une fonction qui n'exécute que peu de temps.

Voici ce que vous changez sans toucher au produit lui-même.

Le nettoyage

Commencez par les dépendances. Vous trouvez quelques grosses bibliothèques à peine utilisées : une librairie PDF complète pour un seul export, une librairie de dates importée deux fois, et un helper d'UI admin empaqueté dans chaque fonction. Vous supprimez ce qui est inutilisé, remplacez les duplicatas, et veillez à ce que les paquets serveur restent côté serveur.

Ensuite, séparez la route admin dans sa propre fonction. Les exports admin s'exécutent rarement, mais ils forçaient chaque cold start à embarquer du code lourd. Maintenant, les chemins utilisateurs restent légers et la fonction admin peut être plus lente sans pénaliser tout le monde.

Enfin, chargez paresseusement le générateur de rapports. Le dashboard et l'auth n'en ont pas besoin au démarrage, donc vous le chargez uniquement quand l'utilisateur clique sur « Generate report ».

Ce qui s'améliore (et ce qui reste identique)

Après ces changements, la première réponse est sensiblement plus rapide, les timeouts du jour de déploiement chutent, et les coûts deviennent plus prévisibles parce que moins de requêtes payent la taxe d'initialisation.

Ce qui reste identique : le flux de connexion, le comportement du dashboard, le contrat API et le rendu des rapports. Les utilisateurs ne devraient remarquer que l'amélioration de la réactivité.

Si vous héritez d'un prototype serverless généré par IA qui se comporte ainsi, FixMyMess peut réaliser un audit de code gratuit pour pointer les dépendances surdimensionnées et les séparations de routes qui réduiront les cold starts sans tout réécrire.

Checklist rapide avant de déployer les changements

Traitez les corrections de performance comme une release normale : prouvez l'amélioration, puis confirmez que vous n'avez rien cassé.

Notez deux chiffres avant/après : taille du bundle déployé et temps de cold start. Gardez simple : date, environnement, endpoint et les nombres. Cela évite les décisions basées sur « on a l'impression que c'est plus rapide ».

Refaites le même test de la même manière à chaque fois. Touchez le même endpoint, dans la même région, avec le même réglage mémoire, après que la fonction soit restée inactive assez longtemps pour être froide. Une erreur fréquente est de comparer des appels chauds (rapides) à des appels froids (lents) et de croire qu'on a résolu le problème.

Checklist pré-déploiement :

- Enregistrer la taille du bundle et le temps de cold start avant et après le changement (même endpoint, même environnement).

- Retester le chemin le plus lent, pas seulement un health check.

- Parcourir les flux clés : login, les appels API principaux dont dépend votre UI, et tout job en arrière-plan ou webhook.

- Faire une passe de sanity sécurité après les refactors : vérifier que les secrets ne sont pas embarqués ou loggés et que les entrées sont toujours validées.

- Noter ce qui tourne encore au démarrage (init de gros SDK, chargement de schémas, parsing de grosses configs) pour savoir quoi attaquer ensuite.

Si vous scindez une grosse fonction en trois plus petites et que les cold starts ont à peine changé, le poids réel est probablement toujours dans un import partagé (comme un SDK cloud complet) ou dans du code d'initialisation qui s'exécute à chaque invocation.

Si vous travaillez sur une base générée par IA, tenez une courte note « startup heavy » au fur et à mesure. Si l'app reste lente, cette note est exactement ce qu'une équipe de remédiation comme FixMyMess utilise pour identifier ce qu'il faut sortir du chemin critique.

Étapes suivantes si votre app générée par IA reste lente

Si vous avez déjà réduit le bloat évident et que ça traîne encore, décidez si vous avez besoin d'un correctif rapide ou d'une restructuration plus profonde.

Un correctif rapide concerne généralement la suppression de dépendances surdimensionnées, la coupure du code inutilisé et le déplacement des setups lourds hors du chemin chaud. Une restructuration plus profonde intervient quand l'agencement de l'app est le problème, par exemple une seule grosse fonction qui gère toutes les routes.

Une règle simple pour choisir : si vous pouvez pointer une ou deux grosses bibliothèques ou un handler trop gonflé, commencez par le correctif rapide. Si tout est emmêlé (globales partagées, imports circulaires, propriété de code floue), vous gagnerez du temps en scindant les routes et en nettoyant les frontières des modules.

Il vaut la peine de demander de l'aide quand la lenteur s'accompagne d'un risque. Surveillez des signes comme des imports que vous n'osez pas toucher, des modules où un changement casse trois routes, ou des hacks « temporaires » autour d'une auth cassée. Le code généré par IA a aussi tendance à livrer des secrets exposés, des requêtes DB non sécurisées ou une validation d'entrée faible ; le travail de performance peut alors révéler un travail de sécurité incontournable.

Si vous voulez un point de départ peu contraignant, FixMyMess (fixmymess.ai) peut diagnostiquer les dépendances surdimensionnées, refactorer la structure des routes, durcir la sécurité et préparer la base de code pour le déploiement. C'est conçu pour des équipes non techniques qui ont besoin d'une liste claire de ce qui ne va pas et de quoi corriger en priorité.

Des attentes pratiques vous aident à planifier. Beaucoup de projets peuvent être remis en état en 48–72 heures selon l'ampleur, surtout si l'objectif est de rendre un prototype généré par IA prêt pour la production plutôt que parfait.

Une bonne action à faire aujourd'hui :

- Capturer une trace d'un cold start lent et la taille du bundle déployé.

- Lister les 5 dépendances principales par taille et où elles sont importées.

- Identifier quels endpoints doivent être rapides et lesquels peuvent tolérer un délai.

- Choisir correctif rapide vs restructuration, puis s'engager sur une voie.

- Si le code semble dangereux ou fragile, demander un audit avant de livrer.

Questions Fréquentes

Qu'est-ce qu'un cold start dans une application serverless ?

Un cold start est le délai supplémentaire sur la première requête après qu'une fonction serverless est restée inactive. La plateforme doit démarrer un runtime neuf et charger votre code avant de répondre, donc la première requête est lente puis les suivantes sont rapides.

En quoi le gonflement du bundle aggrave-t-il les cold starts ?

Le gonflement du bundle signifie que le paquet déployé contient plus de code que nécessaire à l'exécution. Les paquets plus volumineux prennent plus de temps à être téléchargés, décompressés et chargés en mémoire, ce qui ralentit les cold starts et augmente le temps de démarrage facturé.

Pourquoi les apps serverless générées par IA sont-elles souvent lentes sur la première requête ?

Les projets générés par IA ajoutent souvent de grosses bibliothèques « au cas où », réexportent des dossiers entiers ou regroupent plusieurs routes dans un seul fichier d'entrée massif. Ainsi, chaque endpoint charge les mêmes imports lourds, même si la route est minime.

Comment savoir si ma lenteur est due aux cold starts ou à autre chose ?

Cherchez un schéma où la première requête après quelques minutes d'inactivité est beaucoup plus lente que les suivantes. Si vos logs montrent une longue phase d'init ou de chargement de modules avant que le handler ne fasse le vrai travail, vous payez probablement le coût d'un cold start.

Quelle est une façon simple de mesurer les cold starts sans compliquer les choses ?

Commencez par une base de test simple et répétable : touchez un endpoint plusieurs fois, attendez que la fonction soit inactive, puis touchez-la à nouveau et enregistrez cette première réponse séparément. Suivez les latences P50 et P95 ainsi que la durée d'init renseignée par la plateforme, et comparez avant/après.

Que faire en premier pour réduire la taille du bundle ?

Commencez par identifier ce que la fonction doit charger avant de répondre et supprimez le poids mort évident. Des outils comme les vérificateurs de dépendances et les rapports de taille de build aident à repérer les paquets inutilisés, les duplications et les dépendances transives lourdes qui peuvent être coupées en toute sécurité.

Dois-je diviser une grosse fonction en plusieurs plus petites ?

Scindez selon le poids, pas par idéologie. Si les exports admin, la génération de PDF, le traitement d'images ou de gros SDKs sont inclus dans vos chemins principaux, déplacez ces routes dans leur propre fonction ou point d'entrée afin que le trafic normal ne paie pas pour du code rarement utilisé.

Quand le lazy-loading des imports est-il réellement utile ?

Le lazy-loading aide quand une bibliothèque lourde n'est nécessaire que sur certaines requêtes. Importez-la à l'intérieur du handler qui en a besoin pour que votre cold start ne paye pas toujours ce coût, et vérifiez que le runtime gère bien les erreurs d'import.

Quel travail d'initialisation dans la fonction cause généralement des cold starts lents ?

Évitez les appels réseau ou les initialisations lourdes au niveau du module. Initialisez les clients DB/SDK à la première utilisation à l'intérieur du handler et réutilisez-les sur les invocations « chaudes » quand le processus est conservé par la plateforme.

Quand devrais-je demander à FixMyMess d'auditer ou de réparer mon app serverless générée par IA ?

Demandez de l'aide quand l'arborescence des dépendances est difficile à démêler, qu'une modification casse plusieurs routes, ou que les optimisations révèlent des problèmes de sécurité (secrets exposés, requêtes non sécurisées). FixMyMess peut réaliser un audit gratuit puis corriger ou reconstruire le code généré par IA avec vérification humaine.