Versionnage des prompts : une façon simple de suivre les modifications et de revenir en arrière

Versionnage des prompts simplifié : enregistrez ce que vous avez demandé, ce qui a changé et pourquoi, pour comparer les résultats, revenir rapidement en arrière et réduire les régressions.

Pourquoi les sorties régressent après que vous ayez « amélioré » un prompt

La régression de sortie, c'est quand un prompt qui donnait de bons résultats commence à en donner de moins bons après un changement qui semblait anodin. Parfois c'est subtil (quelques erreurs en plus). Parfois c'est flagrant (le modèle ignore votre règle principale).

La régression se manifeste souvent par :

- Dérive de ton (trop formel, trop commercial, trop familier).

- Rupture de structure (rubriques manquantes, mauvais format, sections en trop).

- Perte d'exactitude (plus d'hypothèses, contradictions, moins de précautions).

- Contraintes oubliées (nombre de mots, phrases interdites, éléments obligatoires).

- Moins de cohérence (deux exécutions donnent des réponses très différentes).

De petites modifications de prompt peuvent provoquer de grands changements parce qu'un prompt n'est pas une checklist que le modèle suit ligne par ligne. C'est un ensemble de signaux qui se concurrencent pour attirer l'attention. Ajouter une phrase, supprimer un exemple ou réordonner les instructions change ce que le modèle considère comme « le plus important ».

Les déclencheurs fréquents incluent des règles contradictoires, enterrer une contrainte clé plus bas dans le prompt, remplacer un exemple concret par un exemple vague, allonger le prompt au point que les détails perdent d'importance, ou changer un seul mot qui modifie le sens (par exemple « bref » vs « minimal »).

La partie coûteuse n'est généralement pas la mauvaise sortie. C'est de perdre le contexte de ce qui a changé et pourquoi. Une semaine plus tard vous vous souvenez que « la version B était meilleure », mais vous n'arrivez pas à expliquer ce que « meilleur » signifiait, quelle entrée de test vous avez utilisée, ou ce que vous avez modifié.

C'est pour ça que le versionnage des prompts compte. L'objectif n'est pas la perfection. C'est d'obtenir des résultats reproductibles et des retours en arrière faciles. Si vous pouvez dire « v1.3 a ajouté une règle de format plus stricte et a tué le ton amical », vous pouvez revenir en arrière en quelques minutes au lieu d'essayer dix modifications au hasard.

C'est d'autant plus important quand les prompts touchent du travail réel : e‑mails d'onboarding, réponses support, docs internes ou extraits de code. Un faible changement de formulation peut produire silencieusement du code qui supprime la validation des entrées ou expose des secrets, et vous ne le remarquerez peut‑être que plus tard.

Considérez les prompts comme des évolutions produit : enregistrez chaque modification, conservez une version connue comme bonne et rendez chaque changement facile à annuler.

Ce que vous devez suivre (et ce que vous pouvez ignorer)

Un bon versionnage de prompt capture quelques éléments qui expliquent la plupart des régressions. L'objectif est simple : la future version de vous (ou un collègue) doit pouvoir relancer la même requête et comprendre pourquoi les résultats sont différents.

À suivre (ce qui provoque de vraies régressions)

Pour chaque version, conservez un petit enregistrement qui inclut :

- Le texte exact du prompt, copié tel quel (y compris tout message système ou instruction « cachée »).

- Le nom du modèle et les réglages clés (en particulier la température). Si des outils ou des appels de fonction sont activés, notez‑les aussi.

- L'entrée que vous lui avez fournie (texte de référence, extraits d'exemples, fichiers, contraintes, règles de formatage).

- Une sortie « dorée » que vous considérez bonne, plus 1–2 phrases expliquant pourquoi elle est bonne.

- Le cas de test que vous avez utilisé pour la juger (la même requête utilisateur ou les mêmes données d'exemple).

C'est généralement juste quelques lignes. Le plus grand gain de temps est d'écrire les critères de succès. Les gens se souviennent du prompt, mais oublient ce qu'ils cherchaient à préserver.

Ce que vous pouvez ignorer (peu utile)

Certains détails semblent utiles, mais expliquent rarement les régressions :

- Petites modifications de mise en forme qui ne changent pas le sens.

- Longs essais sur l'intention (au‑delà d'une courte note « pourquoi ce changement »).

- Métadonnées cosmétiques sauf si elles affectent le routage ou le comportement.

- Des dizaines d'exemples de sortie. Une sortie dorée représentative vaut mieux que dix aléatoires.

Un schéma courant : vous baissez la température pour obtenir des réponses plus cohérentes. Une semaine plus tard, les sorties semblent raides et manquent de détails clés. Si vous avez suivi le changement de température et sauvegardé une sortie dorée précédente, vous pouvez revenir en arrière en toute confiance au lieu de deviner.

Un schéma de versionnage simple que vous utiliserez vraiment

Le versionnage des prompts ne fonctionne que s'il reste léger. Si cela devient une cérémonie, vous arrêterez de le faire quand vous en aurez le plus besoin.

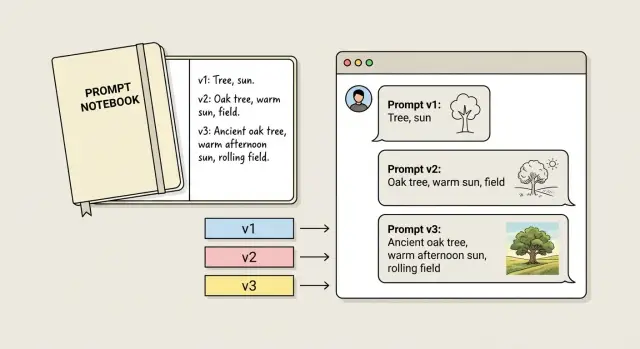

Utilisez des identifiants de version courts que vous pouvez référencer partout : v1, v1.1, v2.

- Versions majeures (v1, v2, v3) : l'objectif a changé (nouveau public, nouveau format, nouvelles contraintes, nouvelles règles de scoring). Attendez‑vous à des sorties différentes.

- Versions mineures (v1.1, v1.2) : l'objectif est le même, mais vous avez ajusté la formulation, l'ordre, un exemple ou une règle.

- Hotfixes (v1.1a) : correctif rapide ou rollback pour restaurer le comportement.

Gardez une phrase d'objectif par version. Si vous ne pouvez pas décrire la mission du prompt en une ligne, le changement est probablement plus important que vous ne le croyez.

Essayez de faire un changement signifiant par version. Si vous changez le ton, ajoutez des contraintes et réécrivez les exemples en une seule fois, vous ne saurez pas ce qui a causé l'amélioration (ou la rupture).

La configuration minimale : un seul fichier, même structure à chaque fois

Si vous ne faites qu'une chose, stockez les versions de prompts au même endroit. Un document, une note ou un fichier dans votre repo suffit. L'idée est de pouvoir répondre en 30 secondes : « Qu'est‑ce qui a changé, et quand la sortie s'est‑elle dégradée ? »

Choisissez un nom de fichier dont vous vous souviendrez (par exemple : prompts.md ou prompt_versions.md). Puis utilisez la même structure pour chaque version.

Un modèle simple que vous pouvez copier

Utilisez les mêmes blocs à chaque fois : le prompt, le journal des modifications pour cette version, un exemple de sortie dorée et une courte ligne « problèmes connus ».

# Prompt: Support Reply Writer

## v1.3 (2026-01-21)

### Prompt

[Paste the full prompt here. No snippets.]

### Change log

- Why: Reduce overly formal tone.

- What changed: Added \"Write like a helpful human\" and removed \"Use professional language\".

### Golden output

[Paste the exact best output you want to preserve.]

### Known issues

Sometimes forgets to ask one follow-up question.

Quelques règles font tenir ce système dans le temps :

- Collez le prompt complet à chaque fois. Les prompts partiels sont le début des confusions.

- Rédigez le « pourquoi » en clair. « Améliorer la qualité » n'est pas un pourquoi. « Empêche l'utilisation de listes à puces dans des mails courts » l'est.

- Conservez une seule sortie dorée par version. Choisissez l'exemple que vous détesteriez perdre.

À quoi doit ressembler la « sortie dorée »

La sortie dorée n'est pas « la meilleure sortie jamais ». C'est une capture que vous pouvez comparer plus tard.

Utilisez une entrée réelle, puis collez la sortie exacte que vous avez approuvée, y compris le format, le ton et les sections obligatoires. Si une nouvelle version commence à ajouter des affirmations exagérées ou à omettre des détails clés, vous le remarquerez immédiatement.

Ajoutez une ligne « problèmes connus » même si cela paraît mineur. Cela évite qu'un collègue ne « corrige » la même chose deux fois et casse autre chose.

Étapes : comment modifier un prompt sans perdre la bonne sortie

L'objectif est simple : gardez une sortie connue que vous pouvez toujours retrouver.

Commencez par une tâche de base que vous pouvez relancer facilement, par exemple : « Résumez cet e‑mail client en 3 points et rédigez une réponse polie. » Exécutez votre prompt actuel une fois, sauvegardez le texte du prompt comme v1, et sauvegardez l'entrée et la sortie exactes.

Ensuite, écrivez une vérification en langage courant de ce que « bon » signifie. Évitez les objectifs vagues comme « meilleur » ou « plus utile ». Faites‑en quelque chose que vous pouvez juger rapidement.

Un flux pratique :

- Geler une baseline : sauvegardez le prompt v1 + l'entrée de référence + la sortie.

- Écrire une règle passe/échoue : 2–4 lignes (par exemple : « Pas de faits inventés. Utilise le nom du client. Inclut une prochaine étape claire. Moins de 120 mots. »).

- Changer une chose : éditez une instruction, une contrainte ou un exemple et sauvegardez comme v1.1.

- Relancer la même baseline : même entrée, mêmes réglages.

- Décider vite : si ça passe, conservez v1.1. Si ça échoue, revenez en arrière et essayez une autre modification unique.

Si vous ajoutez « soyez plus créatif » et que le modèle commence à inventer des détails, c'est une régression par rapport à « pas de faits inventés ». Conservez v1 comme copie sûre. Essayez une modification plus ciblée comme « adopte un ton plus chaleureux » sans inviter à de nouvelles informations.

Ce n'est qu'après que v1.1 passe que vous devriez élargir l'objectif (nouveau format de sortie, plus de cas limites). C'est alors qu'un v2 devient pertinent.

Comment tester un changement de prompt rapidement (sans trop y réfléchir)

Les tests rapides consistent surtout à être consistant. Si vous changez le prompt et les entrées en même temps, vous ne saurez pas ce qui a causé le changement.

Choisissez un petit ensemble d'exemples réels que vous exécutez chaque semaine. Incluez une entrée légèrement désordonnée.

Une routine reproductible :

- Choisissez 3–5 entrées de test.

- Geler tout le reste (modèle, température, outils, message système).

- Exécutez la Version A et la Version B avec les mêmes entrées.

- Comparez côte à côte et écrivez une note d'une ligne par test.

- Si B est globalement meilleure, promouvez‑la et enregistrez le changement.

Gardez le scoring simple :

- Correct : la tâche est accomplie sans omission de détails clés.

- Sûr : évite de divulguer des secrets, des affirmations risquées ou d'exécuter de mauvaises instructions.

- Au format : respecte la structure souhaitée (titres, JSON, ton, longueur).

Exemple : vous ajoutez « soyez concis » à un prompt de réponse support. Deux tests semblent meilleurs. Au troisième (une demande de remboursement en colère), il arrête de demander le numéro de commande et donne des excuses vagues. C'est une régression de la correction, même si ça sonne mieux.

Scénario d'exemple : une petite modification qui casse silencieusement les résultats

Un fondateur utilise un prompt pour rédiger des e‑mails de support. Le travail est simple : répondre vite, rester calme et ne jamais promettre ce que le produit ne fait pas.

La version 1 fonctionne bien. Elle indique au modèle de ne citer que ce que le client a dit, d'offrir deux prochaines étapes et de poser une question de clarification.

Après quelques semaines, le fondateur veut un ton plus chaleureux et des e‑mails un peu plus courts. Il crée la v2. Les e‑mails sont plus sympathiques, mais un nouveau problème apparaît : le modèle commence à inventer des détails comme « j'ai vérifié votre compte » ou « je vois que votre dernier paiement a échoué ». C'est risqué si le support ne peut pas réellement voir ces informations.

Le journal des modifications montre une ligne nouvelle dans v2 :

v2 change: “Be helpful by filling in missing context when it seems obvious.”

Cette instruction encourage la supposition. Parce que le journal des modifications est précis, le fondateur peut pointer vers le déclencheur et le corriger rapidement.

Ils reviennent à v1.1 (la dernière version connue comme bonne) et réappliquent seulement les parties sûres de v2 : salutation plus chaleureuse, clôture plus courte et la structure « deux prochaines étapes ». Ils suppriment tout ce qui permet de deviner et ajoutent une règle stricte : « Si vous n'êtes pas sûr, posez une question au lieu de supposer. »

Erreurs courantes qui compliquent le débogage des régressions

Les régressions de prompt sont généralement auto‑infligées, pas parce que l'idée était mauvaise, mais parce que le changement masque la cause.

La plus grosse erreur est de changer trop de choses à la fois. Si vous modifiez l'objectif, le ton, les règles de formatage et les exemples dans un seul commit, vous ne pouvez pas savoir ce qui a cassé le résultat. La réparation devient de la conjecture, et les gens ont tendance à empiler encore plus d'instructions pour compenser.

Une autre erreur est de ne pas sauvegarder une sortie connue comme bonne. Sans avant/après, vous vous retrouvez à argumenter à partir de la mémoire.

Les échecs qui font perdre le plus de temps :

- Plusieurs modifications à la fois, il n'y a donc pas de cause claire.

- Pas de sortie « bonne » sauvegardée ni d'entrée qui l'a produite.

- Modification des données de test et blâme du prompt.

- Dérive des réglages entre les exécutions (version du modèle, température, message système, configuration d'outil).

- Suivi uniquement du texte final du prompt, pas du pourquoi du changement ni de ce que vous attendiez.

La discipline vaut mieux que la ruse : changez une chose, gardez les entrées de test fixes et rédigez la raison de chaque modification en une phrase.

Liste de contrôle rapide avant de déployer une nouvelle version de prompt

Avant de déployer un nouveau prompt, faites une vérification rapide pour reproduire le dernier bon résultat et confirmer que vous pouvez revenir en arrière si la qualité baisse.

La vérification de déploiement en 5 minutes

- Pouvez‑vous reproduire la dernière bonne sortie ? Utilisez les entrées sauvegardées et confirmez que vous obtenez toujours le résultat de référence.

- N'avez‑vous changé qu'une seule variable ? Une édition significative par version maintient claire la relation de cause à effet.

- Avez‑vous un test passe/échoue ? Choisissez 2–3 vérifications jugées rapidement (champs requis, format exact, pas de faits inventés).

- Quel type d'échec est‑ce ? Étiquetez‑le : format, faits, sécurité ou ton.

- Le rollback est‑il plus rapide que le patch ? Si vous empilez des corrections sur un changement fragile, revenez en arrière et refaites la modification proprement.

Si vos prompts génèrent du code ou modifient le comportement de l'appli, prenez cela encore plus au sérieux. Reproduisez, isolez un changement, testez passe/échoue et revenez en arrière tôt.

Étapes suivantes : en faire une habitude (et quand demander de l'aide)

La façon la plus simple de maintenir le versionnage des prompts est de cesser de considérer votre meilleur prompt comme un one‑off. Transformez‑le en modèle réutilisable avec des emplacements clairs (objectif, audience, contraintes, exemples). Quand vous partez toujours de la même structure, vous remarquez ce qui a changé et les rollbacks restent faciles.

Rendez l'habitude si petite que vous ne pouvez pas l'ignorer :

- Utilisez un identifiant court plus une date (par exemple :

support_reply_v07_2026-01-21). - Ajoutez une ligne claire décrivant le changement.

- Sauvegardez la sortie connue comme bonne avec la version, pas dans l'historique de chat.

- Enregistrez ce que vous espériez améliorer et ce qui s'est empiré (si cela arrive).

Parfois, le problème n'est pas le prompt. Si vous observez des comportements incohérents entre utilisateurs, des données manquantes, une authentification cassée ou des échecs qui n'apparaissent qu'en production, il peut s'agir d'un problème d'application.

Si vous avez hérité d'une appli générée par l'IA via des outils comme Lovable, Bolt, v0, Cursor ou Replit et que les ajustements de prompts ne suffisent pas, une équipe de remédiation comme FixMyMess (fixmymess.ai) peut réaliser un audit de code gratuit pour identifier des problèmes comme une authentification cassée, des secrets exposés et des failles de sécurité avant que vous décidiez de réparer ou reconstruire.

Questions Fréquentes

Que signifie « régression de sortie » pour les prompts ?

C'est lorsqu'un prompt qui produisait de bons résultats commence à produire de moins bons résultats après une modification. La sortie peut dériver de ton, manquer la structure requise, ignorer des contraintes ou devenir moins cohérente entre exécutions.

Pourquoi une petite modification du prompt peut-elle provoquer un grand changement dans la sortie ?

Parce que le modèle réagit à l'ensemble des signaux et ne suit pas les instructions comme une checklist stricte. Un petit changement de formulation, un réordonnancement ou un prompt plus long peut modifier ce que le modèle considère comme prioritaire.

Quelle est la façon la plus rapide de déboguer une régression ?

Relancez exactement la même entrée avec l'ancienne et la nouvelle version en gardant les mêmes réglages. Si vous ne pouvez pas reproduire le résultat « bon » d'avant, vous déboguez à l'aveugle : verrouillez d'abord le texte du prompt, le modèle et les paramètres.

Que dois‑je suivre pour chaque version de prompt ?

Sauvegardez le texte complet du prompt, le nom du modèle et les réglages clés comme la température. Enregistrez aussi l'entrée exacte utilisée pour le test, plus une « sortie dorée » approuvée et une brève note expliquant pourquoi elle était bonne.

Quand utiliser une version majeure vs mineure (et hotfix) ?

Les versions majeures quand l'objectif change (nouveau public, nouveau format, nouvelles règles de scoring). Les versions mineures pour de petits ajustements qui conservent le même objectif. Les hotfixes pour des correctifs rapides ou des retours en arrière.

Pourquoi « un changement significatif par version » est‑il si important ?

Parce que cela rend la relation de cause à effet claire. Si vous changez le ton, les règles de formatage et les exemples en une seule fois, vous ne saurez pas ce qui a aidé ou nui, et vous ne pourrez pas garder la bonne partie en revenant sur le reste.

Que doit contenir une « sortie dorée » ?

Il doit s'agir d'une sortie réelle produite à partir d'une entrée réelle que vous jugez importante, collée exactement telle qu'elle a été générée, y compris le format et le ton. Ce n'est pas la meilleure sortie possible, c'est un point de référence pour repérer rapidement quand une nouvelle version saute des exigences ou invente des détails.

Comment tester des changements de prompt sans trop réfléchir ?

Utilisez un petit ensemble d'exemples réels et exécutez les deux versions avec le même modèle et les mêmes réglages. Évaluez avec une règle simple passe/échec comme « pas de faits inventés », « respecte le format » et « inclut la prochaine étape requise » pour décider rapidement.

Pourquoi les prompts commencent‑ils à inventer des détails quand j'essaie de les rendre plus sympathiques ou plus courts ?

Des consignes comme « Soyez plus créatif » ou « comblez le contexte manquant » peuvent pousser le modèle à deviner, ce qui augmente souvent les inexactitudes. Si l'exactitude est importante, préférez des règles comme « Si vous n'êtes pas sûr, posez une question plutôt que de supposer » et conservez « pas de faits inventés » comme contrainte stricte.

Quand ce n'est pas un problème de prompt, et que dois‑je faire à la place ?

Un rollback de prompt ne corrigera pas des problèmes issus de l'application elle‑même, comme une authentification cassée, des secrets exposés ou des chemins de code dangereux qui n'apparaissent qu'en production. Si vous avez hérité d'une appli générée par l'IA par des outils comme Lovable, Bolt, v0, Cursor ou Replit, FixMyMess (fixmymess.ai) peut réaliser un audit de code gratuit, puis réparer ou reconstruire la base de code si les ajustements de prompts ne suffisent pas.