Control de costes de logging para prototipos: retención, muestreo y redacción

Controla costes de logging: define niveles de retención, reglas de muestreo y redacción para que prototipos en rápido crecimiento mantengan logs útiles sin facturas inesperadas.

Por qué los prototipos reciben facturas inesperadas por los registros

Los prototipos suelen empezar con “registrar todo” porque parece más seguro que perder algo importante. Luego llegan usuarios reales, el tráfico sube y cada clic produce múltiples líneas de log en frontend, backend, autenticación, base de datos y servicios de terceros. Lo que era un goteo se convierte en una manguera de incendios, a veces en un solo fin de semana.

Las facturas sorpresa ocurren cuando los costes escalan en más de una dirección a la vez. Pagas por ingerir volumen de logs, por almacenarlos más tiempo del necesario y por hacerlos buscables. Los logs también pueden duplicarse entre regiones, reenviarse a múltiples herramientas o extraerse para análisis, lo que añade costes de salida y de consulta.

Los desencadenantes habituales son simples:

- Logs de depuración activados en producción

- Una petición que crea muchos logs (reintentos, bucles, clientes verbosos)

- Campos de alta cardinalidad (IDs de usuario, URLs completas, tokens aleatorios) indexados

- Retención larga por defecto que nadie revisa

- Payloads grandes volcados en logs (cuerpos completos de petición, trazas repetidas)

“Logs útiles” para un equipo pequeño es más sencillo de lo que parece. Principalmente necesitas responder: ¿qué falló? ¿quién se vio afectado? ¿cuándo empezó? ¿podemos reproducirlo? Eso suele significar un error claro, un ID de petición o traza, unos pocos campos de contexto clave y una buena traza cuando algo falla, no un diario de cada petición exitosa.

El objetivo es depurar rápido sin pagar por almacenar ruido.

De dónde vienen realmente los costes de logging

La mayoría de las facturas de logging se reducen a unos multiplicadores previsibles que aparecen cuando un prototipo recibe tráfico real.

Ingest es el primer factor. Cada evento de log hay que enviarlo y que lo acepte el servicio de logging. Si tu código registra en cada petición, cada reintento y cada ‘tick’ de job en background, el volumen sube con los usuarios y con los bugs.

Almacenamiento y retención viene después. Mantener logs en bruto 30–90 días puede dar sensación de seguridad, pero es caro cuando la mayoría nunca se consultan. Esto empeora cuando dev, staging y producción mantienen la misma retención.

Búsqueda e indexado es otra sorpresa común. Hacer “todo buscable” suele implicar indexar muchos más campos de los que realmente filtras día a día.

Cardinalidad es el multiplicador oculto. Campos con muchos valores únicos (user IDs, tokens de sesión, URLs completas con query strings, texto de error dinámico) pueden hacer explotar el número de combinaciones únicas que tu herramienta de logging debe rastrear.

Un conjunto rápido de multiplicadores a vigilar:

- Logs de “info” de alto volumen en cada petición

- Retención larga en entornos muy habladores (dev y staging)

- Indexar demasiados campos por defecto

- Añadir campos de alta cardinalidad como tags/labels

- Pipelines duplicados que reenvían los mismos logs dos veces

Decide qué necesitas realmente de los logs

El control de costes empieza con una decisión: ¿qué preguntas deben responder los logs cuando algo falla?

Para la mayoría de prototipos, los logs sirven principalmente para:

- Errores y crashes (qué falló, dónde y por qué)

- Problemas de autenticación (fallos de login, errores de token, comprobaciones de permisos)

- Pagos y facturación (cargos fallidos, errores en webhooks, eventos duplicados)

- Latencia y timeouts (endpoints lentos, consultas lentas, demoras de terceros)

Luego decide cuándo necesitas contexto completo y cuándo basta un resumen. El contexto completo ayuda con bugs nuevos o incidentes de seguridad, pero es caro. Para muchos eventos, un registro corto es suficiente: nombre del evento, ID de petición, ID de usuario (o un hash seguro), código de estado y duración. Reserva el “payload completo” para casos raros, detrás de una bandera o solo en errores.

También ayuda trazar una línea clara entre logs, métricas y trazas:

- Logs cuentan qué pasó para una petición concreta.

- Métricas dicen con qué frecuencia y cuán grave (tasa de error, p95) sin gran volumen.

- Trazas muestran dónde se fue el tiempo entre servicios.

Si metes todo en logs, las facturas crecen rápido y la depuración sigue siendo confusa.

Finalmente, clasifica los datos en tres buckets:

- Conservar siempre: errores, decisiones de autenticación, cambios en estado de pago, versión desplegada, IDs de petición

- Bueno tener: detalles de depuración que usas solo a veces

- Nunca registrar: secretos, contraseñas, tokens de acceso, datos completos de tarjetas

Un ejemplo simple: si un registro de usuario falla, loguea el código de error y el nombre del campo que falló la validación, no el cuerpo completo de la petición.

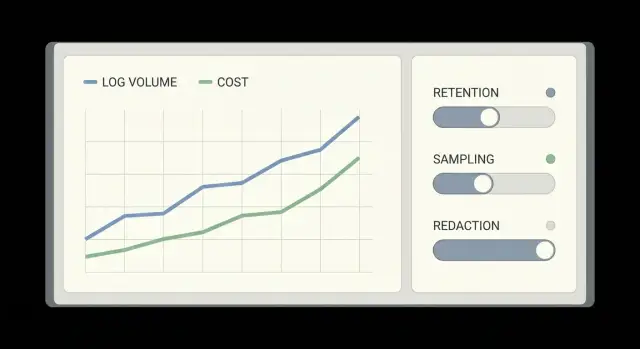

Establece niveles de retención que coincidan con el uso real

Un buen plan de retención parte de una verdad: necesitas distintos tipos de logs para distintos plazos. Si mantienes todo el mismo número de días, o pierdes detalles útiles o pagas por ruido.

Una configuración práctica de 3 niveles

- Hot (corto): logs de app y debug de alto volumen usados para troubleshooting activo. Mantén 1–3 días.

- Warm (medio): logs estándar de peticiones y eventos clave de negocio para seguimiento de incidentes. Mantén 7–14 días.

- Cold (largo): eventos de baja frecuencia y alto valor para seguridad y auditoría (cambios de auth, permisos, acciones admin). Mantén 30–180 días según riesgo y requisitos.

Hot debe ser pequeño pero detallado. Cold debe ser estable y buscable, no lleno de cada línea de debug.

Los distintos entornos deben tener reglas distintas:

- En dev, retención corta (horas a 1 día).

- En staging, suficiente para comparar releases (2–7 días).

- En producción, conserva warm y cold por más tiempo, pero sé estricto con lo que califica.

Elegir números sin adivinar

Parte del comportamiento real:

-

¿Cuánto tiempo después de un problema sueles notarlo (mismo día, día siguiente, semana siguiente)?

-

¿Cuánto tarda reproducir y confirmar una solución?

-

¿Qué eventos debes conservar por seguridad o soporte al cliente?

Usa muestreo para reducir volumen sin quedarte ciego

El muestreo mantiene la señal mientras dejas de pagar por cada “todo va bien”.

Comienza con una regla “error-first”: captura fallos al 100%. Eso incluye logs de error, excepciones, timeouts y cualquier petición que devuelva 4xx o 5xx. Cuando algo falla, quieres la traza completa.

Luego ataca las rutas de éxito más ruidosas. A menudo son health checks, polling en background, reintentos parlanchines y endpoints que se llaman en cada carga de página.

Reglas prácticas de muestreo que aún permiten depurar

- Mantén 100% de errores y warnings, además de cualquier petición por encima de un umbral de latencia.

- Muestra respuestas 200 de alto volumen (por ejemplo, 1 de cada 50).

- Añade topes por endpoint (por ejemplo, máximo 20 logs de éxito por minuto por ruta).

- Mantén eventos raros al 100% (reset de contraseña, facturación, acciones admin).

- Descarta repeticiones: si el mismo mensaje ocurre 1.000 veces, conserva los primeros N y luego resume.

Los límites por tasa son la red de seguridad. Evitan que un bug (como un bucle de reintentos) explote tu volumen de logs de la noche a la mañana.

Documenta las reglas en lenguaje plano y mantenlas estables. Un muestreo predecible calma la depuración porque sabes qué está capturado al 100% y qué está muestreado.

Fundamentos de redacción: protege secretos y datos de usuarios

La redacción reduce riesgo y a menudo el volumen. El objetivo es simple: mantener los logs útiles para depurar sin capturar secretos o datos personales que no deberías almacenar.

Redacta en la fuente (tu app), no luego en la herramienta de logs. Si un secreto se registra una vez, puede copiarse a backups, exportaciones y alertas.

Enfócate en los lugares que suelen derramar datos:

- Headers de petición

- Cookies

- Payloads de autenticación

- Parámetros de consulta

Campos comunes de riesgo incluyen Authorization, Cookie, IDs de sesión, campos de contraseña, enlaces de restablecimiento, claves API y cualquier valor llamado “token”. Muchos frameworks también registran objetos de error completos que incluyen contexto de petición, así que revisa los valores por defecto.

Cuando necesites conectar eventos entre peticiones, enmascara en vez de borrar. Por ejemplo, conserva solo los últimos 4 caracteres de un token o registra un hash unidireccional del correo en lugar del correo completo.

Una regla rápida para PII: evita registrar nombres, emails, teléfonos, direcciones e IPs salvo que tengas una razón clara y una política de retención.

Comprobaciones automatizadas ayudan a evitar regresiones:

- Añade middleware de redacción basado en denylist (headers, cookies, campos conocidos)

- Añade tests que fallen si los logs contienen patrones como

Bearer,sk-opassword= - Añade un escaneo pre-despliegue que busque secretos en logs recientes

- Mantén una allowlist pequeña de campos “seguros para loguear”

Paso a paso: implementar retención, muestreo y redacción

Empieza listando cada lugar donde se producen logs. No adivines. Incluye tu web app, workers/colas, funciones en el edge, logs de base de datos y cualquier cosa que toque el inicio de sesión (auth, callbacks del proveedor de identidad). Una fuente faltante puede mantener los costes altos y hacer incidentes más difíciles de depurar.

Estandariza una pequeña forma de log para poder filtrar rápido y evitar formatos ruidosos puntuales. Manténlo aburrido: timestamp, level, nombre del servicio y un request ID (o trace ID). Añade un nombre corto de “evento” y un pequeño contexto JSON.

Luego establece defaults por entorno:

- Producción: info/warn/error solamente

- Staging: permite debug por periodos cortos

- Dev local: cualquier cosa vale

Aquí hay un orden de implementación que suele funcionar:

- Inventaria las fuentes y asigna un responsable para cada una

- Adopta un pequeño esquema y hazlo cumplir en código nuevo

- Establece niveles de log por entorno con un default seguro en producción

- Añade muestreo o límites de tasa para eventos repetitivos (health checks, polling, reintentos)

- Añade filtros de redacción para secretos y PII, más tests automatizados

Despliega los cambios gradualmente. Compara antes vs después en volumen, coste y utilidad para incidentes durante una semana.

Monitorización de costes de observabilidad: detecta picos pronto

Si no haces nada, las facturas de logging tienden a subir en silencio y aparecen cuando ya pasó el daño. El control de costes de logging se trata sobre todo de vigilar unos pocos números cada día y saber dónde mirar cuando cambian.

Sigue tres tendencias:

- Volumen diario de ingest (cuánto envías)

- Crecimiento de almacenamiento (qué mantienes)

- “Top talkers” (servicios o rutas que más logs generan)

Los top talkers suelen ser un endpoint ruidoso, un job en retry o un error que loguea un payload completo en cada petición.

Las alertas de presupuesto importan más que dashboards perfectos. Pon alertas en varios puntos (por ejemplo 50%, 75%, 90% del presupuesto mensual) para tener tiempo de actuar.

Los picos suelen seguir a releases, migraciones, cambios de config y saltos de tráfico. Tras cada uno, revisa ingest y volumen de errores en la primera hora. Una sola bandera de debug dejada activada puede multiplicar costes de la noche a la mañana.

Construye una vista de triage de coste

Cuando suben los costes, quieres respuestas en minutos:

- Qué servicio aumentó más desde ayer

- Qué endpoint o job produjo la subida

- Qué nivel de log cambió (info vs error vs debug)

- Qué campo se añadió (volcados de payload, headers, trazas)

- Qué release se correlaciona con el pico

Una vez que encuentres la fuente, la solución suele ser: bajar el nivel de log, añadir muestreo, quitar un campo ruidoso o limitar un error repetitivo.

Mantenlo ligero: una revisión semanal de 15 minutos es suficiente mientras creces rápido.

Ejemplo: un prototipo que creció demasiado rápido para sus logs

Un equipo pequeño lanzó un prototipo y pasó de 50 a 5.000 usuarios en dos semanas. Justo después de añadir login por email, la autenticación empezó a fallar para un subconjunto de usuarios. Pusieron el nivel de logs en debug para captarlo, y su volumen de logs se disparó de la noche a la mañana.

El problema no era solo “más usuarios”. Estaban registrando cuerpos completos de petición, headers completos y respuestas de auth enteras. Eso incluía JWT largos, refresh tokens y, ocasionalmente, cookies de sesión. Durante la respuesta al incidente, la gente copiaba logs en el chat, lo que multiplicó el riesgo de exposición.

Pasaron a “lo justo”. En vez de volcar todo, cada evento de auth registraba: request ID, user ID (o ID anonimizados), endpoint, código de estado, código de error, latencia y una cadena de motivo corta. Para depuración, registraban qué paso falló (parseo de token, lookup en BD, verificación de contraseña), no el payload crudo.

El muestreo hizo la mayor parte del trabajo. Mantuvieron 100% de errores y timeouts, pero solo 5% de solicitudes de auth exitosas. Eso les mostró tendencias sin pagar por cada OK.

La redacción cerró la brecha de seguridad. Tokens y secretos se enmascararon en el logger, así que las búsquedas durante el incidente no expusieron credenciales.

Su plan de retención fue simple:

- 7 días: logs completos de errores (no muestreados)

- 14 días: logs de petición muestreados (éxitos)

- 30 días: eventos de seguridad y auditoría (campos mínimos)

- 90 días: solo agregados diarios (contadores, p95)

Errores comunes que aumentan costes (y riesgo)

La mayoría de problemas de control de costes vienen de un hábito: activar “todo” durante un sprint de prototipo y no desactivarlo cuando llegan usuarios reales.

Una trampa común es loguear cuerpos de petición y respuesta completos por defecto. Parece útil, pero multiplica el volumen rápido y a menudo captura contraseñas, tokens, datos de pago o mensajes privados. Si necesitas payloads, registra solo una allowlist pequeña de campos seguros y solo por un periodo corto.

Otro impulsor silencioso de costes es hacer cada campo buscable. Campos de alta cardinalidad como user_id, session_id, trace_id, email y URLs completas con query strings pueden hacer explotar el tamaño del índice. Mantén la mayoría como texto plano y solo indexa unos pocos campos estables que realmente filtres.

Tres errores que suelen aparecer justo antes de una factura sorpresa:

- Dejar debug/verbose activado en producción tras un incidente

- Usar logs para analítica (funnels, cohortes) en vez de métricas o eventos

- Añadir redacción solo después de que los logs llegan a tu proveedor

La redacción debe ocurrir antes de que algo salga de la app. “Lo limpiaremos en el pipeline” falla la primera vez que un endpoint nuevo registra algo inesperado.

Lista rápida antes de tu próximo pico de crecimiento

Un pico de crecimiento convierte “está bien por ahora” en una factura y un riesgo de la noche a la mañana.

- Escribe tus niveles de retención y por qué existen. Retención corta para logs debug de alto volumen, retención más larga solo para logs que de verdad usas.

- Añade reglas de muestreo para tus caminos más ruidosos. Muestrea éxitos rutinarios, mantén completos los errores y casos raros.

- Redacta secretos y datos personales antes de que los logs salgan de la app. Si no lo pegarías en un chat público, no debería estar en un log.

- Activa presupuestos y alertas y pruébalos. Confirma que las alertas se disparan y que alguien las ve.

- Revisa las principales fuentes de logs semanalmente, con un responsable único. Designa a una persona que apruebe cambios en logging para que un “debug temporal” no se vuelva permanente.

Próximos pasos: estabiliza los logs mientras te acercas a producción

Una vez que las facturas sorpresa paren, el objetivo es mantener los logs útiles a medida que crece el uso. Eso no es un gran cambio único sino hábitos que eviten que el volumen vuelva a colarse.

Comienza con una auditoría rápida en tu explorador de logs y ordénalo por lo que genera más datos: el servicio más ruidoso, el endpoint más ocupado y las líneas de log más grandes. Para cada uno, pregunta: ¿esto ayuda a arreglar un problema real o solo es “bonito tener”?

Arregla los mayores culpables primero:

- Ruido de debug que quedó activado en entornos parecidos a producción

- Campos de alta cardinalidad (URLs completas con query strings, valores proporcionados por usuarios)

- Payloads crudos (cuerpos completos, blobs JSON grandes, trazas repetidas)

Luego haz que las protecciones sean difíciles de revertir por accidente. Añade tests de redacción que fallen el build si los logs contienen patrones como claves API, JWTs, contraseñas o prefijos comunes de secretos. Añade un “contrato de logs” simple para eventos clave (fallos de auth, errores de pago, fallos de jobs) para saber qué debe registrarse y qué jamás.

Si heredaste un prototipo generado por IA, planifica tiempo extra para limpieza. Estos proyectos suelen venir con logging por defecto muy parlante, snippets que imprimen headers o tokens y flujos de auth frágiles que generan errores repetidos (y logs repetidos).

Si quieres ayuda externa, FixMyMess (fixmymess.ai) se especializa en diagnosticar y reparar codebases generadas por IA, incluyendo logging ruidoso, exposición de secretos y hardening para producción. Una auditoría rápida puede identificar los hotspots de volumen de logs y los cambios más seguros para hacer primero.

Preguntas Frecuentes

¿Cuál es la manera más rápida de detener una factura sorpresa por logging?

Empieza por desactivar logs de debug/verbose en producción y eliminar cualquier volcado de cuerpos de petición/respuesta. Luego reduce la retención de los logs de alto volumen a unos pocos días y añade muestreo para las respuestas 200 OK rutinarias, manteniendo 100% de los errores. Estos tres cambios suelen reducir el volumen rápido sin dificultar la respuesta a incidentes.

¿Qué debo registrar en un prototipo para que sea útil y barato?

Registra por defecto fallos y cambios importantes de estado, no cada petición exitosa. Una base útil es: timestamp, nivel, nombre del servicio, endpoint, código de estado, duración y un ID de petición o traza; añade un código de error corto cuando algo falla. Incluye solo el contexto mínimo necesario para reproducir problemas.

¿Cómo elijo la retención de logs sin adivinar?

Las retenciones cuestan según el volumen, así que los logs de mucho volumen deben tener ventanas cortas. Mantén logs detallados para troubleshooting ‘hot’ por 1–3 días, logs generales de peticiones por 7–14 días y eventos de seguridad/auditoría de bajo volumen por más tiempo solo si realmente los necesitas. Si dudas, elige retenciones más cortas primero y extiende solo si confirmas que usas logs antiguos.

¿Cómo puedo usar muestreo sin quedarme ciego durante incidentes?

Captura 100% de errores, excepciones, timeouts y peticiones inusualmente lentas para no perder evidencia en incidentes. Para rutas de éxito de alto volumen, muestrea un pequeño porcentaje para seguir viendo tendencias sin almacenar cada evento. Añade un límite estricto por tasa para que un bucle de reintentos no multiplique el volumen de logs de la noche a la mañana.

¿Qué significa “alta cardinalidad” y por qué aumenta los costes?

Campos de alta cardinalidad son valores casi siempre únicos, como URLs completas con query strings, tokens de sesión, IDs aleatorios y texto de error dinámico. Cuando se indexan como tags/labels, la herramienta de logs tiene que rastrear muchísimas combinaciones únicas, lo que dispara costos. Mantén esos datos fuera de campos indexados y guarda solo campos estables que realmente filtres.

¿Cómo decido qué campos indexar para búsqueda?

Indexa solo un conjunto pequeño de campos estables que suelas filtrar, como nombre del servicio, entorno, nivel del log, endpoint y un pequeño conjunto de códigos de error. Deja todo lo demás como JSON/texto no indexado para que esté disponible si hace falta pero no infle el índice. Si las búsquedas son lentas, añade un campo a la vez en lugar de indexarlo todo por defecto.

¿Cuál es la forma más segura de evitar que tokens y secretos se filtren en los logs?

Redacta antes de que los logs salgan de tu app; una vez que un secreto se envía, puede propagarse a alertas, exportaciones y backups. Enmascara o elimina headers y campos sensibles como Authorization, cookies, contraseñas, claves API, enlaces de restablecimiento y tokens. Si necesitas correlación, guarda un hash unidireccional o un valor parcial en lugar del secreto crudo.

¿Por qué explotó mi volumen de logs justo después de un release?

Suele ser una bandera de configuración dejada activada tras la depuración, o un camino de código que hace logging en cada reintento o bucle. Otra causa común es añadir un campo nuevo y muy grande a los logs, como cuerpos de petición completos o trazas repetidas. Cuando sube el volumen, encuentra primero el “top talker” (servicio/ruta ruidosa) y revierte el cambio ruidoso de inmediato; luego añade muestreo o límites por tasa.

¿Cómo monitoreo el coste de los logs para que los picos no me sorprendan otra vez?

Mide el volumen diario de ingest, el crecimiento de almacenamiento y los “top talkers” por servicio y endpoint, y configura alertas de presupuesto que salten temprano en el mes. Cuando una alerta se activa, revisa qué cambió: un deploy nuevo, un cambio de configuración o un endpoint que empezó a reintentar. Trata los cambios de logging como cambios en producción: con un responsable y una revisión rápida tras releases.

Mi prototipo fue creado con una herramienta de IA y los logs son un desastre—¿qué debo hacer?

Los prototipos generados por IA suelen venir con logging muy verboso por defecto, fragmentos copiados que imprimen headers o tokens y flujos de auth frágiles que provocan errores y reintentos repetidos. Si no sabes de dónde viene el ruido, FixMyMess (fixmymess.ai) puede hacer una auditoría gratuita de código para encontrar los mayores drivers de volumen, riesgos de exposición de secretos y las correcciones más seguras. Luego pueden limpiarlo y endurecer el código rápidamente, incluso si el prototipo está desordenado.