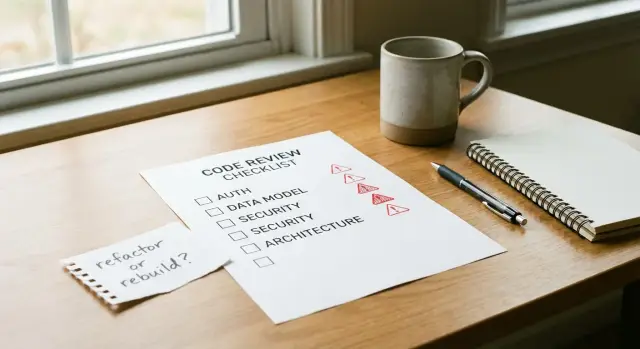

Estimar el alcance de remediación para una base de código generada por IA: señales de advertencia

Usa esta rúbrica para estimar el alcance de remediación de una base de código generada por IA identificando señales de advertencia en auth, modelo de datos, seguridad y arquitectura.

Qué estás estimando y por qué importa

El alcance de remediación es una estimación de lo que hace falta para que una base de código sea segura, estable y apta para usuarios reales. Cubre esfuerzo (horas o días), riesgo (qué podría romperse mientras lo arreglas) y desconocidos (áreas en las que no puedes confiar hasta inspeccionarlas o probarlas).

La primera decisión real normalmente no es “¿qué bug primero?” sino “¿reparamos lo que hay o reconstruimos las mismas funciones sobre una base más limpia?” Elegir mal puede hacer que pases una semana parchando problemas que reaparecen al añadir una característica más.

Las bases de código generadas por IA a menudo se ven bien en una demo, pero pueden ser irregulares. Puede haber una UI pulida sobre una lógica frágil. Un archivo sigue buenos patrones y el siguiente tiene secretos en claro, omite validaciones de entrada o mezcla consultas de base de datos con código de UI. No es automáticamente “malo”, pero puede ocultar bordes afilados.

Esta rúbrica está diseñada para la velocidad. Intentas responder dos preguntas tempranas:

- ¿Se puede dejar esto listo para producción con reparaciones focalizadas, o es más rápido y seguro reiniciar?

- ¿Dónde es probable que el trabajo explote (auth, datos, seguridad, arquitectura)?

Trata el resultado como un rango, no como un número único. Una estimación rápida y honesta ayuda a fijar expectativas y decidir si necesitas una segunda opinión antes de comprometerte con semanas de conjeturas.

Entradas y un enfoque rápido y con límite de tiempo

Para estimar alcance necesitas justo la información mínima para responder a una pregunta: ¿se puede volver este código seguro y fiable sin reescribirlo todo?

Reúne los insumos mínimos (antes de abrir el código)

Pide esto por adelantado. Si faltan piezas clave, tu estimación es mayormente una suposición.

- Acceso al repo (código fuente completo, no un zip de artefactos compilados)

- Configuración del entorno (vars de entorno, enfoque para manejar secretos y una plantilla .env de ejemplo)

- Detalles de la base de datos (esquema, migraciones y una pequeña muestra de datos si existe)

- Objetivo de despliegue (dónde debe correr y restricciones como regiones o VPC)

- Una lista corta de flujos “deben funcionar” (registro, checkout, admin, etc.)

Limita el primer pase en el tiempo. 60 a 120 minutos suelen ser suficientes para detectar riesgos mayores sin entrar en una auditoría completa.

Un flujo simple funciona bien: dedica alrededor de 15 minutos a ponerlo en marcha, 30 minutos a recorrer el camino de usuario central de extremo a extremo y luego 15 a 45 minutos escaneando las grandes señales (auth, modelo de datos, seguridad, arquitectura).

Lo que se considera “hecho” es un resultado de una página: problemas principales, un rango de esfuerzo aproximado y una llamada clara (refactorizar vs reconstruir).

Los paros forzosos importan. Si no tienes el código fuente, no puedes ejecutarlo localmente o en un entorno limpio, o nadie puede explicar cómo es la data de producción, detén y marca la estimación como bloqueada.

Triagem de primer pase: ¿puede ejecutarse y cumple la función principal?

Antes de puntuar nada, intenta usar la app como un usuario real. No buscas depurar cada problema; verificas si la base de código está básicamente viva o falla antes de llegar al flujo principal.

Comienza con una ejecución de extremo a extremo: ¿puedes iniciar el servidor, abrir la app, registrarte, iniciar sesión y completar la acción central (crear algo, reservar algo, enviar algo)? Si algún paso queda bloqueado por un crash, pantalla en blanco o ruta rota, el alcance suele aumentar porque estás arreglando fundamentos, no detalles.

Revisa rápidamente la configuración. ¿Están documentadas las variables de entorno? ¿Ves claves API, tokens o contraseñas en claro en archivos o en código cliente? Incluso un secreto expuesto puede convertir una “arreglo rápido” en una limpieza de seguridad más amplia.

También apunta la señal de pruebas. No tener tests es común en prototipos, pero aumenta el riesgo en la estimación. Incluso algunas comprobaciones smoke reducen la incertidumbre. Tests alrededor de auth y flujos centrales pueden acortar el tiempo de remediación.

Captura los desconocidos de inmediato, porque a menudo impulsan el alcance más que los bugs visibles:

- ¿Qué paso falló y qué error viste?

- ¿Qué partes del flujo central son poco claras o inconsistentes?

- ¿Qué datos se crean o cambian y dónde se almacenan?

- ¿Qué debe funcionar en producción (pagos, correos, subidas de archivos)?

Señales de auth que aumentan el alcance rápido

Los problemas de auth rara vez son “solo un bug”. Tocan enrutamiento, datos, almacenamiento de sesión y cada función protegida. En proyectos generados por IA, auth también es donde tiende a aparecer código copiado/pegado y comprobaciones del lado del servidor ausentes.

Una señal rápida es si lo básico funciona de extremo a extremo. Si los correos de restablecimiento no llegan, las sesiones expiran al azar o la UI dice “logueado” mientras la API rechaza solicitudes, normalmente estás ante más que una corrección rápida. Esos síntomas suelen indicar que el estado de auth está dividido en múltiples lugares (frontend, backend, BD, cookies) sin una única fuente de verdad.

Señales a vigilar

Estos patrones tienden a aumentar el alcance rápidamente:

- Flujos rotos (enlaces de restablecimiento fallan, cerrar sesión no desconecta de verdad, sesiones mueren tras refrescar)

- Comprobaciones de rol ausentes o inconsistentes (un usuario normal puede cargar pantallas de admin o llamar endpoints de admin)

- OAuth parcial (errores en la ruta de callback, tokens almacenados “en algún lugar”, flujo de refresh poco claro)

- Autorización aplicada solo en la UI (las páginas están ocultas, pero el servidor sigue devolviendo los datos)

Una rúbrica simple de severidad ayuda a mantener la estimación honesta:

- Bajo: un flujo rompe, pero el enfoque es consistente (un bug)

- Medio: el enfoque es inconsistente (sesiones y JWT mezclados, lógica duplicada) y necesita rediseño

- Alto: roles y autorización server-side son inseguros o poco claros (candidato a reconstrucción)

Ejemplo: si un prototipo “protege” funciones de admin ocultando botones, pero aún puedes llamar a la API de admin desde el navegador, trátalo como alta gravedad. Arreglarlo implica definir permisos, aplicarlos en el servidor y volver a probar cada función que toque datos de usuarios.

Señales en el modelo de datos: donde vive la complejidad oculta

Si una app generada por IA “más o menos funciona” pero sigue fallando de formas extrañas, el modelo de datos suele ser la razón. Problemas de esquema pequeños crean gran alcance porque cada función depende de las mismas tablas, relaciones y reglas.

Una señal rápida es el desajuste de esquema: el código lee o escribe campos que no existen en la base, o la base tiene columnas que nadie usa. Verás errores de columna faltante, nulls donde la UI asume un valor o blobs JSON “temporales” que se volvieron permanentes.

Otro amplificador de alcance es no tener una fuente de verdad clara para IDs, relaciones y propiedad. Un pedido puede referenciar a un usuario por email en un sitio, por userId en otro y por un campo “owner” en otro lugar. Entonces las correcciones no son locales. Debes decidir qué significa la app y luego actualizar código, consultas y datos existentes.

La duplicación y nombres inconsistentes entre tablas (users vs user vs app_users) usualmente indica que el modelo creció por copy-paste. Conduce a reportes que nunca coinciden, bugs que regresan después de “arreglos” y lógica que se bifurca en varias versiones.

La ausencia de una historia de migraciones es otra señal. Si no hay una forma reproducible de cambiar el esquema de forma segura, cada cambio se vuelve una edición manual riesgosa y los despliegues pueden romper producción.

Señales de alto riesgo que suelen subir las estimaciones incluyen validación omitida, deletes sin constraints, límites de tenant ausentes, relaciones aplicadas solo en el frontend y diseños “una tabla lo hace todo” llenos de campos opcionales. Si detectas varios a la vez, puede ser más barato reconstruir la capa de datos limpiamente y reconectar la app que perseguir bugs tabla por tabla.

Señales de seguridad que empujan hacia una reconstrucción

Los problemas de seguridad no son todos iguales. Algunos son arreglos rápidos (“cerrar la puerta”) que puedes aplicar con rapidez. Otros indican que el proyecto entero se construyó sin límites básicos. En estimaciones de alcance, la segunda categoría a menudo hace que reconstruir sea más seguro (y a veces más rápido) que parchear.

Empieza por los secretos. Si claves API o contraseñas de base de datos aparecen en el repo, logs o un bundle de frontend, trátalos como ya filtrados. Rotar claves es solo el primer paso. Si el código aún necesita secretos en el navegador para funcionar, eso es un problema de diseño, no solo de limpieza.

El riesgo de inyección es otro multiplicador. Si ves SQL crudo pegado en la app, consultas construidas por concatenación de strings o entradas “aceptar cualquier cosa”, no puedes arreglar un endpoint y dar por cerrado el tema. Necesitas un patrón consistente para validación y acceso a BD en todo el proyecto.

Señales que suelen inclinar a reconstruir incluyen secretos del lado cliente “porque fue lo más fácil”, endpoints sin comprobaciones de acceso, consultas construidas a partir de texto de usuario en varios sitios, manejo de sesiones que falla al refrescar o expirar y ausencia de una clara separación entre datos públicos y privados.

Básicos ausentes como rate limiting, protección CSRF y comprobaciones de autorización fiables pueden parchearse si la arquitectura está limpia. Pero si cada ruta es un caso especial, el endurecimiento se convierte en un juego de whack-a-mole.

Señales de arquitectura: dolor de refactor vs reinicio limpio

La arquitectura es donde los atajos de prototipo se vuelven sumideros de tiempo. Esto a menudo decide entre un refactor dirigido y una reconstrucción limpia.

Una advertencia común es “todo está en todas partes”: la misma regla de negocio aparece en un componente UI, en una ruta API y en un helper, cada una ligeramente diferente. Cuando acceso a datos, manejo de peticiones y renderizado están mezclados, cada cambio corre el riesgo de romper varios sitios.

Señales que suelen significar dolor de refactor

Busca patrones que hagan el código difícil de razonar y probar:

- Lógica central duplicada en varios archivos sin una fuente de verdad

- Llamadas a BD esparcidas dentro de UI o handlers de rutas sin una capa de datos clara

- Múltiples formas de hacer la misma tarea (dos comprobaciones de auth, tres helpers de facturación)

- Caminos lentos integrados (loops de fetch repetidos, trabajo pesado en el cliente, N+1 obvios)

- Estado guardado en memoria o singletons, asumiendo un único servidor

Cuando ves varios de estos dentro de la misma función, el refactor suele inflarse. Arreglas un bug y descubres que la “lógica real” vive en otro lado.

Cuando reconstruir es la opción más amable

Una reconstrucción se vuelve atractiva cuando no hay límites que valga la pena preservar. Un prototipo que “funciona en mi máquina” pero depende de sesiones en memoria, mezcla escrituras a BD en eventos de UI y repite fetchs por todos lados puede parchearse, pero cada parche añade más pegamento.

Una regla práctica: si no puedes dibujar un diagrama simple de cajas (UI, API, capa de datos) y señalar dónde vive cada regla, el alcance probablemente es mayor de lo que parece.

Una rúbrica simple que puedes aplicar en 30 a 60 minutos

Usa esta rúbrica cuando necesites estimar alcance rápido y defendible. El objetivo es reducir reconstrucciones sorpresa.

Paso 1: Puntúa cuatro áreas de riesgo (1 a 5)

Puntúa cada área de 1 (limpia, predecible) a 5 (alto riesgo, problemas que se compounding): autenticación, modelo de datos, seguridad y arquitectura.

- 1-2: Funciona mayormente, los cambios se sienten locales, pocas sorpresas

- 3: Funciona en algunos sitios pero tiene bordes afilados y acoplamientos ocultos

- 4-5: Rompe a menudo, arreglar genera nuevos bugs, difícil de razonar

Paso 2: Añade una puntuación de “desconocidos” (1 a 5)

Los desconocidos explotan las estimaciones. Puntúa docs faltantes, tests ausentes, pasos de reproducción inestables o un equipo que no puede explicar flujos centrales.

Paso 3: Separa bloqueadores de irritaciones

Antes de sumar, etiqueta hallazgos como bloqueadores o irritantes.

Bloqueadores detienen el uso en producción: usuarios no pueden iniciar sesión, datos se corrompen, secretos expuestos.

Irritaciones son sobrevivibles: UI inconsistente, páginas lentas, nombres de carpetas desordenados.

Paso 4: Mapea el total a una acción

Suma las cinco puntuaciones (auth + datos + seguridad + arquitectura + desconocidos) y usa una regla empírica:

- 5-9: Arreglo rápido (cambios focales, lanzar pronto)

- 10-14: Refactor (mejorar estructura manteniendo lo core)

- 15-19: Reconstrucción parcial (reconstruir un subsistema, mantener el resto)

- 20-25: Reconstrucción completa (más rápido que perseguir fallos)

Paso 5: Transforma en una declaración de alcance

Escribe tres líneas cortas: Arreglar ahora, Dejar para después, Fuera de alcance.

Ejemplo: “Arreglar ahora: flujo de login, manejo de secretos, restricciones de BD. Dejar para después: pulido UI de admin. Fuera de alcance: nuevas funciones de billing.”

Trampas comunes que hacen que las estimaciones salgan mal

Una UI limpia puede ocultar una base frágil. Las apps generadas por IA suelen parecer terminadas porque las pantallas son fáciles de generar, pero las partes riesgosas están detrás: auth, permisos, reglas de datos y manejo de secretos.

Otro error es tomar “funciona localmente” como prueba de que el trabajo es pequeño. El éxito local puede depender de sesiones en caché, una BD local sin datos reales, límites de tasa ausentes o claves en claro que no sobrevivirán a un despliegue real.

La seguridad es un asesino frecuente de estimaciones. Si planeas “parchar seguridad al final”, la línea de tiempo suele estirarse porque la seguridad toca autenticación, acceso a datos, diseño de API y almacenamiento.

También es fácil refactorizar demasiado pronto. Si reorganizas carpetas o “limpias la arquitectura” antes de entender quién posee qué datos y qué puede hacer cada rol, puedes embellecer el código manteniendo las reglas centrales rotas.

Un control rápido de instinto:

- No uses el pulido de UI como señal de calidad del backend

- No tomes ejecuciones locales como preparación para producción

- No pospongas decisiones de seguridad

- No refactorices antes de que el modelo de permisos sea claro

- No ignores el trabajo de despliegue

La preparación para despliegue suele subestimarse: variables de entorno, pasos de build, migraciones, logging básico y monitorización simple. Ese trabajo puede convertir un “arreglo de dos días” en una semana.

Lista de comprobación rápida: las señales más rápidas de alcance

Cuando necesitas una estimación veloz, busca señales que predigan re-trabajo, no solo bugs. Si no puedes responder una cosa claramente, trátala como multiplicador de alcance.

- Crea un usuario nuevo y completa el flujo central de extremo a extremo (no solo la demo de happy-path).

- Busca secretos (claves API, URLs de base de datos, secretos JWT) en el repo y en el código cliente.

- Confirma que la autorización se aplica en el servidor (no solo botones ocultos).

- Revisa si las migraciones corren correctamente y si tablas/campos coinciden con lo que el código espera.

- Explica la arquitectura en cinco frases: dónde entran las peticiones, dónde vive auth, dónde están las reglas de negocio, dónde se almacenan los datos y cómo se realizan los despliegues.

Si el registro funciona pero falta autorización en la API y hay secretos expuestos, ya estás en territorio de “endurecimiento de seguridad más refactor”.

Ejemplo: decidir refactor vs reconstruir para un prototipo que sigue fallando

Un fundador no técnico trae un prototipo Lovable que “más o menos funciona”, salvo que el login falla aleatoriamente y la gente se desconecta. El objetivo es estimar alcance sin pasar días leyendo cada archivo.

Un pase de 30 minutos puede responder cuatro preguntas: ¿puede ejecutarse?, ¿puede un usuario registrarse e iniciar sesión?, ¿hay datos sensibles expuestos? y ¿coincide la base de datos con lo que la app espera?

Qué comprobamos primero

Empieza ejecutando la app localmente (o en su host actual) y repitiendo el flujo de login varias veces: registrarse, cerrar sesión, volver a iniciar sesión. Después traza auth de extremo a extremo: formulario frontend, ruta API, creación de sesión o token, configuración de cookies, middleware.

A continuación, escanea en busca de secretos expuestos (claves API en el repo, secretos JWT en claro, URLs públicas de BD) y verifica el esquema: tablas, relaciones, migraciones y tipos (especialmente user, org, permissions).

Aquí hay una puntuación de ejemplo (0 = bien, 3 = severo):

| Área | Puntuación | Por qué |

|---|---|---|

| Auth | 3 | Patrones de auth mezclados (cookies + localStorage), falta flujo de refresh |

| Modelo de datos | 2 | La tabla de usuarios existe, pero los roles están duplicados entre tablas |

| Seguridad | 3 | Secretos comprometidos, sin validación en endpoints clave |

| Arquitectura | 2 | Lógica de negocio repartida entre UI y rutas API |

Total: 10/12. Eso suele indicar reconstruir la base (auth + acceso a datos) mientras se reutilizan pantallas y copy del UI.

Arreglos inmediatos (hacer ahora): reemplazar auth por un enfoque consistente, rotar y eliminar secretos expuestos, añadir validación básica y proteger endpoints de alto riesgo, hacer migraciones reproducibles y añadir logging mínimo alrededor del login y la creación de usuarios.

Después de estabilizar la app, deja para después la limpieza estructural (nombres de carpetas, refactors profundos), ajuste de rendimiento y herramientas de admin opcionales.

La sorpresa suele ser el acoplamiento oculto: bugs “rápidos” de login causados por deriva del esquema o por dos IDs de usuario diferentes.

Siguientes pasos: convierte la rúbrica en un plan claro

Transforma tu puntuación en una página de alcance que puedas compartir con un compañero, fundador o cliente. Manténlo simple: qué está roto, qué es riesgoso y qué harás primero.

Incluye:

- Los 3 riesgos principales (flujo de auth roto, modelo de datos poco claro, secretos expuestos)

- Los 5 arreglos principales (escritos como resultados, no tareas)

- Tu recomendación: refactor por etapas o reconstrucción

- El primer hito que puedes entregar de forma segura

- Qué no vas a tocar por ahora (para proteger la línea de tiempo)

Si tu puntuación es alta, planifica una reconstrucción pero manténla pequeña. Define un núcleo mínimo listo para producción: un camino feliz, autenticación real, un esquema de BD limpio y logging básico. Añade funciones después de que la base sea estable.

Si tu puntuación queda en la mitad, elige un refactor por etapas. Empieza por seguridad y autenticación porque afectan todo y son difíciles de parchear después. Luego aborda el modelo de datos y solo después la limpieza de arquitectura.

Si heredaste una app generada por IA y estás enterrado en desconocidos, obtener un diagnóstico externo puede ser la forma más rápida de dejar de adivinar. FixMyMess (fixmymess.ai) se centra en tomar prototipos generados por IA y convertirlos en listos para producción mediante diagnóstico del código, reparación de lógica, endurecimiento de seguridad, refactor y preparación para despliegue.

Preguntas Frecuentes

¿Cuál es la forma más rápida de estimar el alcance sin leer todo el código?

Empieza respondiendo una cosa: ¿puede un nuevo usuario completar el flujo central de trabajo de extremo a extremo sin fallos ni callejones confusos? Luego busca los multiplicadores de alcance: auth roto, deriva del esquema, secretos expuestos y código “todo mezclado”. No estás intentando arreglar nada aún; intentas predecir si las correcciones se mantendrán.

¿Cuándo debo detenerme y marcar la estimación como bloqueada?

Si no puedes ejecutarlo en un entorno limpio, no puedes confiar en ninguna estimación. El acceso faltante al repo, variables de entorno sin documentar, configuración de base de datos poco clara o no saber cómo es la “data de producción” deben tratarse como bloqueadores. En la práctica, pausa y marca la estimación como bloqueada hasta que se proporcionen esos básicos.

¿Cómo decido entre reparar la app existente y reconstruirla?

Reparar tiene sentido cuando los problemas son locales: un flujo roto, algunas comprobaciones inconsistentes o validación faltante que puede añadirse de forma coherente. Una reconstrucción suele ser más rápida cuando faltan límites básicos: auth inconsistente, permisos no aplicados en el servidor, secretos necesarios en el navegador o modelo de datos que no coincide con lo que la app espera. Si arreglar un bug crea dos nuevos, ya estás pagando “impuesto de reconstrucción”.

¿Por qué los problemas de autenticación amplían tanto el alcance?

Porque auth afecta casi cada pantalla y llamada API. Un síntoma pequeño —cierres de sesión aleatorios, correos para restablecer que no llegan, la UI dice “logueado” mientras la API rechaza solicitudes— suele indicar que el estado está repartido en varios sitios sin una única fuente de verdad. Eso normalmente implica un rediseño y volver a probar muchas funciones, no un parche de una línea.

¿Cuál es la manera más simple de saber si la autorización es realmente segura?

La protección solo en la UI no protege. Si un usuario puede llamar a un endpoint de admin o obtener datos privados directamente llamando a la API, el problema es de alta gravedad. La solución es definir permisos con claridad, aplicarlos en el servidor para cada ruta relevante y verificar las reglas de propiedad de datos para no filtrar ni corromper información de usuarios.

¿Cuáles son las señales más rápidas del modelo de datos para revisar?

Busca desajuste y ambigüedad: el código lee campos que no existen, tablas con columnas sin usar, múltiples formas de representar la propiedad (email en un sitio, userId en otro), o roles duplicados en varias tablas. Estos crean bugs “embrujados” donde las cosas se rompen de formas extrañas porque la app no sabe cuál es la verdad. Arreglarlo suele requerir elegir una fuente de verdad limpia y actualizar código y datos juntos.

Si encuentro secretos comprometidos, ¿es solo una limpieza rápida?

Si ves claves API, contraseñas de bases de datos o secretos JWT comprometidos en el repo o en el bundle del front-end, asume que ya se filtraron. Rotar claves es necesario, pero no es la solución completa si el diseño aún exige secretos en el navegador. Trata esto como un incidente de seguridad y una señal de alcance: puede que la arquitectura necesite cambios, no solo limpieza.

¿Qué problemas de seguridad suelen indicar que necesito arreglos más amplios, no parches?

Cuando la app construye consultas por concatenación de strings, acepta entradas sin validar o tiene SQL crudo disperso en múltiples endpoints, no puedes parchear una ruta y estar seguro. Necesitas un patrón consistente para validación y acceso a la base de datos para no repetir el mismo fallo en otro lugar. Cuantos más sitios muestren ese patrón, más debe incluir la estimación cambios sistémicos y retesting.

¿Qué señales de arquitectura predicen que la refactorización será dolorosa?

Suele presentarse como “todo está en todas partes”: reglas de negocio duplicadas entre UI y API, llamadas a la base de datos dentro de componentes UI, múltiples maneras de hacer lo mismo y estado en memoria como si solo existiera un servidor. En ese entorno, los cambios no se mantienen locales y las refactorizaciones se inflan porque sigues encontrando dependencias ocultas. Si no puedes explicar dónde viven auth, reglas de negocio y acceso a datos en términos sencillos, tu alcance debería incluir limpieza de límites o una reconstrucción parcial.

¿Cómo debo presentar una estimación de alcance para que no se convierta en semanas de conjeturas?

Usa un rango y deja explícita la incertidumbre. Escribe tres buckets cortos: qué arreglarás primero para que quede seguro, qué dejarás para después y qué está fuera de alcance para que la línea de tiempo no explote. Si heredaste un prototipo generado por IA y los desconocidos se acumulan, FixMyMess puede ejecutar una auditoría de código gratuita y dar una recomendación clara de reparar o reconstruir; la mayoría de las remediaciones se completan en 48–72 horas tras la auditoría.