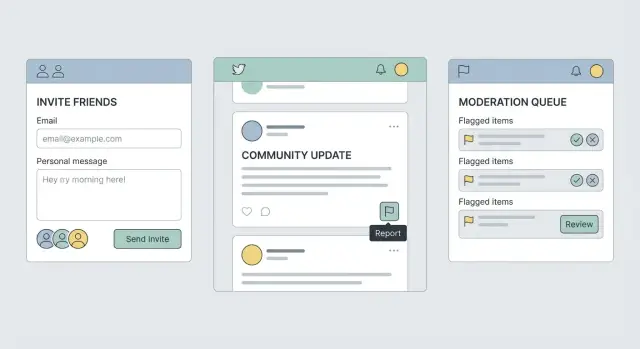

Flujo de moderación para apps comunitarias construidas con IA

Un plan práctico para el flujo de moderación en una app comunitaria: invitaciones, acciones por roles, reportes y pasos de revisión que mantienen tu espacio seguro.

Por qué los flujos de seguridad hacen o rompen una app comunitaria

Una app comunitaria puede parecer amigable el primer día y caótica a la semana. Ese cambio rara vez se debe a las funciones. Sucede cuando no hay un flujo de seguridad claro: la gente no sabe cómo reportar problemas, los moderadores no saben qué hacer después y los actores malintencionados aprenden que pueden pasar límites sin consecuencias.

Sin un plan, los mismos problemas se repiten: cuentas de spam publicando enlaces, acoso en respuestas y mensajes directos, suplantación de miembros confiables y estafas dirigidas a usuarios nuevos. Incluso unos pocos incidentes pueden marcar el tono. Los miembros habituales dejan de publicar y las personas que más deseas retener se van primero.

Las funciones llamativas rara vez solucionan esto. Las invitaciones y los reportes importan más porque controlan quién entra y qué sucede cuando algo sale mal. Si las invitaciones son fáciles de abusar, verás oleadas de cuentas de bajo esfuerzo. Si reportar es confuso o parece inútil, los miembros discutirán en público, se irán en silencio o llevarán los problemas a otro lugar.

Un flujo sólido de moderación no se trata de ser estricto. Se trata de ser consistente. El mismo tipo de comportamiento debería llevar al mismo siguiente paso, y los miembros deben saber qué esperar.

Para un equipo pequeño, “suficientemente seguro para lanzar” suele significar que puedes hacer cuatro cosas de forma fiable:

- Reducir el abuso en la puerta con comprobaciones básicas de invitación y límites de tasa.

- Permitir que cualquiera reporte en unos pocos toques, con motivos claros y detalles opcionales.

- Dar a los moderadores un conjunto pequeño de acciones (advertir, eliminar contenido, silenciar, banear) con una escalada clara.

- Mantener un registro ligero de lo que pasó (quién hizo qué, cuándo y por qué).

Si tu app fue construida rápidamente con herramientas de IA, prueba estos flujos temprano. Los equipos a menudo descubren que la autenticación, los permisos o las pantallas de reportes parecen correctos pero fallan en el uso real.

Define reglas claras que realmente puedas aplicar

Las reglas solo funcionan si puedes aplicarlas de la misma manera cada vez. Empieza por definir en una frase para quién es la comunidad y añade una frase sobre lo que no es. Ejemplo: “Un grupo de pares para nuevos product managers. No es un lugar para vender servicios o reclutar para empleos no relacionados.” Esa frase guiará decisiones más adelante.

Después, convierte tus reglas en unas pocas categorías sencillas que puedas etiquetar y actuar rápidamente. Si una regla no se puede mapear a una categoría, es difícil de aplicar.

- Spam y estafas (publicaciones masivas, enlaces de referidos, sorteos falsos)

- Acoso y odio (insultos, amenazas, ataques dirigidos)

- Contenido inseguro (ánimo de autolesión, contenido sexual con menores)

- Desinformación (afirmaciones médicas dañinas, suplantación)

- Violaciones de privacidad (doxxing, compartir capturas privadas)

Luego decide qué es automático y qué necesita a un humano. Mantén la lista “automática” corta y obvia. Los falsos positivos se sienten injustos y hacen que la gente desconfíe de los reportes.

Una separación práctica podría ser: bloquear automáticamente patrones claros de spam, estafas obvias, doxxing y contenido sexual infantil; ocultar automáticamente contenido pendiente de revisión cuando hay reportes repetidos, insultos o suplantación; y enviar a revisión humana los casos que requieren contexto (disputas, sarcasmo, chistes límite).

Escribe mensajes cortos orientados al usuario antes de necesitarlos. Deben decir qué pasó, por qué y qué hacer a continuación.

Ejemplo de mensaje de eliminación: “Hemos eliminado tu publicación porque incluía un enlace de venta. Este espacio es para discusión, no promoción. Puedes volver a publicar sin enlaces.”

Ejemplo de advertencia: “Por favor deja de comentar rasgos personales. Crítica ideas, no personas. La próxima vez podría resultar en un silencio temporal.”

Diseña un flujo de invitación e incorporación que reduzca el abuso

Un buen flujo de invitación e incorporación hace dos cosas a la vez: ayuda a las personas reales a unirse rápidamente y hace que sea molesto para los malos actores aparecer en masa. Cuando aciertas, la moderación se mantiene más tranquila porque entran menos problemas.

Elige la “puerta” adecuada para tu comunidad

Escoge el método de entrada más simple que coincida con tu riesgo:

- Afiliación abierta: mejor para espacios de bajo riesgo, pero espera más spam y trolls ocasionales.

- Solo por invitación: ideal en etapas tempranas y para grupos de pago; crecimiento más lento, tono más seguro.

- Lista de espera: útil cuando necesitas tiempo para revisar perfiles o controlar el crecimiento.

- Referencias: fuerte cuando los miembros avalan a los nuevos y puedes rastrear el abuso hasta su origen.

Puedes empezar estricto y relajarte después. Endurecer reglas cuando la comunidad ya está desordenada es mucho más difícil.

Añade fricción ligera que bloquee el abuso masivo

La mayoría del abuso no es “una persona teniendo un mal día”. Son intentos repetidos, registros automatizados y compartir enlaces. Unos pocos guardarraíles ayudan mucho:

- Haz que los enlaces de invitación expiren (por ejemplo, 24 a 72 horas) y soporta códigos de un solo uso.

- Limita la tasa de creación de invitaciones y registros (por cuenta, por IP y por dispositivo cuando sea posible).

- Requiere un correo verificado antes de publicar o enviar MDs; considera verificación telefónica opcional para grupos de mayor riesgo.

- Limita cuántas cuentas pueden crearse desde un mismo dispositivo en una ventana de tiempo.

Vincula la fricción al poder. Las cuentas nuevas pueden leer y reaccionar, mientras que publicar, enlazar fuera y mandar MDs se desbloquean después de verificación o un breve periodo de “buen comportamiento”.

Incorporación que establece normas antes de que empiecen los problemas

La incorporación no es solo una pantalla de bienvenida. Es tu primera oportunidad para marcar expectativas en lenguaje claro. Una breve casilla de “compromiso comunitario” más unas pocas preguntas pueden reducir el mal comportamiento y dar a los moderadores algo concreto a lo que referirse después.

Ejemplo: un grupo local de founders puede preguntar: “¿Qué estás construyendo?” y “¿Para qué estás aquí: feedback, contratación o networking?” Luego mostrar tres reglas: no acoso, no spam y mantener los pitches en el canal correcto.

Registra lo suficiente para investigar, sin incomodar a la gente

Para las invitaciones, registra lo que te ayuda a rastrear el abuso sin recopilar datos personales de más:

- ID del invitador, tipo de invitación y cuándo se creó y usó

- estado de la invitación (expirada, usada, revocada) y cuántas veces se intentó

- señales básicas como región de IP o hash de huella de dispositivo (si lo usas), no detalles crudos del dispositivo

- las primeras acciones que hizo una cuenta nueva (unirse, publicar, enviar MD), con marcas de tiempo

Construye reportes que sean fáciles de usar y difíciles de manipular

Un buen sistema de reportes en la app debería tomar segundos, proteger a la persona que reporta y dar a los moderadores contexto suficiente para actuar.

Pon “Reportar” donde realmente ocurre el daño: en publicaciones y comentarios, dentro de MDs y hilos de mensajes, en perfiles de usuario (por suplantación o acoso repetido) y a nivel de grupo o canal (para anillos de spam).

Mantén el formulario de reporte corto. Pregunta primero por una categoría (acoso, spam, odio, suplantación, preocupación por autolesión, amenaza de violencia, doxxing, otro). Luego ofrece notas opcionales y una manera simple de adjuntar evidencia, como una captura de pantalla o un ID de mensaje que tu app capture automáticamente.

Permite que las personas se protejan mientras reportan. Una opción de “Bloquear” o “Silenciar” dentro de la pantalla de reporte reduce el daño de inmediato. Si bloquear también cambia el acceso a un grupo compartido, indícalo antes de confirmar.

Establece expectativas en la pantalla final. Diles qué pasa después, qué puedes y no puedes compartir y cuál suele ser el tiempo de respuesta. Si no puedes prometer un plazo, da un rango y explica qué lo cambia (severidad, reincidencia, falta de detalles).

Haz el flujo más difícil de abusar. Limita el ritmo de reportes desde cuentas nuevas, vigila reportes falsos repetidos y exige una breve razón cuando alguien reporta a la misma persona otra vez. Evita exponer detalles que puedan identificar al reportante.

Los casos de emergencia necesitan una vía más rápida. Añade una opción “urgente” solo para categorías de alto riesgo y dispara alertas inmediatas para:

- amenazas creíbles de violencia

- amenazas de autolesión o intención suicida

- doxxing (dirección de domicilio, lugar de trabajo, teléfono privado)

- preocupaciones de seguridad infantil

Ejemplo: alguien recibe un MD con su dirección. Lo reporta, elige “Doxxing”, la app adjunta el mensaje automáticamente y bloquea al remitente. La confirmación explica que el mensaje queda bloqueado para revisión y un moderador lo verá al inicio de la cola con una etiqueta de urgencia.

Acciones de moderación y reglas de escalada

Un flujo de moderación necesita dos cosas: un menú claro de acciones y reglas claras sobre cuándo usar cada una. Sin eso, los resultados parecen aleatorios y los malos actores encuentran huecos.

Acciones que apoyan, no solo castigan

Empieza con un conjunto pequeño de acciones que cubran la mayoría de los casos:

- Eliminar contenido (ocultar o borrar una publicación/comentario)

- Advertir (citar la regla y qué debe cambiar)

- Tiempo fuera (modo solo lectura temporal o sin poder publicar por un periodo)

- Suspensión (cuenta pausada por días, requiere revisión para volver)

- Baneo (eliminación permanente, con salvaguardas por dispositivo/IP si las usas)

Las acciones suaves también importan, especialmente cuando alguien está en el límite o un hilo se está calentando. Cosas como modo lento, restricciones temporales de enlaces o requerir aprobación para cuentas nuevas pueden detener el daño sin llegar al baneo.

Escalada y apelaciones

Define quién puede hacer qué. Un camino simple funciona: el moderador maneja la primera respuesta, el admin maneja reincidencias y casos límite, y el propietario decide sobre baneos permanentes o temas de alto riesgo (acoso, doxxing, amenazas). Para acciones difíciles de revertir (como un baneo), requiere la confirmación de una segunda persona.

Deben existir apelaciones, pero no para todo. Permite apelaciones para tiempos fuera largos, suspensiones y baneos. No permitas apelaciones para spam obvio o violaciones claras de seguridad. Idealmente, asigna a un revisor de apelaciones que no haya participado en la decisión original y pon un límite de tiempo (por ejemplo, dentro de 7 días) para que los casos no se alarguen.

La consistencia es más fácil con tres herramientas pequeñas: razones predefinidas que mapeen a tus reglas, notas internas ocultas a los miembros y un contador de strikes simple para que la reincidencia escale de forma predecible.

Paso a paso: configura el flujo completo desde la invitación hasta la resolución

Trata el flujo como una línea de montaje: quién puede hacer qué, a dónde van los reportes y cómo se toman las decisiones. Configúralo una vez y cíñete a él.

Paso 1: Define roles de moderación y permisos

Empieza con roles que puedas explicar en una frase cada uno: miembro, de confianza, moderador, admin. “De confianza” es útil porque da a miembros probados más libertad (publicar enlaces, invitar) sin darles poder total de moderación.

Anota qué puede ver y hacer cada rol. Manténlo aburrido y específico.

Una lista rápida de verificación:

- Quién puede invitar nuevos usuarios

- Quién puede ver identidades de reportantes

- Quién puede ocultar contenido versus borrarlo

- Quién puede aplicar tiempos fuera versus baneos

- Quién puede ver el registro de moderación

Paso 2: Crea estados para la cola de reportes

Dale a cada reporte un estado para que nada se pierda. Un conjunto simple es: Nuevo, Triaje, Resuelto, Apelado.

Nuevo significa que acaba de llegar. Triaje significa que un moderador está revisando contexto (historial de mensajes, capturas, reportes pasados). Resuelto significa que se tomó una acción o el reporte se cerró con una razón. Apelado significa que el usuario impugnó la decisión y necesita una segunda revisión.

Paso 3: Añade notificaciones que mantengan informada a la gente

Notifica a los moderadores cuando un reporte entre en Nuevo y de nuevo si se queda mucho tiempo. Notifica al reportante cuando el reporte pase a Resuelto, aunque no puedas compartir detalles. Un mensaje corto como “Gracias, lo revisamos y tomamos medidas” evita reportes repetidos y frustración.

Evita alertas ruidosas. Agrupa los items de baja prioridad, pero envía alertas inmediatas para reportes de alto riesgo (amenazas, doxxing, seguridad infantil, estafas).

Paso 4: Añade límites de tasa y comprobaciones de abuso

El abuso suele aparecer a través de invitaciones y reportes. Añade límites simples temprano:

- limitar invitaciones por cuenta por día (más estricto para cuentas nuevas)

- frenar reportes repetidos de un mismo usuario en una ventana corta

- detectar ráfagas de reportes y dirigirlas a revisión

- exigir una nota corta para categorías de reporte severas

- marcar cuentas con muchos reportes rechazados para revisión más cercana

Paso 5: Usa una plantilla de decisión para consistencia

Cada acción de moderación debe registrar los mismos campos mínimos: razón, acción y seguimiento.

- Razón: qué regla se infringió (lenguaje sencillo)

- Acción: qué pasó (ocultar publicación, advertir, silenciar 24h, banear)

- Seguimiento: qué puede hacer el usuario después (editar y republicar, apelar, recursos de ayuda)

Si tu app está construida con IA, planifica tiempo extra para probar casos límite, como si “silenciar” realmente bloquea notificaciones o si el contenido oculto sigue apareciendo en búsquedas.

Registros, trazas de auditoría y principios básicos de privacidad

Una comunidad puede parecer “moderada” incluso cuando no es justa. Los buenos registros arreglan eso. Permiten revisar decisiones, detectar patrones y explicar lo que pasó sin depender de la memoria.

Decide qué debes registrar para que las decisiones sean trazables y nada más. Guarda los hechos necesarios para entender un caso, no una copia completa de la vida privada de todos.

Un conjunto mínimo que suele servir:

- Detalles del reporte: categoría, texto libre, IDs de mensajes/publicaciones relevantes

- Acción tomada: ninguna, advertencia, eliminación de contenido, silencio, baneo (más duración)

- Marcas de tiempo: cuándo se reportó, cuándo se revisó, cuándo se actuó

- Actores: quién reportó, qué moderador lo gestionó, quién aprobó la escalada

- Punteros a evidencia: IDs de adjuntos o capturas de mensajes (solo lo necesario)

Los problemas de privacidad suelen venir por datos almacenados “por si acaso”. Evita registrar historial completo de mensajes, IPs crudas o copiar perfiles enteros en cada registro. Si debes guardar contenido sensible (capturas, extractos), limita quién puede verlo. Separar permisos de “ver contenido” de permisos de “actuar” ayuda a que moderadores junior procesen colas sin revisar material privado.

Básicos de la traza de auditoría

Cada acción de moderación debe escribir un evento claro: quién hizo qué, a quién, cuándo y por qué. Haz que el “por qué” sea obligatorio para acciones serias (silenciamientos largos, baneos). Si permites editar reportes, guarda historial de versiones para que los cambios sean visibles.

Dashboards simples que realmente ayudan

No necesitas analíticas sofisticadas. Un pequeño dashboard que se actualice a diario es suficiente:

- tamaño de la cola y reporte más antiguo abierto

- reincidentes (usuarios con múltiples acciones confirmadas)

- categorías principales de reporte

- carga de trabajo de moderadores (casos por moderador)

- acciones revocadas (apelaciones que revirtieron decisiones)

Define reglas de retención antes del lanzamiento. Guarda eventos de auditoría más tiempo que la evidencia cruda. Por ejemplo, conserva eventos de auditoría 12 a 24 meses, pero elimina adjuntos y capturas de 30 a 90 días salvo que el caso esté escalado.

Errores comunes que crean resultados inseguros o injustos

La mayoría de apps comunitarias fallan en seguridad por una razón simple: las reglas están escritas, pero los flujos no.

Demasiado poder en una cuenta de moderador

Un error común es dar a moderadores acceso total a perfiles de usuario, correos, datos de IP, mensajes privados o detalles de facturación solo para que manejen reportes básicos. Eso es riesgoso para la privacidad y puede causar daño real si alguien actúa de forma indebida o emocional.

Mantén permisos estrechos y basados en tareas. Un moderador que puede ocultar una publicación no debería poder ver automáticamente el historial completo de un usuario o exportar listas de miembros.

Sin guardarraíles contra spam y ataques coordinados

Si las invitaciones y reportes se usan ilimitadamente, los malos actores lo aprovecharán. Verás spam de invitaciones, cuentas falsas y campañas de reportes diseñadas para silenciar a alguien.

Añade fricción que no castigue a usuarios normales: limita invitaciones para miembros nuevos, regula reportes repetidos, detecta ráfagas y exige una razón corta para ciertos tipos de reporte.

Casos límite que rompen la confianza

La moderación se complica en las esquinas: una publicación se borra antes de revisarse, dos usuarios se bloquean mutuamente, un miembro es baneado de un grupo pero no de la app, o un mensaje reportado está en un hilo privado. Si tu UI dice “Reporte enviado” pero los moderadores no pueden ver el contenido, los usuarios se sentirán ignorados.

Asegura que cada reporte pueda resolverse aunque falte contenido. Guarda una instantánea mínima (qué pasó, cuándo y por qué) para que los revisores actúen sin exponer más datos de los necesarios.

Mensajes confusos y sin apelaciones

Notificaciones genéricas como “Violaste las normas” sin contexto hacen que la gente sienta castigo aleatorio. El silencio después de un reporte hace lo mismo.

Cada acción debe incluir una razón en lenguaje claro, qué pasa a continuación y cómo apelar (cuando aplique). Incluso una opción simple de “solicitar revisión” reduce la rotación y los conflictos públicos.

Lista rápida de verificación pre-lanzamiento

Puedes lanzar rápido y de forma segura si revisas los detalles aburridos antes de que lleguen usuarios reales.

Ejecuta esta lista en un build staging (o beta privada) y anota lo que ves. Si algo es confuso para ti, será confuso para moderadores y usuarios también.

- Las invitaciones se comportan de forma predecible: expiran, se pueden revocar y no se pueden reutilizar por accidente. Prueba qué pasa si alguien reenvía una invitación.

- Reportar es realmente rápido: desde publicaciones, comentarios, MDs y perfiles, un usuario puede reportar en unos dos toques, añadir una nota corta y enviar.

- Los moderadores tienen una cola clara: los reportes nuevos aterrizan en una bandeja única con filtros básicos (nuevo, en revisión, resuelto).

- Cada acción deja rastro de auditoría: baneos, silenciamientos, borrados, advertencias, cambios de rol y resultados de reportes escriben una entrada con quién lo hizo, cuándo y por qué.

- Los bloqueos se aplican: los usuarios bloqueados no pueden contactar al que los bloqueó (MDs, respuestas, menciones, invitaciones). Verifica que bloquear no filtre información de presencia como estado en línea.

Después de la lista, haz cinco simulacros de abuso rápidos con un compañero: una ráfaga de spam, un intento de suplantación, un hilo de acoso (respuestas y MDs), un intento de evasión (nueva cuenta tras baneo) y un intento de informe falso (usar reportes como arma).

Escenario de ejemplo y siguientes pasos para lanzar de forma segura

Una prueba realista es simple: un miembro recién llegado se une por invitación y empieza a enviar MDs spam en minutos.

Para la persona afectada, el flujo debe sentirse rápido y protectivo. Abre el MD, toca Bloquear, y luego Reportar. El formulario es corto: elegir motivo (Spam), añadir una nota opcional y enviar. La confirmación debería ser clara: “Gracias, recibimos tu reporte. No recibirás mensajes de esta cuenta.”

Para los moderadores, el reporte debe llegar con suficiente contexto para actuar sin exponer datos privados innecesarios: antigüedad de la cuenta, origen de la invitación (quién la envió), conteo de mensajes recientes, el contenido reportado y si otros usuarios reportaron la misma cuenta.

El punto de decisión suele ser tiempo fuera vs baneo. Si es menor, primer incidente y bajo volumen, un tiempo fuera corto más una advertencia puede bastar. Si la cuenta es nueva, envía muchos MDs rápido y tiene múltiples reportes, banear es la opción más segura. La clave es la consistencia: comportamientos similares deben llevar a resultados similares.

Una regla de decisión simple:

- Tiempo fuera para casos menores, primer incidente y bajo volumen.

- Baneo para spam de alto volumen, comportamiento repetido o múltiples reportes.

- Revocar privilegios de invitación (o marcar al invitador) si el mismo invitador sigue trayendo malos actores.

- Escalar a un admin para amenazas, menores o doxxing.

Los reportantes deben recibir una actualización de estado que no revele detalles privados de la acción: “Revisamos tu reporte y tomamos medidas según nuestras normas.” Si ofreces apelaciones, mantenlas sencillas. El usuario baneado puede pedir revisión, pero no debería poder mensajear a moderadores desde la misma cuenta bloqueada.

Si heredaste un prototipo generado por IA donde roles, registros de auditoría o flujos de reporte no resisten estos simulacros, FixMyMess (fixmymess.ai) puede diagnosticar qué está roto y ayudar a que lo básico de seguridad funcione antes del lanzamiento, incluyendo una auditoría de código gratuita.