Versionado de prompts: una forma sencilla de rastrear cambios y revertir

Versionado de prompts simplificado: registra qué pediste, qué cambió y por qué, para comparar salidas, revertir rápido y reducir regresiones.

Por qué las salidas retroceden después de que “mejoras” un prompt

La regresión de salida ocurre cuando un prompt que antes te daba buenos resultados empieza a dar peores resultados tras un cambio que parecía inofensivo. A veces es sutil (unos pocos errores más). A veces es obvio (el modelo ignora tu regla principal).

La regresión suele manifestarse como:

- Deriva de tono (demasiado formal, demasiado comercial, demasiado informal).

- Ruptura de la estructura (faltan encabezados, formato incorrecto, se agregan secciones extras).

- Menor precisión (más conjeturas, contradicciones, menos matices).

- Restricciones olvidadas (límite de palabras, frases prohibidas, elementos obligatorios).

- Menos consistencia (dos ejecuciones dan respuestas muy distintas).

Pequeños ajustes en el prompt pueden provocar grandes cambios porque un prompt no es una lista que el modelo cumple línea por línea. Es un conjunto de señales que compiten por atención. Añadir una frase, quitar un ejemplo o reordenar instrucciones cambia lo que el modelo considera “más importante”.

Los desencadenantes comunes incluyen reglas en conflicto, enterrar una restricción clave más abajo en el prompt, sustituir un ejemplo concreto por uno vago, hacer el prompt más largo para que los detalles tengan menos atención, o cambiar una sola palabra que altera el significado (por ejemplo, “breve” vs “mínimo”).

Lo costoso generalmente no es la mala salida. Es perder el contexto de qué cambió y por qué. Una semana después recuerdas “La versión B era mejor”, pero no puedes explicar qué significaba “mejor”, qué entrada de prueba usaste o qué cambiaste.

Por eso importa el versionado de prompts. El objetivo no es la perfección. Es obtener resultados repetibles y revertir fácilmente. Si puedes decir “v1.3 añadió una regla de formato más estricta y mató el tono amigable”, puedes revertir en minutos en lugar de probar diez ediciones al azar.

Esto importa aún más cuando los prompts afectan trabajo real: correos de incorporación, respuestas de soporte, documentos internos o fragmentos de código. Un pequeño cambio de redacción puede producir código que omite la validación de entrada o expone secretos, y puede que no lo notes hasta más tarde.

Trata los prompts como cambios de producto: registra cada edición, guarda una versión conocida como buena y haz que cada cambio sea fácil de deshacer.

Qué debes rastrear (y qué puedes ignorar)

Un buen versionado de prompts captura unos pocos detalles que explican la mayoría de las regresiones. El objetivo es simple: tú (o un compañero) deberían poder volver a ejecutar la misma solicitud y entender por qué los resultados se ven distintos.

Rastrear esto (causa regresiones reales)

Para cada versión, guarda un pequeño registro que incluya:

- El texto exacto del prompt, copiado tal cual (incluyendo cualquier mensaje de sistema o instrucciones “ocultas”).

- El nombre del modelo y las configuraciones clave (especialmente la temperatura). Si están activadas herramientas o llamadas a funciones, anótalo también.

- La entrada que usaste (texto de referencia, fragmentos de ejemplo, archivos, restricciones, reglas de formato).

- Una salida “dorada” que consideraste buena, más 1-2 frases sobre por qué era buena.

- El caso de prueba que usaste para juzgarla (la misma solicitud del usuario o los mismos datos de muestra).

Eso suele ser solo unas pocas líneas. El mayor ahorro de tiempo es escribir los criterios de éxito. La gente recuerda el prompt, pero olvida qué intentaba preservar.

Puedes ignorar esto (rara vez ayudan)

Algunos detalles parecen útiles, pero rara vez explican regresiones:

- Pequeñas ediciones de formato que no cambian el significado.

- Ensayos largos sobre la intención (más allá de una nota corta de “por qué cambió”).

- Metadatos cosméticos a menos que afecten el enrutamiento o el comportamiento.

- Docenas de muestras de salida. Una salida dorada representativa vence a diez aleatorias.

Un patrón común: bajas la temperatura para obtener respuestas más consistentes. Una semana después las salidas se sienten rígidas y pierden detalles clave. Si registraste el cambio de temperatura y guardaste una salida dorada previa, puedes revertir con confianza en lugar de adivinar.

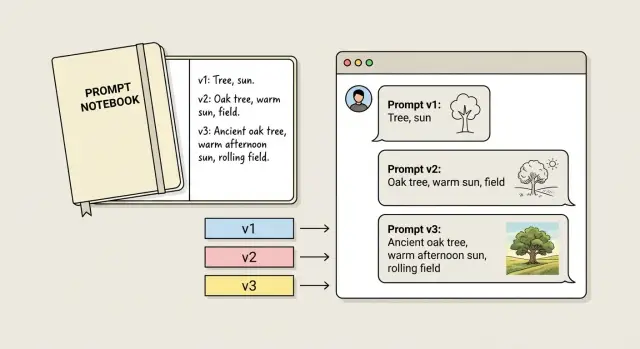

Un esquema de versionado simple que realmente usarás

El versionado de prompts solo funciona si se mantiene ligero. Si se convierte en una ceremonia, dejarás de hacerlo cuando más lo necesites.

Usa IDs de versión cortos que puedas referenciar en cualquier lugar: v1, v1.1, v2.

- Versiones mayores (v1, v2, v3): cambió el objetivo (nueva audiencia, nuevo formato, nuevas restricciones, nuevas reglas de puntuación). Espera salidas distintas.

- Versiones menores (v1.1, v1.2): el objetivo es el mismo, pero ajustaste redacción, orden, un ejemplo o una regla.

- Hotfixes (v1.1a): un parche rápido o un revert para restaurar el comportamiento.

Mantén una frase objetivo por versión. Si no puedes describir en una línea el trabajo del prompt, probablemente el cambio es más grande de lo que crees.

Intenta hacer un cambio significativo por versión. Si cambias tono, añades restricciones y reescribes ejemplos a la vez, no sabrás qué causó la mejora (o la rotura).

La configuración de menor esfuerzo: un archivo, misma estructura siempre

Si solo vas a hacer una cosa, guarda las versiones de los prompts en un solo lugar. Un documento, una nota o un archivo en tu repo basta. La idea es responder en 30 segundos: “¿Qué cambió y cuándo empeoró la salida?”

Elige un nombre de archivo que recuerdes (por ejemplo: prompts.md o prompt_versions.md). Luego usa la misma estructura para cada versión.

Una plantilla simple que puedes copiar

Usa los mismos bloques cada vez: el prompt, el registro de cambios para esa versión, un ejemplo de salida dorada y una línea corta de “problemas conocidos”.

# Prompt: Support Reply Writer

## v1.3 (2026-01-21)

### Prompt

[Paste the full prompt here. No snippets.]

### Change log

- Why: Reduce overly formal tone.

- What changed: Added \"Write like a helpful human\" and removed \"Use professional language\".

### Golden output

[Paste the exact best output you want to preserve.]

### Known issues

Sometimes forgets to ask one follow-up question.

Algunas reglas hacen que esto se mantenga útil con el tiempo:

- Pega el prompt completo cada vez. Los prompts parciales son donde empieza la confusión.

- Escribe el “por qué” en palabras simples. “Mejorar la calidad” no es un porqué. “Evita usar viñetas en correos cortos” sí lo es.

- Mantén una salida dorada por versión. Elige el ejemplo que odiarías perder.

Cómo debe ser una “salida dorada”

La salida dorada no es “la mejor salida de todas.” Es una instantánea con la que puedes comparar después.

Usa una entrada real, luego pega la salida exacta que aprobaste, incluyendo formato, tono y secciones obligatorias. Si una nueva versión empieza a añadir afirmaciones exageradas o a omitir detalles claves, lo notarás de inmediato.

Añade una línea de “Problemas conocidos” incluso si parece menor. Evita que tú (o un compañero) “arreglen” la misma cosa dos veces y rompan otra.

Paso a paso: cómo cambiar un prompt sin perder la buena salida

El objetivo es simple: mantener una salida conocida que siempre puedas recuperar.

Empieza con una tarea base que importe y sea fácil de volver a ejecutar, por ejemplo: “Resume este correo de cliente en 3 viñetas y una respuesta cortés.” Ejecuta tu prompt actual una vez, guarda el texto del prompt como v1 y guarda la entrada y salida exactas.

Luego escribe una comprobación en lenguaje llano de lo que “bueno” significa. Evita objetivos vagos como “mejor” o “más útil.” Haz algo que puedas juzgar rápido.

Un flujo práctico:

- Congela una base: guarda prompt v1 + entrada base + salida.

- Escribe una regla aprobar/fallar: 2-4 líneas (por ejemplo: “No inventar hechos. Usar el nombre del cliente. Incluir un paso siguiente claro. Menos de 120 palabras.”).

- Cambia una cosa: edita una instrucción, restricción o ejemplo y guarda como v1.1.

- Vuelve a ejecutar la misma base: misma entrada, mismas configuraciones.

- Decide rápido: si pasa, mantén v1.1. Si falla, revierte y prueba otro cambio único.

Si añadiste “sé más creativo” y el modelo empieza a inventar detalles, eso es una regresión respecto a “no inventar hechos.” Mantén v1 como copia segura. Prueba un cambio más restricto como “usa un tono más cálido” sin invitar a nueva información.

Solo después de que v1.1 pase deberías ampliar el objetivo (nuevo formato de salida, más casos límite). Ahí tiene sentido crear una v2.

Cómo probar un cambio de prompt rápido (sin sobrepensarlo)

Las pruebas rápidas son principalmente consistencia. Si cambias el prompt y las entradas al mismo tiempo, no sabrás qué causó el cambio.

Elige un pequeño conjunto de ejemplos reales que ejecutes cada semana. Incluye una entrada ligeramente desordenada.

Una rutina repetible:

- Elige 3-5 entradas de prueba.

- Congela todo lo demás (modelo, temperatura, herramientas, mensaje de sistema).

- Ejecuta la Versión A y la Versión B con las mismas entradas.

- Compara lado a lado y escribe una nota de una línea por prueba.

- Si B es mejor en general, promuévela y registra el cambio.

Mantén la puntuación simple:

- Correcto: ¿realizó la tarea sin omitir detalles clave?

- Seguro: ¿evitó filtrar secretos, afirmaciones riesgosas o seguir malas instrucciones?

- En formato: ¿coincidió con la estructura que necesitas (encabezados, JSON, tono, longitud)?

Ejemplo: añades “sé conciso” a un prompt de respuestas de soporte. Dos pruebas mejoran. En la tercera (una solicitud de reembolso enojada), deja de pedir el número de pedido y hace una disculpa vaga. Esa es una regresión en corrección, aunque suene mejor.

Ejemplo: un pequeño ajuste que silenciosamente rompe resultados

Un fundador usa un prompt para redactar correos de soporte. La tarea es simple: responder rápido, mantener la calma y nunca prometer algo que el producto no hace.

La versión 1 funciona bien. Indica al modelo que cite solo lo que dijo el cliente, ofrezca dos próximos pasos y haga una pregunta aclaratoria.

Tras unas semanas, el fundador quiere un tono más cálido y correos un poco más cortos. Crean v2. Los correos suenan mejor, pero aparece un problema: el modelo empieza a inventar detalles como “Revisé tu cuenta” o “Veo que tu último pago falló.” Eso es arriesgado si el soporte realmente no puede ver esos detalles.

El registro de cambios muestra una línea nueva en v2:

v2 change: “Be helpful by filling in missing context when it seems obvious.”

Esa instrucción anima a adivinar. Como el registro de cambios es específico, el fundador puede apuntar al disparador y arreglarlo rápido.

Hacen rollback a v1.1 (la última versión conocida como buena) y reponen solo las partes seguras de v2: saludo más cálido, cierre más corto y la estructura de “dos próximos pasos”. Eliminan cualquier cosa que permita conjeturas y añaden una regla dura: “Si no estás seguro, haz una pregunta en vez de asumir.”

Errores comunes que hacen difícil depurar regresiones

Las regresiones de prompts suelen ser autoinfligidas, no porque la idea fuera mala, sino porque el cambio ocultó la causa.

El mayor error es cambiar demasiado a la vez. Si editas objetivo, tono, reglas de formato y ejemplos en un solo commit, no puedes saber qué rompió el resultado. La solución se vuelve conjeturas y la gente a menudo añade más instrucciones para compensar.

Otro error es no guardar una salida conocida como buena. Sin un antes/después, acabas discutiendo desde la memoria.

Los fallos que más tiempo desperdician:

- Múltiples ediciones a la vez, sin causa clara.

- No guardar la salida “buena” y no guardar la entrada que la produjo.

- Cambiar los datos de prueba y culpar al prompt.

- Las configuraciones cambiaron entre ejecuciones (versión del modelo, temperatura, mensaje de sistema, configuración de herramientas).

- Registrar solo el texto final del prompt, no por qué lo cambiaste o qué esperabas.

La disciplina vence a la astucia: cambia una cosa, mantiene las entradas de prueba fijas y escribe la razón de cada edición en una frase.

Lista rápida antes de lanzar una nueva versión de prompt

Antes de lanzar un nuevo prompt, haz una comprobación rápida para asegurarte de poder reproducir el último resultado bueno y de que puedas revertir si baja la calidad.

La comprobación de 5 minutos antes de enviar

- ¿Puedes reproducir la última salida buena? Usa entradas guardadas y confirma que aún obtienes el resultado base.

- ¿Cambiaste solo una variable? Un cambio significativo por versión mantiene claro causa y efecto.

- ¿Tienes una prueba aprobar/fallar? Elige 2-3 comprobaciones que puedas juzgar rápido (campos requeridos, formato exacto, sin hechos inventados).

- ¿Qué tipo de fallo es? Etiquétalo: formato, hechos, seguridad o tono.

- ¿Es más rápido revertir que parchear? Si estás acumulando arreglos sobre un cambio inestable, revierte y rehace la edición de forma limpia.

Si tus prompts generan código o cambian el comportamiento de la app, toma esto aún más en serio. Reproduce, aísla un cambio, prueba aprobar/fallar y revierte pronto.

Próximos pasos: hazlo un hábito (y cuándo pedir ayuda)

La forma más fácil de mantener el versionado es dejar de tratar tu mejor prompt como algo único. Convierte ese prompt en una plantilla reutilizable con marcadores claros (objetivo, audiencia, restricciones, ejemplos). Si partes siempre de la misma forma, notas qué cambió y los rollbacks siguen siendo sencillos.

Haz el hábito tan pequeño que no puedas saltártelo:

- Usa un ID corto más fecha (por ejemplo:

support_reply_v07_2026-01-21). - Añade una línea simple describiendo el cambio.

- Guarda la salida conocida como buena con la versión, no en el historial del chat.

- Registra lo que esperabas mejorar y lo que empeoró (si ocurre).

A veces el problema no es el prompt. Si ves comportamientos inconsistentes entre usuarios, datos faltantes, autenticación rota o fallos que solo ocurren en producción, puede ser un problema de la app.

Si heredaste una app generada por IA de herramientas como Lovable, Bolt, v0, Cursor o Replit y los ajustes de prompt no bastan, un equipo de remediación como FixMyMess (fixmymess.ai) puede ejecutar una auditoría de código gratuita para identificar problemas como autenticación rota, secretos expuestos y agujeros de seguridad antes de que decidas reparar o reconstruir.

Preguntas Frecuentes

¿Qué significa “regresión de salida” en prompts?

Es cuando un prompt que antes producía buenos resultados comienza a producir resultados peores tras un cambio. La salida puede desviarse en tono, omitir la estructura requerida, ignorar restricciones o volverse menos consistente entre ejecuciones.

¿Por qué una edición mínima del prompt puede causar un gran cambio en la salida?

Porque el modelo responde al conjunto de señales en el prompt, no sigue las instrucciones como una lista de verificación estricta. Un pequeño cambio de redacción, reordenar cosas o un prompt más largo puede cambiar qué considera el modelo como "más importante".

¿Cuál es la forma más rápida de depurar una regresión?

Vuelve a ejecutar exactamente la misma entrada con la versión anterior y la nueva bajo las mismas configuraciones. Si no puedes reproducir el resultado “bueno” anterior, estarás adivinando, así que bloquea el texto del prompt, el modelo y las opciones primero.

¿Qué debo registrar para cada versión de un prompt?

Guarda el texto completo del prompt, el nombre del modelo y configuraciones clave como la temperatura. También guarda la entrada exacta que usaste para probar, además de una "salida dorada" aprobada y una nota corta sobre por qué era buena.

¿Cuándo debo usar una versión mayor vs menor (y hotfix)?

Las versiones mayores son para cuando cambia el objetivo (nueva audiencia, nuevo formato o nuevas reglas de puntuación). Las menores son para ajustes pequeños manteniendo el mismo objetivo, y los hotfixes son parches rápidos o revertidos para restaurar el comportamiento.

¿Por qué es tan importante “un cambio significativo por versión”?

Porque así queda claro qué causa qué. Si cambias tono, reglas de formato y ejemplos a la vez, no sabrás qué ayudó o dañó, y no podrás quedarte con la parte buena mientras reviertes la mala.

¿Qué debe incluir una “salida dorada”?

Debe ser una salida real producida a partir de una entrada real que te importe, pegada exactamente como se generó, incluyendo formato y tono. No tiene que ser perfecta; es un punto de referencia para detectar rápido cuando una nueva versión empieza a omitir requisitos o a inventar detalles.

¿Cómo pruebo cambios en prompts sin darle demasiadas vueltas?

Usa un pequeño conjunto repetible de entradas reales y ejecuta ambas versiones con el mismo modelo y configuraciones. Júzgalas con una comprobación simple tipo aprobar/fallar como “sin hechos inventados”, “mantiene el formato” y “incluye el siguiente paso requerido”, para decidir rápido.

¿Por qué los prompts empiezan a inventar detalles cuando intento hacerlos más amables o breves?

Indicaciones como “sé más creativo” o “llena el contexto faltante” pueden empujar al modelo a adivinar, lo que aumenta las inexactitudes. Si la precisión importa, prefiere reglas como “si no estás seguro, haz una pregunta en lugar de asumir” y mantén “sin hechos inventados” como una restricción estricta.

¿Cuándo no es un problema de prompt y qué debo hacer en su lugar?

Un rollback del prompt no arreglará problemas que provengan de la propia aplicación, como autenticación rota, secretos expuestos o rutas inseguras que solo aparecen en producción. Si heredaste una app generada por IA de herramientas como Lovable, Bolt, v0, Cursor o Replit, FixMyMess (fixmymess.ai) puede ejecutar una auditoría de código gratuita y luego reparar o reconstruir el código cuando ajustes de prompt no basten.